Содержание

- 2. Основные приложения Dimensionality reduction Снижение размерности данных при сохранении всей или большей части информации Feature extraction

- 3. Анализ заемщиков банка Задача : Проанализировать заемщиков банка на основе различных данных

- 4. Личные данные Семейное положение Образование Финансовое состояние Имущество Кредитная история … Данные могут быть:

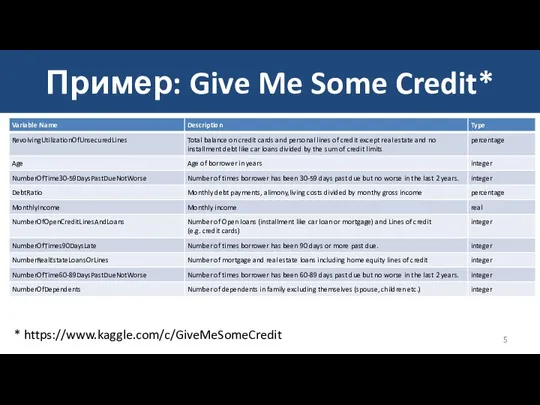

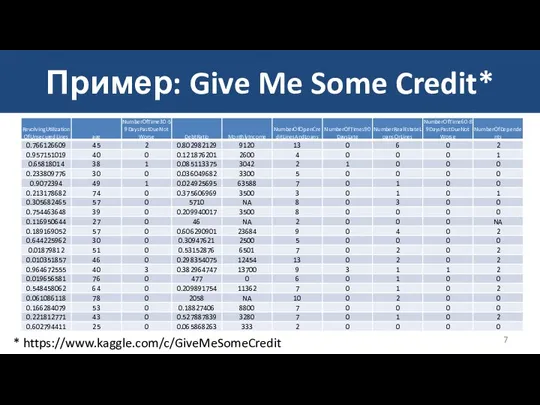

- 5. Пример: Give Me Some Credit* * https://www.kaggle.com/c/GiveMeSomeCredit

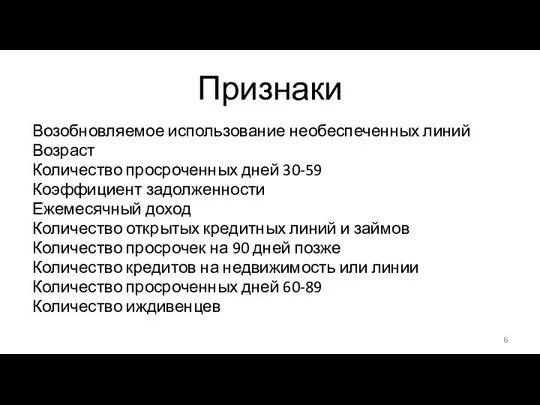

- 6. Признаки Возобновляемое использование необеспеченных линий Возраст Количество просроченных дней 30-59 Коэффициент задолженности Ежемесячный доход Количество открытых

- 7. Пример: Give Me Some Credit* * https://www.kaggle.com/c/GiveMeSomeCredit

- 8. Задача снижения размерности Представить набор данных меньшим числом признаков таким образом, чтобы потеря информации, содержащейся в

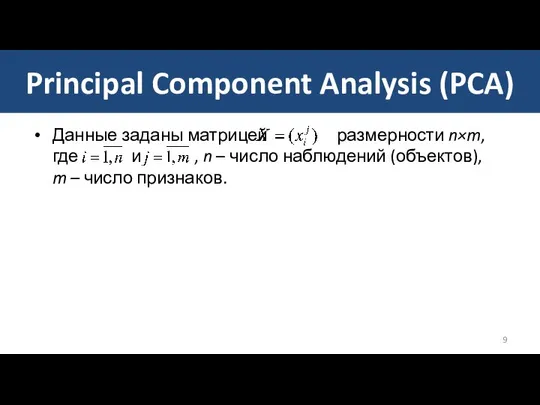

- 9. Principal Component Analysis (PCA) Данные заданы матрицей размерности n×m, где и , n – число наблюдений

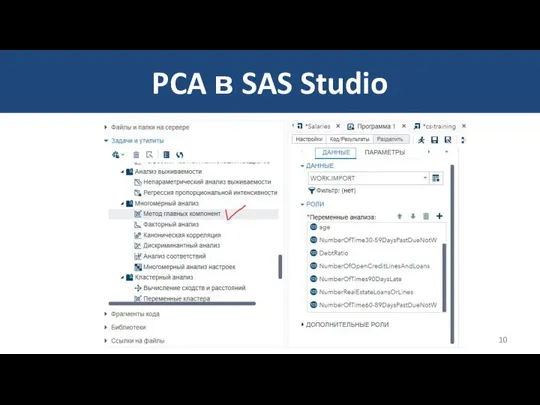

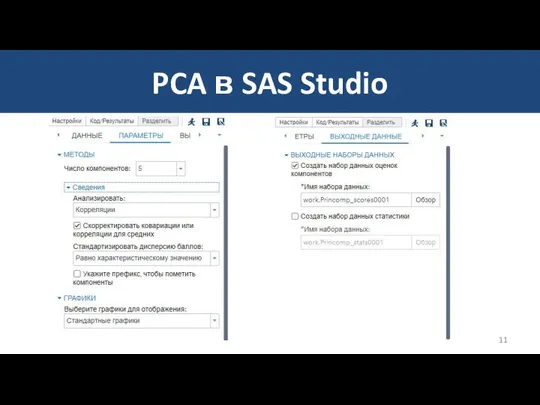

- 10. PCA в SAS Studio

- 11. PCA в SAS Studio

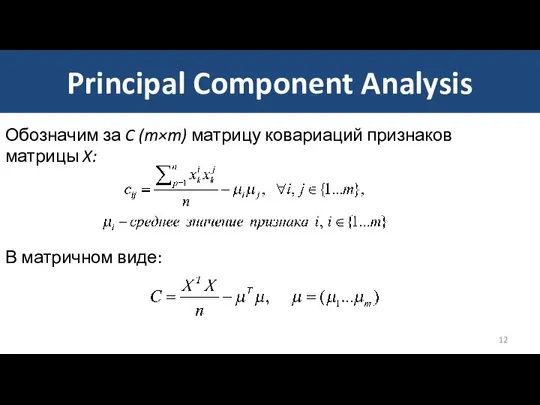

- 12. Principal Component Analysis Обозначим за C (m×m) матрицу ковариаций признаков матрицы X: В матричном виде:

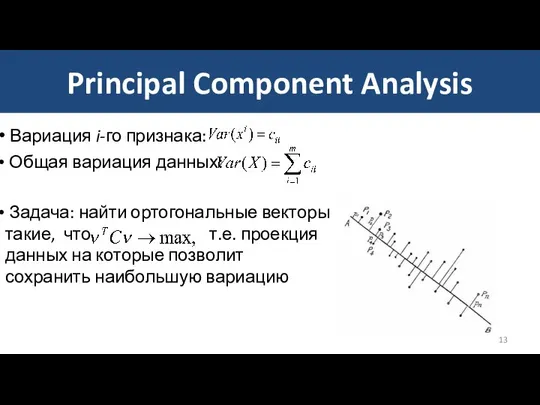

- 13. Principal Component Analysis Вариация i-го признака: Общая вариация данных: Задача: найти ортогональные векторы такие, что т.е.

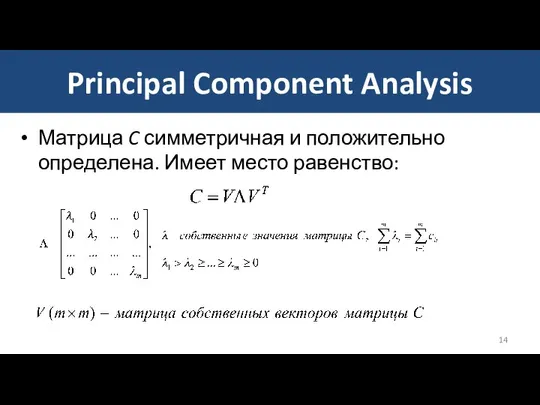

- 14. Матрица C симметричная и положительно определена. Имеет место равенство: Principal Component Analysis

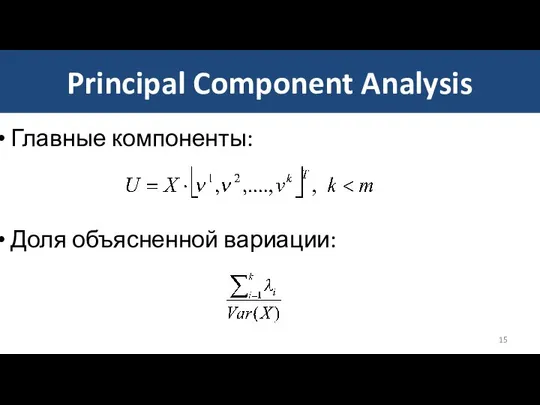

- 15. Principal Component Analysis Главные компоненты: Доля объясненной вариации:

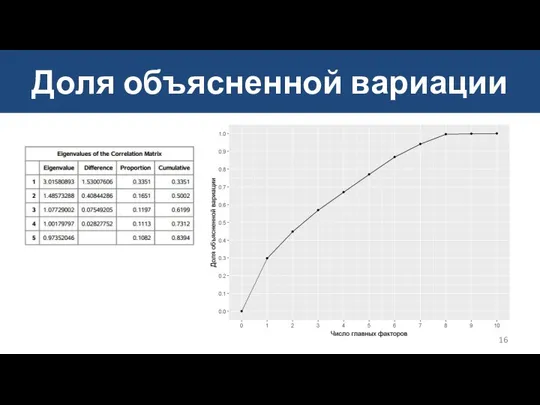

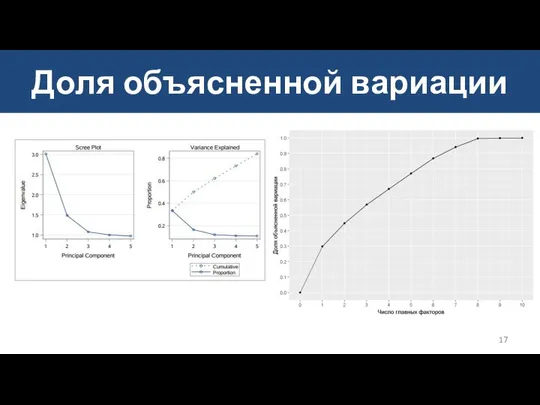

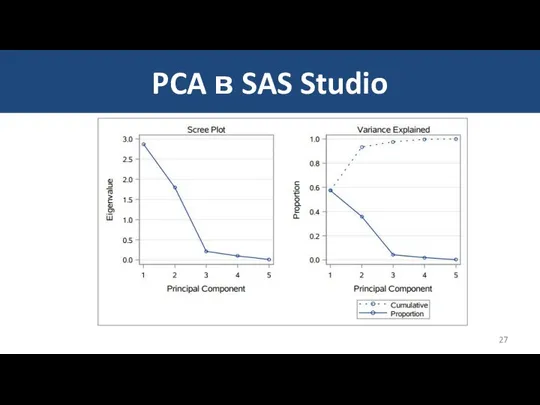

- 16. Доля объясненной вариации

- 17. Доля объясненной вариации

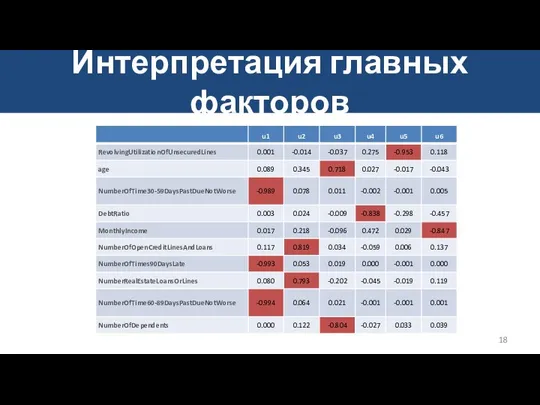

- 18. Интерпретация главных факторов

- 19. Интерпретация главных факторов Исходя из структуры матрицы факторных нагрузок, можно предложить следующую интерпретацию: U1: История просроченных

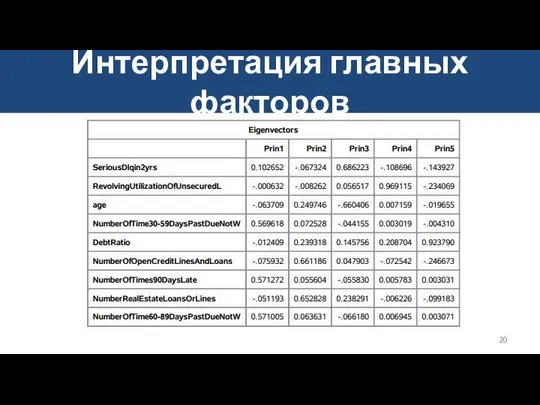

- 20. Интерпретация главных факторов

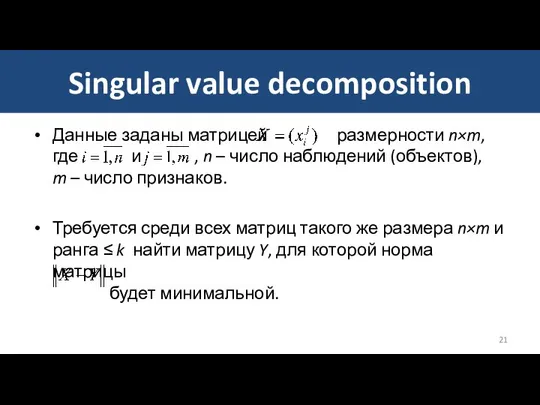

- 21. Singular value decomposition Данные заданы матрицей размерности n×m, где и , n – число наблюдений (объектов),

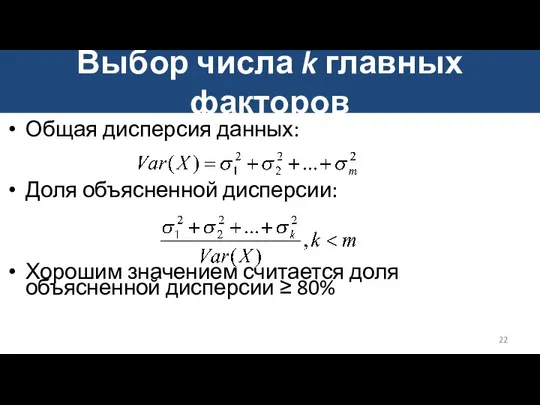

- 22. Выбор числа k главных факторов Общая дисперсия данных: Доля объясненной дисперсии: Хорошим значением считается доля объясненной

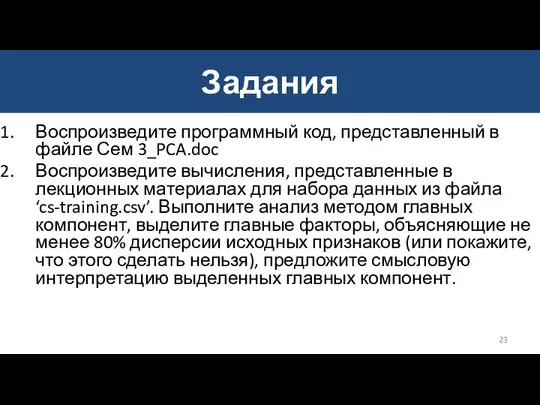

- 23. Задания Воспроизведите программный код, представленный в файле Сем 3_PCA.doc Воспроизведите вычисления, представленные в лекционных материалах для

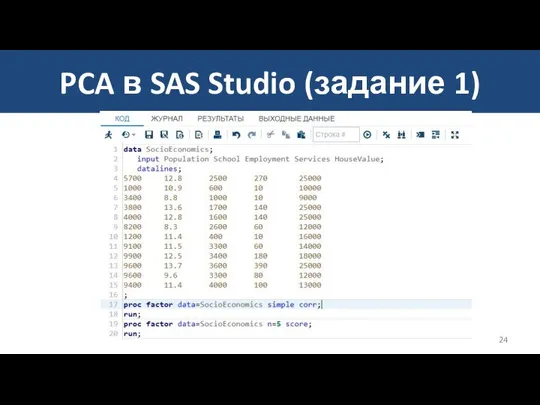

- 24. PCA в SAS Studio (задание 1)

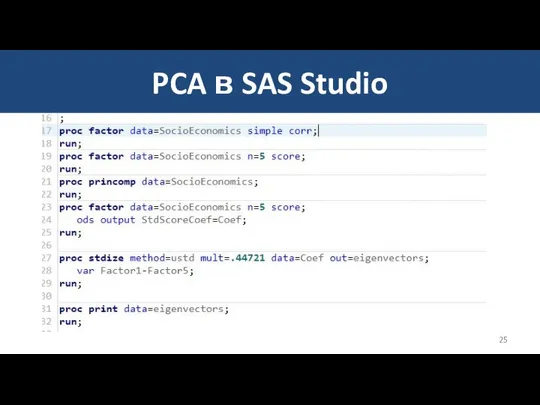

- 25. PCA в SAS Studio

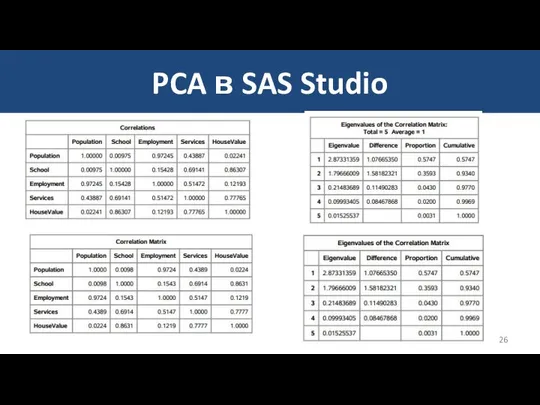

- 26. PCA в SAS Studio

- 27. PCA в SAS Studio

- 29. Скачать презентацию

Законодательная власть в системе государственного управления

Законодательная власть в системе государственного управления Правоохранительная деятельность органов внутренних дел в системе обеспечения экономической безопасности: оценка состояния

Правоохранительная деятельность органов внутренних дел в системе обеспечения экономической безопасности: оценка состояния Об изменениях в трудовом законодательстве

Об изменениях в трудовом законодательстве Избирательная кампания в РФ. Выборы и избирательные системы

Избирательная кампания в РФ. Выборы и избирательные системы Коррупционные правонарушения и правонарушения, создающие условия для коррупции (Тема 4)

Коррупционные правонарушения и правонарушения, создающие условия для коррупции (Тема 4) Преступление как наиболее опасное противоправное деяние

Преступление как наиболее опасное противоправное деяние Криминалистическое исследование подписей, выполненных с намеренным изменением

Криминалистическое исследование подписей, выполненных с намеренным изменением Обстоятельства непреодолимой силы в практике судов Российской Федерации

Обстоятельства непреодолимой силы в практике судов Российской Федерации Сравнительная характеристика наказаний за преступления в России и Саудовской Аравии

Сравнительная характеристика наказаний за преступления в России и Саудовской Аравии Акты незаконного вмешательства

Акты незаконного вмешательства Юридические механизмы защиты прав и свобод. Тема 18

Юридические механизмы защиты прав и свобод. Тема 18 Процессуальное право. Административное юрисдикция и конституционное судопроизводство

Процессуальное право. Административное юрисдикция и конституционное судопроизводство Особенности регистрации поступающих и отправляемых документов в организации

Особенности регистрации поступающих и отправляемых документов в организации Судебное разбирательство

Судебное разбирательство Полномочия муниципальных образований в сфере местного самоуправления

Полномочия муниципальных образований в сфере местного самоуправления Law no. 12 of 1996 promulgating the child law

Law no. 12 of 1996 promulgating the child law Понятие и сущность судебной власти. Модели правосудия в современном мире

Понятие и сущность судебной власти. Модели правосудия в современном мире Правоведение. Гражданин РФ

Правоведение. Гражданин РФ Российское частное право

Российское частное право О выборах депутатов МПСО

О выборах депутатов МПСО Правила оформления списка использованных источников

Правила оформления списка использованных источников Особенности судебного толкования

Особенности судебного толкования С чего начиналось право. Обычаи и законы Древней Руси

С чего начиналось право. Обычаи и законы Древней Руси Арбитражное процессуальное право

Арбитражное процессуальное право Понятия и виды административных наказаний

Понятия и виды административных наказаний Стандарт прохождения модерации

Стандарт прохождения модерации Экстремизм и терроризм

Экстремизм и терроризм Стадии совершения умышленного преступления

Стадии совершения умышленного преступления