Содержание

- 2. План. MPI: основные понятия и определения Введение в MPI Инициализация и завершение MPI программ Определение количества

- 3. Понятие MPI MPI используется в вычислительных системах с распределенной памятью, в которых процессоры работают независимо друг

- 4. Стандарт MPI 1993 г. – объединение нескольких групп в MPI Forum для создания единых требований к

- 5. Стандарт MPI 1997 г – стандарт MPI 2.0 Возможности, заложенные в стандарт превышают возможности самих машин,

- 6. В рамках MPI для решения задачи разрабатывается одна программа, она запускается на выполнение одновременно на всех

- 7. В MPI существует множество операций передачи данных: обеспечиваются разные способы пересылки данных; реализованы практически все основные

- 8. Библиотека MPI Существует для двух языков: Fortran C/C++ Представляет собой реализацию общих положений стандарта под тот

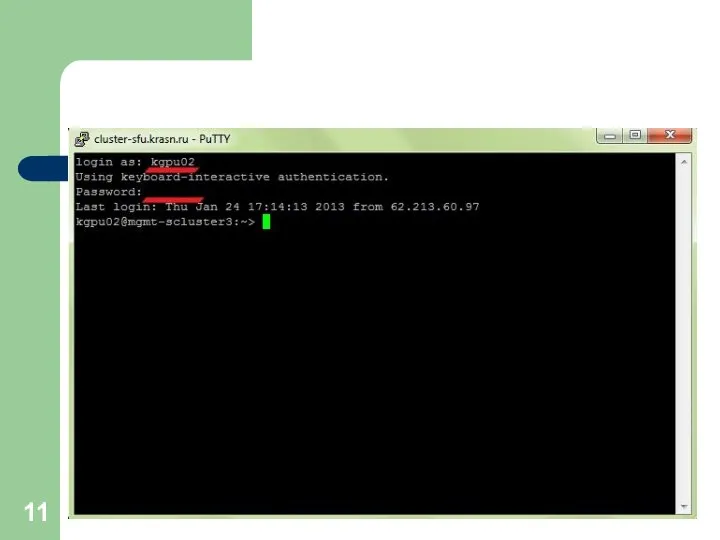

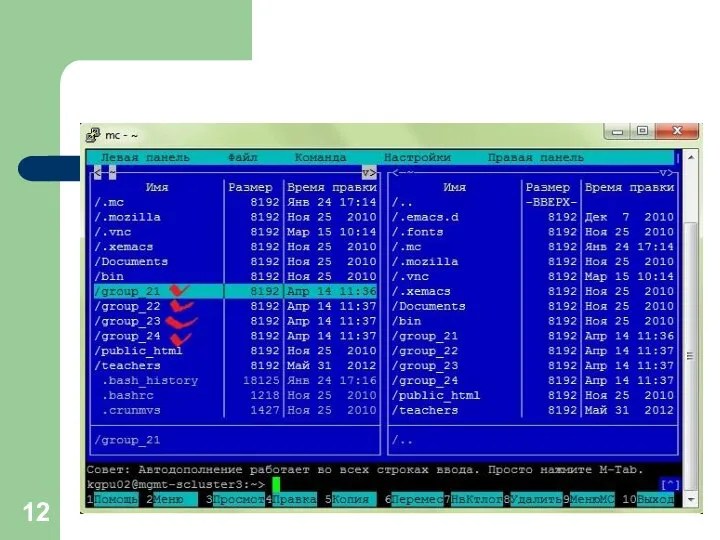

- 9. Работа на кластере Необходимое ПО устанавливается (как правило) на кластерных системах. Доступ к кластеру КГПУ осуществляется

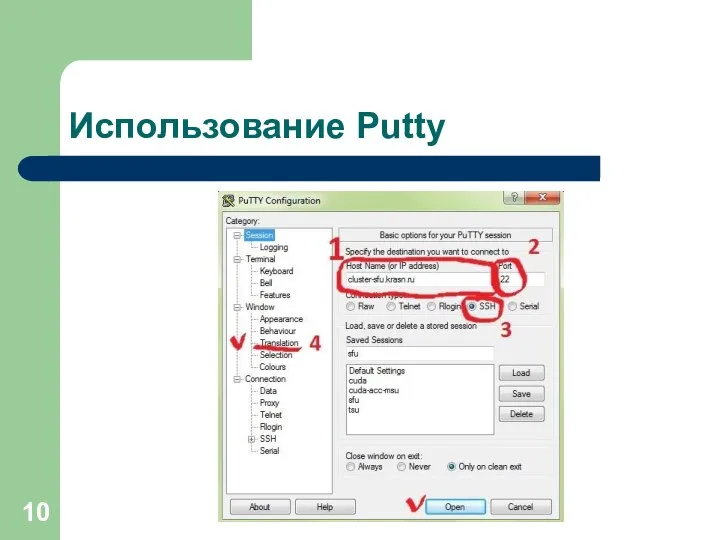

- 10. Использование Putty

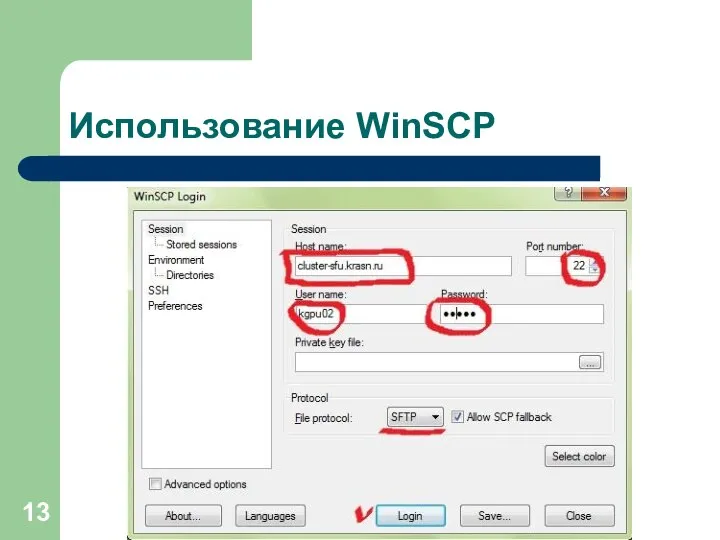

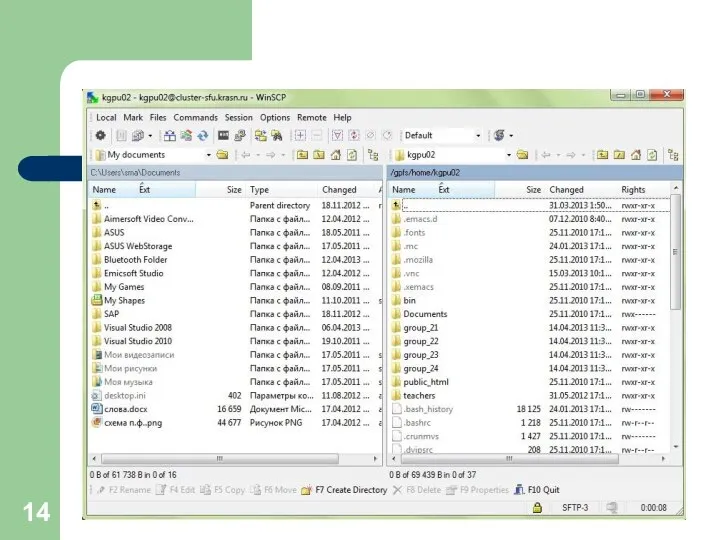

- 13. Использование WinSCP

- 15. MPI: основные понятия и определения… Понятие параллельной программы Под параллельной программой в рамках MPI понимается множество

- 16. MPI: основные понятия и определения… Количество процессов определяется в момент запуска параллельной программы средствами среды исполнения

- 17. MPI: основные понятия и определения… В основу MPI положены четыре основных понятия: Тип операции передачи сообщения

- 18. MPI: основные понятия и определения… Операции передачи данных Основу MPI составляют операции передачи сообщений. Среди предусмотренных

- 19. MPI: основные понятия и определения… Понятие коммуникаторов Определение: Коммуникатор в MPI - специально создаваемый служебный объект,

- 20. MPI: основные понятия и определения… В ходе вычислений могут создаваться новые и удаляться существующие коммуникаторы. Один

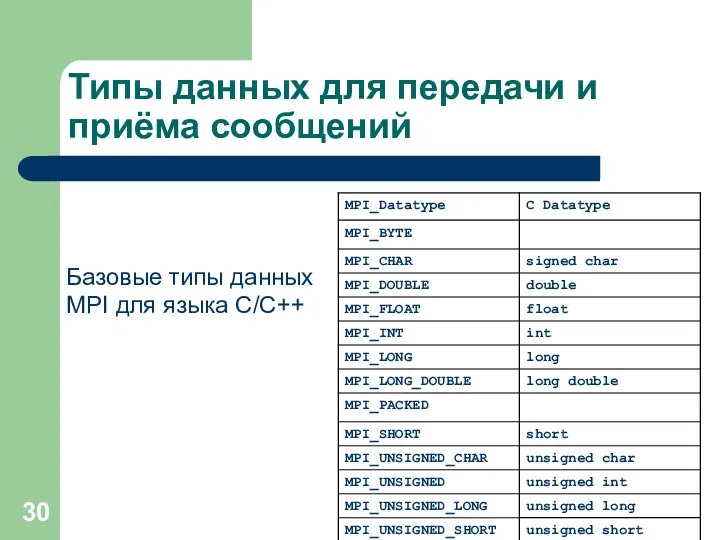

- 21. Типы данных MPI При выполнении операций передачи сообщений для определения передаваемых или получаемых данных в функциях

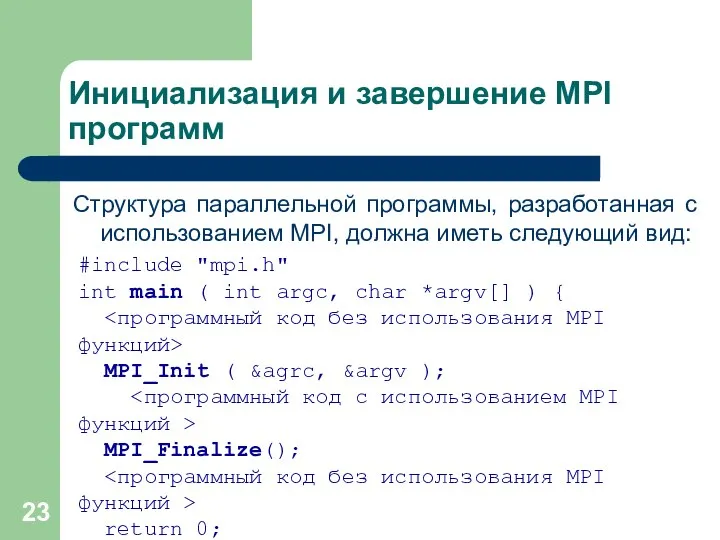

- 22. Инициализация и завершение MPI программ Первой вызываемой функцией MPI должна быть функция: int MPI_Init ( int

- 23. Инициализация и завершение MPI программ Структура параллельной программы, разработанная с использованием MPI, должна иметь следующий вид:

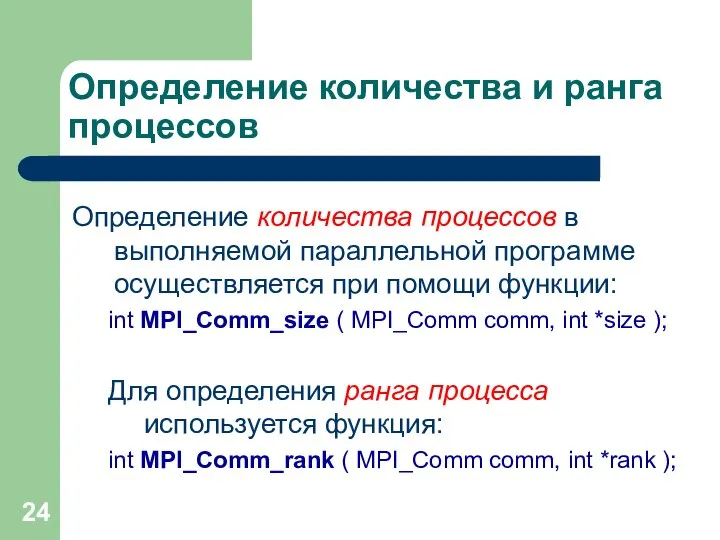

- 24. Определение количества и ранга процессов Определение количества процессов в выполняемой параллельной программе осуществляется при помощи функции:

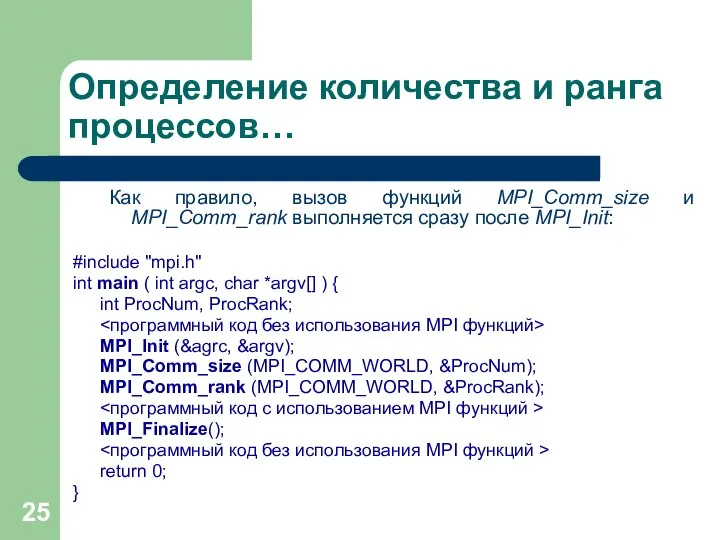

- 25. Определение количества и ранга процессов… Как правило, вызов функций MPI_Comm_size и MPI_Comm_rank выполняется сразу после MPI_Init:

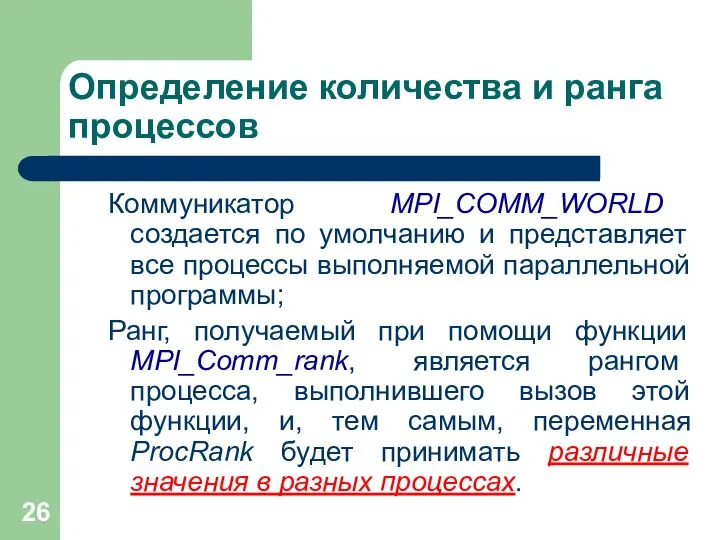

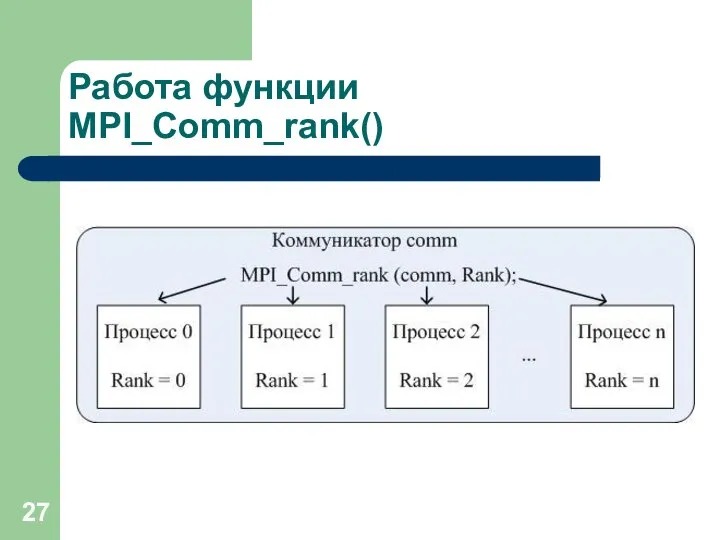

- 26. Определение количества и ранга процессов Коммуникатор MPI_COMM_WORLD создается по умолчанию и представляет все процессы выполняемой параллельной

- 27. Работа функции MPI_Comm_rank()

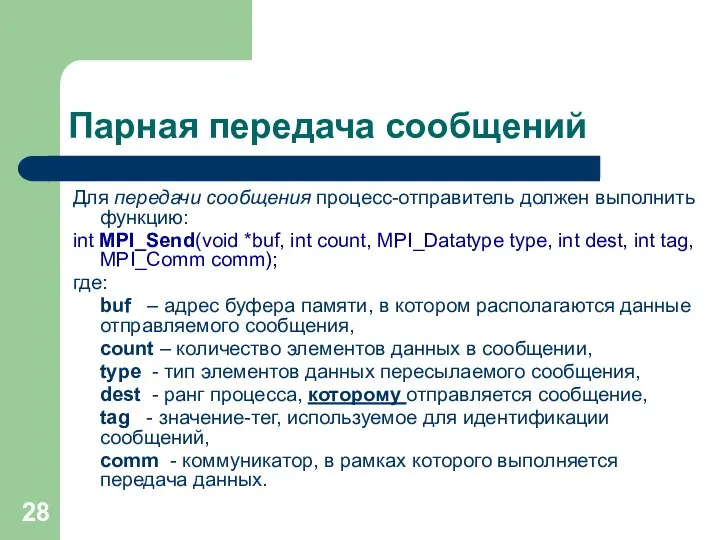

- 28. Парная передача сообщений Для передачи сообщения процесс-отправитель должен выполнить функцию: int MPI_Send(void *buf, int count, MPI_Datatype

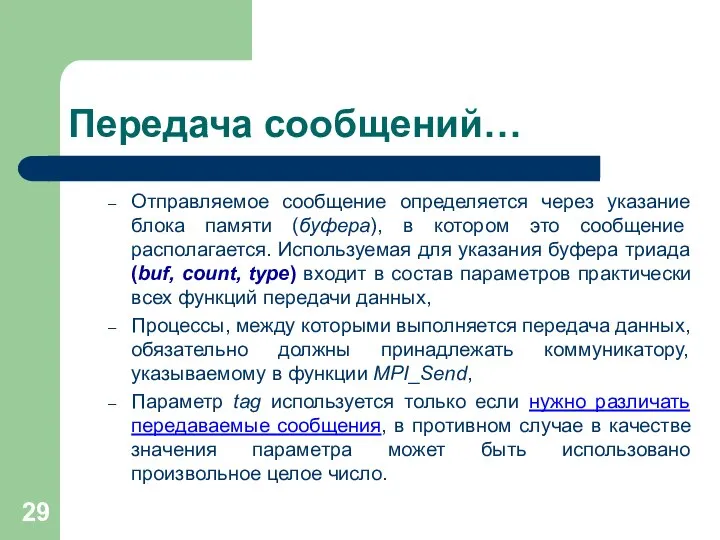

- 29. Передача сообщений… Отправляемое сообщение определяется через указание блока памяти (буфера), в котором это сообщение располагается. Используемая

- 30. Типы данных для передачи и приёма сообщений Базовые типы данных MPI для языка C/С++

- 31. Прием сообщений Для приема сообщения процесс-получатель должен выполнить функцию: int MPI_Recv(void *buf, int count, MPI_Datatype type,

- 32. Прием сообщений… Буфер памяти должен быть достаточным для приема сообщения, а тип элементов передаваемого и принимаемого

- 33. Прием сообщений… Параметр status позволяет определить ряд характеристик принятого сообщения: status.MPI_SOURCE – ранг процесса-отправителя принятого сообщения,

- 34. Прием сообщений… Функция MPI_Recv является блокирующей для процесса-получателя, т.е. его выполнение приостанавливается до завершения работы функции.

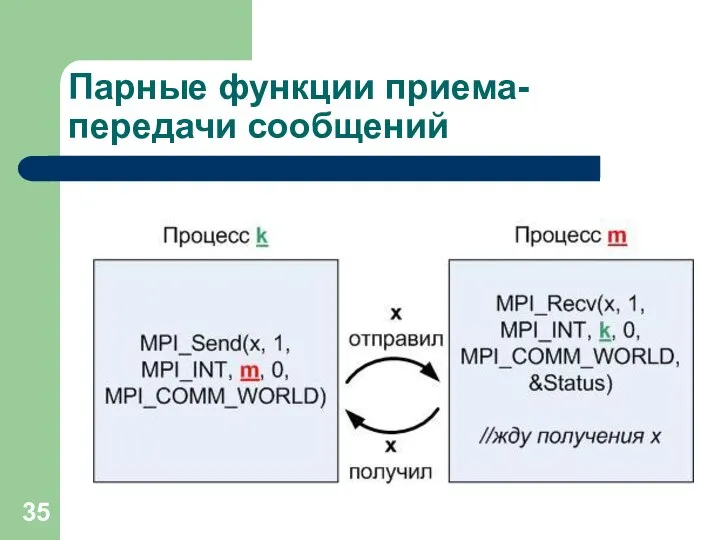

- 35. Парные функции приема-передачи сообщений

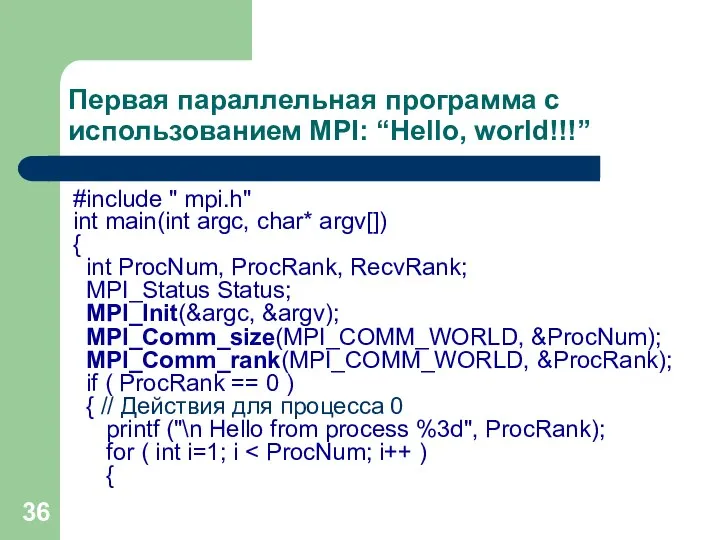

- 36. Первая параллельная программа с использованием MPI: “Hello, world!!!” #include " mpi.h" int main(int argc, char* argv[])

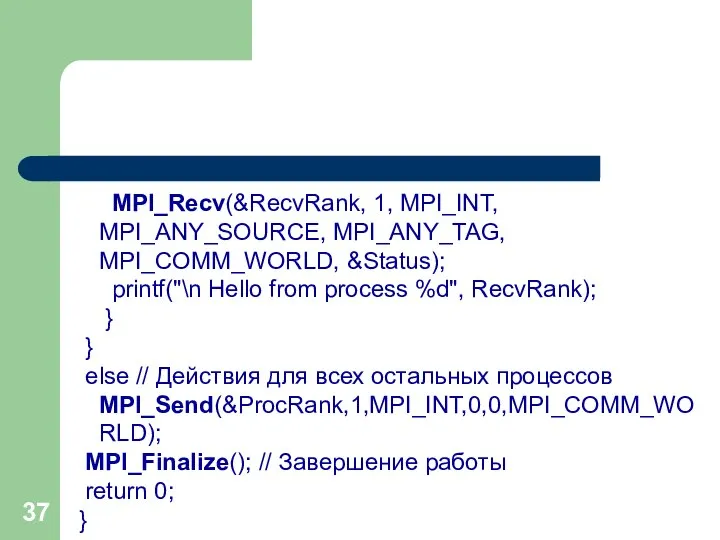

- 37. MPI_Recv(&RecvRank, 1, MPI_INT, MPI_ANY_SOURCE, MPI_ANY_TAG, MPI_COMM_WORLD, &Status); printf("\n Hello from process %d", RecvRank); } } else

- 38. Первая параллельная программа с использованием MPI… Каждый процесс определяет свой ранг, после чего действия в программе

- 39. Первая параллельная программа с использованием MPI… Порядок приема сообщений заранее не определен и зависит от условий

- 41. Скачать презентацию

Художественная культура Японии: развитие и виды

Художественная культура Японии: развитие и виды Построение оценок производительности и эффективности параллельных компьютеров. Законы Адмала, Густавсона-Барсиса

Построение оценок производительности и эффективности параллельных компьютеров. Законы Адмала, Густавсона-Барсиса фрактальная геометрия и физика

фрактальная геометрия и физика U-ON. Travel - CRM для туристических компаний

U-ON. Travel - CRM для туристических компаний Водно-минеральный обмен

Водно-минеральный обмен ФИЗМИНУТКА - презентация для начальной школы

ФИЗМИНУТКА - презентация для начальной школы ФИЗИОЛОГИЯ ДЫХАНИЯ 2

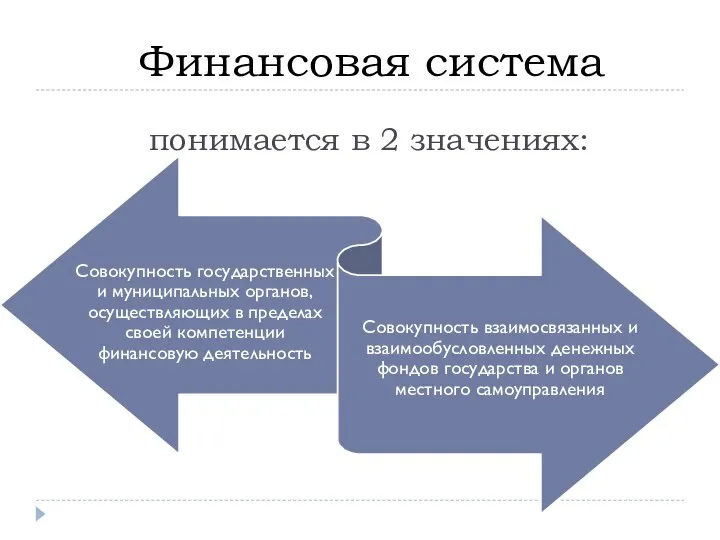

ФИЗИОЛОГИЯ ДЫХАНИЯ 2 1. 2. Финансовая система

1. 2. Финансовая система Математика у гномов - презентация для начальной школы_

Математика у гномов - презентация для начальной школы_ Проект Etoday.ru запущен в июне 2007 года. Etoday.ru интернет-журнал о новостях из мира кино, музыки, моды, спорта, политики, бизнеса, технологи

Проект Etoday.ru запущен в июне 2007 года. Etoday.ru интернет-журнал о новостях из мира кино, музыки, моды, спорта, политики, бизнеса, технологи Презентация Будущее человечества. Глобальные проблемы современности

Презентация Будущее человечества. Глобальные проблемы современности Нанесение размеров на чертежах Решение задач на тему «Построение изображений»

Нанесение размеров на чертежах Решение задач на тему «Построение изображений» ИНСТИТУЦИОНАЛЬНАЯ ЭКОНОМИКА К.э.н. Григорий Владимирович Калягин gkalyagin@yandex.ru kalyagin@econ.msu.ru 939 52 37 http://www.econ.msu.ru/cd/629

ИНСТИТУЦИОНАЛЬНАЯ ЭКОНОМИКА К.э.н. Григорий Владимирович Калягин gkalyagin@yandex.ru kalyagin@econ.msu.ru 939 52 37 http://www.econ.msu.ru/cd/629  Интегративная деятельность организма

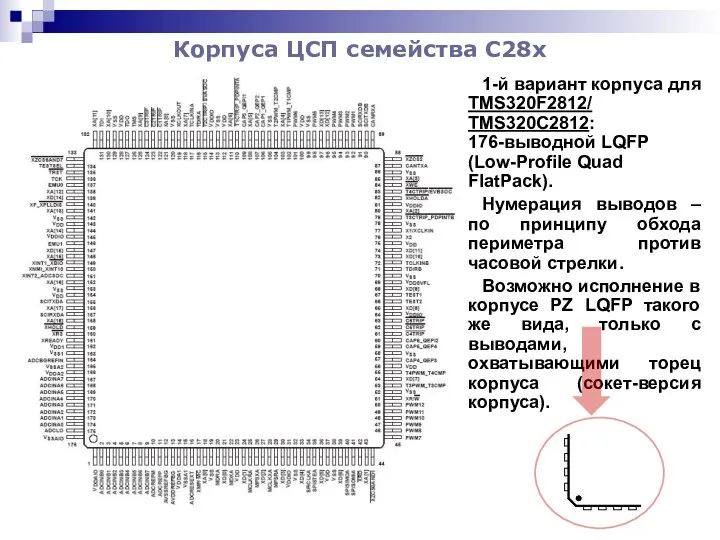

Интегративная деятельность организма  Корпуса ЦСП семейства С28x

Корпуса ЦСП семейства С28x Ведение Бизнеса в 2007-2008 годах Презентация основных результатов Душанбе, 4 декабря 2007г.

Ведение Бизнеса в 2007-2008 годах Презентация основных результатов Душанбе, 4 декабря 2007г.  The UK. The British monarchy. The British parliament the electoral system

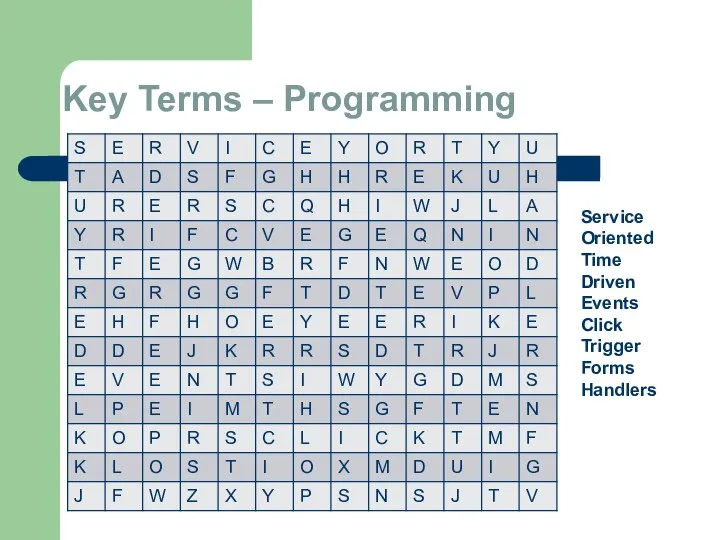

The UK. The British monarchy. The British parliament the electoral system Unit 6: Software Design & Development. Data Types in Programming

Unit 6: Software Design & Development. Data Types in Programming Najpiękniejszy ze wszystkich prezentów

Najpiękniejszy ze wszystkich prezentów Презентация Интеллектуальная игра умники и умницы

Презентация Интеллектуальная игра умники и умницы Патофизиология почек

Патофизиология почек Вторичный сектор Отрасли промышленности

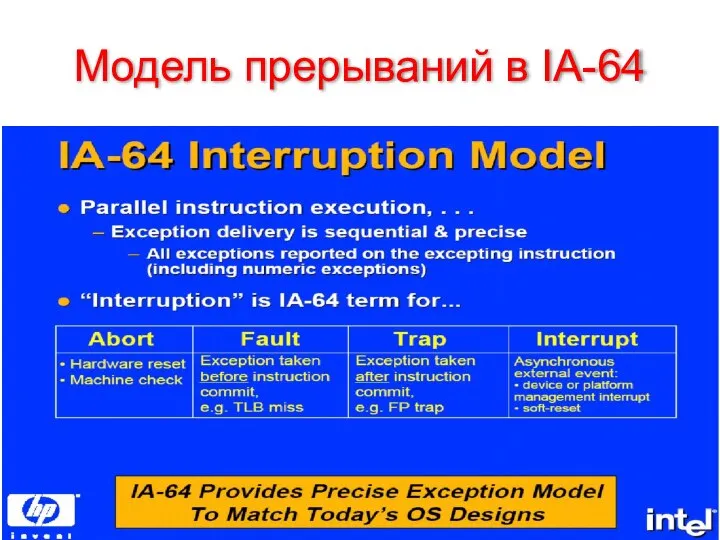

Вторичный сектор Отрасли промышленности Прерыв Itanium

Прерыв Itanium  Культура речи. Требования к лексике. Речевой этике

Культура речи. Требования к лексике. Речевой этике Презентация Международное движение трудовых и финансовых ресурсов Вопросы лекции: Демографические проблемы современной миров

Презентация Международное движение трудовых и финансовых ресурсов Вопросы лекции: Демографические проблемы современной миров надежность

надежность Вольная борьба

Вольная борьба Звучащие картины - презентация для начальной школы_

Звучащие картины - презентация для начальной школы_