- Главная

- Информатика

- Data Scientist. Рекомендательные системы

Содержание

- 2. План работы: 1. Постановка задачи, исходные данные и что с ними нужно сделать. 2. Подсчет топ

- 3. Постановка задачи: Нам нужно разработать рекомендательную систему подбора товаров, исходя из индивидуальных особенностей каждого пользователя. Представим

- 4. Roadmap экспериментов: Постановка задачи «Наивный» алгоритм Implicit ALS Implicit kNN LightFM Работают на основе разряженных матриц

- 5. Разбор алгоритмов:

- 6. Разбор алгоритмов: (СЛАЙД НА УДАЛЕНИЕ) 2. Implicit ALS (Alternating Least Squares) Хорошая удобная библиотека, главная фишка

- 7. Несколько слов о разряженных матрицах. Ключевым элементов в работе вышеописанных библиотек является т н разряженная матрица

- 8. Алгоритм на основе нейронной сети. В качестве вишенки на торте и чего-то по-настоящему рабочего было решено

- 9. Архитектура нейросети: 2 входа отдельно для продуктовых и пользовательских признаков Превращаем данные в одномерный тензор Объединение

- 10. Интересные наблюдения. Приведу две наиболее удачные конфигурации сетей: одна дала наилучшие финальные рекомендации, другая наивысшую точность

- 11. Некоторые технические моменты. Вид итогового датафрейма, отсортированного по величине выхода сигмоиды: Как дополнялись предсказания: Набор списка

- 13. Скачать презентацию

План работы:

1. Постановка задачи, исходные данные и что с ними нужно

План работы:

1. Постановка задачи, исходные данные и что с ними нужно

2. Подсчет топ 10 самых популярных товаров для каждого пользователя и оценка этого подсчета –

как идеал, к которому мы будем стремиться.

3. Roadmap работы, какие подходы и какие библиотеки использовались.

3.1 Иплисит ALS и kNN

3.2 LightFM

3.3 Нейросеть

4. Подведение итогов и вывод.

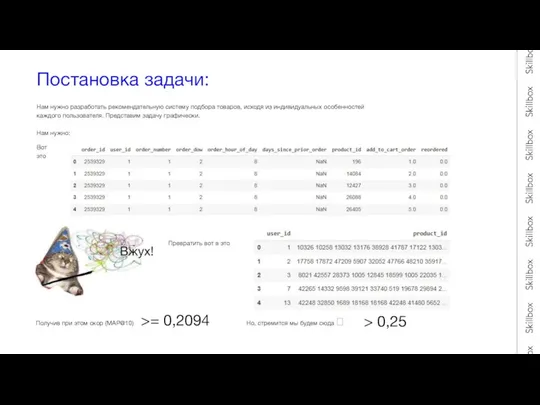

Постановка задачи:

Нам нужно разработать рекомендательную систему подбора товаров, исходя из индивидуальных

Постановка задачи:

Нам нужно разработать рекомендательную систему подбора товаров, исходя из индивидуальных

каждого пользователя. Представим задачу графически.

Нам нужно:

Вот это

Превратить вот в это

Получив при этом скор (MAP@10)

>= 0,2094

Но, стремится мы будем сюда ?

> 0,25

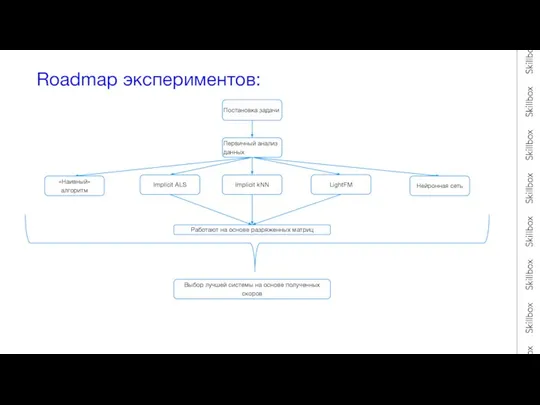

Roadmap экспериментов:

Постановка задачи

«Наивный» алгоритм

Implicit ALS

Implicit kNN

LightFM

Работают на основе разряженных матриц

Первичный анализ

Roadmap экспериментов:

Постановка задачи

«Наивный» алгоритм

Implicit ALS

Implicit kNN

LightFM

Работают на основе разряженных матриц

Первичный анализ

Нейронная сеть

Выбор лучшей системы на основе полученных скоров

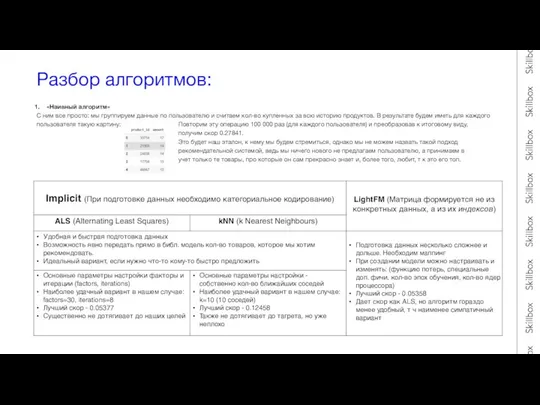

Разбор алгоритмов:

Разбор алгоритмов:

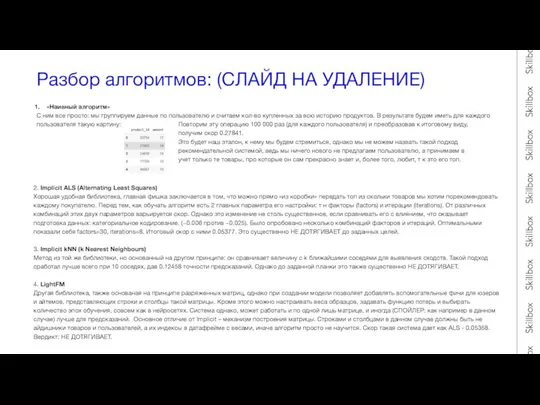

Разбор алгоритмов: (СЛАЙД НА УДАЛЕНИЕ)

2. Implicit ALS (Alternating Least Squares)

Хорошая удобная

Разбор алгоритмов: (СЛАЙД НА УДАЛЕНИЕ)

2. Implicit ALS (Alternating Least Squares)

Хорошая удобная

3. Implicit kNN (k Nearest Neighbours)

Метод из той же библиотеки, но основанный на другом принципе: он сравнивает величину с k ближайшими соседями для выявления сходств. Такой подход сработал лучше всего при 10 соседях, дав 0.12458 точности предсказаний. Однако до заданной планки это также существенно НЕ ДОТЯГИВАЕТ.

4. LightFM

Другая библиотека, также основаная на принципе разряженных матриц, однако при создании модели позволяет добавлять вспомогательные фичи для юзеров и айтемов, представляющих строки и столбцы такой матрицы. Кроме этого можно настраивать веса образцов, задавать функцию потерь и выбирать количество эпох обучения, совсем как в нейросетях. Система однако, может работать и по одной лишь матрице, и иногда (СПОЙЛЕР: как например в данном случае) лучше для предсказаний. Основное отличие от Implicit – механизм построения матрицы. Строками и столбцами в данном случае должны быть не айдишники товаров и пользователей, а их индексы в датафрейме с весами, иначе алгоритм просто не научится. Скор такая система дает как ALS - 0.05358. Вердикт: НЕ ДОТЯГИВАЕТ.

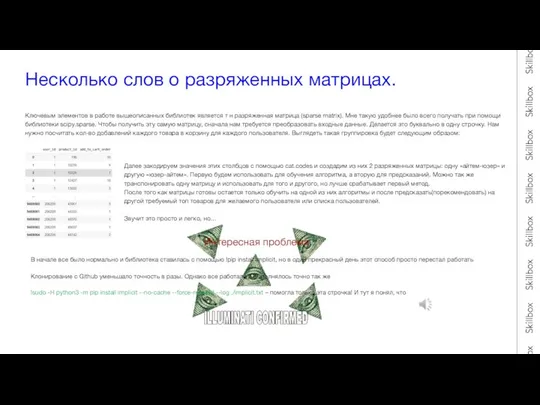

Несколько слов о разряженных матрицах.

Ключевым элементов в работе вышеописанных библиотек является

Несколько слов о разряженных матрицах.

Ключевым элементов в работе вышеописанных библиотек является

Далее закодируем значения этих столбцов с помощью cat.codes и создадим из них 2 разряженных матрицы: одну «айтем-юзер» и другую «юзер-айтем». Первую будем использовать для обучения алгоритма, а вторую для предсказаний. Можно так же транспонировать одну матрицу и использовать для того и другого, но лучше срабатывает первый метод.

После того как матрицы готовы остается только обучить на одной из них алгоритмы и после предсказать(порекомендовать) на другой требуемый топ товаров для желаемого пользователя или списка пользователей.

Звучит это просто и легко, но…

Интересная проблема

В начале все было нормально и библиотека ставилась с помощью !pip install Implicit, но в один прекрасный день этот способ просто перестал работать

Клонирование с Github уменьшало точность в разы. Однако все работало и выполнялось точно так же

!sudo -H python3 -m pip install implicit --no-cache --force-reinstall --log ./implicit.txt – помогла только эта строчка! И тут я понял, что

Алгоритм на основе нейронной сети.

В качестве вишенки на торте и чего-то

Алгоритм на основе нейронной сети.

В качестве вишенки на торте и чего-то

Исходный набор признаков был преобразован и дополнен, и в итоге получилось 3 признака для пользователей и 6 для продуктов. В качестве таргета был взят факт повторного заказа того или иного продукта конкретным юзером. Весь сет был разбит на трэйн и тест выборки по принципу разницы между первым и последним номера заказа. Если разница была больше 1, то такие строки уходили в трэйн, если меньше – то в тест.

Идея была в том, чтобы по величине сырой сигмоиды после предсказаний судить о «силе» или весе того или иного продукта для конкретного пользователя. Отсортировав все эти продукты по убыванию значения сигмоиды, можно было получить топ N. Не всегда это был топ 10, иногда больше, иногда меньше, ведь с некоторыми продуктами некоторые пользователи могли вовсе не взаимодействовать.

Итоговый сет из 10 продуктов добивался случайным образом из исторического топ10 для каждого юзера. Также он добивался и рандомом из всех возможных продуктов, но добивать из топ10 было выгодней для скора приблизительно на 0.015. Повторы естественно исключались.

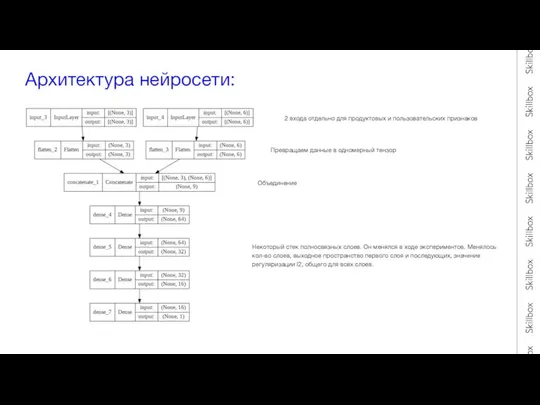

Архитектура нейросети:

2 входа отдельно для продуктовых и пользовательских признаков

Превращаем данные в

Архитектура нейросети:

2 входа отдельно для продуктовых и пользовательских признаков

Превращаем данные в

Объединение

Некоторый стек полносвязных слоев. Он менялся в ходе экспериментов. Менялось

кол-во слоев, выходное пространство первого слоя и последующих, значение

регуляризации l2, общего для всех слоев.

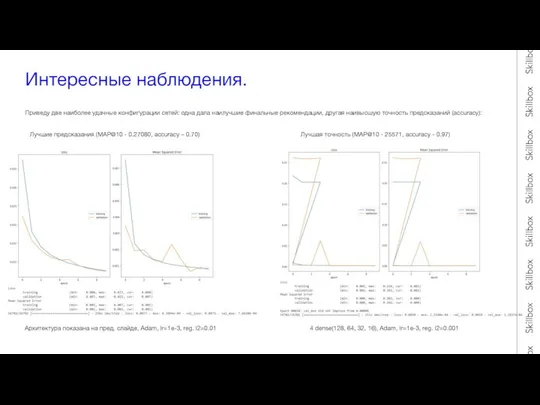

Интересные наблюдения.

Приведу две наиболее удачные конфигурации сетей: одна дала наилучшие финальные

Интересные наблюдения.

Приведу две наиболее удачные конфигурации сетей: одна дала наилучшие финальные

Лучшие предсказания (MAP@10 - 0.27080, accuracy – 0.70)

Лучшая точность (MAP@10 - 25571, accuracy - 0.97)

Архитектура показана на пред. cлайде, Adam, lr=1e-3, reg. l2=0.01

4 dense(128, 64, 32, 16), Adam, lr=1e-3, reg. l2=0.001

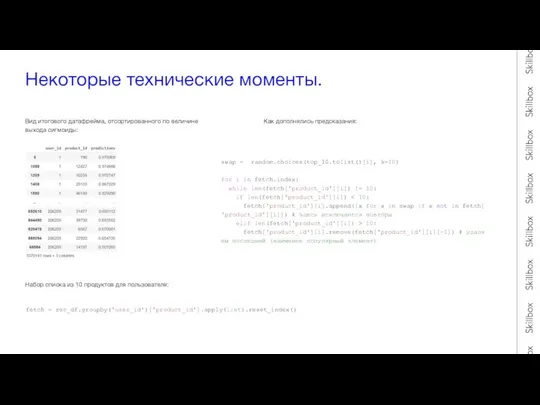

Некоторые технические моменты.

Вид итогового датафрейма, отсортированного по величине выхода сигмоиды:

Как дополнялись

Некоторые технические моменты.

Вид итогового датафрейма, отсортированного по величине выхода сигмоиды:

Как дополнялись

Набор списка из 10 продуктов для пользователя:

fetch = rec_df.groupby('user_id')['product_id'].apply(list).reset_index()

swap = random.choices(top_10.tolist()[i], k=10)

for i in fetch.index:

while len(fetch['product_id'][i]) != 10:

if len(fetch['product_id'][i]) < 10:

fetch['product_id'][i].append([x for x in swap if x not in fetch['product_id'][i]]) # здесь исключаются повторы

elif len(fetch['product_id'][i]) > 10:

fetch['product_id'][i].remove(fetch['product_id'][i][-1]) # удаляем последний (наименее популярный элемент)

Требования к конкурсным работам в номинации Лучший сайт

Требования к конкурсным работам в номинации Лучший сайт Модуль “Выписки и проверка контрагента”

Модуль “Выписки и проверка контрагента” Обработка информации. 5 класс

Обработка информации. 5 класс Цикл с предусловием

Цикл с предусловием Интерфейсы МатКапитал

Интерфейсы МатКапитал Предистория информатики

Предистория информатики Introduction to cloud computing

Introduction to cloud computing Презентация "Устройства ввода - вывода" - скачать презентации по Информатике

Презентация "Устройства ввода - вывода" - скачать презентации по Информатике Кодирование и декодирование информации (7 класс)

Кодирование и декодирование информации (7 класс) Блочная модель

Блочная модель Принципы организации сетей

Принципы организации сетей Рекламная сеть Яндекс

Рекламная сеть Яндекс Программа Sketch Up для MrDoors

Программа Sketch Up для MrDoors Социальная сеть как основа современной социальной структуры

Социальная сеть как основа современной социальной структуры Лагерь. Обучение в стиле Майнкрафт

Лагерь. Обучение в стиле Майнкрафт Оcнови роботи в пакеті Scilab

Оcнови роботи в пакеті Scilab Печать документов Борисов В.А. Красноармейский филиал ГОУ ВПО «Академия народного хозяйства при Правительстве РФ» Красноарме

Печать документов Борисов В.А. Красноармейский филиал ГОУ ВПО «Академия народного хозяйства при Правительстве РФ» Красноарме Техническое задание. Система голосования v3. Регистрация. Страница регистрации на сайте

Техническое задание. Система голосования v3. Регистрация. Страница регистрации на сайте Заголовок слайда. Вставьте Ваш текст

Заголовок слайда. Вставьте Ваш текст Информация и информационные процессы. Информационные технологии

Информация и информационные процессы. Информационные технологии Thieme - руководство пользователя на русском языке

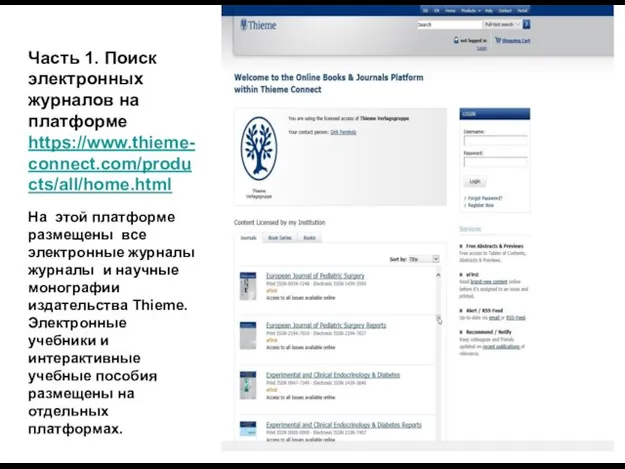

Thieme - руководство пользователя на русском языке Creating MO Script with AMOS

Creating MO Script with AMOS Лабораторная работа №1 «Структура и влияние различных факторов на динамику ВВП РФ» Силантьев В.Б.<number><number> Профессор кафед

Лабораторная работа №1 «Структура и влияние различных факторов на динамику ВВП РФ» Силантьев В.Б.<number><number> Профессор кафед Домашняя работа по информатике 9 класс

Домашняя работа по информатике 9 класс Презентация "Информационная культура"

Презентация "Информационная культура" Книга Excel в библиотеке общих документов. Отчет

Книга Excel в библиотеке общих документов. Отчет Графики и диаграммы. Визуализация многорядных данных

Графики и диаграммы. Визуализация многорядных данных Internet технологии. Лекция 7.2

Internet технологии. Лекция 7.2