Содержание

- 2. Word embeddings and convolution neural networks for NLP

- 3. Semantic Level NLP Поиск синонимов Ответы на вопросы Чат боты Машинный перевод Построение аннотаций ….

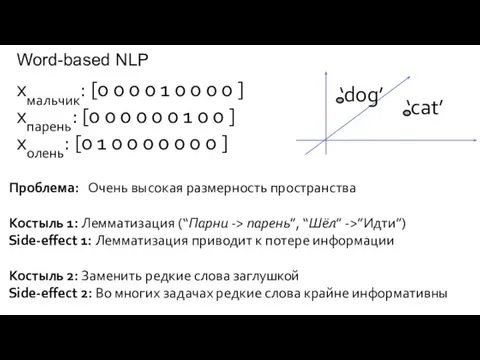

- 4. xмальчик: [0 0 0 0 1 0 0 0 0 ] xпарень: [0 0 0 0

- 5. Проблема: Очень высокая размерность пространства Костыль 1: Лемматизация (“Парни -> парень”, “Шёл” ->”Идти”) Side-effect 1: Лемматизация

- 6. Лингвистические единицы, встречающиеся в схожих контекстах, имееют близкие значения. Дистрибутивная гипотеза Гипотеза: Значит, представления слов, можно

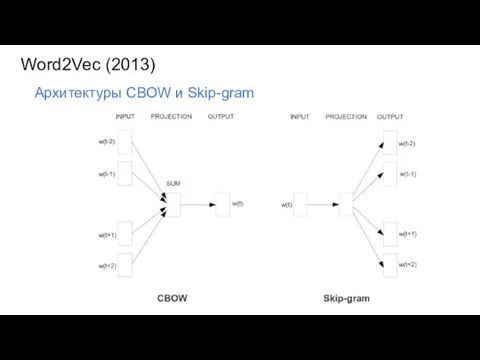

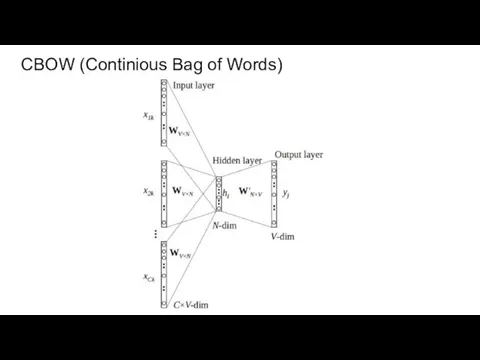

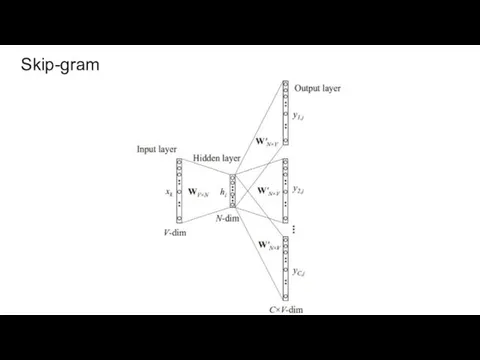

- 7. Word2Vec (2013) Архитектуры CBOW и Skip-gram

- 8. CBOW (Continious Bag of Words)

- 9. Skip-gram

- 10. Skip-gram Оптимизируем

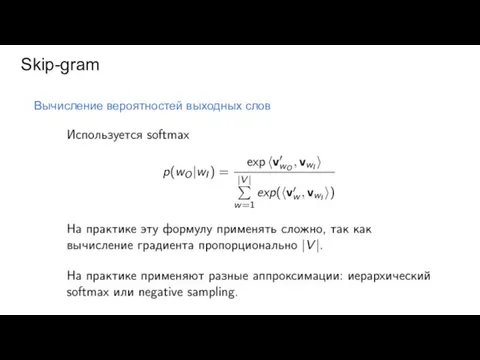

- 11. Skip-gram Вычисление вероятностей выходных слов

- 12. Negative sampling Идея:

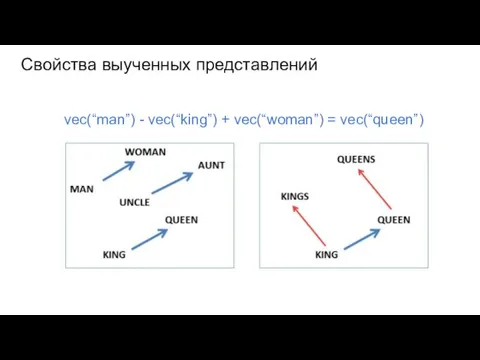

- 13. Свойства выученных представлений vec(“man”) - vec(“king”) + vec(“woman”) = vec(“queen”)

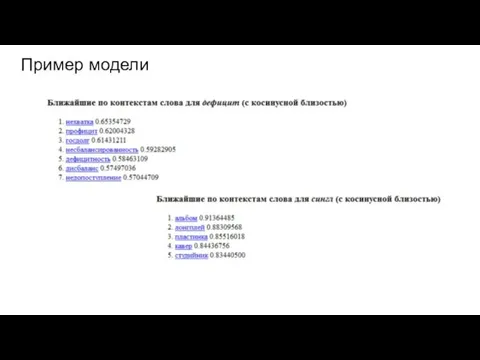

- 14. Пример модели

- 15. Doc2vec (Mikolov, 2014) Обобщение word2vec на целые документы (фразы, предложения и т.д.) Преобразует текст произвольной длины

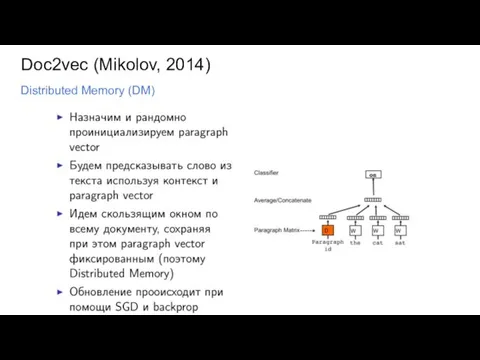

- 16. Doc2vec (Mikolov, 2014) Distributed Memory (DM)

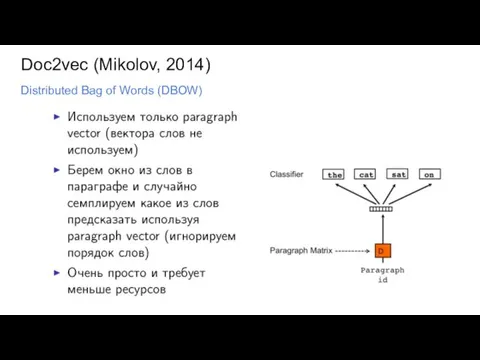

- 17. Doc2vec (Mikolov, 2014) Distributed Bag of Words (DBOW)

- 18. Character-level ConvNet Trained for text classification

- 19. Векторное представление текста как изображения

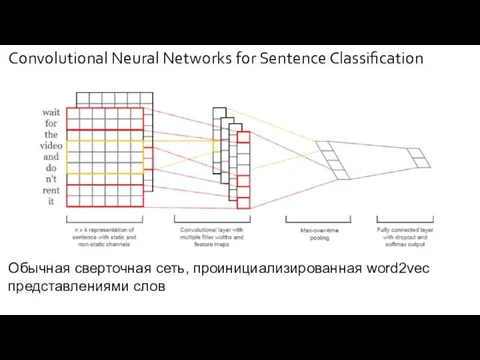

- 20. Convolutional Neural Networks for Sentence Classification Обычная сверточная сеть, проинициализированная word2vec представлениями слов

- 21. Neural networks for recommendation systems

- 22. Рекомендательные системы

- 23. E-commerce

- 24. Recommender systems - The task Нужно построить модель, предсказывающую насколько user нравятся items У типичной рекомендательной

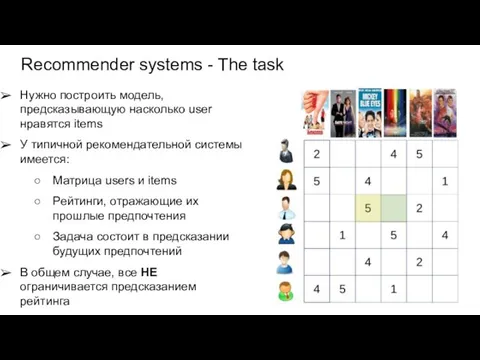

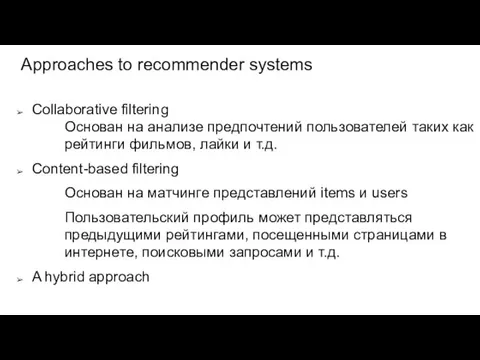

- 25. Approaches to recommender systems Collaborative filtering Основан на анализе предпочтений пользователей таких как рейтинги фильмов, лайки

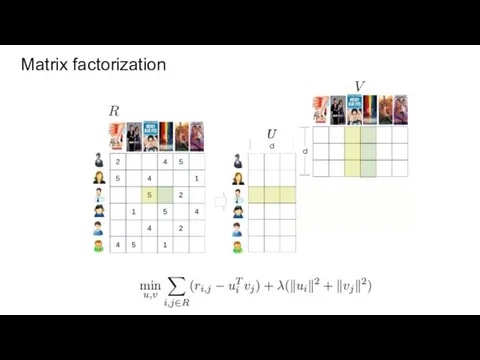

- 26. Matrix factorization

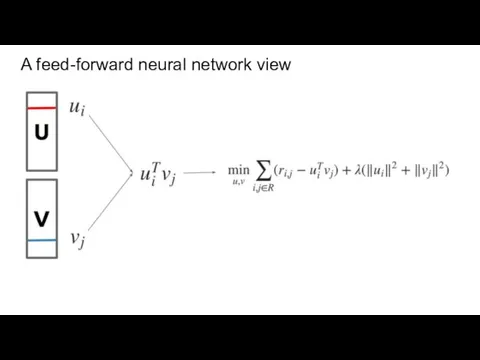

- 27. A feed-forward neural network view

- 28. Pytorch example

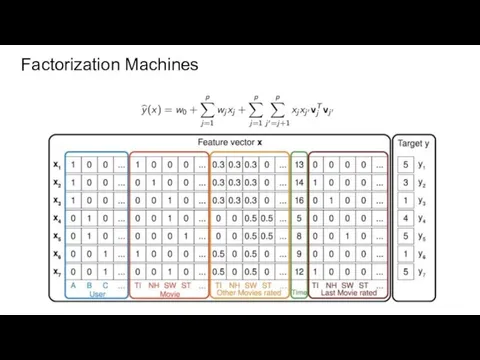

- 29. Factorization Machines

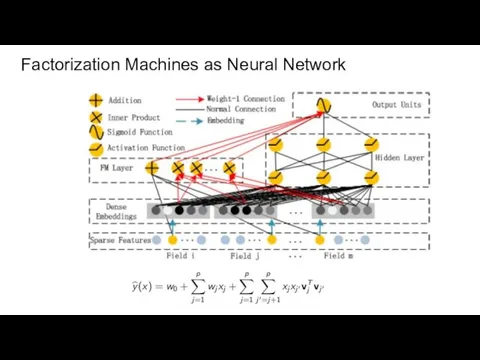

- 30. Factorization Machines as Neural Network

- 31. A deeper view

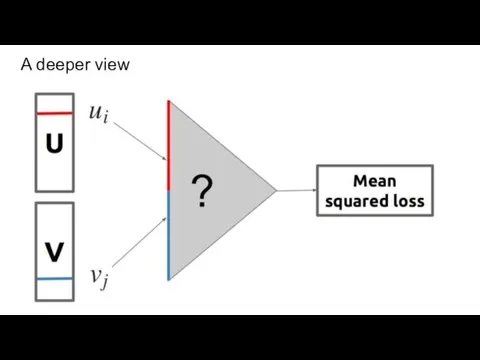

- 32. Wide and Deep (Google 2016)

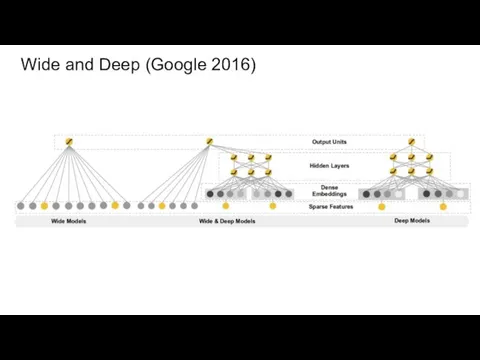

- 33. Нейросетевые архитектуры для CF FNN - FM initialized feed forward neural network PNN - Product based

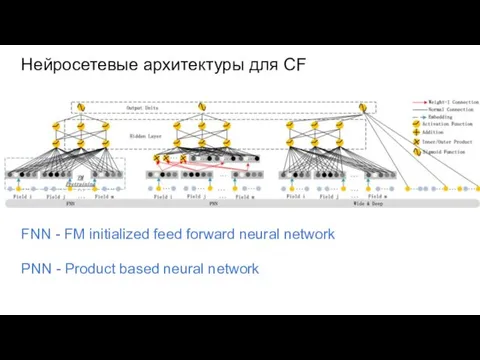

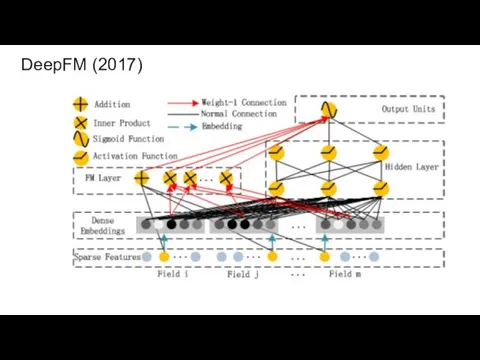

- 34. DeepFM (2017)

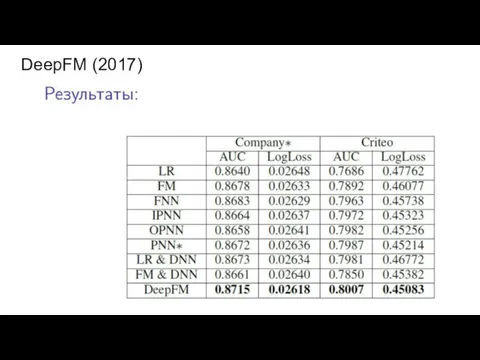

- 35. DeepFM (2017)

- 36. Prod2Vec and Item2Vec Prod2vec skip-gram model Prod2Vec & item2vec: факторизация матрицы совместной покупки товаров Аналог word2vec

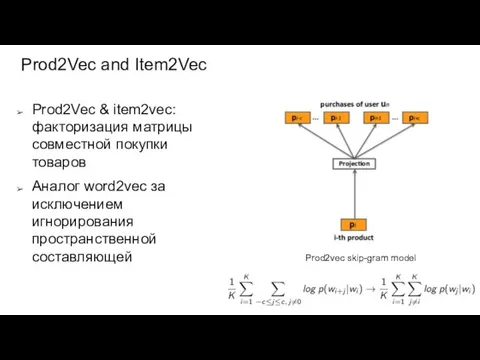

- 37. Pandao2Vec + _ = Чехол для IPhone Стекло для IPhone Стекло для Samsung Чехол для Samsung

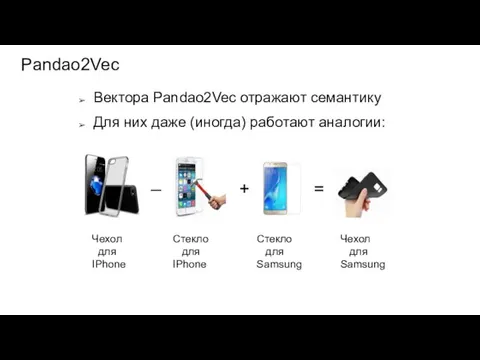

- 38. Pandao2Vec Топ 1000 товаров

- 39. Neural networks for information retrieval

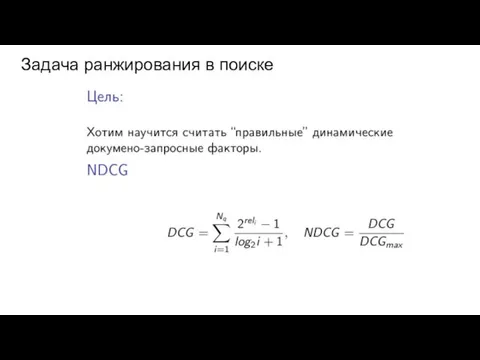

- 40. Задача ранжирования в поиске

- 41. Поиск

- 42. Vector space ranking model

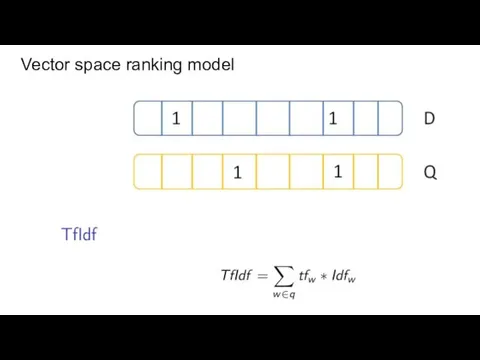

- 43. BM25

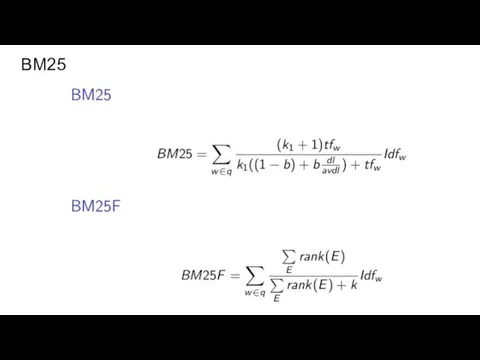

- 44. Классические модели

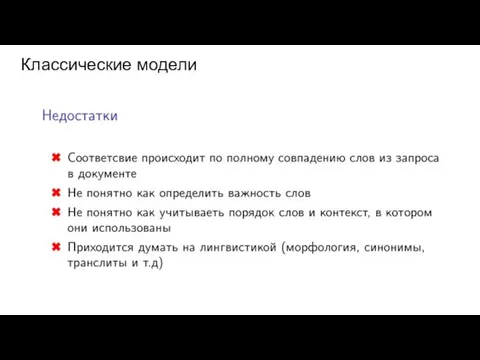

- 45. Векторная модель

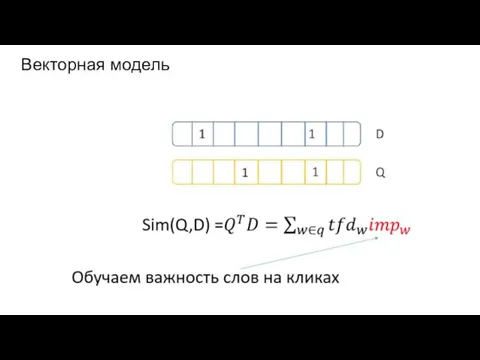

- 46. Векторная модель

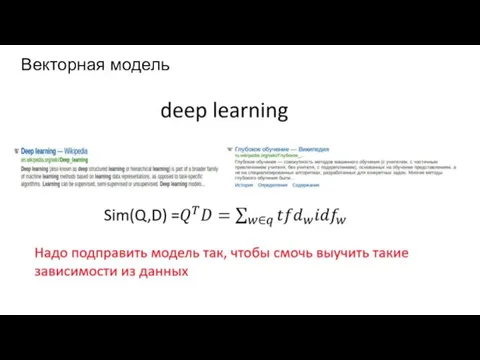

- 47. Векторная модель

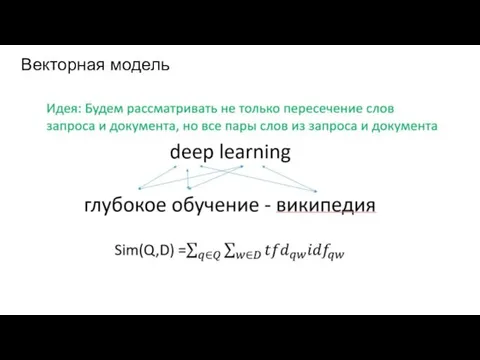

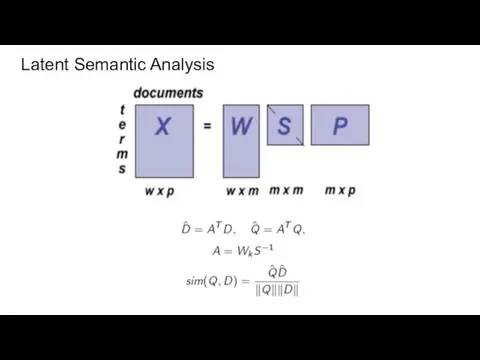

- 48. Latent Semantic Analysis

- 49. Dual Embedding Space Model (DESM)

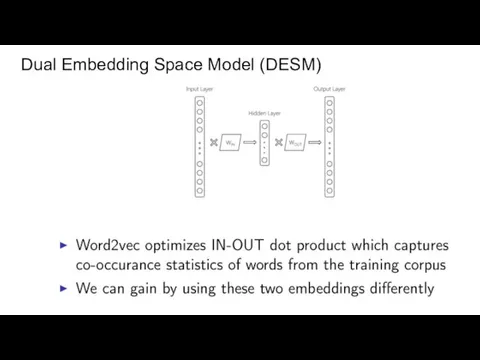

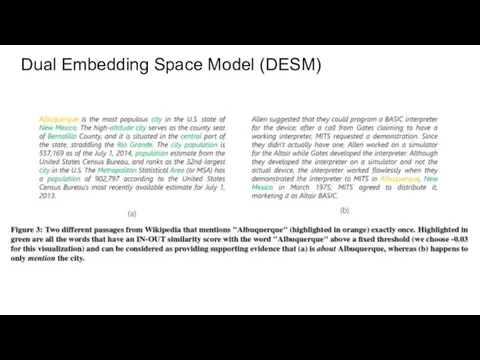

- 50. Dual Embedding Space Model (DESM)

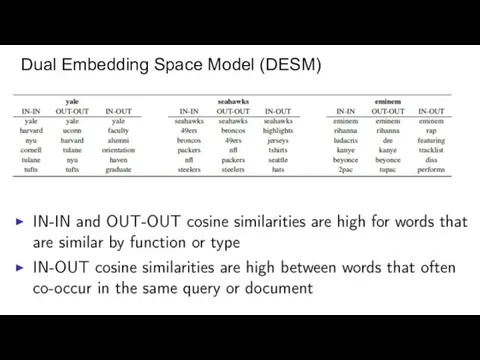

- 51. Dual Embedding Space Model (DESM)

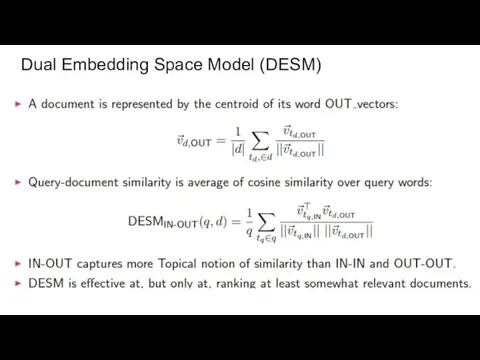

- 52. Dual Embedding Space Model (DESM)

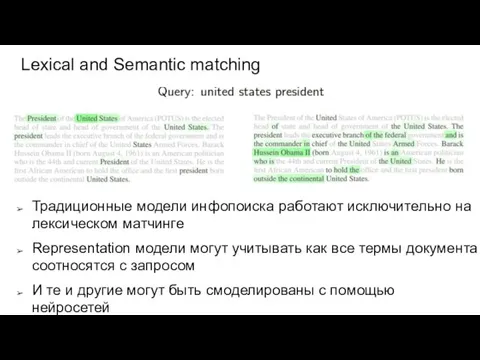

- 53. Lexical and Semantic matching Традиционные модели инфопоиска работают исключительно на лексическом матчинге Representation модели могут учитывать

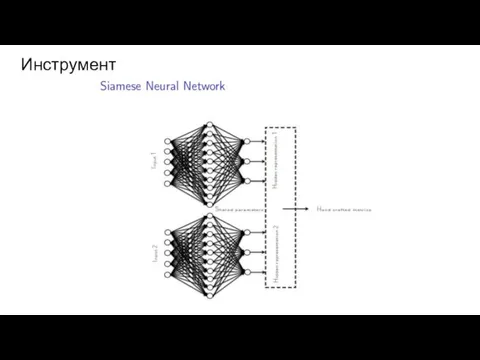

- 54. Инструмент

- 55. Deep Structured Semantic Model (DSSM) (2013)

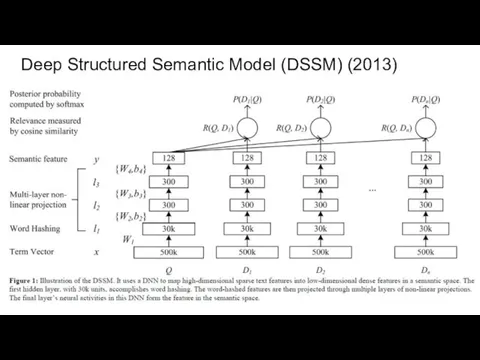

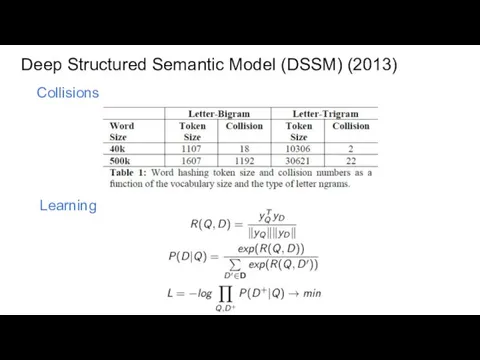

- 56. Deep Structured Semantic Model (DSSM) (2013) Collisions Learning

- 57. DSSM в яндексе

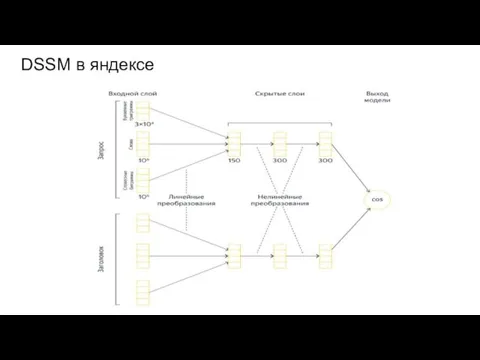

- 58. DSSM в яндексе Запрос: [келлская книга]

- 59. DSSM в яндексе Запрос: [евангелие из келлса]

- 60. DSSM в яндексе Запрос: [рассказ в котором раздавили бабочку]

- 61. Interaction matrix based approaches

- 62. MatchPyramid Сверточные слои поверх interaction matrix между запросом и документом После конволюций полносвязные слои

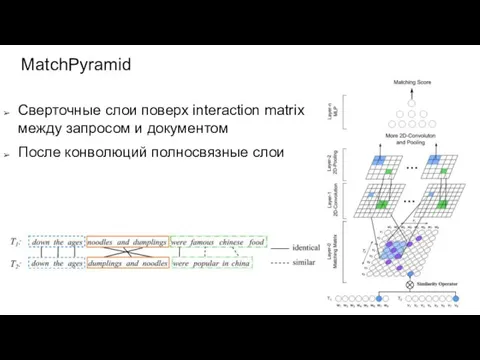

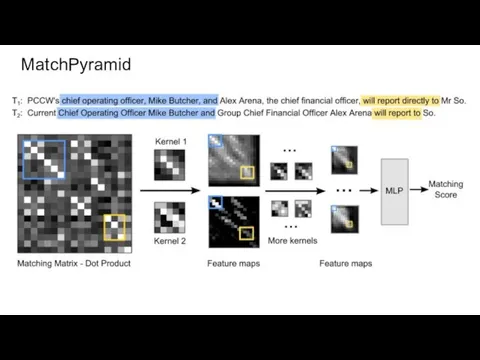

- 63. MatchPyramid

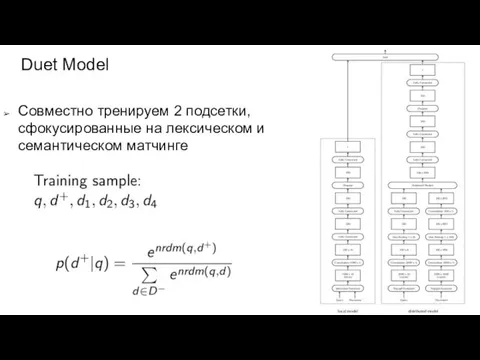

- 64. Duet Model Совместно тренируем 2 подсетки, сфокусированные на лексическом и семантическом матчинге

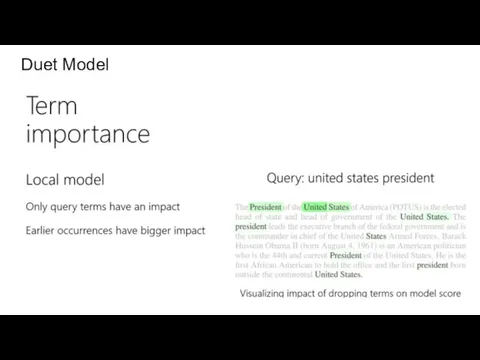

- 65. Duet Model

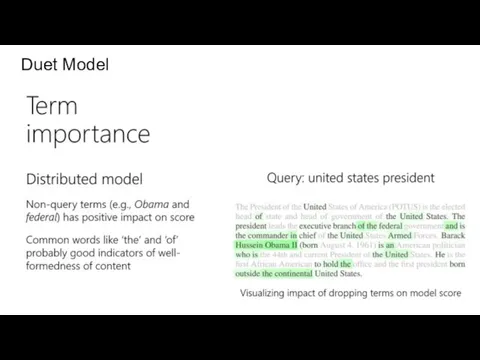

- 66. Duet Model

- 68. Скачать презентацию

![xмальчик: [0 0 0 0 1 0 0 0 0 ]](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/490484/slide-3.jpg)

![DSSM в яндексе Запрос: [келлская книга]](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/490484/slide-57.jpg)

![DSSM в яндексе Запрос: [евангелие из келлса]](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/490484/slide-58.jpg)

![DSSM в яндексе Запрос: [рассказ в котором раздавили бабочку]](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/490484/slide-59.jpg)

Устройства ввода

Устройства ввода מערכת CRMלמוקד סמייל

מערכת CRMלמוקד סמייל  Программирование (Python)

Программирование (Python) Информация. Основные виды информации

Информация. Основные виды информации Daemon Tools Lite

Daemon Tools Lite Кодирование основных типов алгоритмических структур на языках объектно — ориентированного и процедурного программирования

Кодирование основных типов алгоритмических структур на языках объектно — ориентированного и процедурного программирования Режимы и способы обработки данных

Режимы и способы обработки данных Знаки: форма и значение. Знаковые системы

Знаки: форма и значение. Знаковые системы Презентация "Практический поиск в Интернете" - скачать презентации по Информатике

Презентация "Практический поиск в Интернете" - скачать презентации по Информатике Виды компьютеров

Виды компьютеров Визуальный инструмент разработки автоматических спецпрограмм проверки РЗА, ООО НПП Динамика

Визуальный инструмент разработки автоматических спецпрограмм проверки РЗА, ООО НПП Динамика Растровая и векторная графика

Растровая и векторная графика Данные в компьютере

Данные в компьютере Кодирование чисел. Системы счисления

Кодирование чисел. Системы счисления Телемедицина в приложении СОГАЗ

Телемедицина в приложении СОГАЗ Мультимедийные презентации на уроке истории

Мультимедийные презентации на уроке истории Мультимедийные интерактивные презентации

Мультимедийные интерактивные презентации РАЗДЕЛ 20 ПРОГНОЗИРОВАНИЕ ДОЛГОВЕЧНОСТИ СОЕДИНЕНИЙ, ВЫПОЛНЕННЫХ ТОЧЕЧНОЙ СВАРКОЙ

РАЗДЕЛ 20 ПРОГНОЗИРОВАНИЕ ДОЛГОВЕЧНОСТИ СОЕДИНЕНИЙ, ВЫПОЛНЕННЫХ ТОЧЕЧНОЙ СВАРКОЙ  Решение логических задач

Решение логических задач Программное обеспечение ПК

Программное обеспечение ПК Администрирование в информационных системах Администрирование БД Резервное копирование и восстановление данных

Администрирование в информационных системах Администрирование БД Резервное копирование и восстановление данных  Антивирусные программы

Антивирусные программы Технология создания Web-страниц

Технология создания Web-страниц SQL basics. Урок 1

SQL basics. Урок 1 Обеспечение доступности серверов БД

Обеспечение доступности серверов БД преза

преза Красивая абстракция в Photoshop

Красивая абстракция в Photoshop Анимация смены слайдов. Microsoft PowerPoint

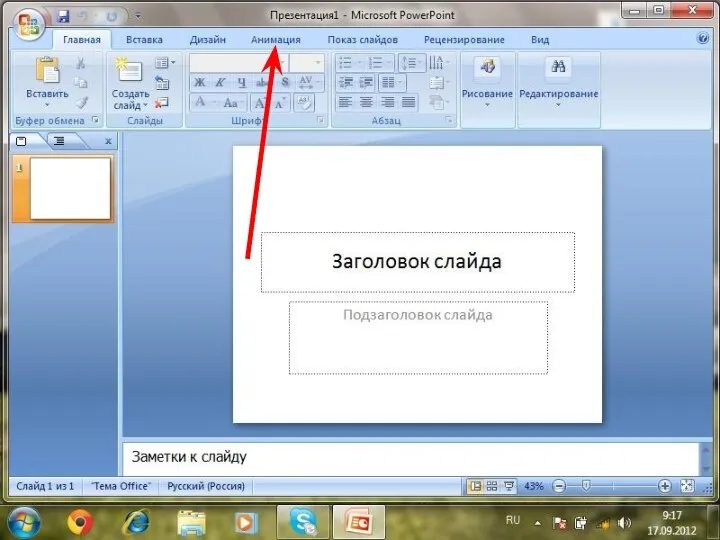

Анимация смены слайдов. Microsoft PowerPoint