Содержание

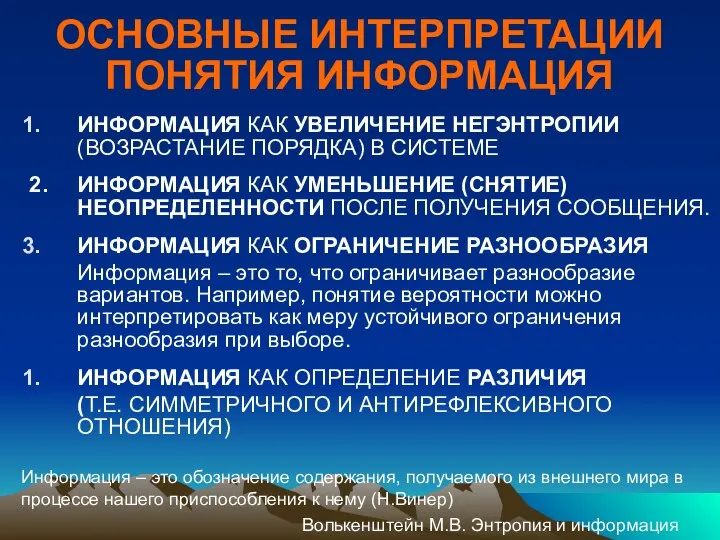

- 2. ОСНОВНЫЕ ИНТЕРПРЕТАЦИИ ПОНЯТИЯ ИНФОРМАЦИЯ ИНФОРМАЦИЯ КАК УВЕЛИЧЕНИЕ НЕГЭНТРОПИИ (ВОЗРАСТАНИЕ ПОРЯДКА) В СИСТЕМЕ 2. ИНФОРМАЦИЯ КАК УМЕНЬШЕНИЕ

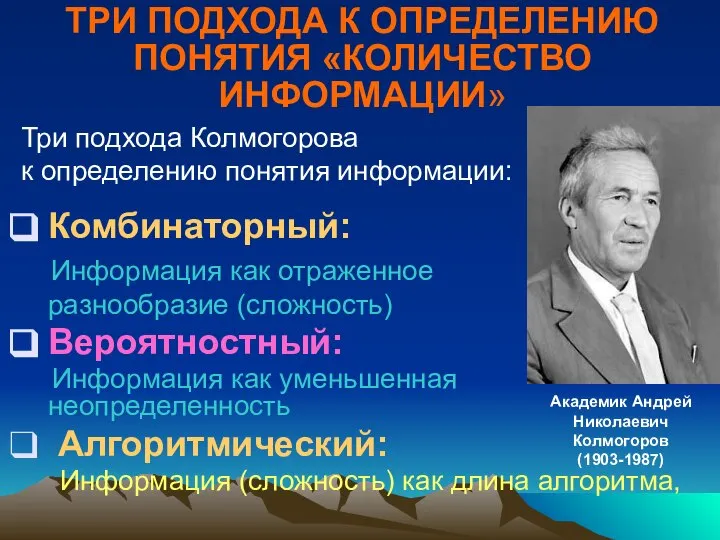

- 3. ТРИ ПОДХОДА К ОПРЕДЕЛЕНИЮ ПОНЯТИЯ «КОЛИЧЕСТВО ИНФОРМАЦИИ» Три подхода Колмогорова к определению понятия информации: Комбинаторный: Информация

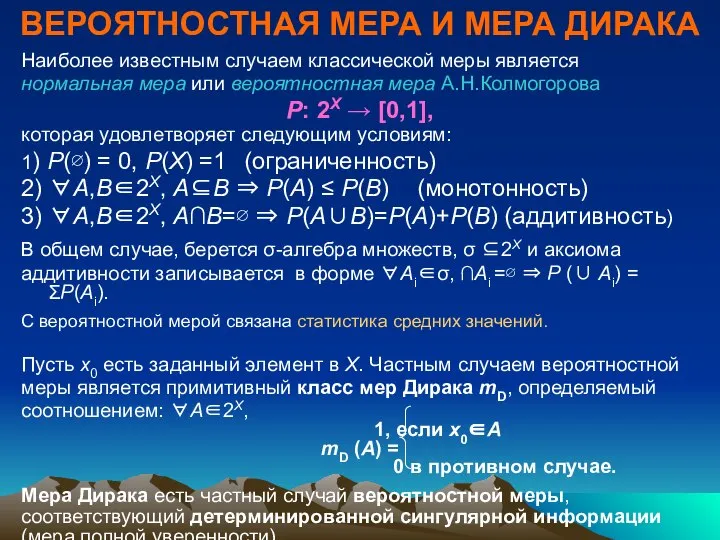

- 4. ВЕРОЯТНОСТНАЯ МЕРА И МЕРА ДИРАКА Наиболее известным случаем классической меры является нормальная мера или вероятностная мера

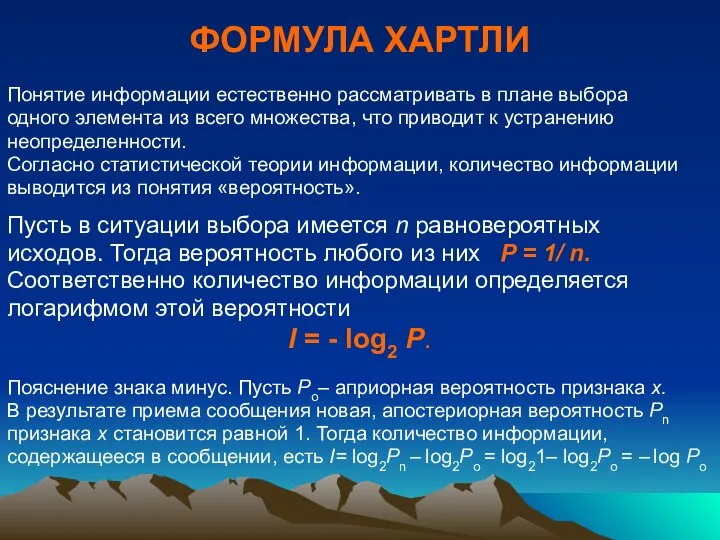

- 5. ФОРМУЛА ХАРТЛИ Понятие информации естественно рассматривать в плане выбора одного элемента из всего множества, что приводит

- 6. СТАТИСТИЧЕСКАЯ ТЕОРИЯ ИНФОРМАЦИИ К.ШЕННОНА 1948 Г. К.Шеннон «Математическая теория связи» Общая схема построения теории информации: теория

- 7. А.Н.КОЛМОГОРОВ О СООТНОШЕНИИ МЕЖДУ ИНФОРМАЦИЕЙ И ВЕРОЯТНОСТЬЮ Согласно А.Н.Колмогорову, информация по своей природе – не специальное

- 8. КОМБИНАТОРНАЯ ТЕОРИЯ ИНФОРМАЦИИ Согласно комбинаторному (теоретико-множественному) подходу, информация в системе определяется мощностью множества X ее различных

- 9. КОМБИНАТОРНАЯ ТЕОРИЯ ИНФОРМАЦИИ (продолжение) Логарифмическая мера степени разнообразия равна логарифму мощности конечного множества. Согласно комбинаторной теории

- 10. ПОНЯТИЕ ε-ЭНТРОПИИ Понятие ε–энтропии характеризует неопределенность исследуемого объекта с точностью до ε. Например, ε–энтропия подмножества A

- 11. ТОПОЛОГИЧЕСКАЯ ТЕОРИЯ ИНФОРМАЦИИ Н.РАШЕВСКОГО Вариант структурной теории информации Связь информации с неоднородностью структуры. Чем больше неоднородность

- 12. ТОПОЛОГИЧЕСКАЯ ТЕОРИЯ ИНФОРМАЦИИ (продолжение) Количество информации определяется различием степеней вершин графа. Степень вершины графа v∈V есть

- 13. АЛГОРИТМИЧЕСКАЯ ТЕОРИЯ ИНФОРМАЦИИ Алгоритмический подход к определению информации (сложности) связан с теорией рекурсивных функций. Пусть для

- 14. ИНФОРМАЦИЯ КАК РАСПРОСТРАНЕНИЕ ГИБКИХ ОГРАНИЧЕНИЙ У Л.Заде две главные интерпретации информации сливаются. Информация понимается как «неопределенность,

- 15. ХАРАКТЕРИСТИКИ ИНФОРМАЦИИ Понятие избыточности информации RD= 1 – (Imin/If)

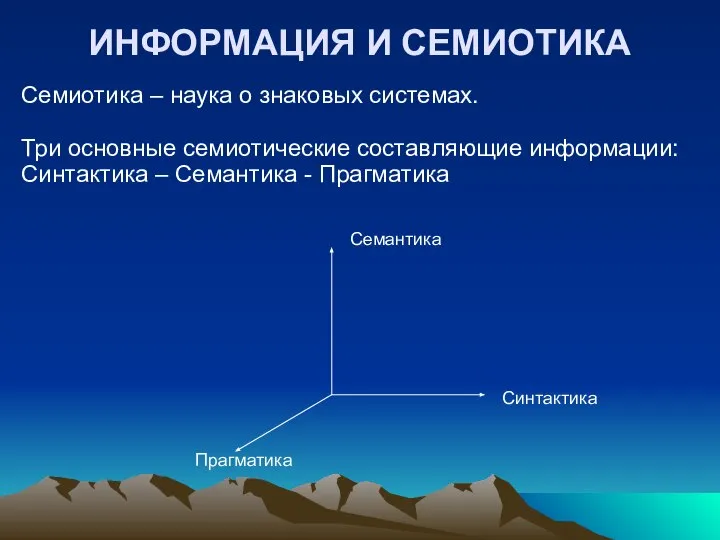

- 16. ИНФОРМАЦИЯ И СЕМИОТИКА Семиотика – наука о знаковых системах. Три основные семиотические составляющие информации: Синтактика –

- 17. КОММУНИКАЦИЯ КАК ИНФОРМАЦИОННЫЙ ПРОЦЕСС. КЛАССИЧЕСКАЯ МОДЕЛЬ ПЕРЕДАЧИ ИНФОРМАЦИИ ШЕННОНА-УИВЕРА Согласно этой классической модели, коммуникативный акт состоит

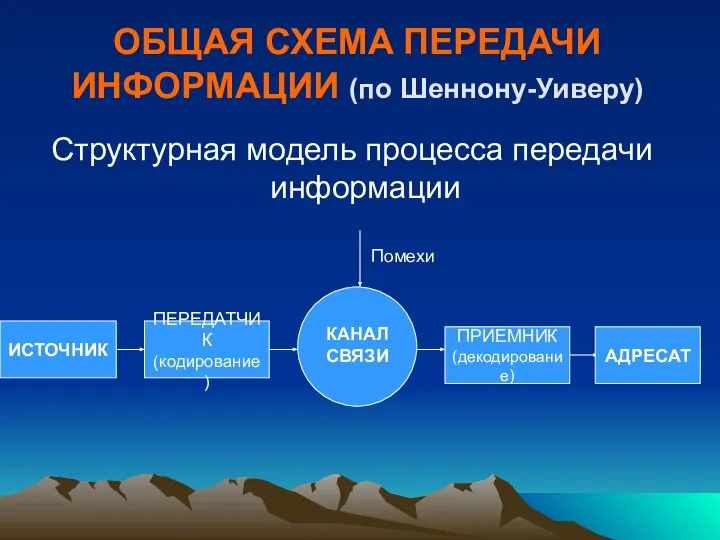

- 18. ОБЩАЯ СХЕМА ПЕРЕДАЧИ ИНФОРМАЦИИ (по Шеннону-Уиверу) Структурная модель процесса передачи информации ИСТОЧНИК ПЕРЕДАТЧИК (кодирование) КАНАЛ СВЯЗИ

- 19. ИНФОРМАЦИЯ И КОММУНИКАЦИЯ. МОДЕЛЬ Р.Якобсона Основные компоненты и факторы коммуникации (по Р.Якобсону) Контекст Сообщение Передатчик Приемник

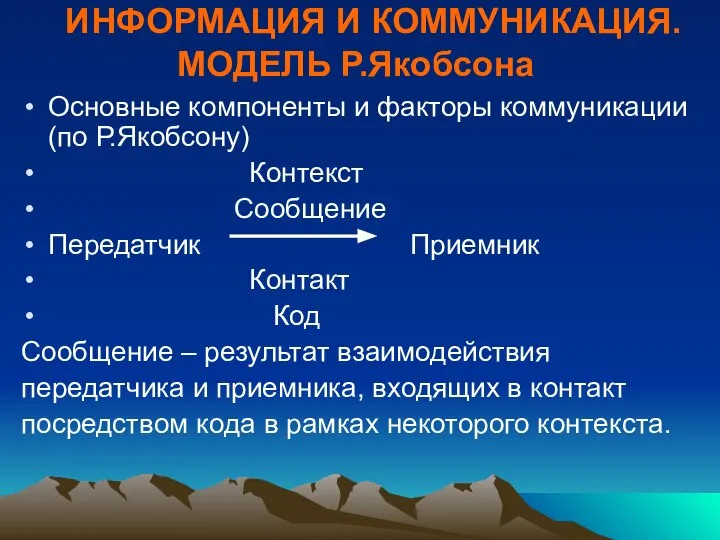

- 20. СЕМИОТИЧЕСКИЕ АСПЕКТЫ: ЦЕННОСТЬ ИНФОРМАЦИИ (ПО А.А.Харкевичу) Полезность (ценность) как прагматическая характеристика информации. Информация ценна настолько, насколько

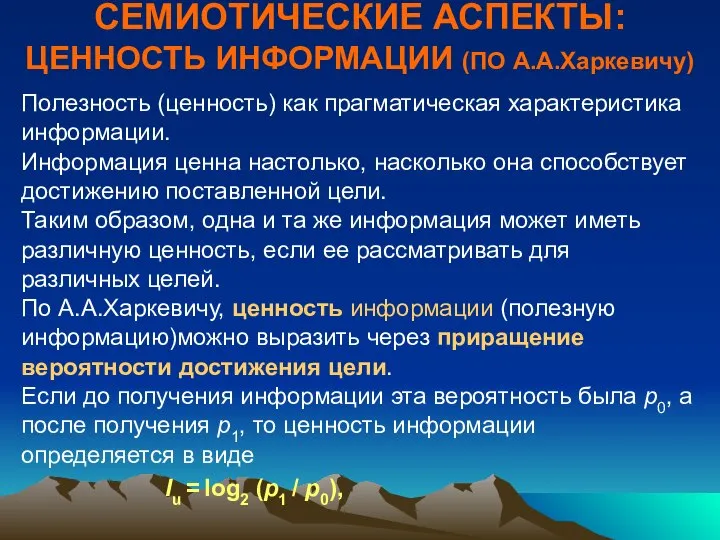

- 21. РАДИАЛЬНАЯ И ТАНГЕНЦИАЛЬНАЯ ИНФОРМАЦИЯ (по Г.А.Голицыну) Информация – это то, что меняет наши представления. Будем связывать

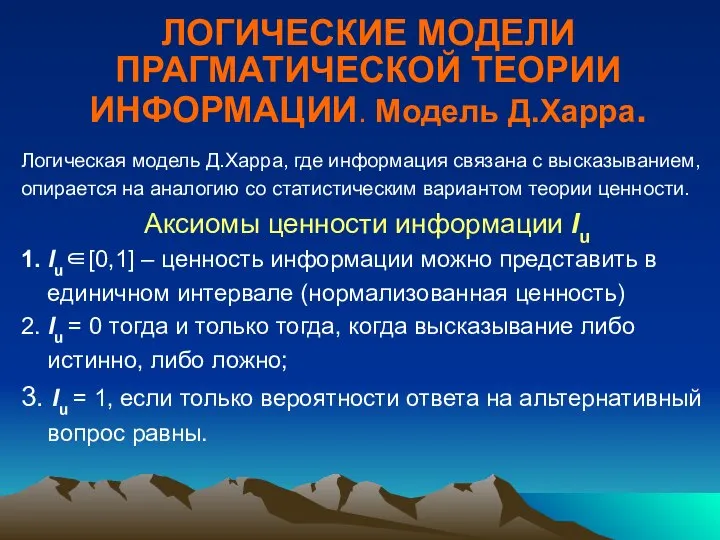

- 22. ЛОГИЧЕСКИЕ МОДЕЛИ ПРАГМАТИЧЕСКОЙ ТЕОРИИ ИНФОРМАЦИИ. Модель Д.Харра. Логическая модель Д.Харра, где информация связана с высказыванием, опирается

- 23. ЧТО ТАКОЕ ЗНАНИЯ? 1. ЗНАНИЯ ~ (ИНФОРМАЦИЯ, СВЕДЕНИЯ…) Знания – это информация, которая используется для принятия

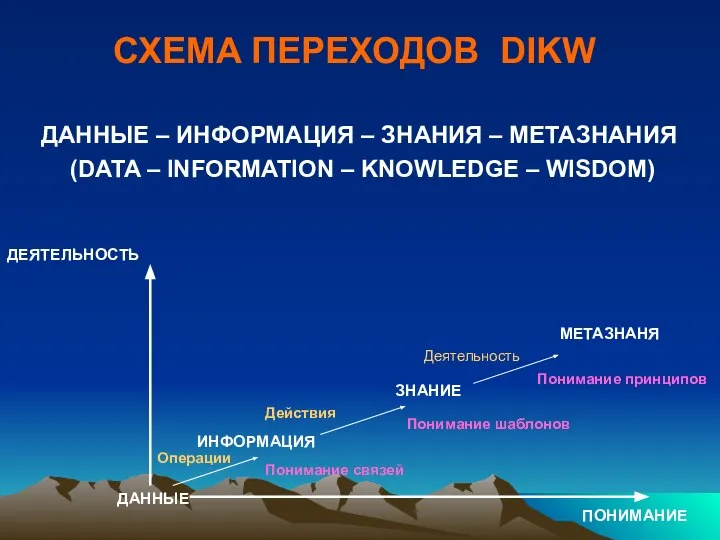

- 24. СХЕМА ПЕРЕХОДОВ DIKW ДАННЫЕ – ИНФОРМАЦИЯ – ЗНАНИЯ – МЕТАЗНАНИЯ (DATA – INFORMATION – KNOWLEDGE –

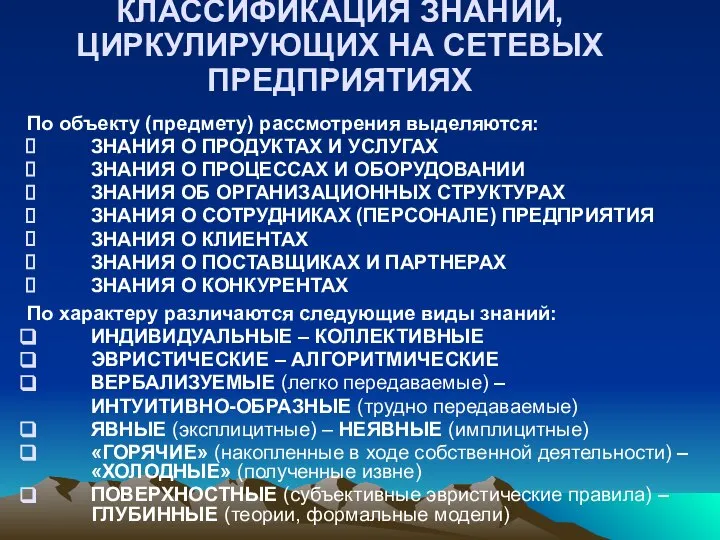

- 25. КЛАССИФИКАЦИЯ ЗНАНИЙ, ЦИРКУЛИРУЮЩИХ НА СЕТЕВЫХ ПРЕДПРИЯТИЯХ По объекту (предмету) рассмотрения выделяются: ЗНАНИЯ О ПРОДУКТАХ И УСЛУГАХ

- 26. ОБЩАЯ СХЕМА ВЗАИМОСВЯЗЕЙ МЕЖДУ РОЛЯМИ И ЗНАНИЯМИ В СЕТЕВОЙ ОРГАНИЗАЦИИ Иллюстрация распределения знаний в организации ЗАКАЗЧИК

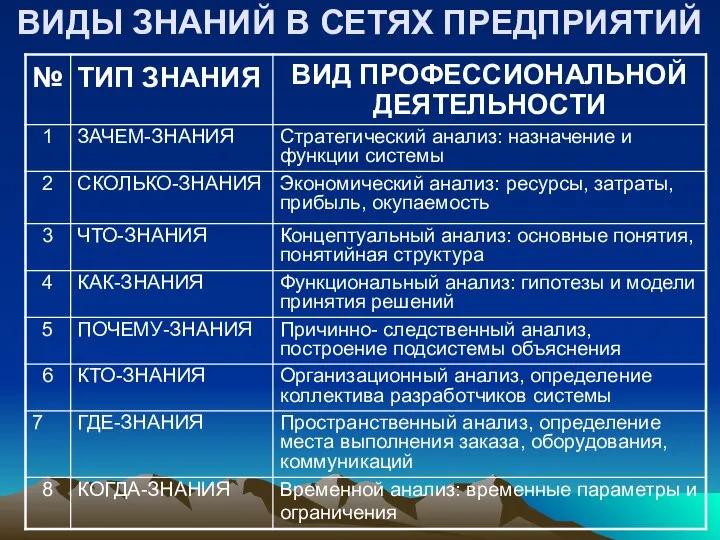

- 27. ВИДЫ ЗНАНИЙ В СЕТЯХ ПРЕДПРИЯТИЙ

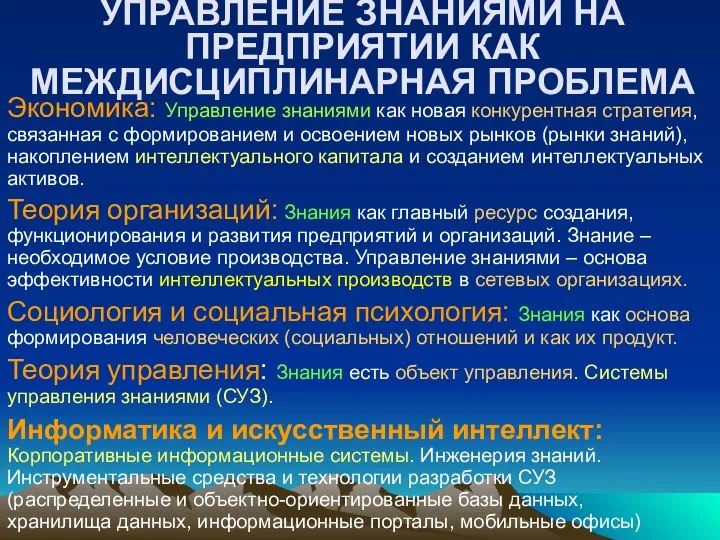

- 28. УПРАВЛЕНИЕ ЗНАНИЯМИ НА ПРЕДПРИЯТИИ КАК МЕЖДИСЦИПЛИНАРНАЯ ПРОБЛЕМА Экономика: Управление знаниями как новая конкурентная стратегия, связанная с

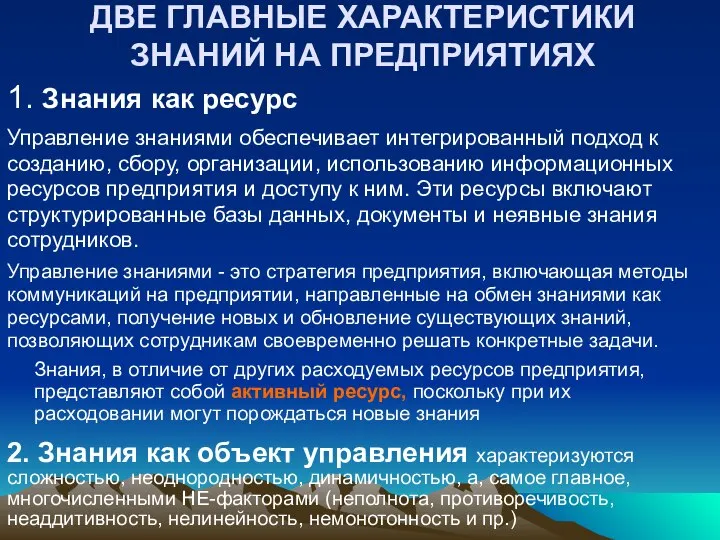

- 29. ДВЕ ГЛАВНЫЕ ХАРАКТЕРИСТИКИ ЗНАНИЙ НА ПРЕДПРИЯТИЯХ 1. Знания как ресурс Управление знаниями обеспечивает интегрированный подход к

- 30. ЖИЗНЕННЫЙ ЦИКЛ КОРПОРАТИВНЫХ ЗНАНИЙ Организация знаний = Представление знаний + Пополнение знаний

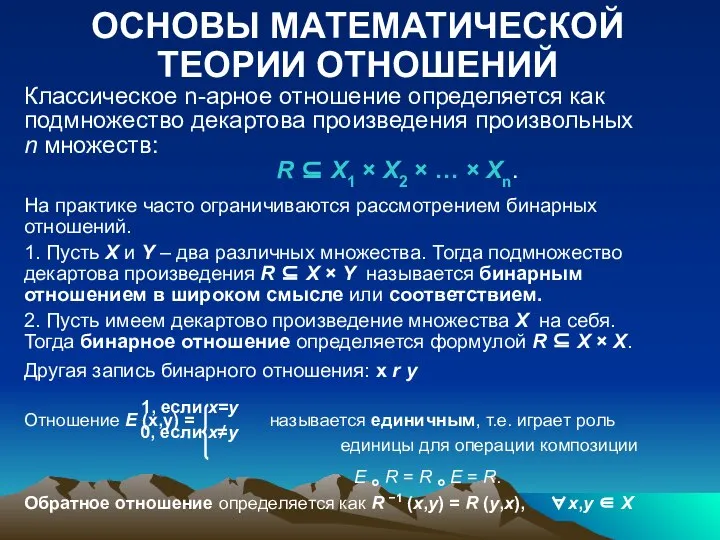

- 31. ОСНОВЫ МАТЕМАТИЧЕСКОЙ ТЕОРИИ ОТНОШЕНИЙ Классическое n-арное отношение определяется как подмножество декартова произведения произвольных n множеств: R

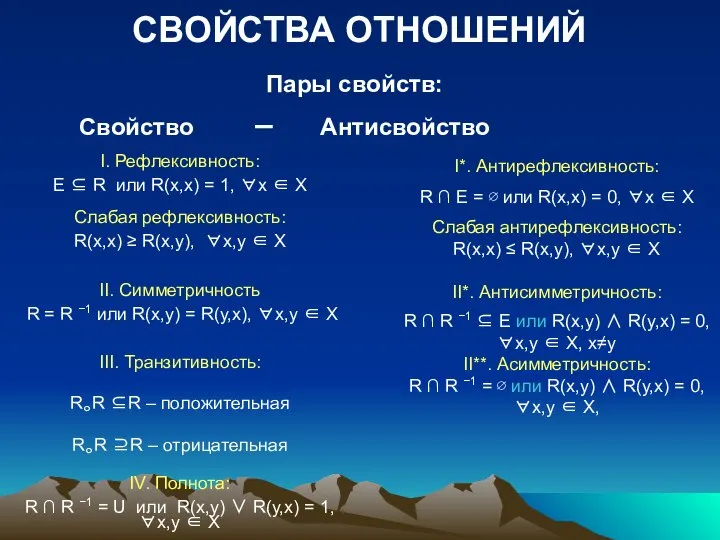

- 32. СВОЙСТВА ОТНОШЕНИЙ Пары свойств: Свойство – Антисвойство I. Рефлексивность: E ⊆ R или R(x,x) = 1,

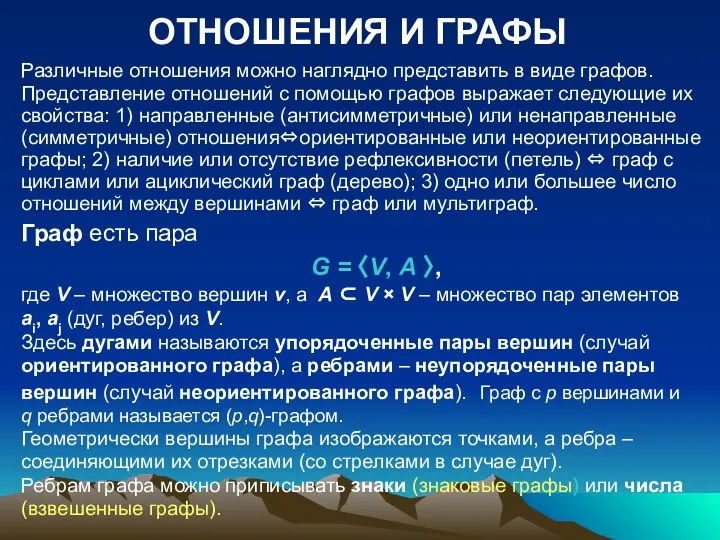

- 33. ОТНОШЕНИЯ И ГРАФЫ Различные отношения можно наглядно представить в виде графов. Представление отношений с помощью графов

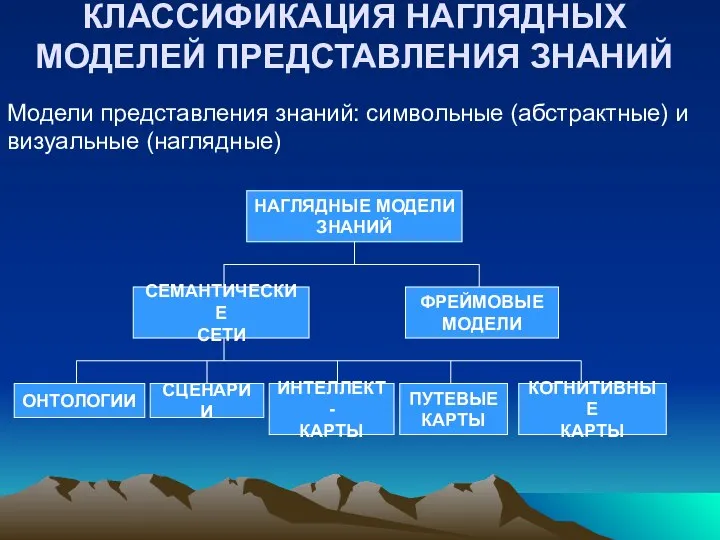

- 34. КЛАССИФИКАЦИЯ НАГЛЯДНЫХ МОДЕЛЕЙ ПРЕДСТАВЛЕНИЯ ЗНАНИЙ Модели представления знаний: символьные (абстрактные) и визуальные (наглядные) НАГЛЯДНЫЕ МОДЕЛИ ЗНАНИЙ

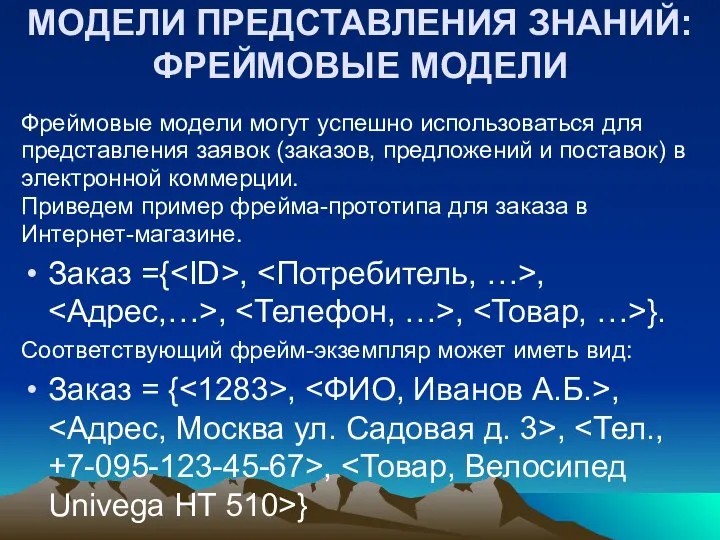

- 35. МОДЕЛИ ПРЕДСТАВЛЕНИЯ ЗНАНИЙ: ФРЕЙМОВЫЕ МОДЕЛИ Фреймовые модели могут успешно использоваться для представления заявок (заказов, предложений и

- 36. ПРЕДСТАВЛЕНИЕ ЗНАНИЙ: ПРОДУКЦИОННЫЕ ПРАВИЛА Продукционные правила подразумевают выполнение некоторого действия B в случае выполнения условия A.

- 37. КОГНИТИВНЫЕ КАРТЫ: инструментарий когнитивного моделирования Когнитивные карты – это средства когнитивного моделирования, которые могут применяться для

- 38. КОГНИТИВНАЯ КАРТА: ФОРМАЛЬНОЕ ОПРЕДЕЛЕНИЕ Когнитивная карта представляет собой знаковый граф: G = 〈V, A, F〉, где:

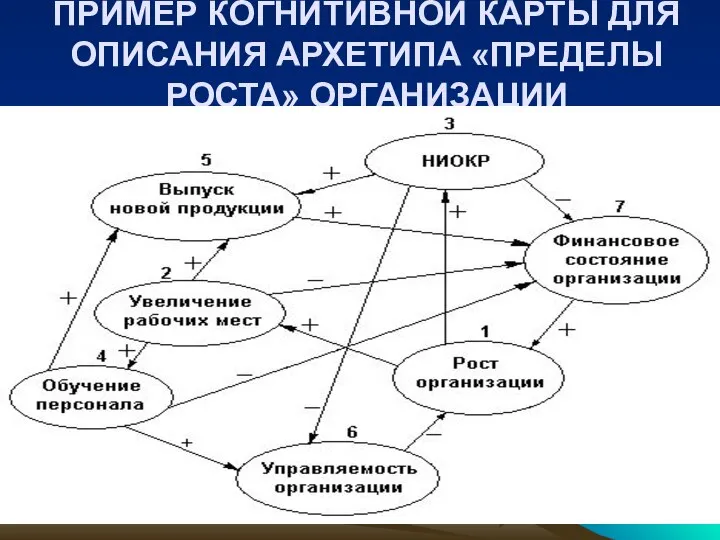

- 39. ПРИМЕР КОГНИТИВНОЙ КАРТЫ ДЛЯ ОПИСАНИЯ АРХЕТИПА «ПРЕДЕЛЫ РОСТА» ОРГАНИЗАЦИИ

- 40. ИНТЕЛЛЕКТ-КАРТЫ (МЕНТАЛЬНЫЕ КАРТЫ) Основная идея интеллект-карт (Mind Maps) заключается в поддержке правополушарных механизмов мышления путем преобразования

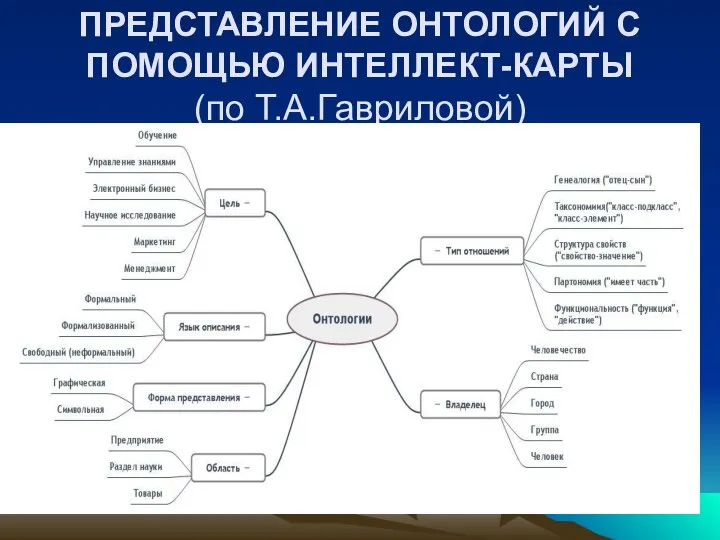

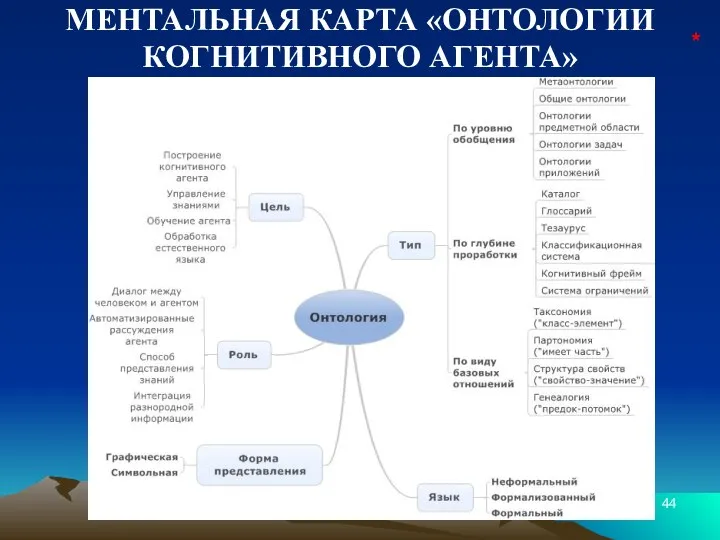

- 41. ПРЕДСТАВЛЕНИЕ ОНТОЛОГИЙ С ПОМОЩЬЮ ИНТЕЛЛЕКТ-КАРТЫ (по Т.А.Гавриловой)

- 42. ОПРЕДЕЛЕНИЕ ОНТОЛОГИИ Значительный вклад в теорию и проектирование онтологий внесли Т.Грубер, Н.Гуарино, Р.Мизогучи, Р.Студер, Т.А.Гаврилова, А.С.Клещев,

- 43. ПОНЯТИЕ ОНТОЛОГИИ Согласно спецификациям Международной федерации по разработке интеллектуальных физических агентов (FIPA98 Specifications), под онтологией понимается

- 44. МЕНТАЛЬНАЯ КАРТА «ОНТОЛОГИИ КОГНИТИВНОГО АГЕНТА» *

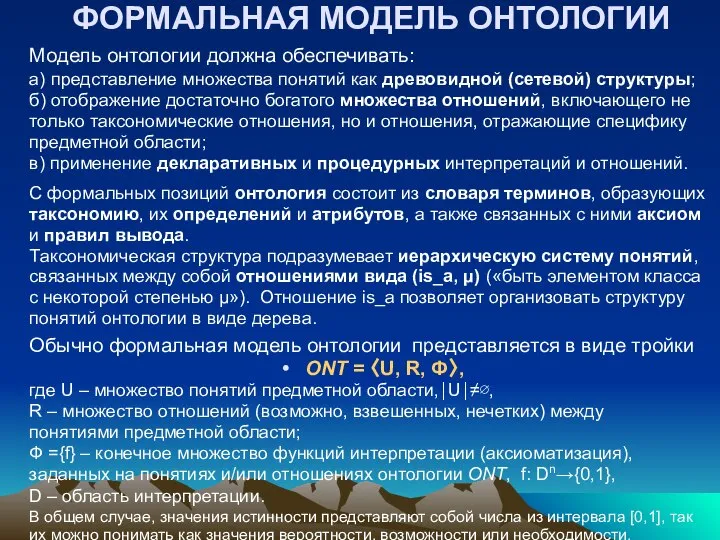

- 45. ФОРМАЛЬНАЯ МОДЕЛЬ ОНТОЛОГИИ Модель онтологии должна обеспечивать: а) представление множества понятий как древовидной (сетевой) структуры; б)

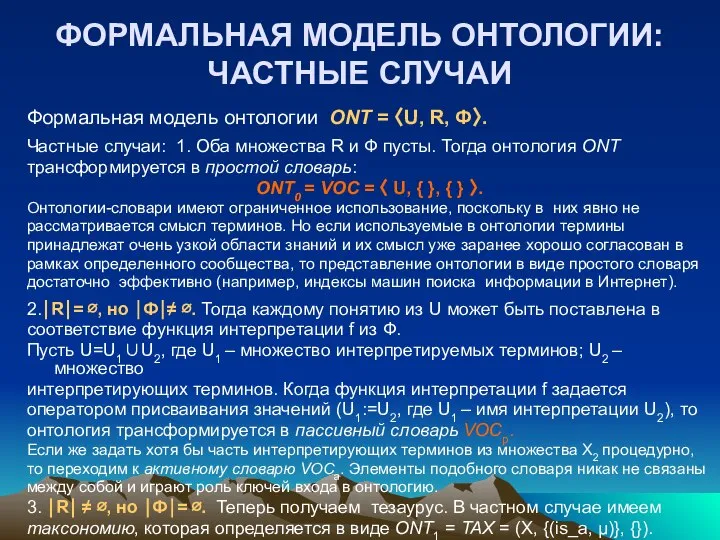

- 46. ФОРМАЛЬНАЯ МОДЕЛЬ ОНТОЛОГИИ: ЧАСТНЫЕ СЛУЧАИ Формальная модель онтологии ONT = 〈U, R, Ф〉. Частные случаи: 1.

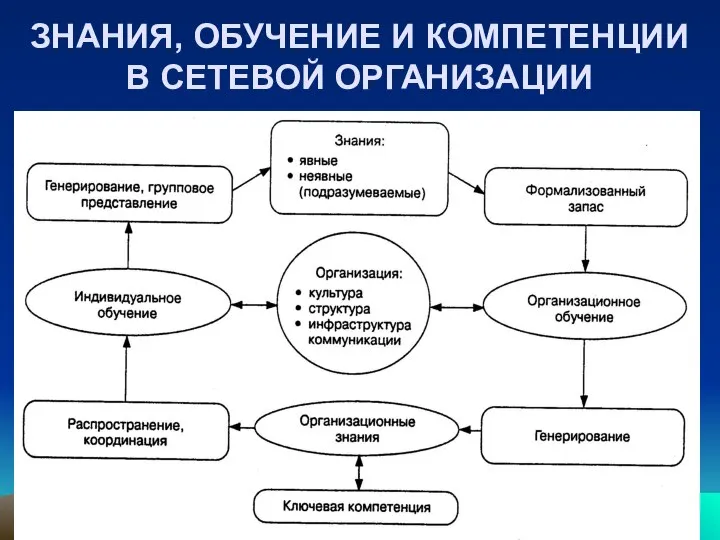

- 47. ЗНАНИЯ, ОБУЧЕНИЕ И КОМПЕТЕНЦИИ В СЕТЕВОЙ ОРГАНИЗАЦИИ

- 48. ПАРАДИГМАТИЧЕСКИЕ ОТНОШЕНИЯ Общие отношения для различных онтологий: 1) генеративные отношения «есть некоторый» (is_a); 2) таксономические отношения

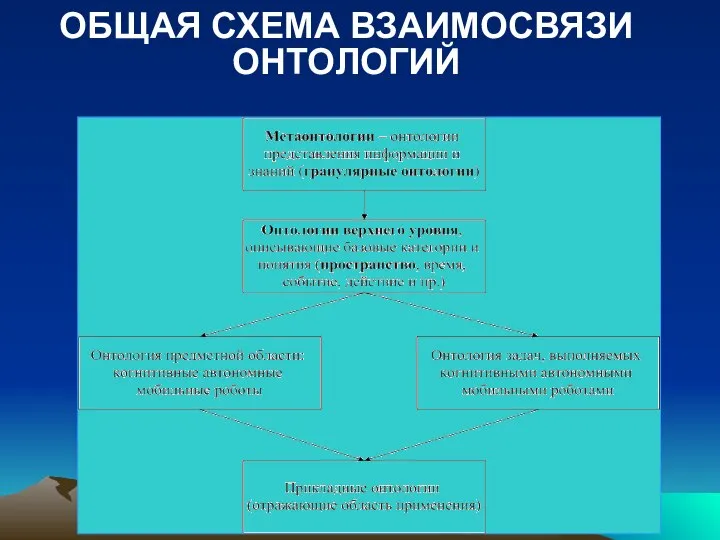

- 49. ОБЩАЯ СХЕМА ВЗАИМОСВЯЗИ ОНТОЛОГИЙ

- 50. ПОНЯТИЕ МЕТАОНТОЛОГИИ Когда говорят о метаонтологии, речь идет непосредственно об используемом классе моделей (языке) представления информации

- 52. Скачать презентацию

Массивы. Класс Array

Массивы. Класс Array Україна. День української мови

Україна. День української мови . Историко-культурный стандарт

. Историко-культурный стандарт Марафон «здоровая Эжва». Спортивный праздник «Спорт, здоровье и семья – неразлучные друзья». Фотоотчет команды «Непоседы

Марафон «здоровая Эжва». Спортивный праздник «Спорт, здоровье и семья – неразлучные друзья». Фотоотчет команды «Непоседы Стратегический анализ внутренней и внешней среды организации

Стратегический анализ внутренней и внешней среды организации Взаимосвязь политики с другими явлениями общественной жизни и ее функции

Взаимосвязь политики с другими явлениями общественной жизни и ее функции Устами младенца - презентация для начальной школы_

Устами младенца - презентация для начальной школы_ Числа, которыми измеряется преступность

Числа, которыми измеряется преступность Презентация на тему "СПИД" - скачать презентации по Медицине

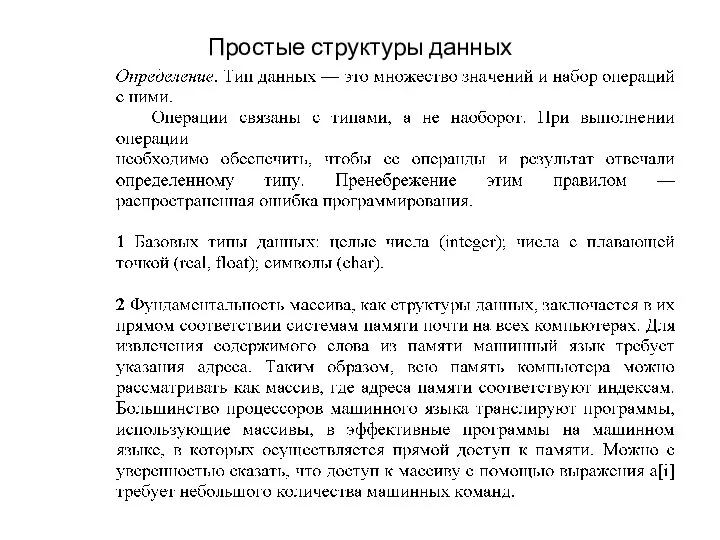

Презентация на тему "СПИД" - скачать презентации по Медицине Простые структуры данных

Простые структуры данных Костюм эпохи Відродження

Костюм эпохи Відродження Медицина, основанная на доказательствах Иерархия клинических доказательств Ора Палтиел, 9 июля, 2004

Медицина, основанная на доказательствах Иерархия клинических доказательств Ора Палтиел, 9 июля, 2004  Русская православная церковь в XV - начале XVI в

Русская православная церковь в XV - начале XVI в Разработка машины для корчевания пней

Разработка машины для корчевания пней Общественное наблюдение на выборах

Общественное наблюдение на выборах Сапаны басқарудың тотальды жалпылама жүйесі (TQM) және қолдану бағыттары

Сапаны басқарудың тотальды жалпылама жүйесі (TQM) және қолдану бағыттары ГТО и эффективность её использования

ГТО и эффективность её использования Туристско-рекреационные ресурсы: понятие, структура, оценка

Туристско-рекреационные ресурсы: понятие, структура, оценка Международное сотрудничество в Арктике

Международное сотрудничество в Арктике Программирование на языке Паскаль

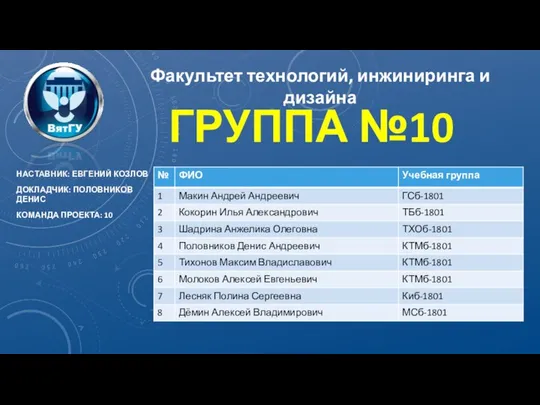

Программирование на языке Паскаль Машина Голдберга группа 10

Машина Голдберга группа 10 Презентация____

Презентация____ Износ деревянных конструкций

Износ деревянных конструкций Элементы дискретной математики

Элементы дискретной математики Проблемы распространения оружия массового уничтожения. Глава 16 (1 часть)

Проблемы распространения оружия массового уничтожения. Глава 16 (1 часть) Художественная культура в первой половине XIX века

Художественная культура в первой половине XIX века Интересные факты из жизни великих женщин-математиков

Интересные факты из жизни великих женщин-математиков Заработная плата Рынок труда Учитель: Галина Николаевна Студентка группы 1414 Моисеенкова Мария.

Заработная плата Рынок труда Учитель: Галина Николаевна Студентка группы 1414 Моисеенкова Мария.