Содержание

- 2. Нейронные сети (НС). Введение в НС. S Y Синапсы Аксон ВЫХОД

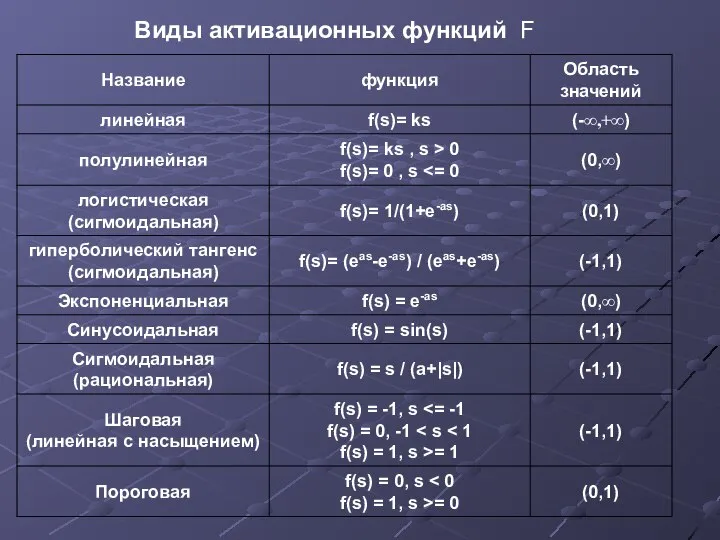

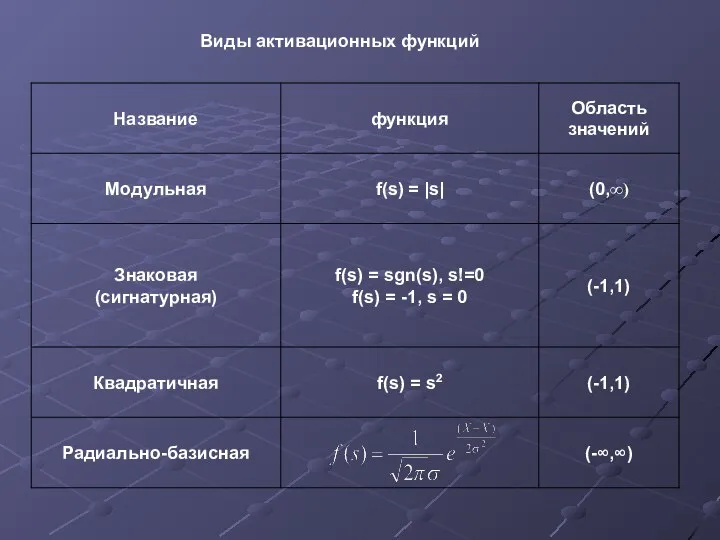

- 3. Виды активационных функций F

- 4. Виды активационных функций

- 5. Классификация нейронных сетей №1 Классификация по топологии 1.1 Полносвязные сети: 1.2 Многослойные или слоистые:

- 6. Многослойные сети делятся на: 1.2.1 Монотонные . 1.2.2 Сети без обратных связей: Обычная многослойная сеть, с

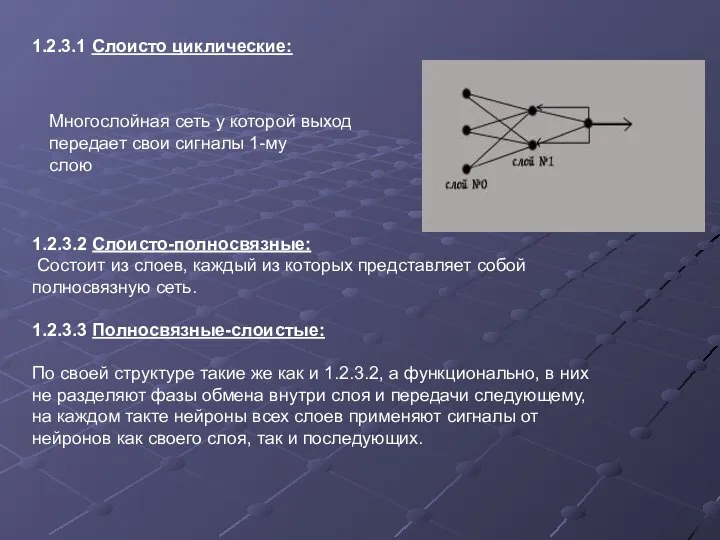

- 7. 1.2.3.1 Слоисто циклические: Многослойная сеть у которой выход передает свои сигналы 1-му слою 1.2.3.2 Слоисто-полносвязные: Состоит

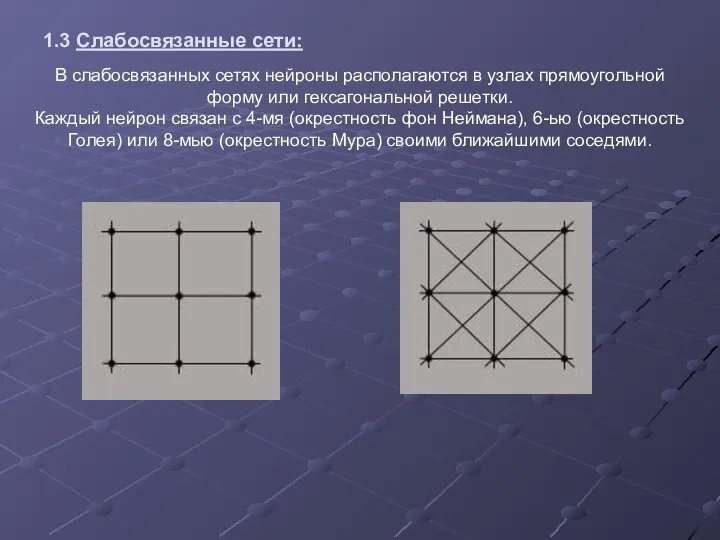

- 8. 1.3 Слабосвязанные сети: В слабосвязанных сетях нейроны располагаются в узлах прямоугольной форму или гексагональной решетки. Каждый

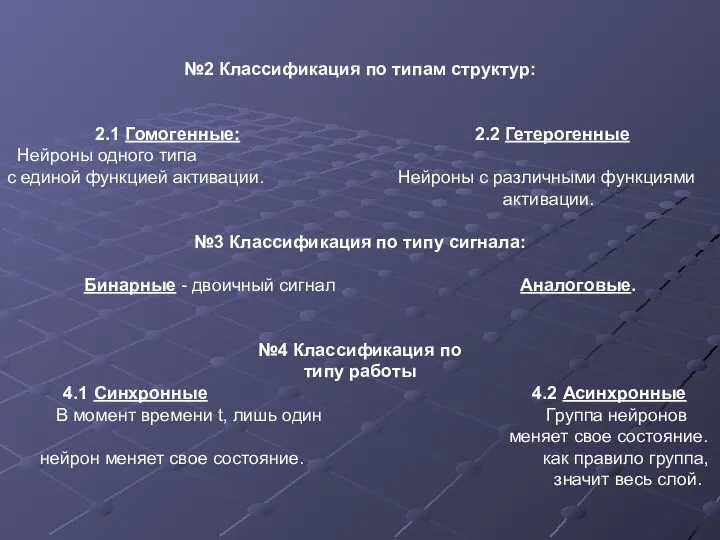

- 9. №2 Классификация по типам структур: 2.1 Гомогенные: 2.2 Гетерогенные Нейроны одного типа с единой функцией активации.

- 10. Алгоритмы обучения НС делятся на обучение “с учителем" "без учителя" Схема обучения НС с учителем

- 11. Схема обучения НС без учителя Выходной вектор нейронной сети

- 12. АЛГОРИТМЫ ОБУЧЕНИЯ НС

- 14. При заданных значениях весов и порогов, нейрон имеет определенное значение выходной активности для каждого возможного вектора

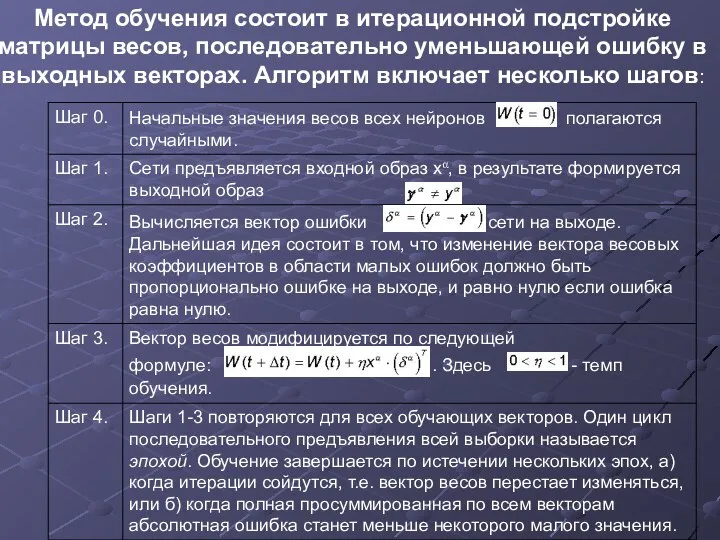

- 15. Метод обучения состоит в итерационной подстройке матрицы весов, последовательно уменьшающей ошибку в выходных векторах. Алгоритм включает

- 16. Ситуация линейной неразделимости множеств белых и черных точек Классификация на основе ПЕРСЕПТРОНА Розенблатта Логическая функция “исключающее

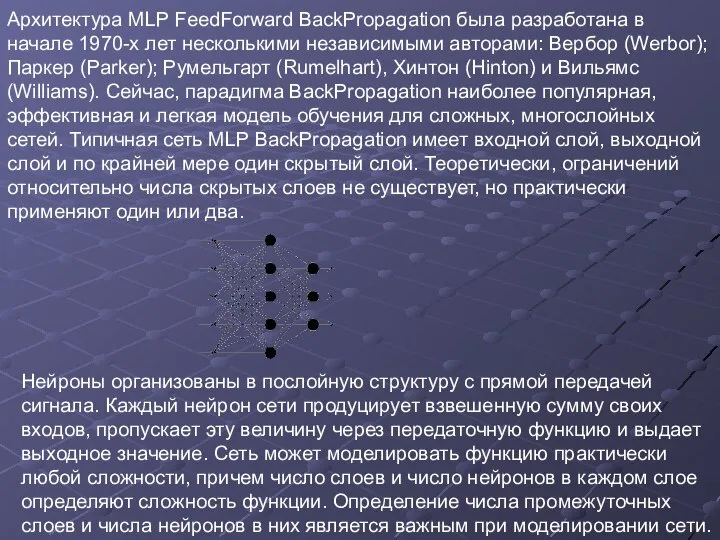

- 17. Архитектура MLP FeedForward BackPropagation была разработана в начале 1970-х лет несколькими независимыми авторами: Вербор (Werbor); Паркер

- 18. Большинство исследователей и инженеров, применяя архитектуру к определенным проблемам используют общие правила, в частности: Количество входов

- 19. В процессе функционирования нейронная сеть формирует выходной сигнал Y в соответствии с входным сигналом X, реализуя

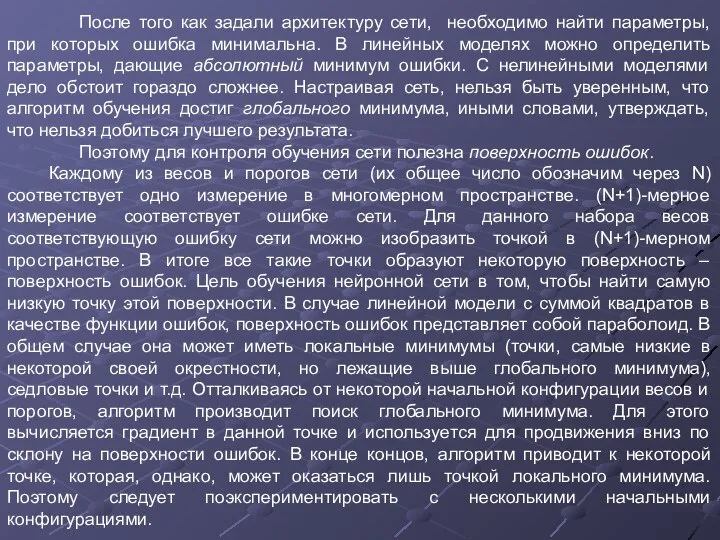

- 20. После того как задали архитектуру сети, необходимо найти параметры, при которых ошибка минимальна. В линейных моделях

- 21. Перед началом обучения весовые коэффициенты устанавливаются равными некоторым случайным значениям. При этом точка, представляющая начальное состояние

- 22. Пошаговое описание алгоритма обратного распространения ошибок Шаг 1. Весам сети присваиваются небольшие начальные значения, например значениями

- 23. Шаг 5. Веса сети корректируются так, чтобы минимизировать ошибку. Сначала веса выходного слоя, затем, с использованием

- 24. Шаг 6. Шаги со 2-го по 5-й повторяются для каждой пары тренировочного множества до тех пор,

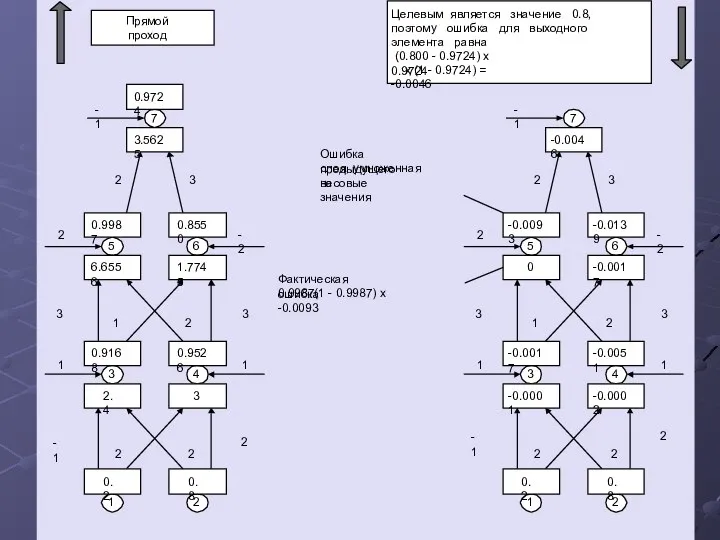

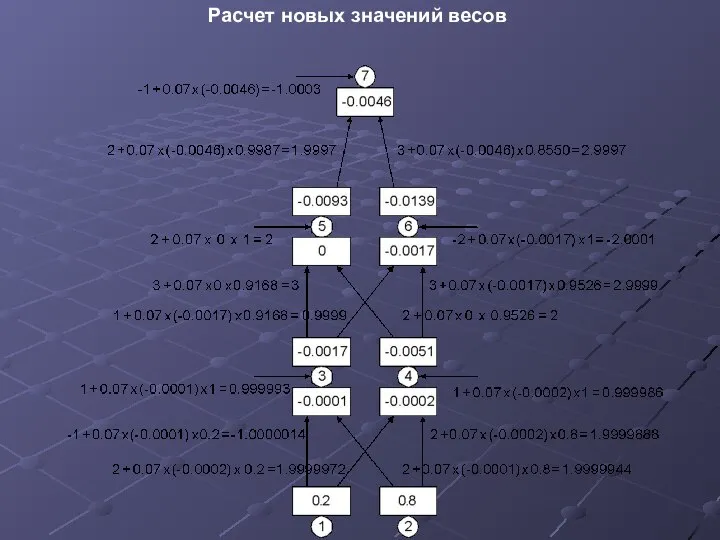

- 25. 5 0.9987 6 0.8550 6.6556 1.7745 3 0.9168 4 0.9526 2.4 3 1 0.2 2 0.8

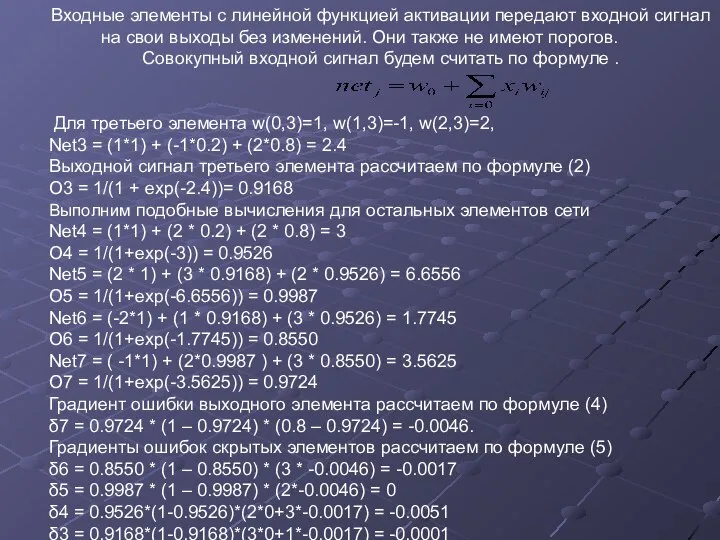

- 26. Входные элементы с линейной функцией активации передают входной сигнал на свои выходы без изменений. Они также

- 27. Вычислим значения приращений весовых коэффициентов по формуле (6). Для первого образца нет необходимости добавлять инерционный член,

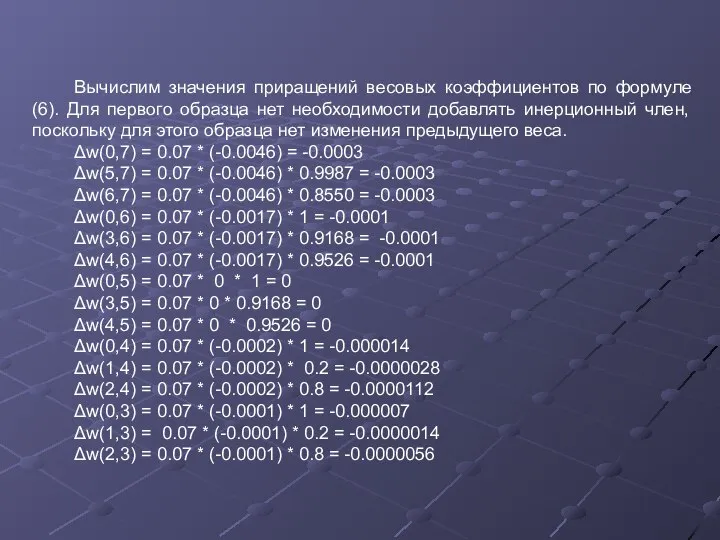

- 28. Вычислим новые значения весовых коэффициентов по формуле (7) w(0,7) = -1 + -0.0003 = -1.0003 w(5,7)

- 29. Расчет новых значений весов

- 31. Скачать презентацию

Простые механизмы

Простые механизмы Закон Ома для полной цепи

Закон Ома для полной цепи То тормозной системы

То тормозной системы Классификация, общее устройство и принцип действия поршневых ДВС

Классификация, общее устройство и принцип действия поршневых ДВС Оптические методы анализа ЛВ

Оптические методы анализа ЛВ Фотографический процесс в лучевой диагностике

Фотографический процесс в лучевой диагностике Явление электромагнитной индукции. Правило Ленца. Закон электромагнитной индукции

Явление электромагнитной индукции. Правило Ленца. Закон электромагнитной индукции Диагностирование тормозов

Диагностирование тормозов Правило Ленца. Явление самоиндукции. Энергия магнитного поля. Автор: Морозова Марина Валентиновна, учитель МОУ СОШ № 27 с УИОП г.

Правило Ленца. Явление самоиндукции. Энергия магнитного поля. Автор: Морозова Марина Валентиновна, учитель МОУ СОШ № 27 с УИОП г.  Фотоэффект – это явление вырывания электронов из вещества под действием света.

Фотоэффект – это явление вырывания электронов из вещества под действием света. Механические волны. (11 класс)

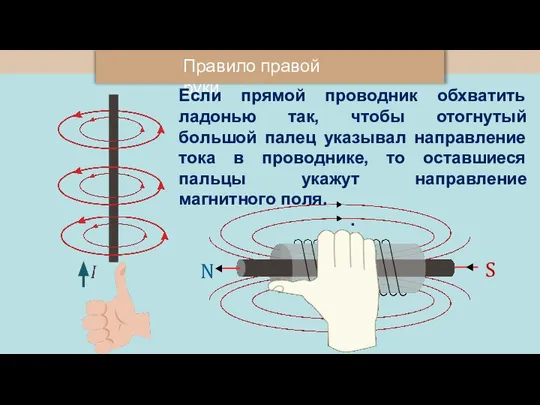

Механические волны. (11 класс) Правило правой руки

Правило правой руки Акселерометр

Акселерометр Явища природи. Фізичні явища, їх різноманітність. (Урок 11)

Явища природи. Фізичні явища, їх різноманітність. (Урок 11) Электромагнитное излучение

Электромагнитное излучение Тест. Что такое прочность?

Тест. Что такое прочность? Действия электрического тока

Действия электрического тока Учиться и, когда придет время, прикладывать усвоенное к делу — разве это не прекрасно! Конфуций

Учиться и, когда придет время, прикладывать усвоенное к делу — разве это не прекрасно! Конфуций Аттестационная работа. Формирование проектной и исследовательской деятельности учащихся на уроках физики

Аттестационная работа. Формирование проектной и исследовательской деятельности учащихся на уроках физики Презентация по физике "Опыт Торричелли" - скачать бесплатно

Презентация по физике "Опыт Торричелли" - скачать бесплатно Середня швидкість

Середня швидкість Общие сведения о системах первичного электроснабжения РЭС

Общие сведения о системах первичного электроснабжения РЭС Автомобильные свинцовые аккумуляторные батареи

Автомобильные свинцовые аккумуляторные батареи Аттестационная работа. Проект «Клуб юных физиков»

Аттестационная работа. Проект «Клуб юных физиков» Расчетно-графическая работа №2

Расчетно-графическая работа №2 Презентация по физике "Механическая модель движения альфа-частиц в опыте Резерфорда" - скачать

Презентация по физике "Механическая модель движения альфа-частиц в опыте Резерфорда" - скачать  Электричество и магнетизм. Теорема Гаусса в дифференциальной форме. (Лекция 3)

Электричество и магнетизм. Теорема Гаусса в дифференциальной форме. (Лекция 3) Явления дифракции света

Явления дифракции света