- Главная

- Математика

- Перцептрон та його різновиди

Содержание

- 2. Штучна нейронна мережа це математична модель, а також її програмна та апаратна реалізація, побудовані за принципом

- 3. Схема штучного нейрону 1. Нейрони, вхідні сигнали яких надходять на вхід даного нейрону 2. Суматор вхідних

- 4. Математична модель Математично нейрон являє собою ваговий суматор, єдиний вихід якого визначається через його входи і

- 5. Перцептро́н - математична або комп'ютерна модель сприйняття інформації мозком запропонована Френком Розенблатом й реалізована у вигляді

- 6. Перцептрон складається з трьох типів елементів, а саме: сигнали, що надходять від давачів, передаються до асоціативних

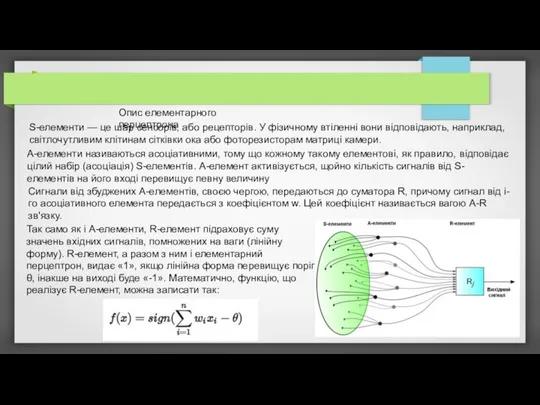

- 7. Опис елементарного перцептрона S-елементи — це шар сенсорів, або рецепторів. У фізичному втіленні вони відповідають, наприклад,

- 8. Навчання елементарного перцептрона полягає у зміні вагових коефіцієнтів w зв'язків A-R. Ваги зв'язків S-A і значення

- 9. Класифікація перцептронів Перцептрон з одним прихованим шаром Одношаровий перцептрон Багатошаровий перцептрон Розенблатта Багатошаровий перцептрон Румельхарта Перцептрон

- 10. Багатошаровий перцептрон Розенблатта перцептрон з додатковими шарами А — елементів, розташованими між S і R елементами.

- 11. Багатошаровий перцептрон Румельхарта окремий випадок перцептрона Розенблатта, в якому один алгоритм зворотного поширення помилки навчає всі

- 12. Відмінності багатошарового перцептрона від перцептрону Розенблатта Використання нелінійної функції активації, як правило сигмоїдної. Число шарів, які

- 13. Багатошаровий перцептрон буде володіти функціональними перевагами в порівнянні з перцептроном Розенблатта лише в тому випадку, якщо

- 14. Алгоритми навчання Важливою властивістю будь-якої нейронної мережі є здатність до навчання. Процес навчання є процедурою налаштування

- 15. Навчання з учителем Класичний метод навчання перцептрону — це метод корекції помилки. Він являє собою такий

- 16. Навчання без учителя Крім класичного методу навчання перцептрону, Розенблат також ввів поняття про навчання без учителя,

- 17. Метод зворотного поширення помилки Для навчання багатошарових мереж ряд учених, було запропоновано градієнтний алгоритм навчання з

- 18. Застосування перцептронів Перцептрон може бути використано, наприклад, для апроксимації функцій, для задачі прогнозування (й еквівалентної їй

- 20. Скачать презентацию

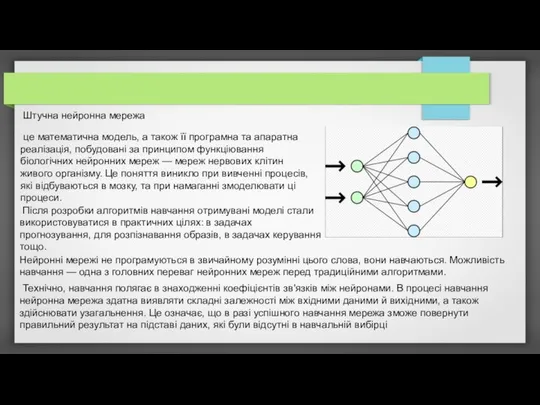

Штучна нейронна мережа

це математична модель, а також її програмна та

Штучна нейронна мережа

це математична модель, а також її програмна та

Після розробки алгоритмів навчання отримувані моделі стали використовуватися в практичних цілях: в задачах прогнозування, для розпізнавання образів, в задачах керування тощо.

Нейронні мережі не програмуються в звичайному розумінні цього слова, вони навчаються. Можливість навчання — одна з головних переваг нейронних мереж перед традиційними алгоритмами.

Технічно, навчання полягає в знаходженні коефіцієнтів зв'язків між нейронами. В процесі навчання нейронна мережа здатна виявляти складні залежності між вхідними даними й вихідними, а також здійснювати узагальнення. Це означає, що в разі успішного навчання мережа зможе повернути правильний результат на підставі даних, які були відсутні в навчальній вибірці

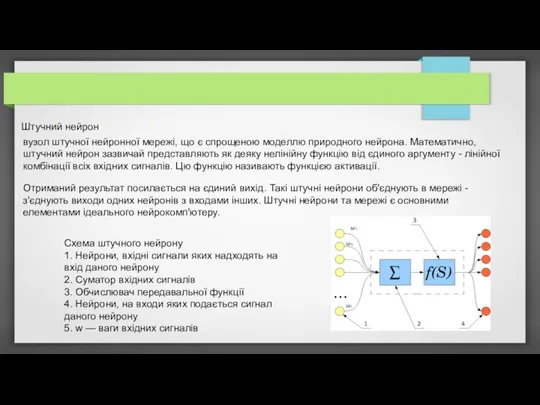

Схема штучного нейрону

1. Нейрони, вхідні сигнали яких надходять на вхід даного

Схема штучного нейрону

1. Нейрони, вхідні сигнали яких надходять на вхід даного

2. Суматор вхідних сигналів

3. Обчислювач передавальної функції

4. Нейрони, на входи яких подається сигнал даного нейрону

5. w — ваги вхідних сигналів

Штучний нейрон

вузол штучної нейронної мережі, що є спрощеною моделлю природного нейрона. Математично, штучний нейрон зазвичай представляють як деяку нелінійну функцію від єдиного аргументу - лінійної комбінації всіх вхідних сигналів. Цю функцію називають функцією активації.

Отриманий результат посилається на єдиний вихід. Такі штучні нейрони об'єднують в мережі - з'єднують виходи одних нейронів з входами інших. Штучні нейрони та мережі є основними елементами ідеального нейрокомп'ютеру.

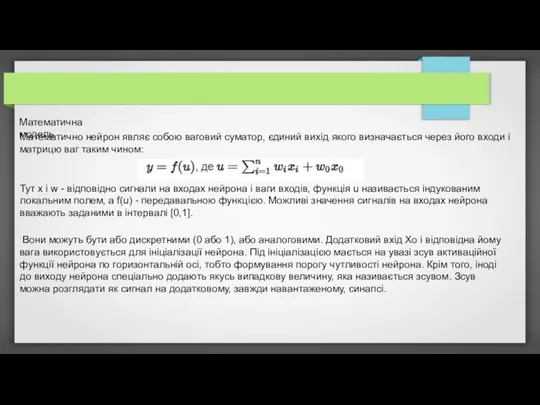

Математична модель

Математично нейрон являє собою ваговий суматор, єдиний вихід якого визначається

Математична модель

Математично нейрон являє собою ваговий суматор, єдиний вихід якого визначається

Тут x і w - відповідно сигнали на входах нейрона і ваги входів, функція u називається індукованим локальним полем, а f(u) - передавальною функцією. Можливі значення сигналів на входах нейрона вважають заданими в інтервалі [0,1].

Вони можуть бути або дискретними (0 або 1), або аналоговими. Додатковий вхід Xo і відповідна йому вага використовується для ініціалізації нейрона. Під ініціалізацією мається на увазі зсув активаційної функції нейрона по горизонтальній осі, тобто формування порогу чутливості нейрона. Крім того, іноді до виходу нейрона спеціально додають якусь випадкову величину, яка називається зсувом. Зсув можна розглядати як сигнал на додатковому, завжди навантаженому, синапсі.

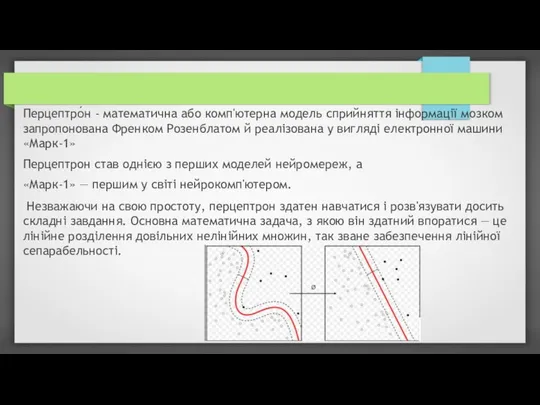

Перцептро́н - математична або комп'ютерна модель сприйняття інформації мозком запропонована Френком

Перцептро́н - математична або комп'ютерна модель сприйняття інформації мозком запропонована Френком

Перцептрон став однією з перших моделей нейромереж, а

«Марк-1» — першим у світі нейрокомп'ютером.

Незважаючи на свою простоту, перцептрон здатен навчатися і розв'язувати досить складні завдання. Основна математична задача, з якою він здатний впоратися — це лінійне розділення довільних нелінійних множин, так зване забезпечення лінійної сепарабельності.

Перцептрон складається з трьох типів елементів, а саме:

сигнали, що надходять

Перцептрон складається з трьох типів елементів, а саме:

сигнали, що надходять

В біологічному плані це відповідає перетворенню, наприклад, зорової інформації у фізіологічну відповідь рухових нейронів.

Опис елементарного перцептрона

S-елементи — це шар сенсорів, або рецепторів. У

Опис елементарного перцептрона

S-елементи — це шар сенсорів, або рецепторів. У

A-елементи називаються асоціативними, тому що кожному такому елементові, як правило, відповідає цілий набір (асоціація) S-елементів. A-елемент активізується, щойно кількість сигналів від S-елементів на його вході перевищує певну величину

Сигнали від збуджених A-елементів, своєю чергою, передаються до суматора R, причому сигнал від i-го асоціативного елемента передається з коефіцієнтом w. Цей коефіцієнт називається вагою A-R зв'язку.

Так само як і A-елементи, R-елемент підраховує суму значень вхідних сигналів, помножених на ваги (лінійну форму). R-елемент, а разом з ним і елементарний перцептрон, видає «1», якщо лінійна форма перевищує поріг θ, інакше на виході буде «-1». Математично, функцію, що реалізує R-елемент, можна записати так:

Навчання елементарного перцептрона полягає у зміні вагових коефіцієнтів w зв'язків

Навчання елементарного перцептрона полягає у зміні вагових коефіцієнтів w зв'язків

Після навчання перцептрон готовий працювати в режимі розпізнавання або узагальнення. У цьому режимі перцептрону пред'являються раніше невідомі йому об'єкти, й він повинен встановити, до якого класу вони належать. Робота перцептрона полягає в наступному: при пред'явленні об'єкта, збуджені A-елементи передають сигнал R-елементу, що дорівнює сумі відповідних коефіцієнтів w.

Якщо ця сума позитивна, то ухвалюється рішення, що даний об'єкт належить до першого класу, а якщо вона негативна — то до другого.

Класифікація перцептронів

Перцептрон з одним прихованим шаром

Одношаровий перцептрон

Багатошаровий перцептрон Розенблатта

Багатошаровий

Класифікація перцептронів

Перцептрон з одним прихованим шаром

Одношаровий перцептрон

Багатошаровий перцептрон Розенблатта

Багатошаровий

Перцептрон з одним прихованим шаром

Це класичний перцептрон, у нього є по одному шару S-, A- та R-елементів.

Одношаровий перцептрон

Це модель, у якій вхідні елементи безпосередньо з'єднано з вихідними за допомогою системи ваг. Є найпростішою мережею прямого поширення — лінійним класифікатором, і окремим випадком класичного перцептрона, в якому кожен S-елемент однозначно відповідає одному A-елементові, S-A зв'язку мають вагу +1, і всі A-елементи мають поріг θ = 1. Одношарові перцептрони фактично є формальними нейронами

Багатошаровий перцептрон Розенблатта

перцептрон з додатковими шарами А — елементів,

Багатошаровий перцептрон Розенблатта

перцептрон з додатковими шарами А — елементів,

Багатошаровий перцептрон Румельхарта

окремий випадок перцептрона Розенблатта, в якому один алгоритм зворотного

Багатошаровий перцептрон Румельхарта

окремий випадок перцептрона Розенблатта, в якому один алгоритм зворотного

Відмінності багатошарового перцептрона від перцептрону Розенблатта

Використання нелінійної функції активації, як

Відмінності багатошарового перцептрона від перцептрону Розенблатта

Використання нелінійної функції активації, як

Число шарів, які навчають, більше одного. Найчастіше використовується не більше трьох.

Сигнали, що надходять на вхід, та одержувані з виходу не бінарні, а можуть кодуватися десятковими числами, які потрібно нормалізувати, так щоб значення були на відрізку була від 0 до 1 (нормалізація необхідна як мінімум для вихідних даних, згідно з функцією активації — сигмоїдою).

Допускається довільна архітектура зв'язків (у тому числі, і повнозв'язані мережі).

Помилка мережі обчислюється не як число неправильних образів після ітерації навчання, а як деяка статистична міра нев'язаності між потрібним і одержаним значенням.

Навчання проводиться не до відсутності помилок після навчання, а до стабілізації вагових коефіцієнтів при навчанні або переривається раніше, щоб уникнути перенавчання.

Багатошаровий перцептрон буде володіти функціональними перевагами в порівнянні з перцептроном

Багатошаровий перцептрон буде володіти функціональними перевагами в порівнянні з перцептроном

Алгоритми навчання

Важливою властивістю будь-якої нейронної мережі є здатність до навчання.

Алгоритми навчання

Важливою властивістю будь-якої нейронної мережі є здатність до навчання.

Система підкріплення — це будь-який набір правил, на підставі яких можна змінювати з плином часу матрицю взаємодії (або стан пам'яті) перцептрону.

• Навчання з учителем

• Навчання без учителя

• Метод зворотного поширення помилки

Навчання з учителем

Класичний метод навчання перцептрону — це метод корекції

Навчання з учителем

Класичний метод навчання перцептрону — це метод корекції

Припустимо, ми хочемо навчити перцептрон розділяти два класи об'єктів так, щоби при пред'явленні об'єктів першого класу вихід перцептрона був позитивний (+1), а при пред'явленні об'єктів другого класу — негативним (-1). Для цього виконаємо наступний алгоритм:

1.Випадково вибираємо пороги для A-елементів та встановлюємо зв'язки S-A .

2.Початкові коефіцієнти w вважаємо рівними нулеві.

3. Пред'являємо навчальну вибірку: об'єкти (наприклад, кола або квадрати) із зазначенням класу, до якого вони належать.

Показуємо перцептронові об'єкт першого класу. При цьому деякі A-елементи збудяться. Коефіцієнти w, що відповідають цим збудженням елементів, збільшуємо на 1.

Пред'являємо об'єкт другого класу, і коефіцієнти w тих А-елементів, які збудилися при цьому показі, зменшуємо на 1.

4. Обидві частини кроку 3 виконаємо для всієї навчальної вибірки. В результаті навчання сформуються значення вагів зв'язків w.

Навчання без учителя

Крім класичного методу навчання перцептрону, Розенблат також ввів

Навчання без учителя

Крім класичного методу навчання перцептрону, Розенблат також ввів

Альфа-система підкріплення — це система підкріплення, за якої ваги всіх активних зв'язків C, що ведуть до елемента U, змінюються на однакову величину r, а ваги неактивних зв'язків за цей час не змінюються.

Пізніше, з розробкою поняття багатошарового перцептрону, альфа-систему було модифіковано, і її стали називати дельта-правилом. Модифікацію було проведено з метою зробити функцію навчання диференційовною (наприклад, сигмоїдною), що в свою чергу потрібно для застосування методу градієнтного спуску, завдяки якому можливе навчання більше ніж одного шару.

Метод зворотного поширення помилки

Для навчання багатошарових мереж ряд учених, було

Метод зворотного поширення помилки

Для навчання багатошарових мереж ряд учених, було

Застосування перцептронів

Перцептрон може бути використано, наприклад, для апроксимації функцій, для

Застосування перцептронів

Перцептрон може бути використано, наприклад, для апроксимації функцій, для

У практичних задачах від перцептрона вимагатиметься можливість вибору більш ніж з двох варіантів, а отже, на виході в нього має бути більше одного R-елемента.

Апроксимація функцій

Прогнозування та розпізнавання образів

Керування агентами

Умножение суммы на число 2

Умножение суммы на число 2 Алгоритм письменного сложения и вычитания многозначных чисел. Яворская Татьяна Федоровна учитель начальных классов ГОУ СОШ №

Алгоритм письменного сложения и вычитания многозначных чисел. Яворская Татьяна Федоровна учитель начальных классов ГОУ СОШ № Прямоугольник, ромб, квадрат

Прямоугольник, ромб, квадрат Линейные уравнения. Конкурс

Линейные уравнения. Конкурс Урок математики во 2 классе «Устные приемы вычислений в пределах 100» Выполнила: учитель начальных классов МОУ «СОШ № 43» Города

Урок математики во 2 классе «Устные приемы вычислений в пределах 100» Выполнила: учитель начальных классов МОУ «СОШ № 43» Города Гипотезы значений вариационного ряда фактора для статистической модели

Гипотезы значений вариационного ряда фактора для статистической модели Свойства параллелограмма

Свойства параллелограмма Обобщение и систематизация знаний и умений решения линейных уравнений с одной переменной в 7 классе

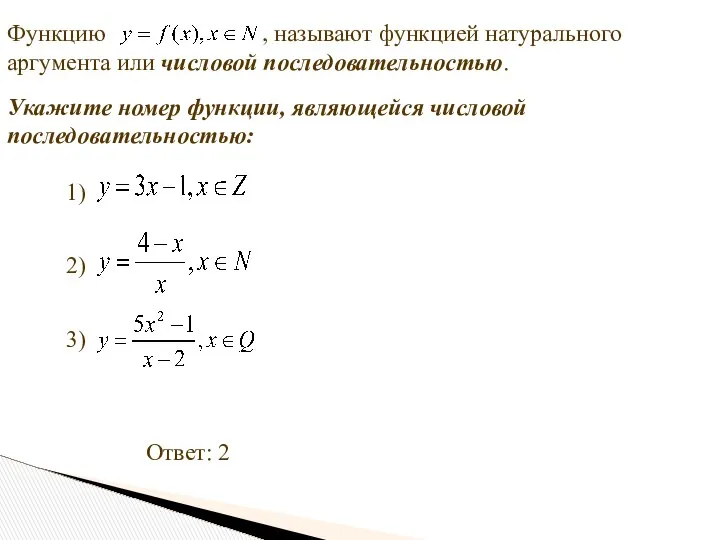

Обобщение и систематизация знаний и умений решения линейных уравнений с одной переменной в 7 классе Способы задания числовых последовательностей

Способы задания числовых последовательностей Алгебра. Подготовка к ЕГЭ

Алгебра. Подготовка к ЕГЭ Схемы краткой записи к задачам

Схемы краткой записи к задачам Автор: Стребкова Виктория Ученица 5 класса

Автор: Стребкова Виктория Ученица 5 класса  Пьер Ферма (1601-1665)

Пьер Ферма (1601-1665) Сложение и вычитание десятичных дробей

Сложение и вычитание десятичных дробей Построение графика квадратичной функции

Построение графика квадратичной функции Тренажёр. Деление на цифру 2

Тренажёр. Деление на цифру 2 Сложение однозначных чисел с переходом через десяток вида + 4

Сложение однозначных чисел с переходом через десяток вида + 4 Презентация на тему Что такое дроби?

Презентация на тему Что такое дроби?  Памятка по оформлению краткой записи к задачам 1-2 класс

Памятка по оформлению краткой записи к задачам 1-2 класс Великая Отечественная война в задачах

Великая Отечественная война в задачах Обработка результатов исследования методами математической статистики

Обработка результатов исследования методами математической статистики Графики функций

Графики функций Векторы. Векторные величины

Векторы. Векторные величины Применение производной. Задание 8 (профильный уровень)

Применение производной. Задание 8 (профильный уровень) Дроби. Урок-игра "Дробный мозгодром". (5 класс)

Дроби. Урок-игра "Дробный мозгодром". (5 класс) Совершенствование навыков решения прямоугольных треугольников

Совершенствование навыков решения прямоугольных треугольников Линейные операторы

Линейные операторы Координатная плоскость

Координатная плоскость