Содержание

- 2. Где мы встречаем многомерные пространства? Одна из самых распространенных областей - анализ данных:

- 3. Цель визуализации Цель – получить отображение данных в 2 или 3 мерном пространстве для дальнейшего изучения

- 4. "To deal with hyper-planes in a 14 dimensional space, visualize a 3D space and say 'fourteen'

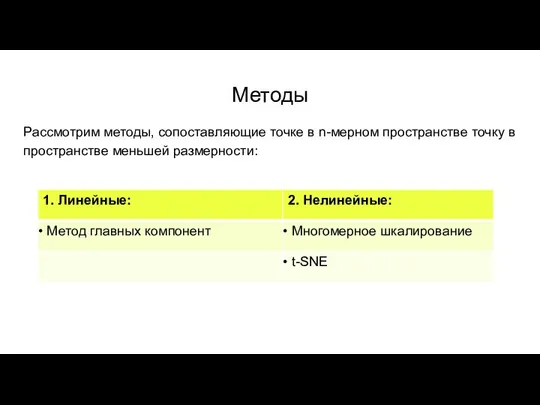

- 5. Методы Рассмотрим методы, сопоставляющие точке в n-мерном пространстве точку в пространстве меньшей размерности:

- 6. Метод главных компонент (PCA) Основной линейный метод понижения размерности – PCA – производит линейное сопоставление данных

- 7. Максимизировать вариацию по вектору Минимизировать сумму расстояний от точки до ее проекции на данный вектор

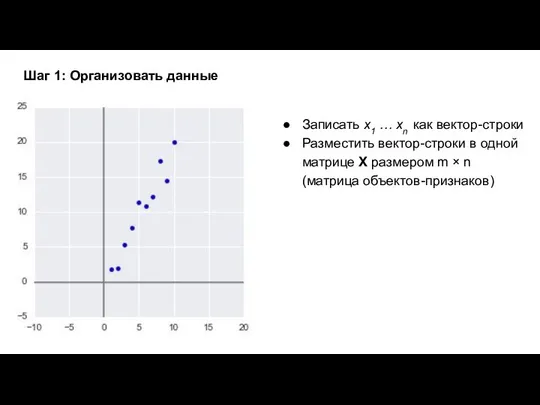

- 8. Записать x1 … xn как вектор-строки Разместить вектор-строки в одной матрице X размером m × n

- 9. Шаг 2: Оцентрировать данные Найти среднее по каждой колонке Вычесть вектор средних из каждой строки матрицы

- 10. Шаг 3: Вычислить матрицу ковариации Найти матрицу ковариации С размера n × n как: C =

- 11. Шаг 4: Найти собственные вектора и собственные числа матрицы С Вычислить матрицу V эйгенвекторов которая диагонализирует

- 12. Шаг 5: Проекция и реконструкция В матрицу Vreduced записать k вектор-колонок, соответствующих k наибольшим собственным числам.

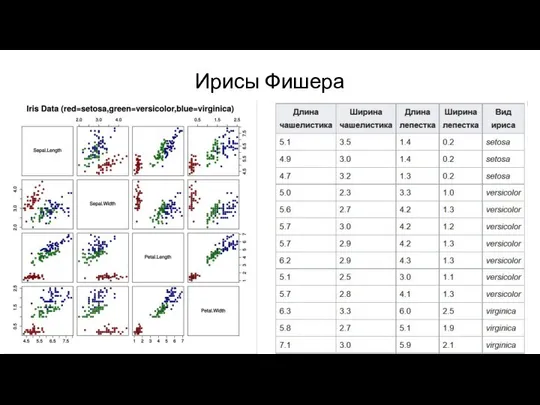

- 13. Ирисы Фишера

- 14. Проекция ирисов на главные компоненты

- 15. MNIST (сокр. от Mixed National Institute of Standards and Technology)

- 17. Почему такой плохой результат? Линейная комбинация объектов датасета не является рукописной цифрой. Значит объекты расположены в

- 18. Нелинейные методы Рассмотрим более простую модель и поставим задачу нелинейного понижения размерности: Задача — найти отображение

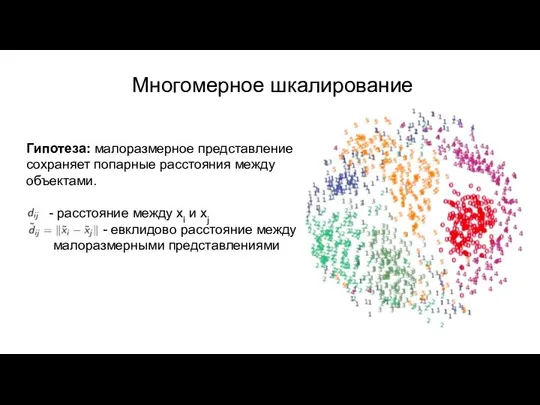

- 19. Гипотеза: малоразмерное представление сохраняет попарные расстояния между объектами. - расстояние между xi и xj - евклидово

- 20. Функционал качества: Ищем представления, апроксимирующие dij: Алгоритм: SMACOF (Scaling by MAjorizing a COmplicated Function) - стресс-функция

- 21. Stochastic Neighbour Embedding (SNE) Гипотеза: В точности воспроизвести расстояния – слишком сложно. Достаточно сохранения пропорций. Опишем

- 22. Функционал качества: Минимизируем разницу между распределениями расстояний с помощью дивергенции Кульбака-Лейблера: Алгоритм: (Стохастический) градиентный спуск Repeat

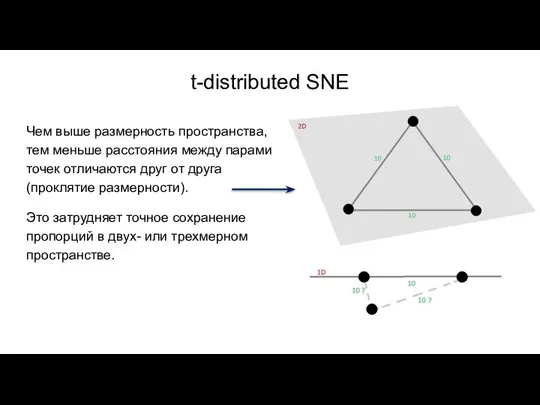

- 23. t-distributed SNE Чем выше размерность пространства, тем меньше расстояния между парами точек отличаются друг от друга

- 24. Значит нужно меньше штрафовать за увеличение пропорций в маломерном пространстве. Изменим распределение:

- 25. Сохраняет кластерную структуру самих классов

- 26. Сравнение методов

- 27. Выводы Существует множество методов визуализации многомерных данных Выбор метода сильно зависит от конкретной задачи Ключевым фактором

- 29. Скачать презентацию

Особенности построения фазовых портретов

Особенности построения фазовых портретов Собирательные числительные

Собирательные числительные Свойства функций . 9 класс

Свойства функций . 9 класс Решение простейших тригонометрических уравнений

Решение простейших тригонометрических уравнений Вавилонская система счисления

Вавилонская система счисления Урок математики в 3классе. «Путешествие по Астане» подготовила учитель начальных классов Пак Светлана Александровна

Урок математики в 3классе. «Путешествие по Астане» подготовила учитель начальных классов Пак Светлана Александровна  Сравнение чисел. Урок математики в 6 классе

Сравнение чисел. Урок математики в 6 классе Симметрия в нашей жизни

Симметрия в нашей жизни Треугольники. Задачи

Треугольники. Задачи Решение задач методом координат. 5 класс

Решение задач методом координат. 5 класс Уравнения и способы их решения

Уравнения и способы их решения Презентация по математике "Учимся считать от 0 до 10" - скачать

Презентация по математике "Учимся считать от 0 до 10" - скачать  Наибольший общий делитель и наименьшее общее кратное

Наибольший общий делитель и наименьшее общее кратное Геометрические тела

Геометрические тела Преобразование подобия. Гомотетия

Преобразование подобия. Гомотетия Четырехугольники. Своя игра

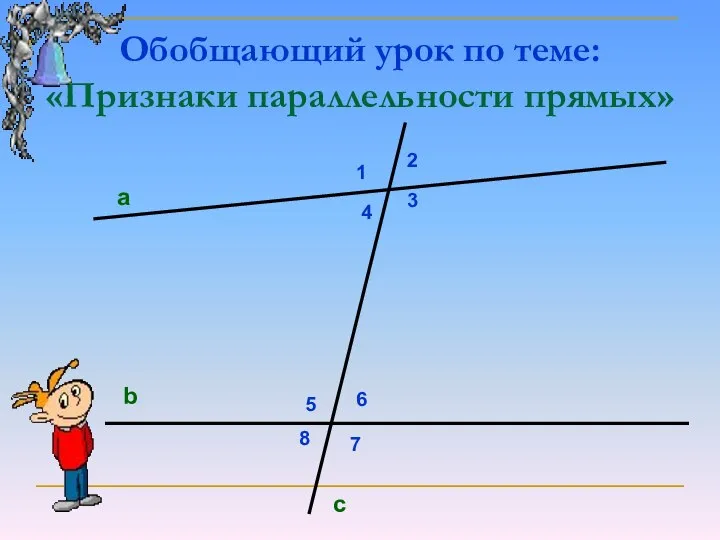

Четырехугольники. Своя игра Обобщающий урок по теме: «Признаки параллельности прямых»

Обобщающий урок по теме: «Признаки параллельности прямых» Геометрические иллюзии

Геометрические иллюзии Решение задач на проценты. Как найти % от числа

Решение задач на проценты. Как найти % от числа Объем тела. Принцип Кавальери

Объем тела. Принцип Кавальери Презентация на тему Коэффициенты

Презентация на тему Коэффициенты  Математический аукцион. 9 класс

Математический аукцион. 9 класс Готовимся к итоговой аттестации

Готовимся к итоговой аттестации Обобщающий урок по теме: «Синус, косинус, тангенс суммы и разности аргументов. Презентация выполнена для уроков по алгебре и начал

Обобщающий урок по теме: «Синус, косинус, тангенс суммы и разности аргументов. Презентация выполнена для уроков по алгебре и начал Численное решение одномерных задач динамики сплошных сред с учетом симметрии

Численное решение одномерных задач динамики сплошных сред с учетом симметрии Задача линейного программирования, графический способ решения

Задача линейного программирования, графический способ решения Сюжетные задачи

Сюжетные задачи Различные способы умножения. Проектная работа

Различные способы умножения. Проектная работа