Содержание

- 2. Хотим все, сразу и бесплатно Программисты всегда мечтали, что в их программы параллелизм проберется сам, незаметно

- 3. OpenMP Открытый стандарт OpenMP Architecture Review Board Windows, Linux, Mac OS X, Solaris «Учредители»:

- 4. Поддержка OpenMP Microsoft Visual Studio 2005 и 2008 поддерживает OpenMP 2.0 в редакциях Professional и Team

- 5. Что такое OpenMP? Стандарт Библиотека времени выполнения Поддержка в компиляторе

- 6. Что такое OpenMP? OpenMP подразумевает маркировку параллельного кода специальными директивами. Параллелизация происходит «почти автоматически». Паралелльные участки

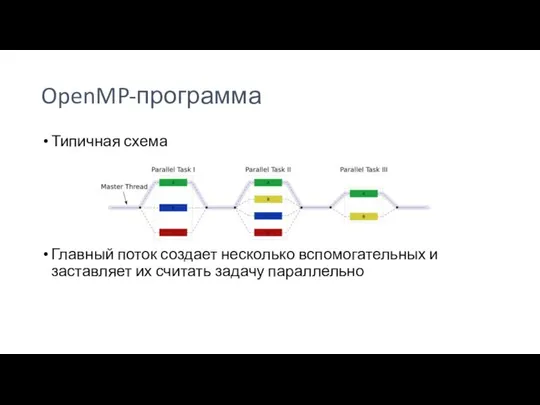

- 7. OpenMP-программа Типичная схема Главный поток создает несколько вспомогательных и заставляет их считать задачу параллельно

- 8. Лучше один раз увидеть… double a[N], b[N], c[N]; int i; omp_set_dynamic(0); omp_set_num_threads(10); #pragma omp parallel shared(a,

- 9. Формат директив #pragma omp [directive] [clause [clause] …] [directive] – название директивы [clause] - условие Продление

- 10. Подключение в C++ /openmp – флаг компилятору в VS

- 11. Инкрементальный параллелизм Не нужно выкидывать старую программу и писать новую Можно постепенно переписывать код на использование

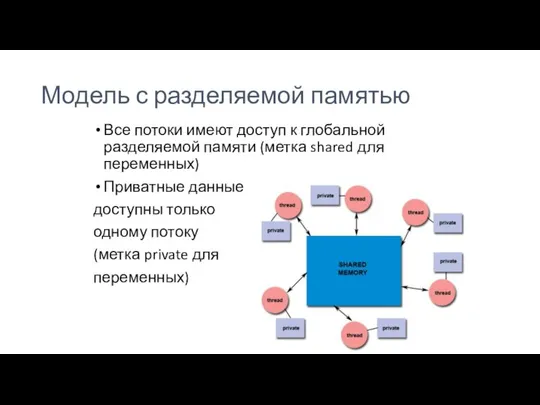

- 12. Модель с разделяемой памятью Все потоки имеют доступ к глобальной разделяемой памяти (метка shared для переменных)

- 13. По умолчанию Все переменные shared общие, кроме: Индексов параллельных циклов Переменных, объявленных внутри параллельных регионов

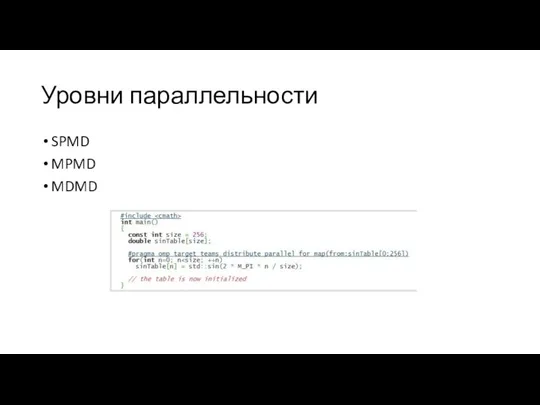

- 14. Уровни параллельности SPMD MPMD MDMD

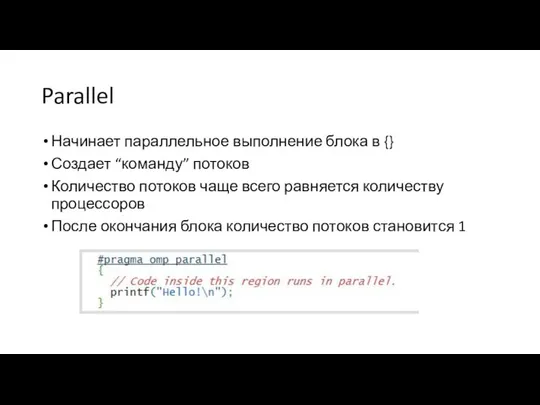

- 15. Parallel Начинает параллельное выполнение блока в {} Создает “команду” потоков Количество потоков чаще всего равняется количеству

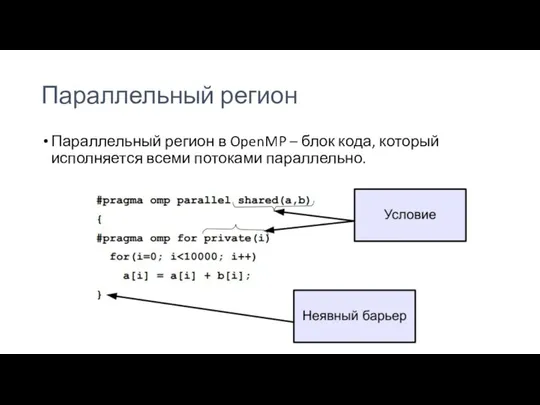

- 16. Параллельный регион Параллельный регион в OpenMP – блок кода, который исполняется всеми потоками параллельно.

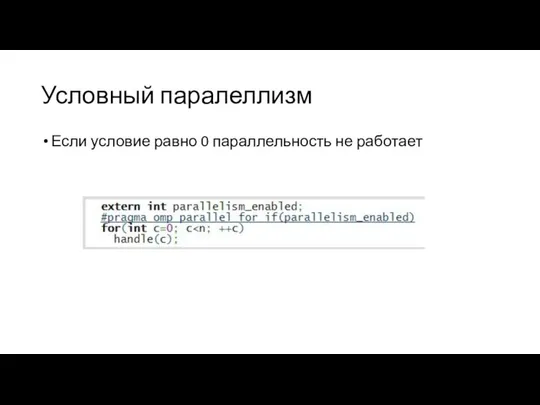

- 17. Условный паралеллизм Если условие равно 0 параллельность не работает

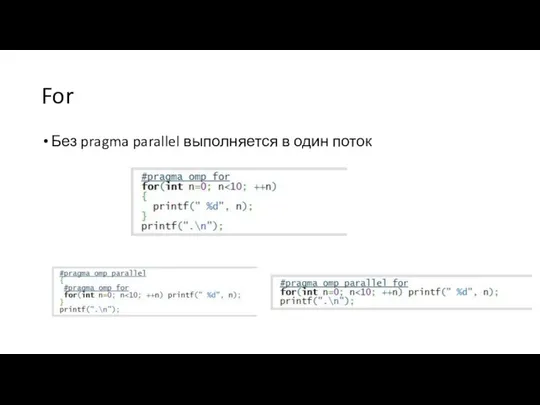

- 18. For Без pragma parallel выполняется в один поток

- 19. Parallel for С pragma parallel выполняется в текущей «команде» потоков

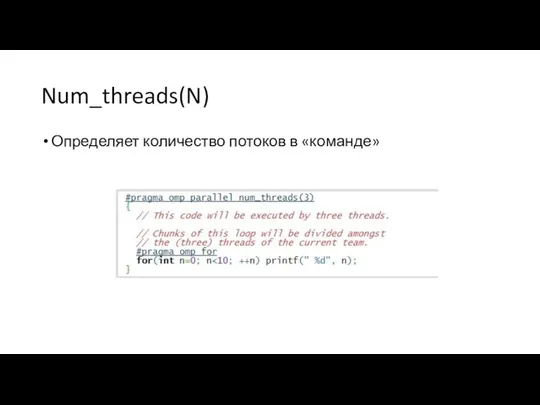

- 20. Num_threads(N) Определяет количество потоков в «команде»

- 21. Циклы, которые нельзя распараллелить Рекурсивные зависимости for (int i = 1; i a[i] = a[i-1] +

- 22. Зависимости Решение зависимостей: перегруппировка кода переписывание алгоритмов расстановка барьеров Если зависимости есть, но мы с ними

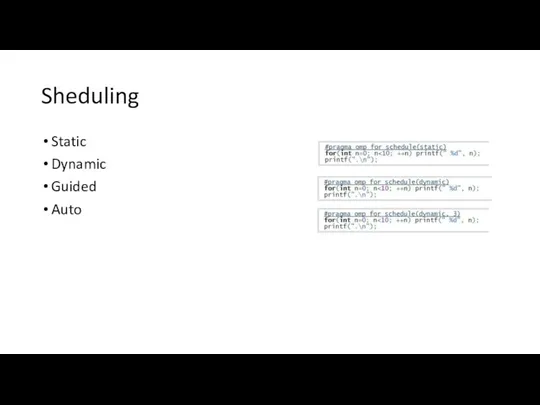

- 23. Sheduling Static Dynamic Guided Auto

- 24. Ordered Код внутри ordered выполняется в установленном циклом последовательности

- 25. collapse Используется для вложенных циклов

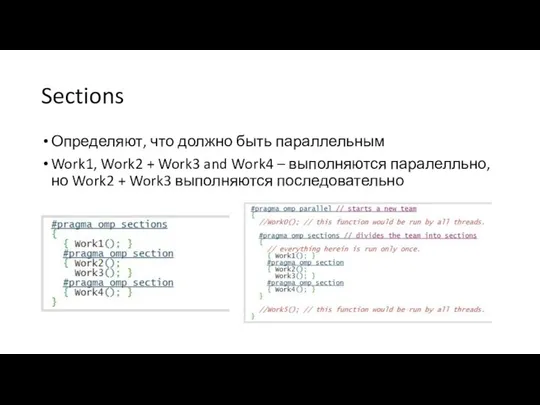

- 26. Sections Определяют, что должно быть параллельным Work1, Work2 + Work3 and Work4 – выполняются паралелльно, но

- 27. Atomic Определяет атомарную операцию

- 28. critical Гарантирует выполнение участка кода только одним потоком

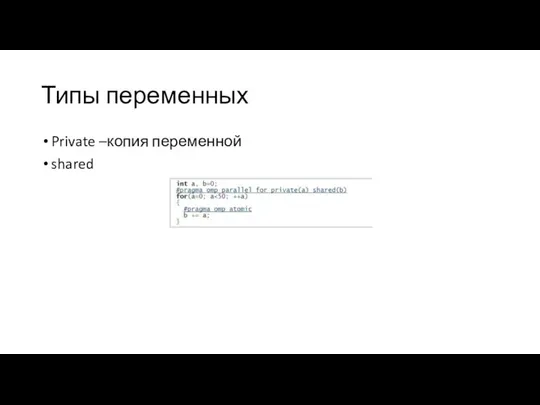

- 29. Типы переменных Private –копия переменной shared

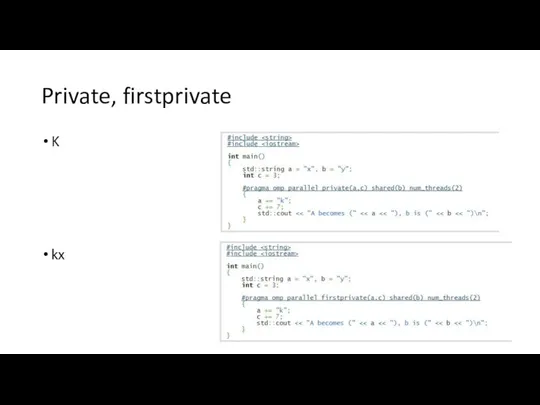

- 30. Private, firstprivate K kx

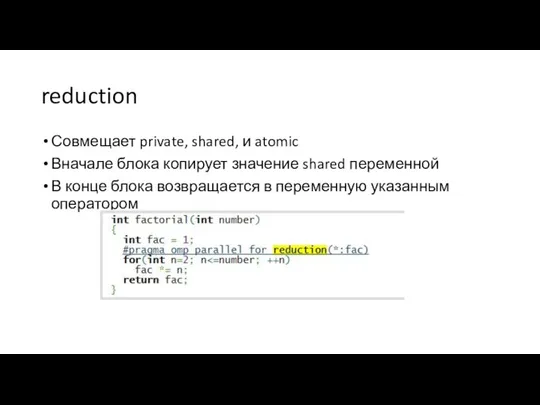

- 31. reduction Совмещает private, shared, и atomic Вначале блока копирует значение shared переменной В конце блока возвращается

- 33. Скачать презентацию

![Лучше один раз увидеть… double a[N], b[N], c[N]; int i; omp_set_dynamic(0);](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/1366353/slide-7.jpg)

![Формат директив #pragma omp [directive] [clause [clause] …] [directive] – название](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/1366353/slide-8.jpg)

Международные отношения Франции

Международные отношения Франции Анализ рядов динамики

Анализ рядов динамики  Презентация Письменность древнего Египта

Презентация Письменность древнего Египта Культура Древнего Египта

Культура Древнего Египта Эпигенитические процессы окислительного ряда

Эпигенитические процессы окислительного ряда Ремонт выхлопной системы Ваз-2170. (Часть 1)

Ремонт выхлопной системы Ваз-2170. (Часть 1) Этноцентризм

Этноцентризм Презентация "Страны в мировой экономике. Часть 1" - скачать презентации по Экономике

Презентация "Страны в мировой экономике. Часть 1" - скачать презентации по Экономике Использование принципов ООП в программной инженерии

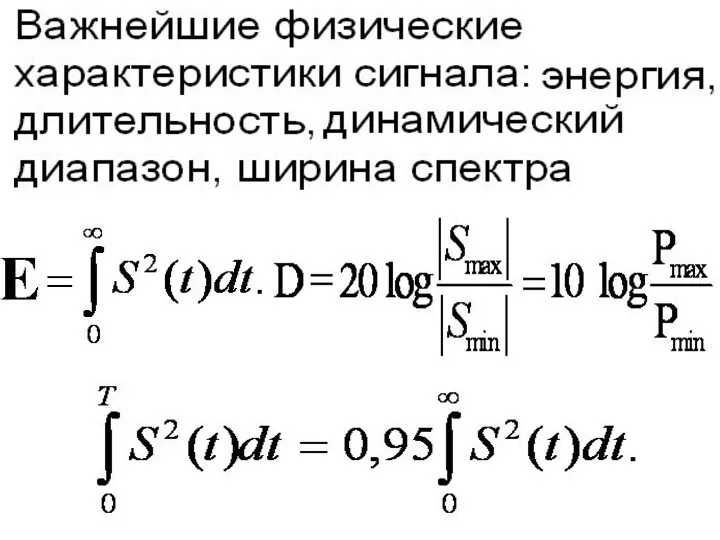

Использование принципов ООП в программной инженерии Физические характеристики сигнала

Физические характеристики сигнала Проектирование программных систем

Проектирование программных систем Центр Делового Развития 3С

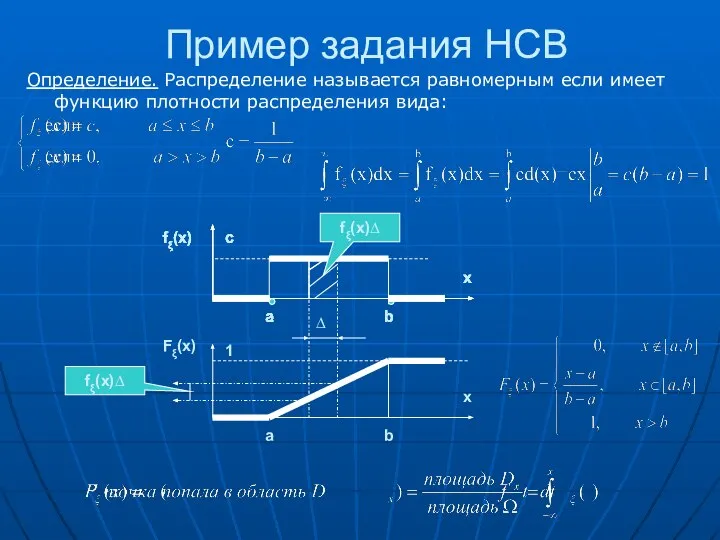

Центр Делового Развития 3С  Пример задания НСВ исправленный

Пример задания НСВ исправленный  Золотая Хохлома Проект выполнила учитель начальных классов МОУ СОШ №1 села Александров Гай Федюнина Ольга Николаев

Золотая Хохлома Проект выполнила учитель начальных классов МОУ СОШ №1 села Александров Гай Федюнина Ольга Николаев Прадмоўна-пасляслоўны комплекс у беларускіх кірылічных выданнях канца XVI- першай паловы XVII стагоддзяў Кандыдацкая работа

Прадмоўна-пасляслоўны комплекс у беларускіх кірылічных выданнях канца XVI- першай паловы XVII стагоддзяў Кандыдацкая работа  ИНФОРМАЦИОННЫЕ ХАРАКТЕРИСТИКИ КАНАЛОВ ЭЛЕКТРОСВЯЗИ

ИНФОРМАЦИОННЫЕ ХАРАКТЕРИСТИКИ КАНАЛОВ ЭЛЕКТРОСВЯЗИ  «Новые стандарты в образовании – веление времени». Если раньше главной целью образования являлась передача суммы предметных зна

«Новые стандарты в образовании – веление времени». Если раньше главной целью образования являлась передача суммы предметных зна Россия как полюс глобального мира

Россия как полюс глобального мира Рисуем животных - презентация для начальной школы_

Рисуем животных - презентация для начальной школы_ Зачетная работа по риторике. Как интернет влияет на учебу и жизнь человека.

Зачетная работа по риторике. Как интернет влияет на учебу и жизнь человека. Электрооборудование токарных сtahкob

Электрооборудование токарных сtahкob Учимся работать по новым стандартам!

Учимся работать по новым стандартам! Научно-технические методы стандартизации. (Лекция 8)

Научно-технические методы стандартизации. (Лекция 8) Техника культурного ассимилятора

Техника культурного ассимилятора Система охлаждения двигателя

Система охлаждения двигателя Чем отличается культурный человек от некультурного

Чем отличается культурный человек от некультурного Основы квантовой химии

Основы квантовой химии Sporda teknik taktik öğretim ilkeleri

Sporda teknik taktik öğretim ilkeleri