Содержание

- 2. До сих пор нас в выборках интересовала только одна зависимая переменная*. Мы изучали, отличается ли распределение

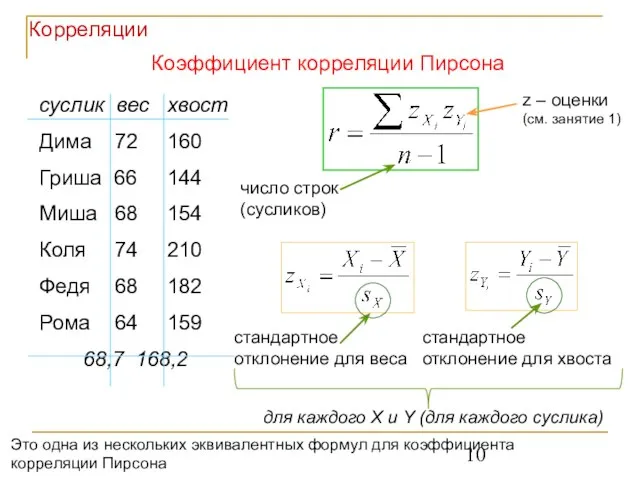

- 3. Мы исследуем сусликов. И хотим узнать, связаны ли между собой у них масса и длина хвоста?

- 4. КОЭФФИЦИЕНТ КОРРЕЛЯЦИИ характеризует силу связи между переменными. ЭТО ПРОСТО ПАРАМЕТР ОПИСАТЕЛЬНОЙ СТАТИСТИКИ Большой коэффициент корреляции между

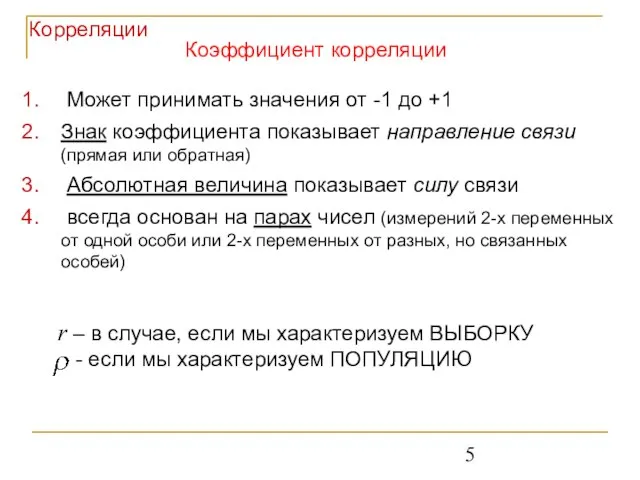

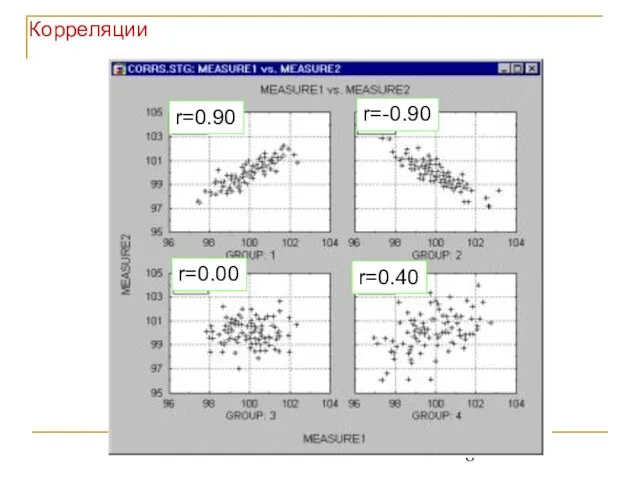

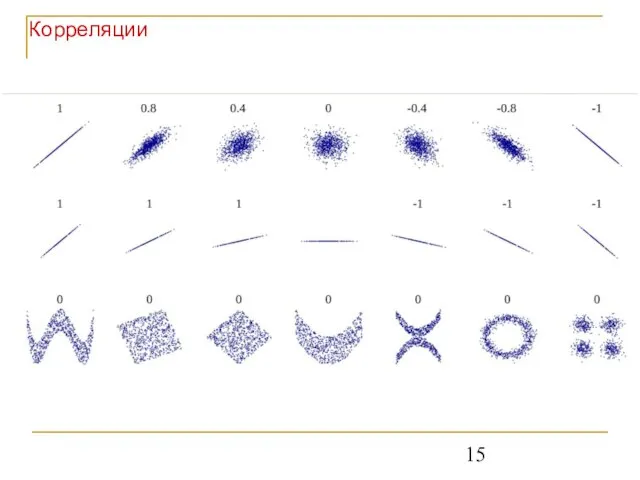

- 5. Коэффициент корреляции Может принимать значения от -1 до +1 Знак коэффициента показывает направление связи (прямая или

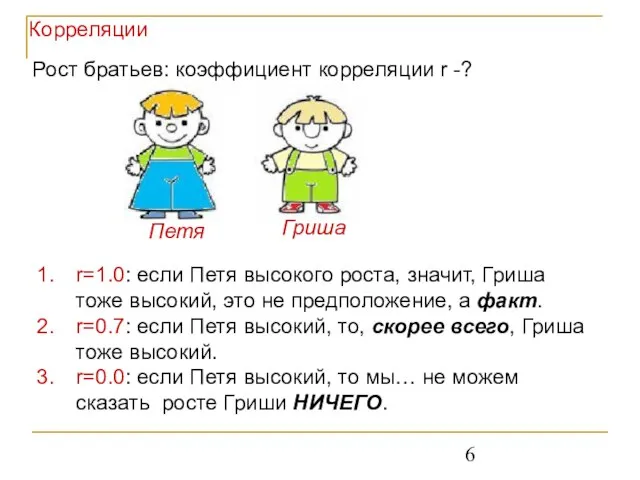

- 6. r=1.0: если Петя высокого роста, значит, Гриша тоже высокий, это не предположение, а факт. r=0.7: если

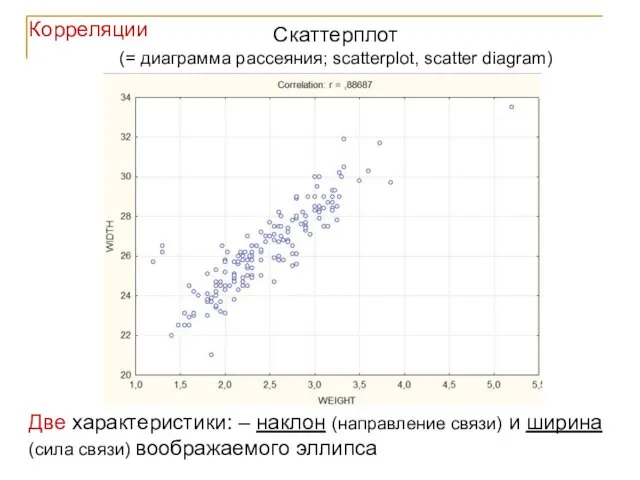

- 7. Корреляции Скаттерплот (= диаграмма рассеяния; scatterplot, scatter diagram) Две характеристики: – наклон (направление связи) и ширина

- 8. Корреляции

- 9. Коэффициент корреляции Пирсона (Pearson product-moment correlation coefficient r) Корреляции Karl Pearson (1857 –1936 )

- 10. стандартное отклонение для хвоста стандартное отклонение для веса Коэффициент корреляции Пирсона для каждого X и Y

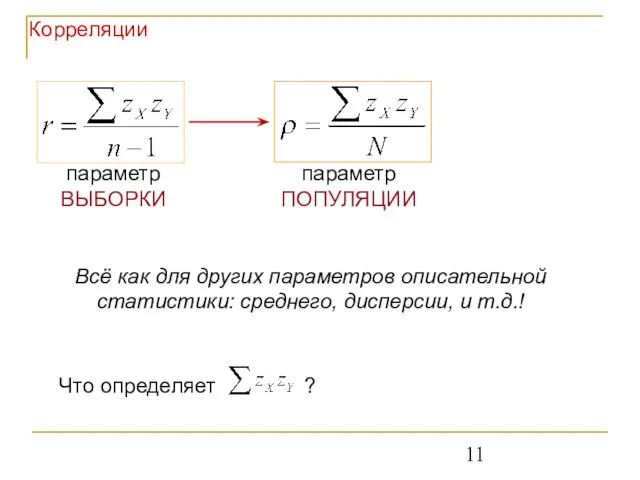

- 11. параметр ВЫБОРКИ параметр ПОПУЛЯЦИИ Всё как для других параметров описательной статистики: среднего, дисперсии, и т.д.! Корреляции

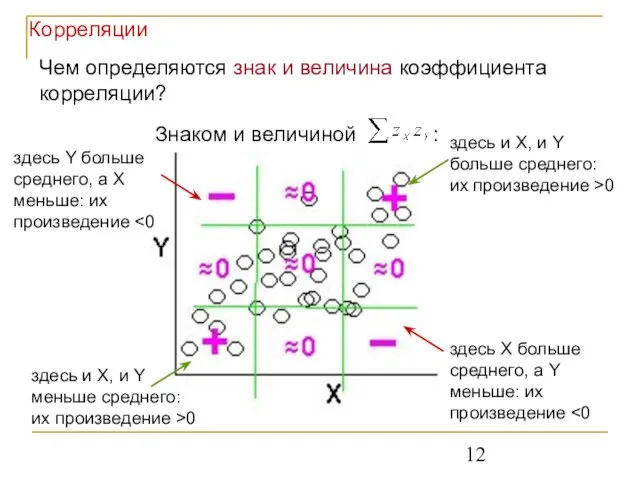

- 12. Чем определяются знак и величина коэффициента корреляции? здесь и X, и Y больше среднего: их произведение

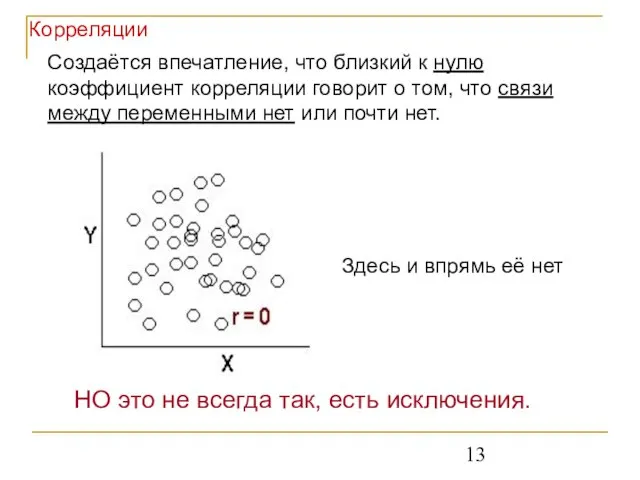

- 13. Создаётся впечатление, что близкий к нулю коэффициент корреляции говорит о том, что связи между переменными нет

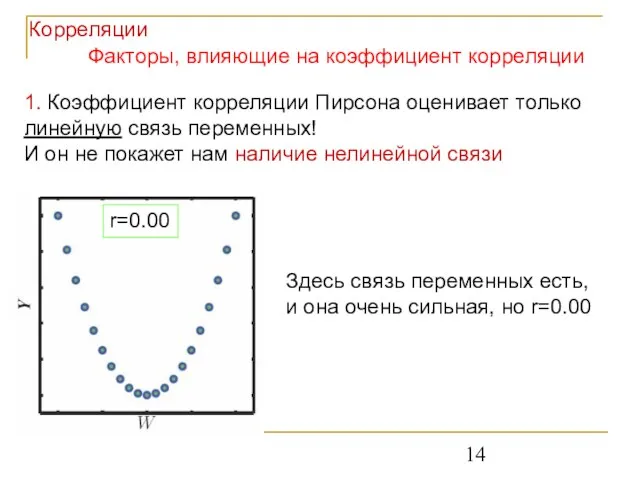

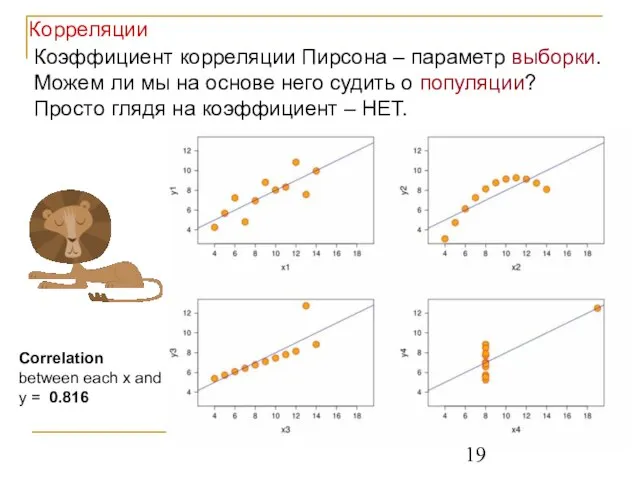

- 14. 1. Коэффициент корреляции Пирсона оценивает только линейную связь переменных! И он не покажет нам наличие нелинейной

- 15. Корреляции

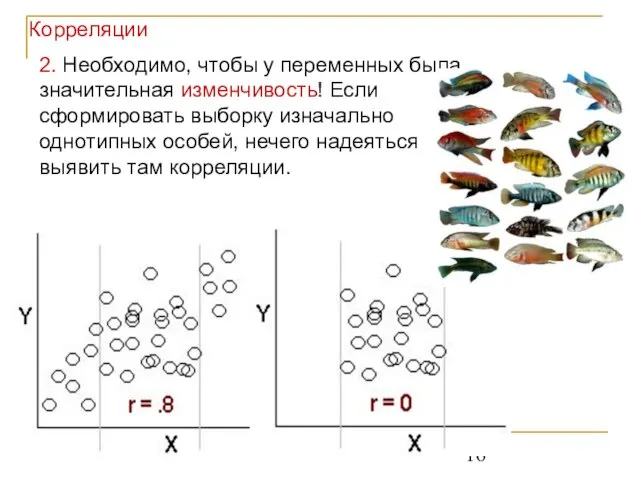

- 16. 2. Необходимо, чтобы у переменных была значительная изменчивость! Если сформировать выборку изначально однотипных особей, нечего надеяться

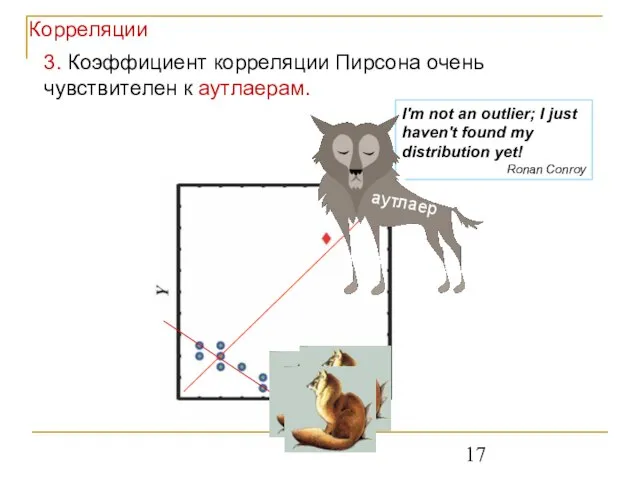

- 17. I'm not an outlier; I just haven't found my distribution yet! Ronan Conroy аутлаер 3. Коэффициент

- 18. Важное замечание: Корреляция совершенно не подразумевает наличие причинно-следственной связи! Она ВООБЩЕ НИЧЕГО о ней НЕ ГОВОРИТ

- 19. Коэффициент корреляции Пирсона – параметр выборки. Можем ли мы на основе него судить о популяции? Просто

- 20. Корреляции H0 : ρ=0 H1: ρ≠0 Связаны ли у сусликов масса тела и длина хвоста? (альтернативная

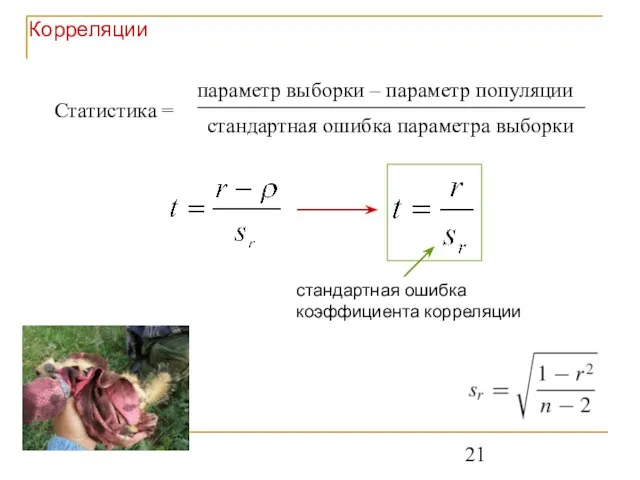

- 21. Корреляции стандартная ошибка коэффициента корреляции

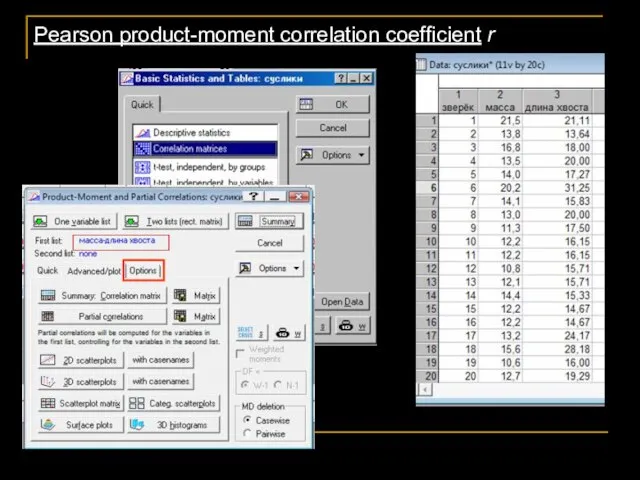

- 22. Pearson product-moment correlation coefficient r

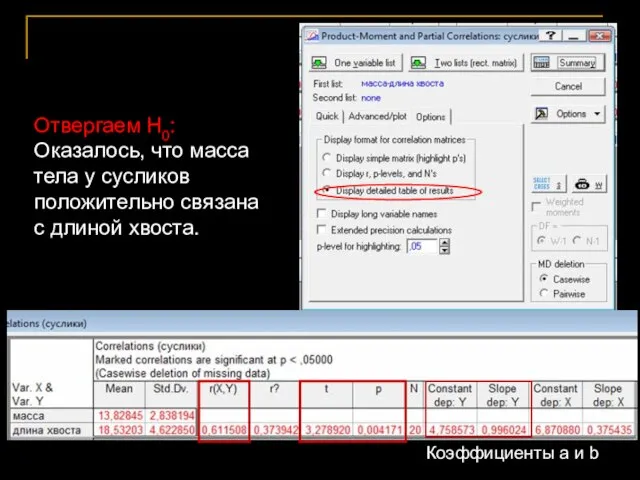

- 23. Отвергаем Н0: Оказалось, что масса тела у сусликов положительно связана с длиной хвоста. Коэффициенты a и

- 24. Бывают задачи, когда нам необходимо получить МАТРИЦУ КОРРЕЛЯЦИЙ (для многомерных методов анализа)

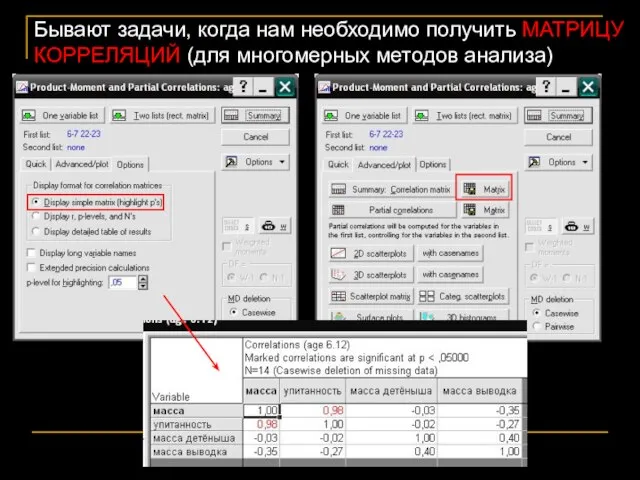

- 25. Можно сравнить два коэффициента корреляции от двух выборок Для двумерного нормального распределения

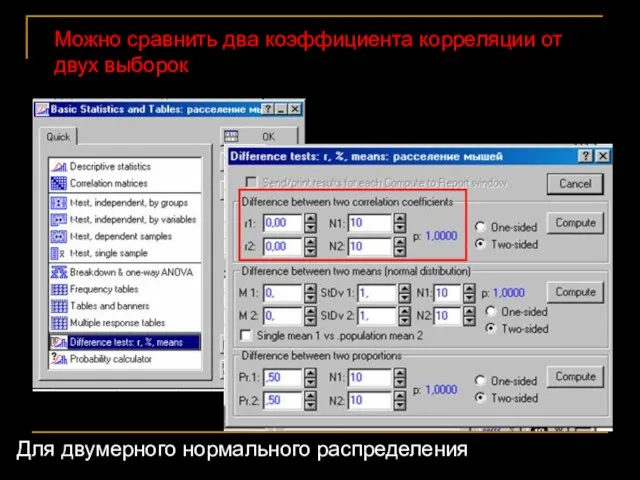

- 26. Корреляции В статьях обычно приводят сам коэффициент корреляции Пирсона (значение t не столь обязательно). Он сам

- 27. Требование к выборке для тестирования гипотезы о коэффициенте корреляции Пирсона: 1. Для каждого X значения Y

- 28. r=0.7: если Петя высокий, то, скорее всего, Гриша тоже высокий. Но можем ли мы предсказать, насколько

- 29. Регрессионный анализ – инструмент для количественного предсказания значения одной переменной на основании другой. Для этого в

- 30. То есть, РЕГРЕССИЯ (regression) – предсказание одной переменной на основании другой. Одна переменная – независимая (independent),

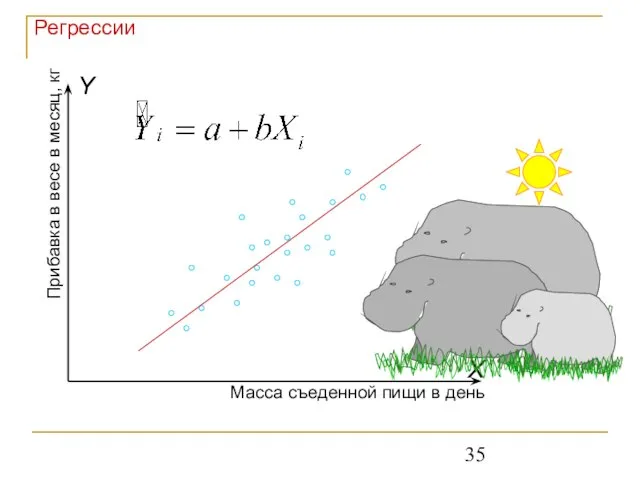

- 31. Мы изучаем поведение молодых бегемотов в Африке. Мы хотим узнать, как зависит прибавка в весе за

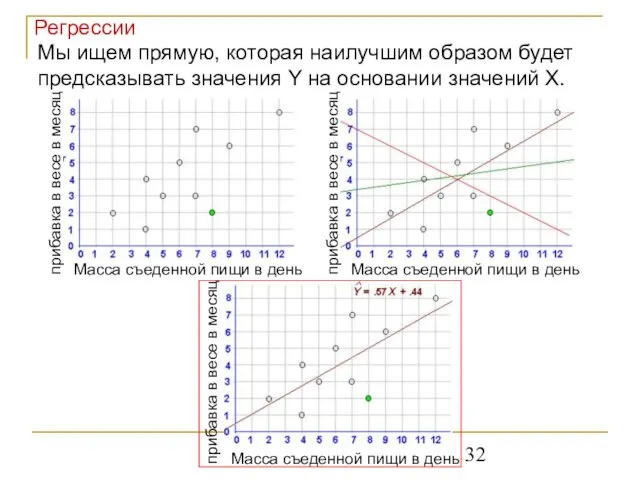

- 32. Мы ищем прямую, которая наилучшим образом будет предсказывать значения Y на основании значений Х. прибавка в

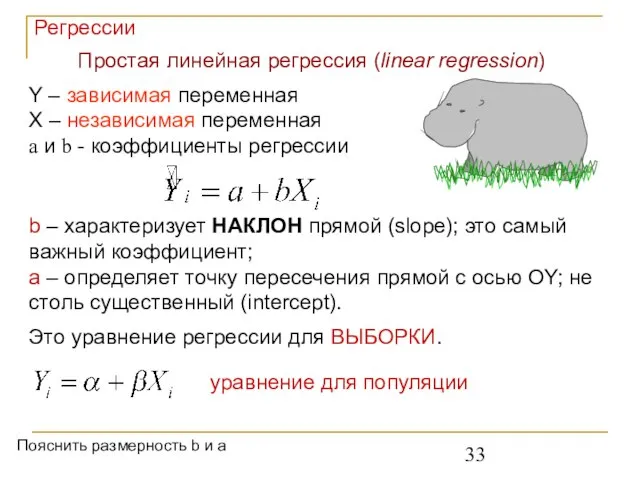

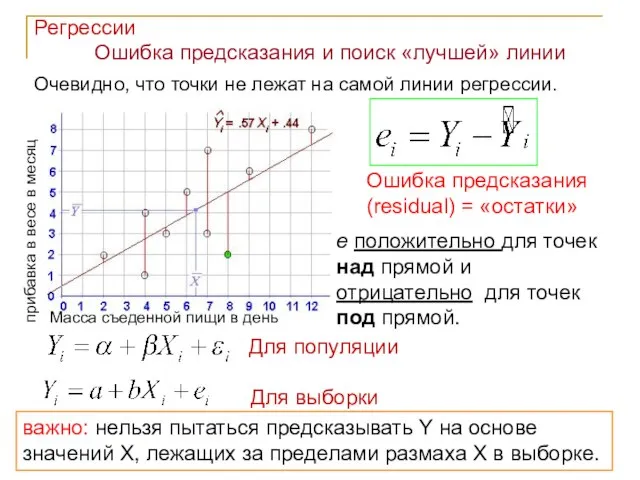

- 33. Простая линейная регрессия (linear regression) Y – зависимая переменная X – независимая переменная a и b

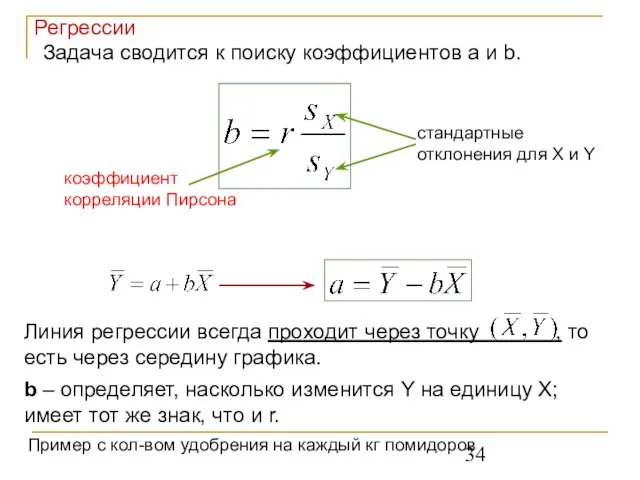

- 34. Задача сводится к поиску коэффициентов a и b. коэффициент корреляции Пирсона стандартные отклонения для X и

- 35. Прибавка в весе в месяц, кг X Y Регрессии Масса съеденной пищи в день

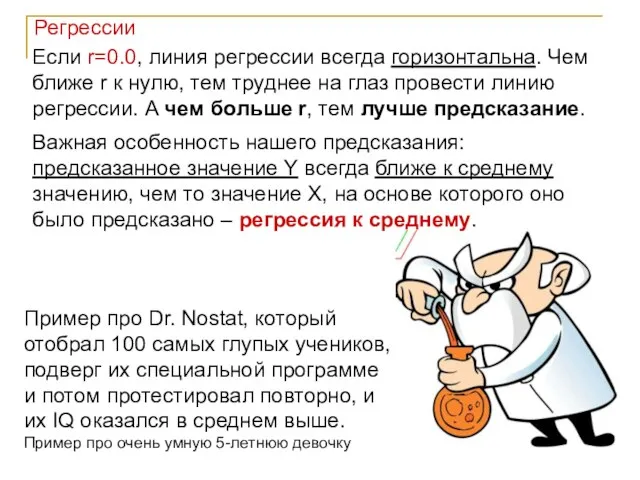

- 36. Если r=0.0, линия регрессии всегда горизонтальна. Чем ближе r к нулю, тем труднее на глаз провести

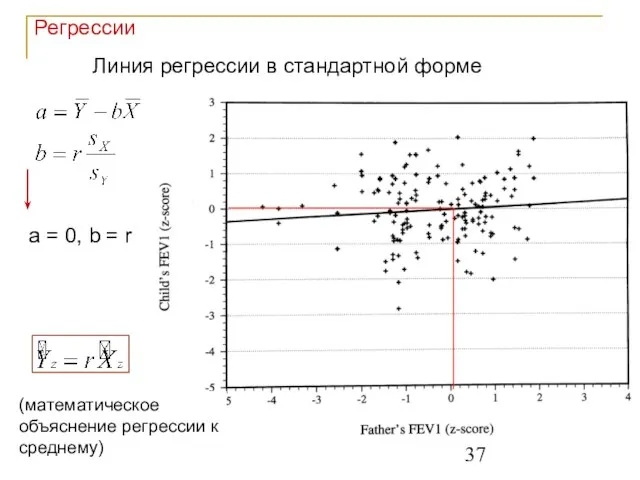

- 37. Регрессии Линия регрессии в стандартной форме a = 0, b = r (математическое объяснение регрессии к

- 38. Ошибка предсказания (residual) = «остатки» e положительно для точек над прямой и отрицательно для точек под

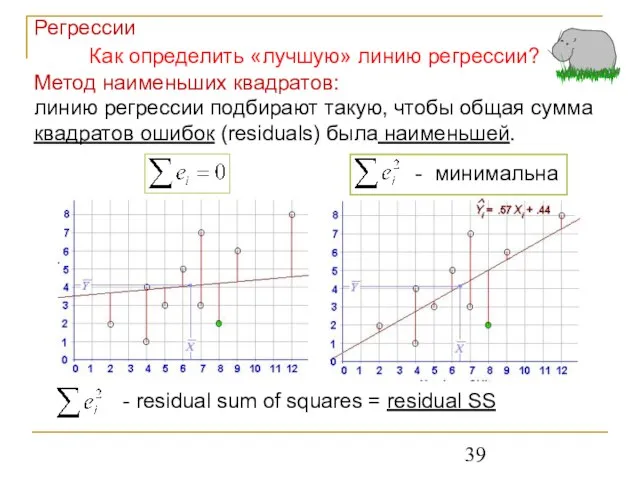

- 39. Метод наименьших квадратов: линию регрессии подбирают такую, чтобы общая сумма квадратов ошибок (residuals) была наименьшей. -

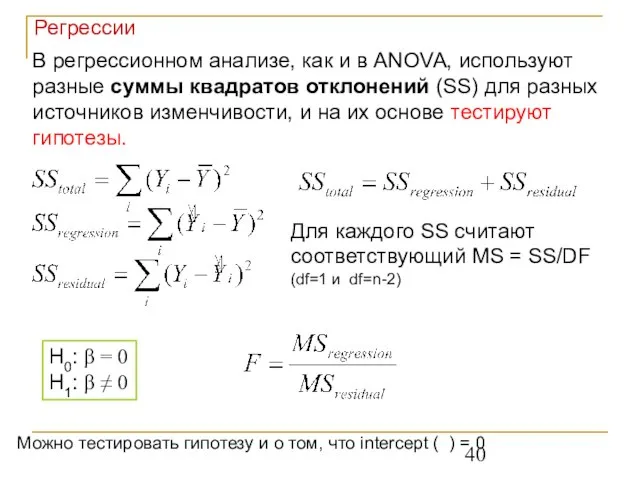

- 40. Регрессии В регрессионном анализе, как и в ANOVA, используют разные суммы квадратов отклонений (SS) для разных

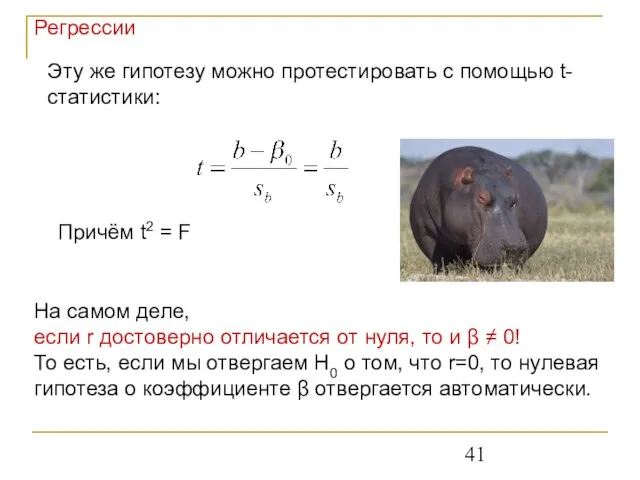

- 41. Регрессии На самом деле, если r достоверно отличается от нуля, то и β ≠ 0! То

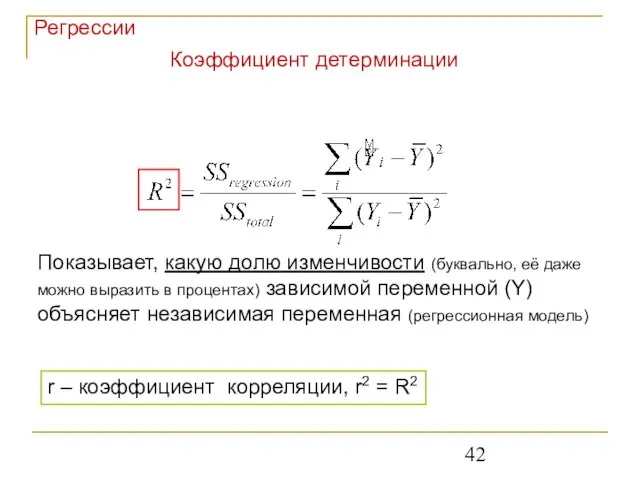

- 42. Регрессии Коэффициент детерминации r – коэффициент корреляции, r2 = R2 Показывает, какую долю изменчивости (буквально, её

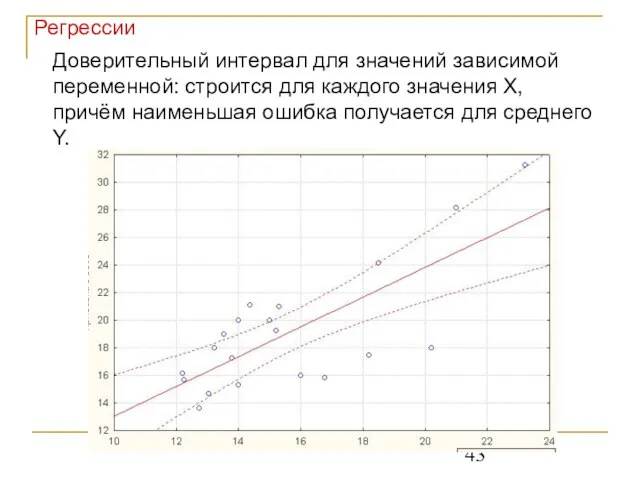

- 43. Регрессии Доверительный интервал для значений зависимой переменной: строится для каждого значения X, причём наименьшая ошибка получается

- 44. Регрессии Сравнение двух (и более) уравнений линейной регрессии Сравнение коэффициентов наклона b1 b2 Сравнение коэффициентов сдвига

- 45. Регрессии Множественная линейная регрессия и корреляция (multiple regression) Простая линейная регрессия: одна зависимая переменная и одна

- 46. Регрессии Например, мы хотим узнать, как на прибавку в весе у бегемотов (1 зависимая переменная) влияют:

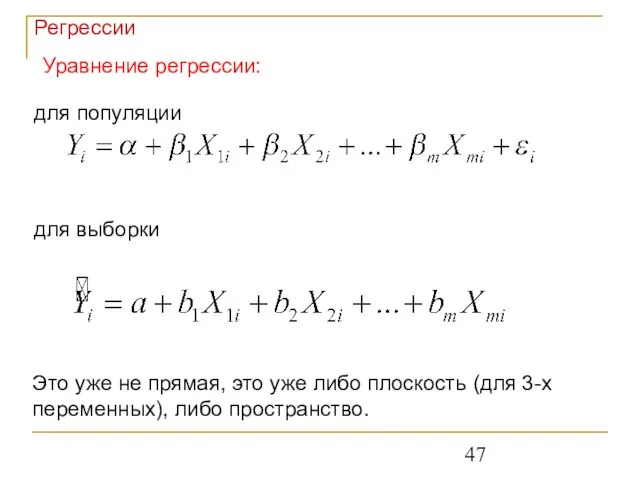

- 47. Регрессии Уравнение регрессии: для популяции для выборки Это уже не прямая, это уже либо плоскость (для

- 48. Регрессии Тестирование гипотез для множественной регрессии: Если для простой регрессии можно было проверить только гипотезу относительно

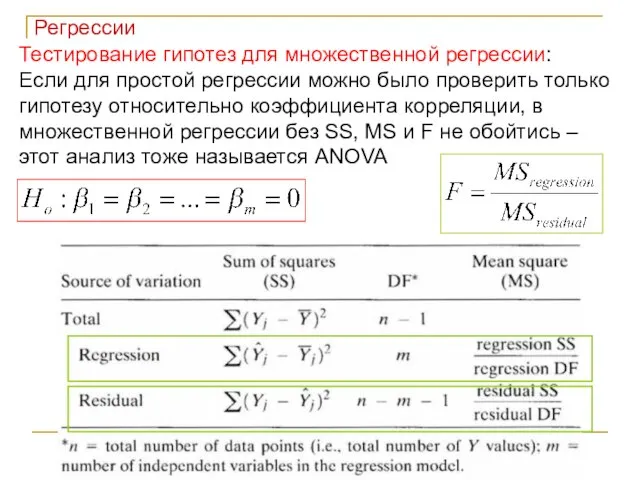

- 49. Регрессии Коэффициент детерминации (coefficient of determination) Считается потому же принципу, что и для простой регрессии, и

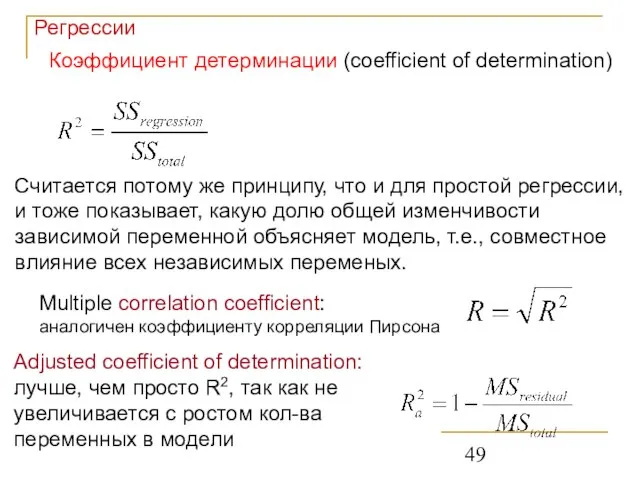

- 50. Регрессии Добавление переменных в модель: SSregression увеличивается, поэтому R2 растёт. При этом F может уменьшаться. Для

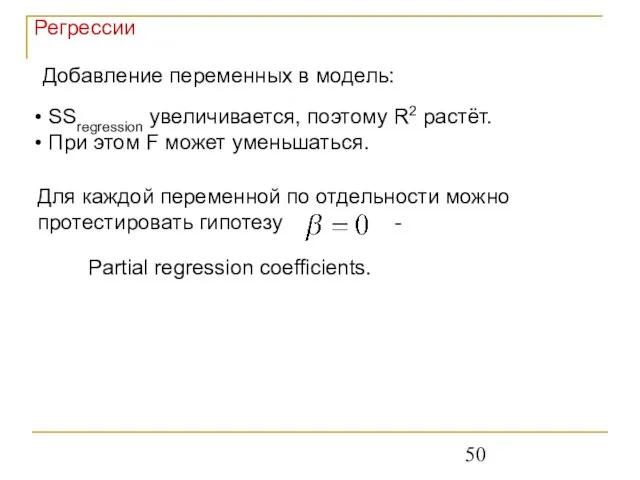

- 51. Регрессии Multicollinearity = ill-conditioning У нас много переменных, поэтому расчёт коэффициентов и статистик сопряжён с операциями

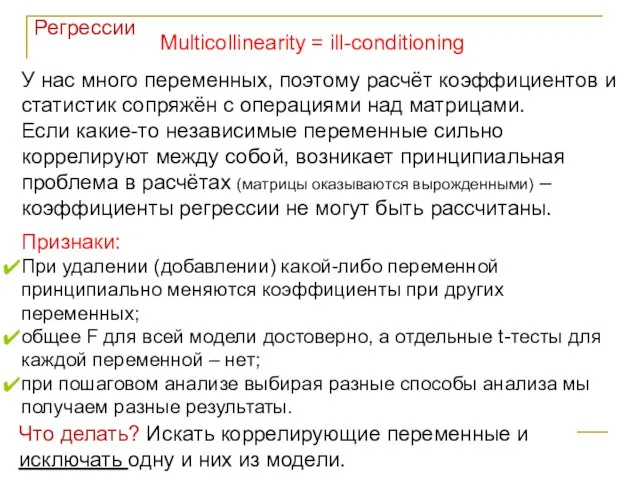

- 52. Регрессии Выбор «лучших» независимых переменных Как выбрать лучшую модель, чтобы наименьшим числом независимых переменных описать набольшую

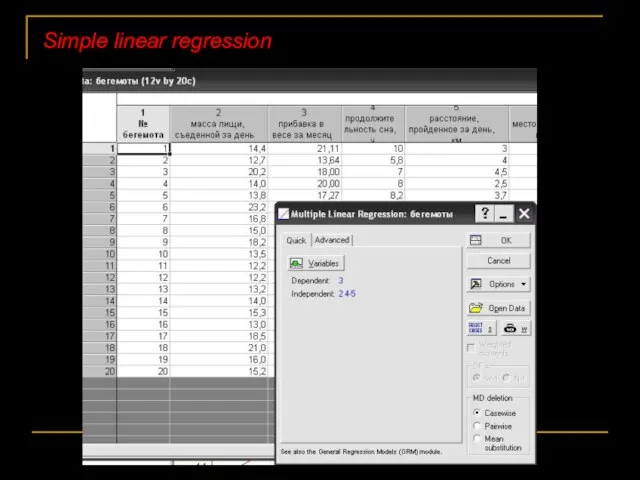

- 53. Simple linear regression

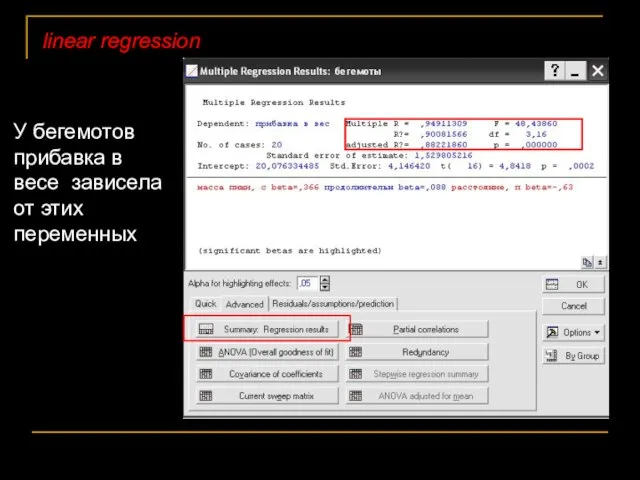

- 54. linear regression У бегемотов прибавка в весе зависела от этих переменных

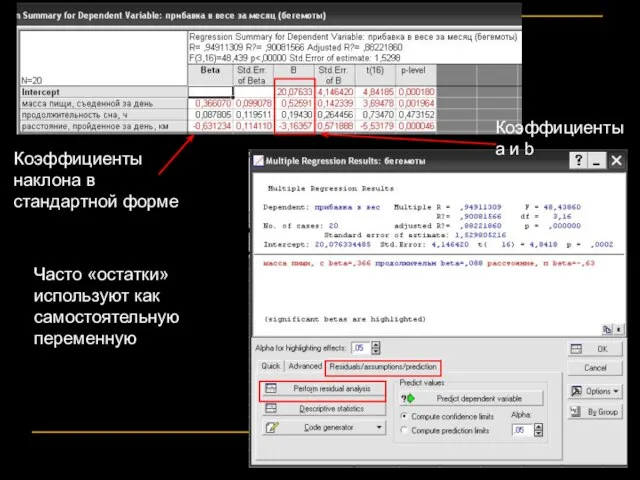

- 55. Коэффициенты наклона в стандартной форме Часто «остатки» используют как самостоятельную переменную Коэффициенты a и b

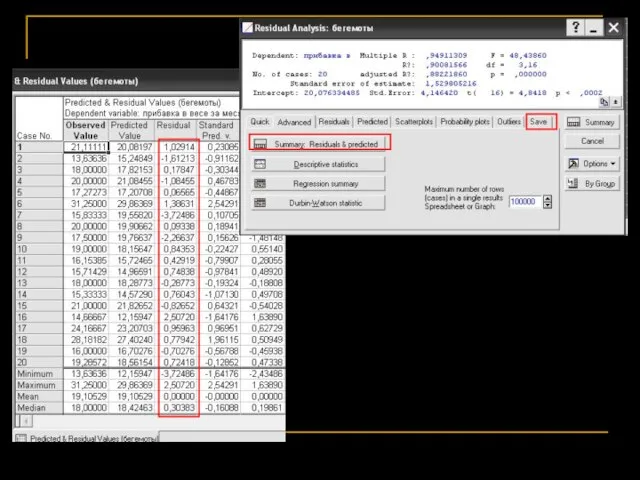

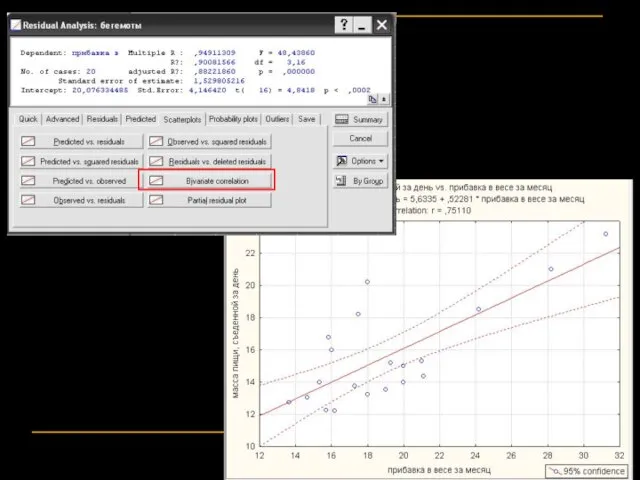

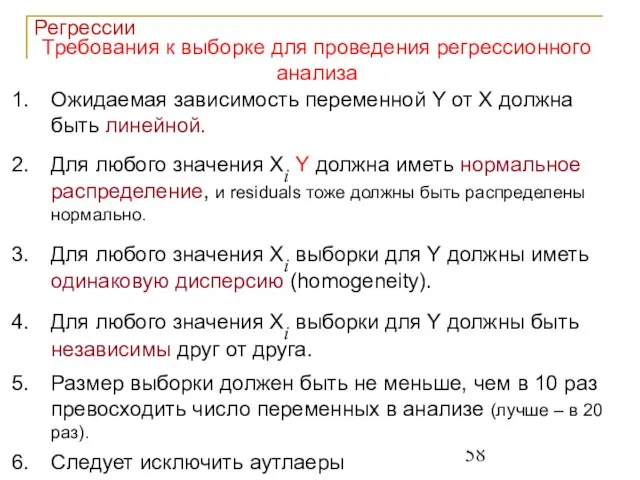

- 58. Требования к выборке для проведения регрессионного анализа Ожидаемая зависимость переменной Y от X должна быть линейной.

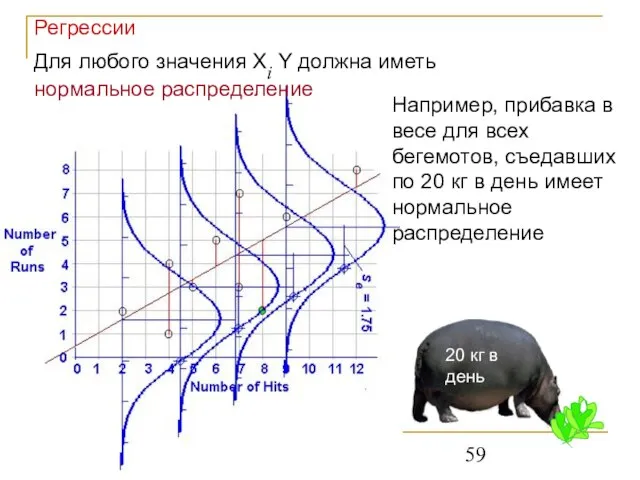

- 59. Для любого значения Xi Y должна иметь нормальное распределение Например, прибавка в весе для всех бегемотов,

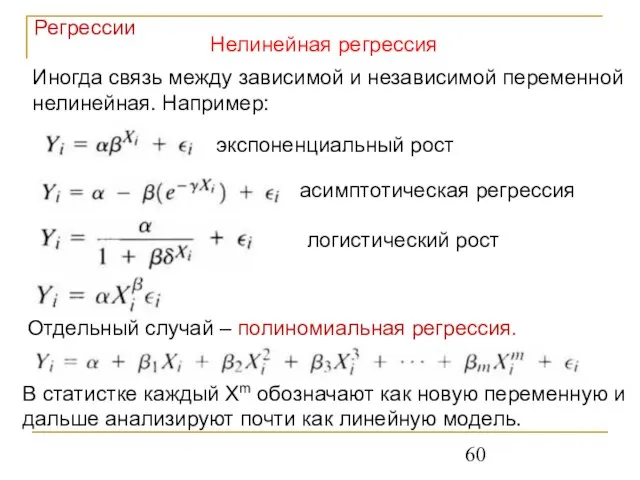

- 60. Нелинейная регрессия Регрессии экспоненциальный рост Иногда связь между зависимой и независимой переменной нелинейная. Например: асимптотическая регрессия

- 61. В случае, если наши переменные связаны друг с другом принципиально не линейной зависимостью: можно трансформировать данные

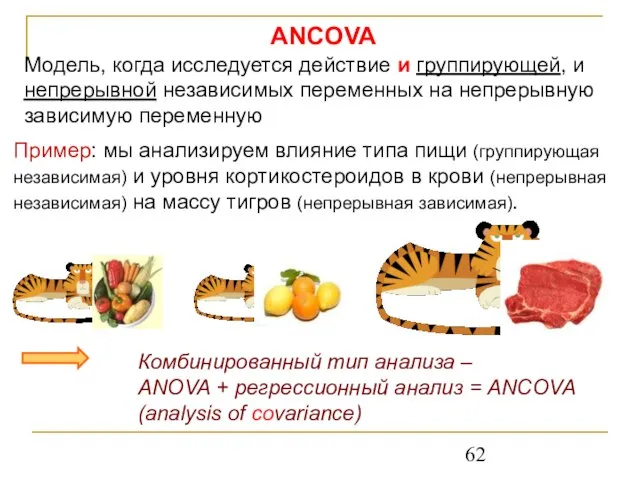

- 62. ANCOVA Модель, когда исследуется действие и группирующей, и непрерывной независимых переменных на непрерывную зависимую переменную Пример:

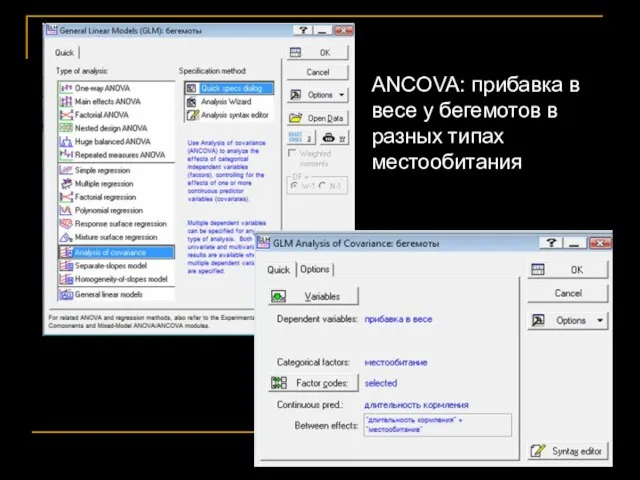

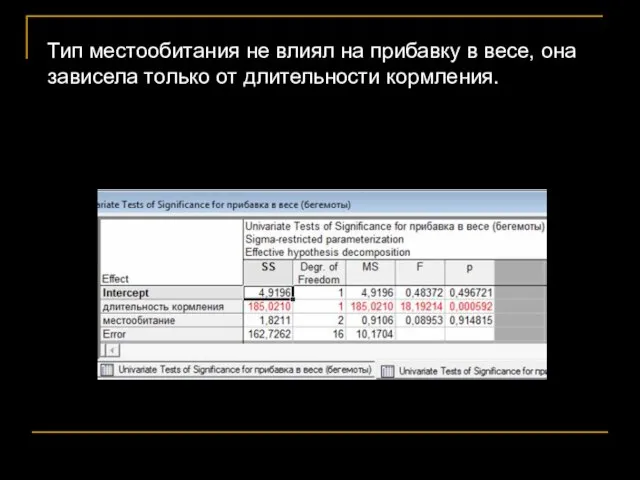

- 63. ANCOVA: прибавка в весе у бегемотов в разных типах местообитания

- 64. Тип местообитания не влиял на прибавку в весе, она зависела только от длительности кормления.

- 65. Выбор модели в GLM «Много» = 2 и больше

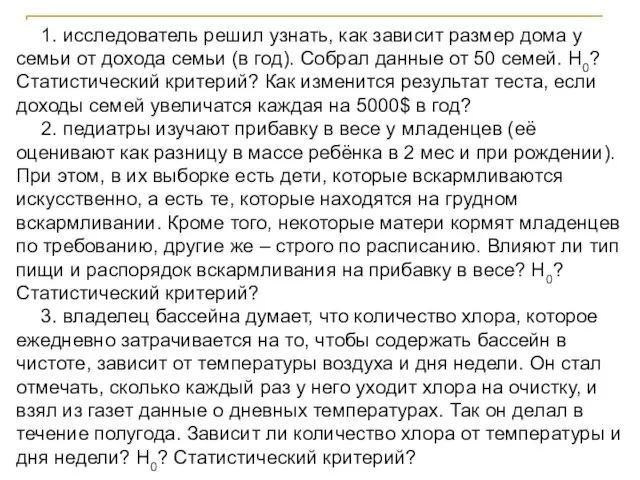

- 66. 1. исследователь решил узнать, как зависит размер дома у семьи от дохода семьи (в год). Собрал

- 68. Скачать презентацию

Круг. Окружность. Длина окружности. Площадь круга

Круг. Окружность. Длина окружности. Площадь круга Оси симметрии

Оси симметрии Отражение истории развития алгебры в современных учебниках

Отражение истории развития алгебры в современных учебниках Умножение одночлена на многочлен

Умножение одночлена на многочлен Тригонометрия Автор: учитель математики Комлякова Ксения Геннадьевна ГБОУ Гимназия №105, г. Санкт-Петербург

Тригонометрия Автор: учитель математики Комлякова Ксения Геннадьевна ГБОУ Гимназия №105, г. Санкт-Петербург Обучающие игры. Страна геометрия

Обучающие игры. Страна геометрия Делители чисел. Дидактическая игра по математике

Делители чисел. Дидактическая игра по математике Равнобедренный треугольник

Равнобедренный треугольник «Счастливый случай». Урок-игра. 6 класс

«Счастливый случай». Урок-игра. 6 класс Cálculo numérico. Resolução de equações diferenciais ordinárias de 1a ordem. (Aula 9)

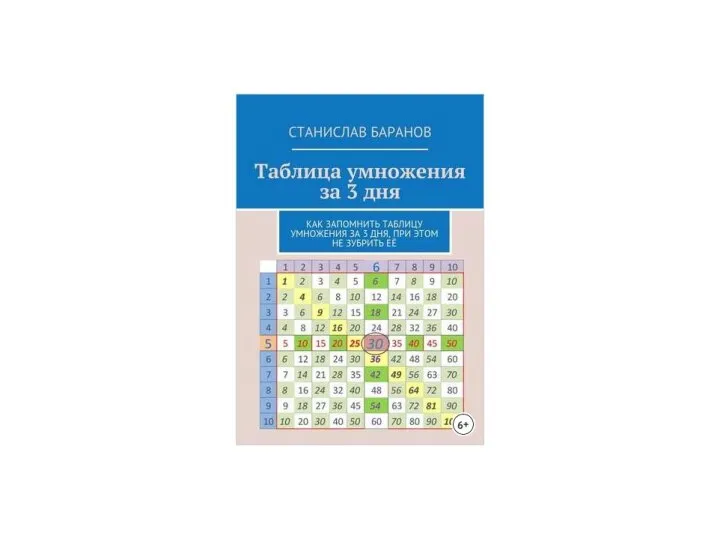

Cálculo numérico. Resolução de equações diferenciais ordinárias de 1a ordem. (Aula 9) Таблица умножения за 3 дня

Таблица умножения за 3 дня Математическое моделирование. Линейное программирование

Математическое моделирование. Линейное программирование Пропорция. 6 класс

Пропорция. 6 класс Элективный курс по математике для учащихся 9 классов

Элективный курс по математике для учащихся 9 классов Логические вопросы по теме «Натуральные числа»

Логические вопросы по теме «Натуральные числа»  Одночлены и многочлены

Одночлены и многочлены Игра на уроке математики (5 класс)

Игра на уроке математики (5 класс) Тема: Порядок выполнения действий в выражениях без скобок. Цель: совершенствование знаний выполнения действий в выражениях без

Тема: Порядок выполнения действий в выражениях без скобок. Цель: совершенствование знаний выполнения действий в выражениях без  Методы непараметрического спектрального анализа. Метод Блэкмана-Тьюки

Методы непараметрического спектрального анализа. Метод Блэкмана-Тьюки Методы решения уравнений

Методы решения уравнений Одномерная оптимизация. Методы оптимизации

Одномерная оптимизация. Методы оптимизации Треугольник

Треугольник Углы. Виды углов

Углы. Виды углов Изменение величин. (6 класс)

Изменение величин. (6 класс) Задачі з частинами і дробами

Задачі з частинами і дробами Сложение и вычитание обыкновенных дробей с одинаковыми знаменателями

Сложение и вычитание обыкновенных дробей с одинаковыми знаменателями Преобразование числовых выражений, содержащих корень n-ой степени

Преобразование числовых выражений, содержащих корень n-ой степени Модулярная арифметика

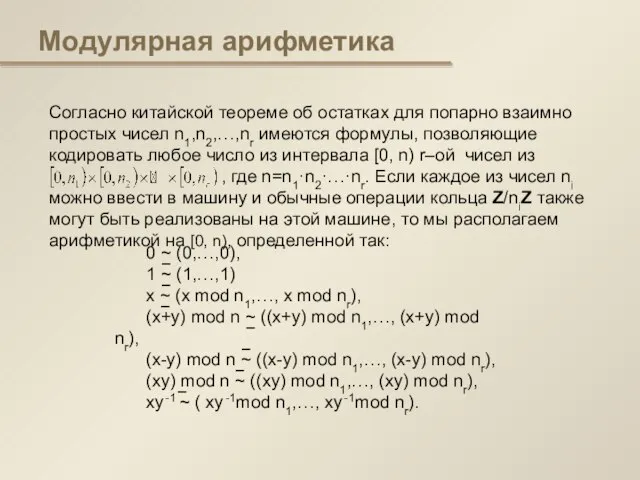

Модулярная арифметика