Содержание

- 2. М. В . Ломоносов: «Математику уже затем учить следует, что она ум в порядок приводит». Давид

- 3. Повесьте ваши уши на гвоздь внимания !!!!!!

- 4. Раздел 1. Теория вероятностей Введение. Теория вероятностей – это математическая наука, изучающая закономерности случайных событий. Математическая

- 5. Примеры неслучайных событий: рождение – смерть, прилив – отлив, восход и закат солнца. Становление теории вероятностей

- 6. § 1. Случайный эксперимент. Элементарные исходы случайного эксперимента. Случайное событие. Реализация случайного события возможна в ходе

- 7. Некоторые из случайных событий можно разбить на более простые события. Те события, которые нельзя разбить на

- 8. § 2. Классификация случайных событий Достоверное событие – это событие, которое обязательно произойдёт в данном случайном

- 9. §3. Действия над событиями (исчисление событий) Объединением двух событий AUB или суммой двух событий (A+B) называется

- 10. Обобщение: Пересечением нескольких событий называется новое событие, состоящее в одновременном наступлении всех этих событий. Рассмотрены свойства

- 11. § 4. Вероятность случайного события. Ведем численную меру возможности реализации случайного события. Примем Р(Ω)=1; Р(Ø)=0. Все

- 12. Б) Статистический: Применим тогда, когда эксперимент можно повторять многократно в неизменных условиях. Пусть выполнено большое число

- 13. § 5. Геометрическая вероятность. Геометрическая вероятность позволяет рассматривать случайные события с бесконечным числом равновозможных элементарных исходов.

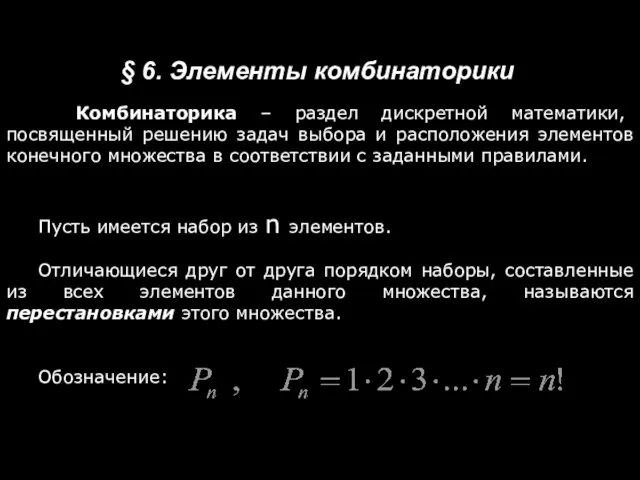

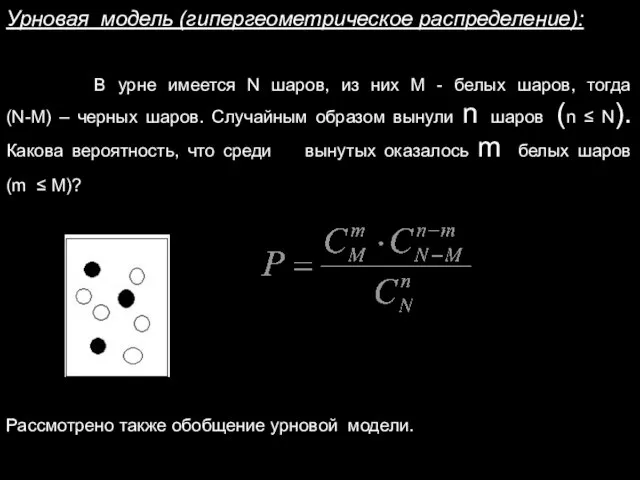

- 14. Комбинаторика – раздел дискретной математики, посвященный решению задач выбора и расположения элементов конечного множества в соответствии

- 15. Размещениями называются комбинации, состоящие из n различных элементов, содержащие k элементов, отличающиеся либо составом элементов, либо

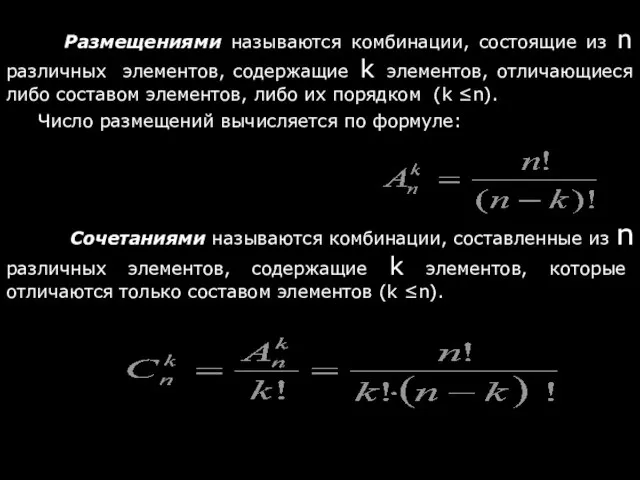

- 16. Урновая модель (гипергеометрическое распределение): В урне имеется N шаров, из них М - белых шаров, тогда

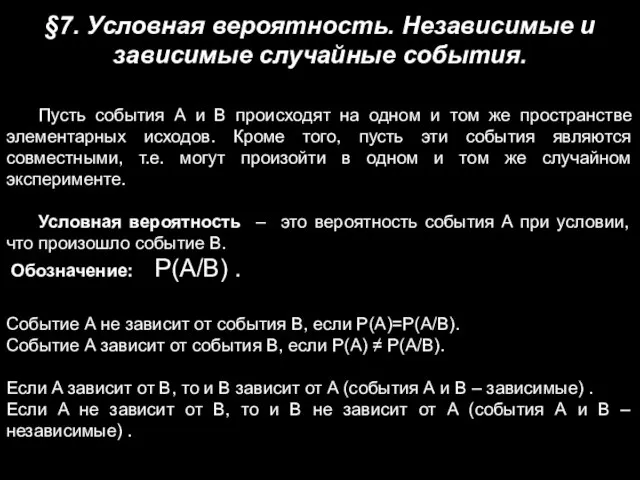

- 17. §7. Условная вероятность. Независимые и зависимые случайные события. Пусть события А и В происходят на одном

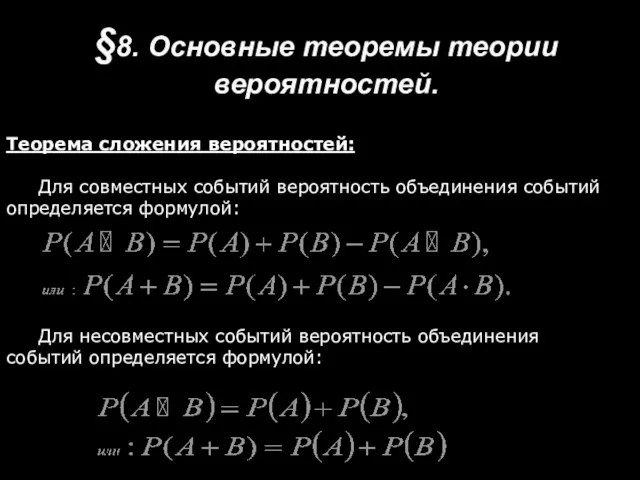

- 18. §8. Основные теоремы теории вероятностей. Теорема сложения вероятностей: Для совместных событий вероятность объединения событий определяется формулой:

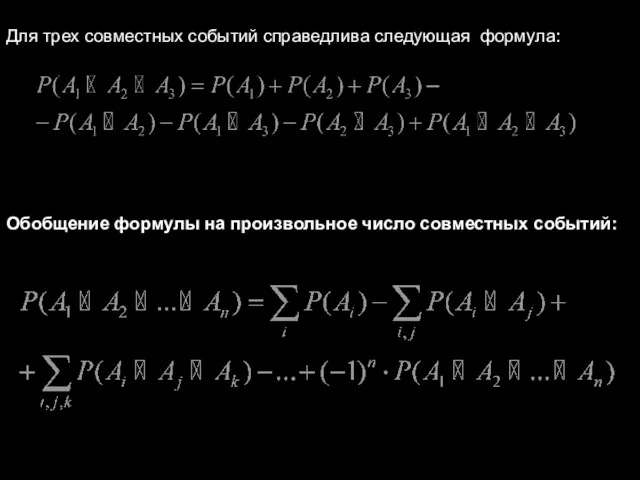

- 19. Для трех совместных событий справедлива следующая формула: Обобщение формулы на произвольное число совместных событий:

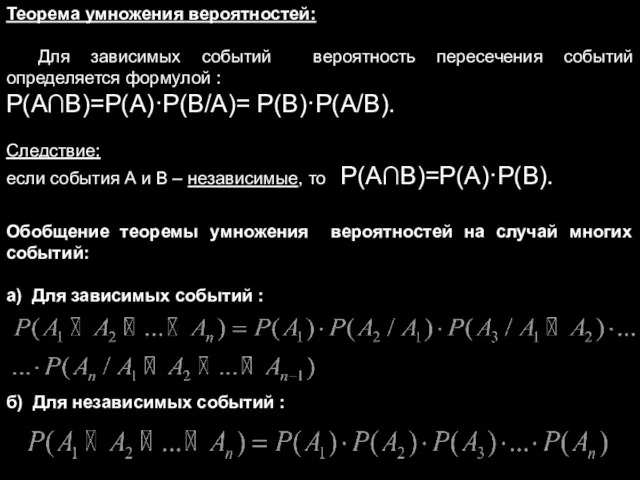

- 20. Теорема умножения вероятностей: Для зависимых событий вероятность пересечения событий определяется формулой : Р(А∩В)=Р(А)·Р(В/А)= Р(В)·Р(А/В). Следствие: если

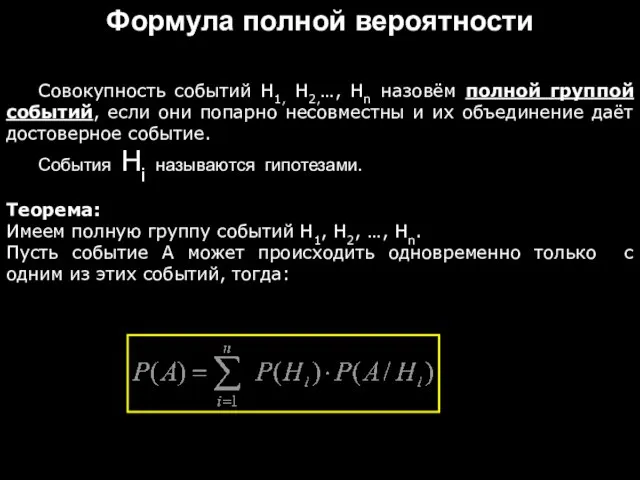

- 21. Формула полной вероятности Совокупность событий Н1, Н2,…, Нn назовём полной группой событий, если они попарно несовместны

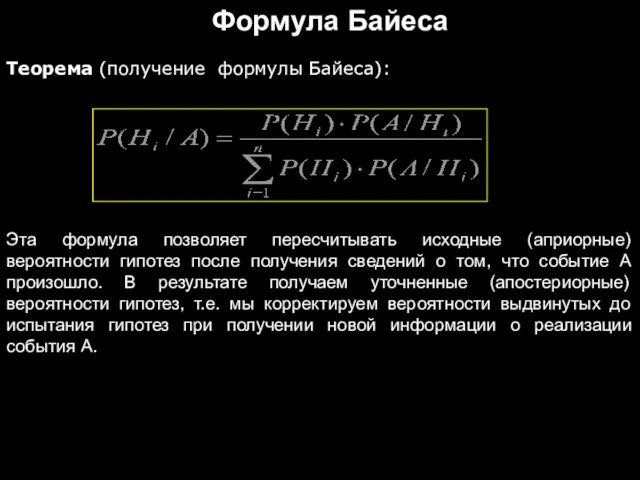

- 22. Формула Байеса Теорема (получение формулы Байеса): Эта формула позволяет пересчитывать исходные (априорные) вероятности гипотез после получения

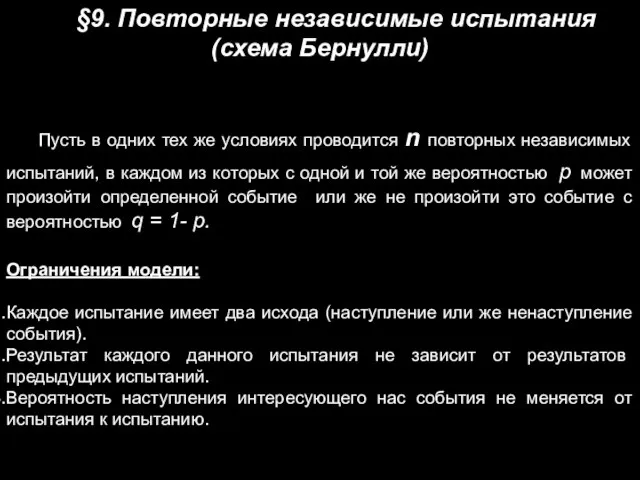

- 23. §9. Повторные независимые испытания (схема Бернулли) Пусть в одних тех же условиях проводится n повторных независимых

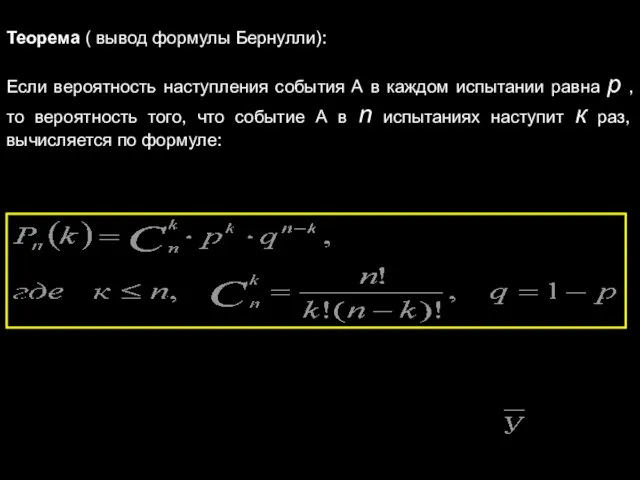

- 24. Теорема ( вывод формулы Бернулли): Если вероятность наступления события А в каждом испытании равна р ,

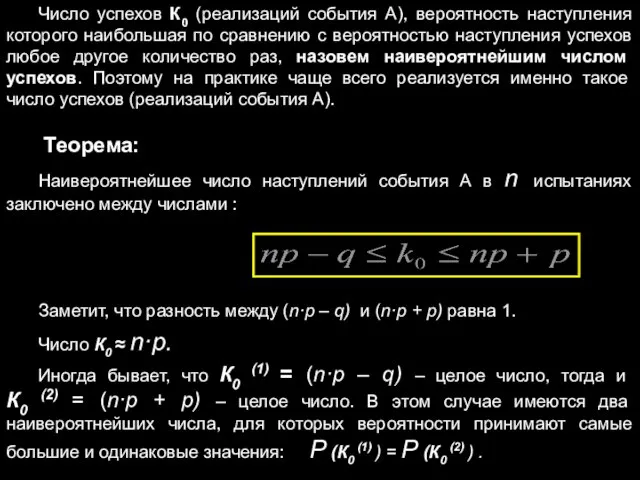

- 25. Число успехов К0 (реализаций события А), вероятность наступления которого наибольшая по сравнению с вероятностью наступления успехов

- 26. §10. Случайная величина (СВ) и закон ее распределения (з.р.). Случайная величина обозначается заглавной буквой Х (если

- 27. Существует два типа случайных величин – дискретные и непрерывные. Закон распределения случайной величины – это правило,

- 28. Пример графика функции распределения для дискретной случайной величины Х – числа выпадений герба при трехкратном бросании

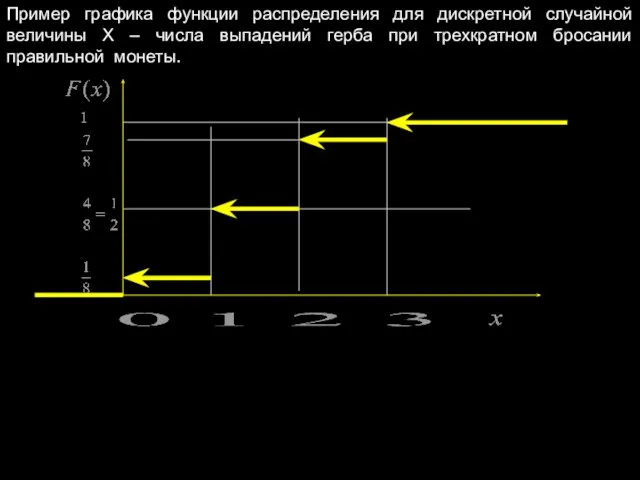

- 29. Если случайная величина такова, что ее функция распределения может быть представлена в виде: (здесь t –

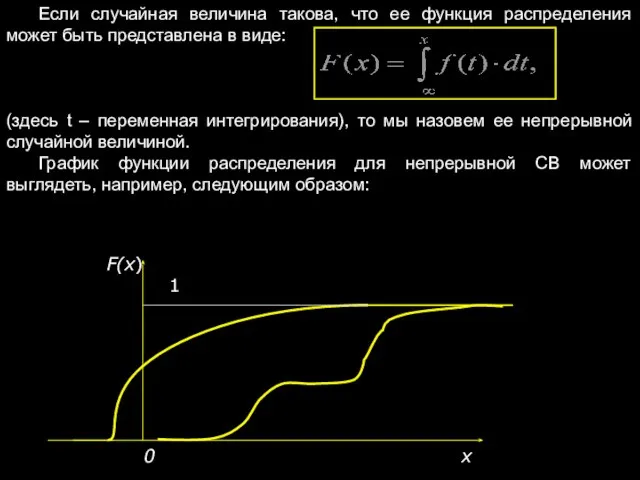

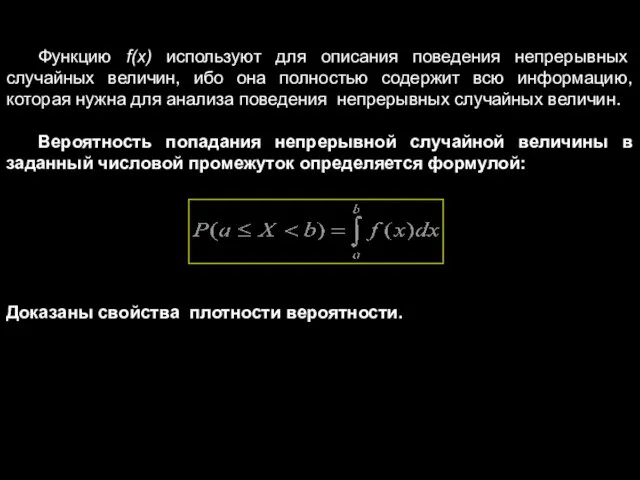

- 30. Функцию f(x) используют для описания поведения непрерывных случайных величин, ибо она полностью содержит всю информацию, которая

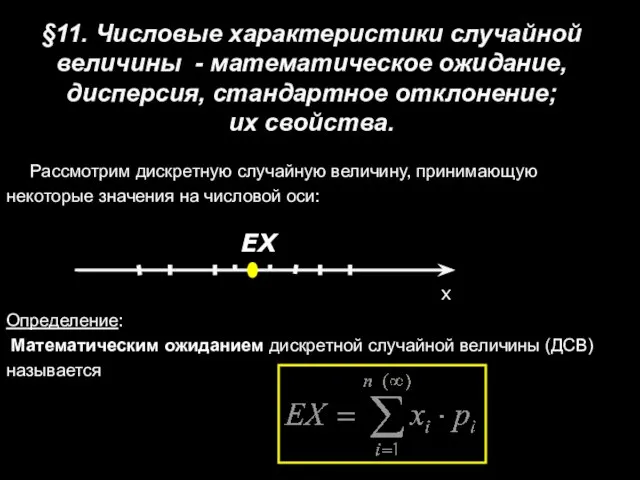

- 31. §11. Числовые характеристики случайной величины - математическое ожидание, дисперсия, стандартное отклонение; их свойства. Рассмотрим дискретную случайную

- 32. Для случая n→ ∞ ряд должен быть сходящимся. Возникают иногда ситуации, когда ряд расходится. Тогда случайная

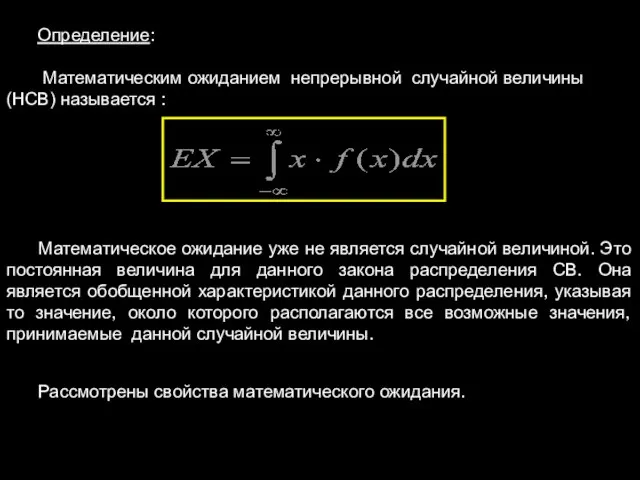

- 33. Определение: Математическим ожиданием непрерывной случайной величины (НСВ) называется : Математическое ожидание уже не является случайной величиной.

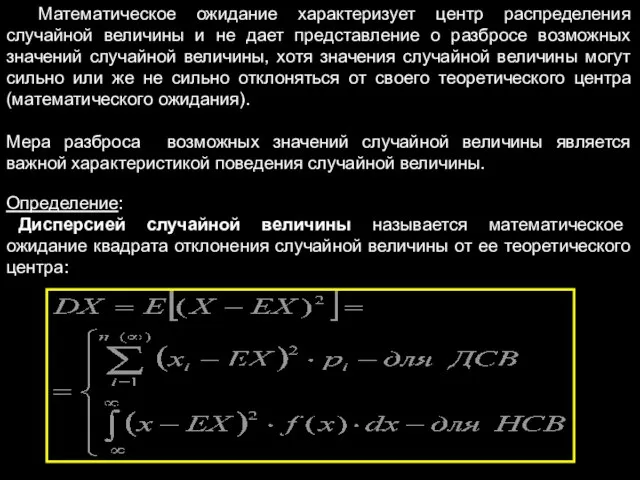

- 34. Математическое ожидание характеризует центр распределения случайной величины и не дает представление о разбросе возможных значений случайной

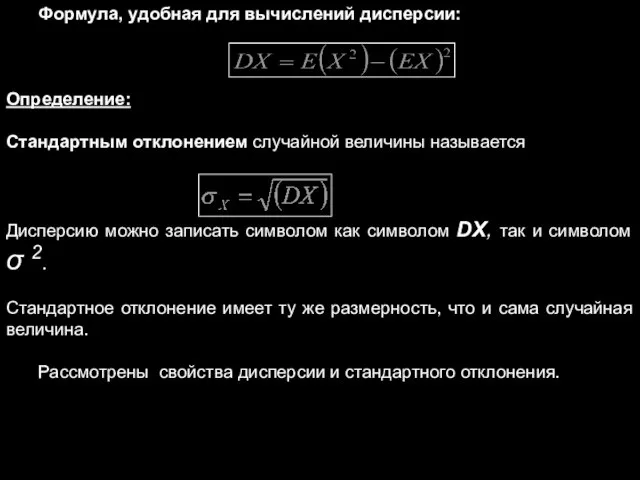

- 35. Формула, удобная для вычислений дисперсии: Определение: Стандартным отклонением случайной величины называется Дисперсию можно записать символом как

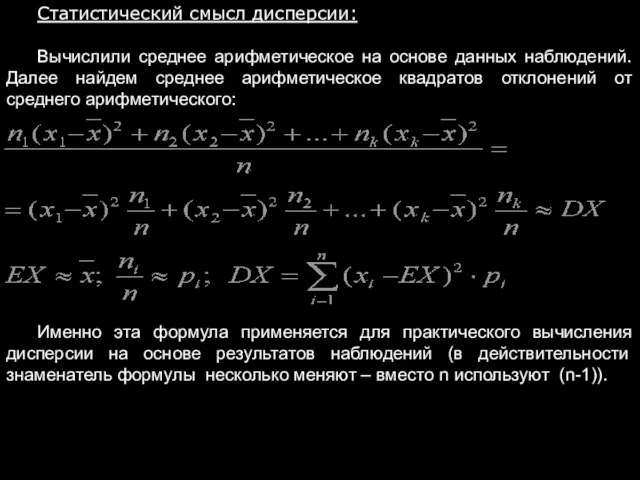

- 36. Статистический смысл дисперсии: Вычислили среднее арифметическое на основе данных наблюдений. Далее найдем среднее арифметическое квадратов отклонений

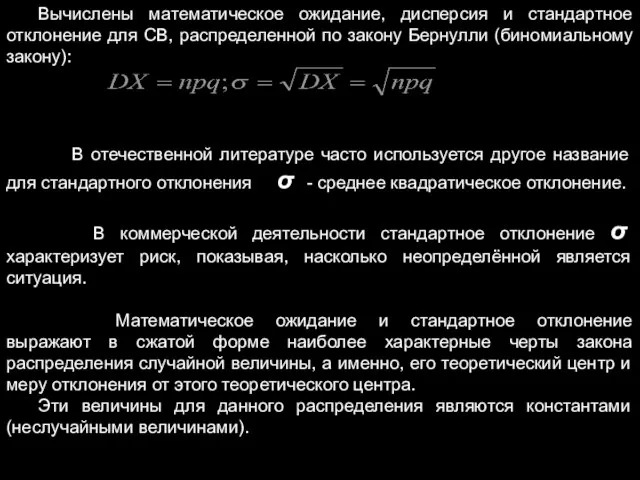

- 37. Вычислены математическое ожидание, дисперсия и стандартное отклонение для СВ, распределенной по закону Бернулли (биномиальному закону): В

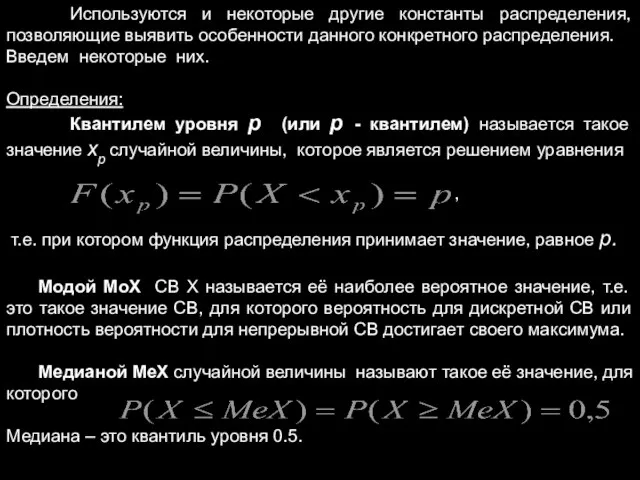

- 38. Используются и некоторые другие константы распределения, позволяющие выявить особенности данного конкретного распределения. Введем некоторые них. Определения:

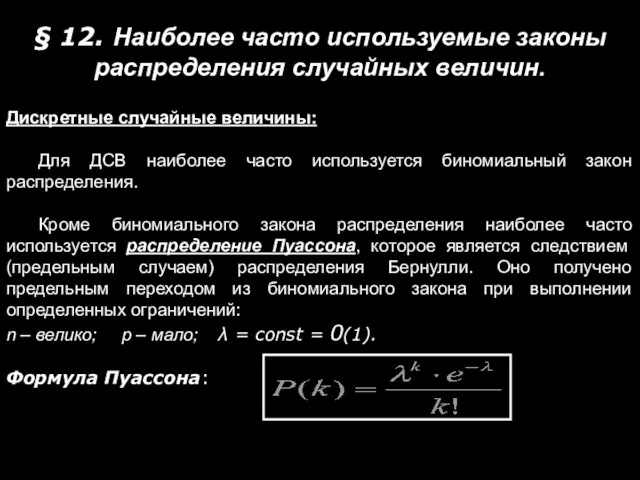

- 39. § 12. Наиболее часто используемые законы распределения случайных величин. Дискретные случайные величины: Для ДСВ наиболее часто

- 40. Параметр λ называют интенсивностью потока событий. Формула Пуассона имеет и самостоятельное значение, когда в задаче рассматривается

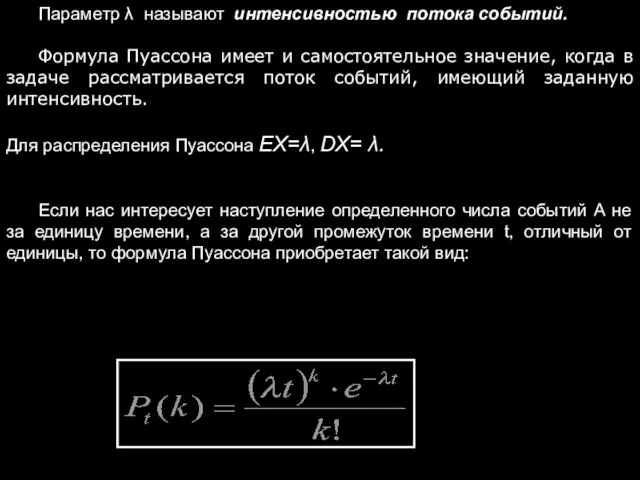

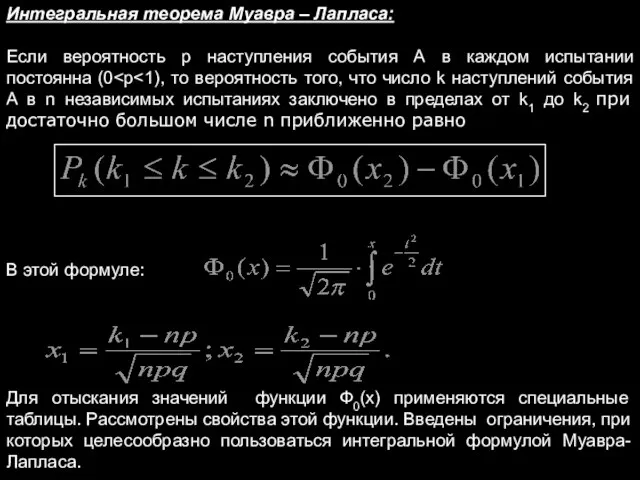

- 41. Интегральная теорема Муавра – Лапласа: Если вероятность p наступления события А в каждом испытании постоянна (0

- 42. Непрерывные случайные величины: СВ Х имеет равномерный закон распределения на отрезке [a, b], если ее плотность

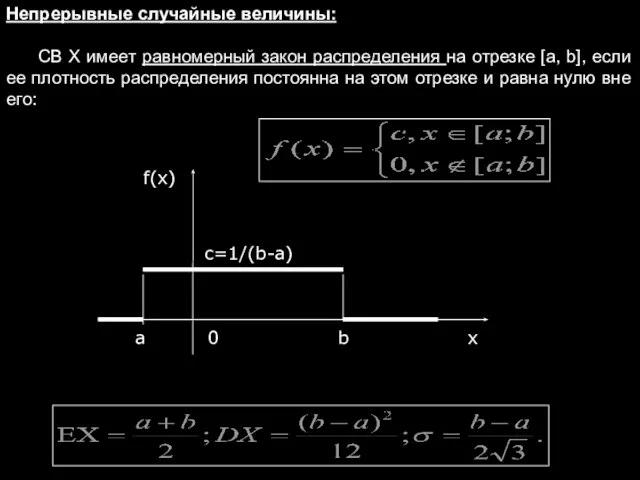

- 43. Непрерывная СВ Х имеет показательный (экспоненциальный) закон распределения с параметром λ, если ее плотность распределения имеет

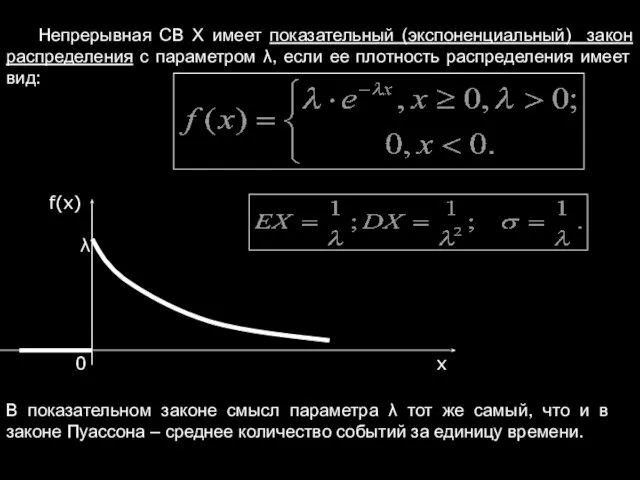

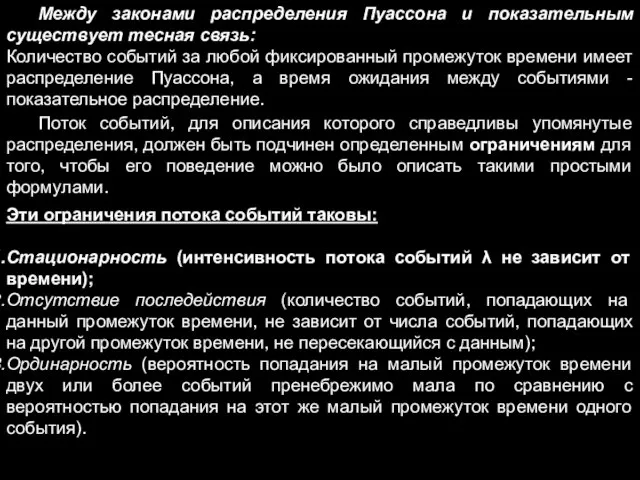

- 44. Между законами распределения Пуассона и показательным существует тесная связь: Количество событий за любой фиксированный промежуток времени

- 45. Поток событий называется простейшим (или стационарным пуассоновским), если он одновременно обладает свойствами 1, 2, 3. Эта

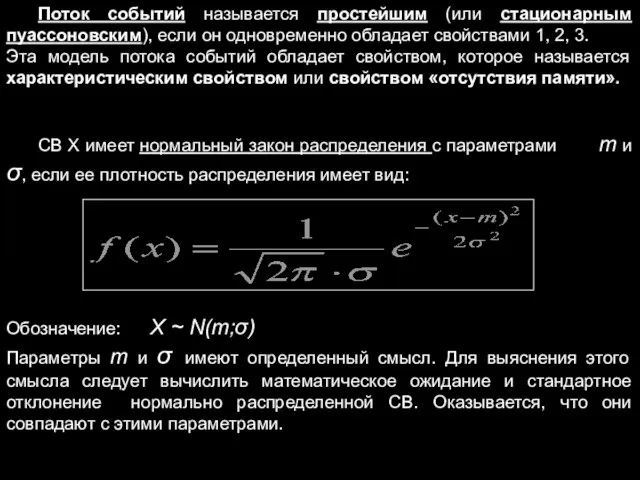

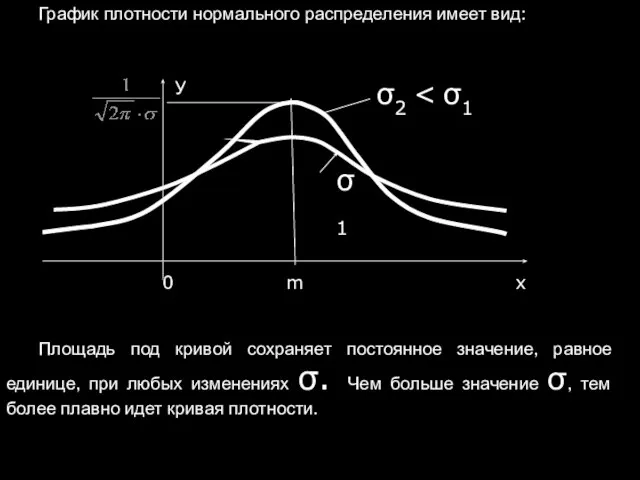

- 46. График плотности нормального распределения имеет вид: σ1 Площадь под кривой сохраняет постоянное значение, равное единице, при

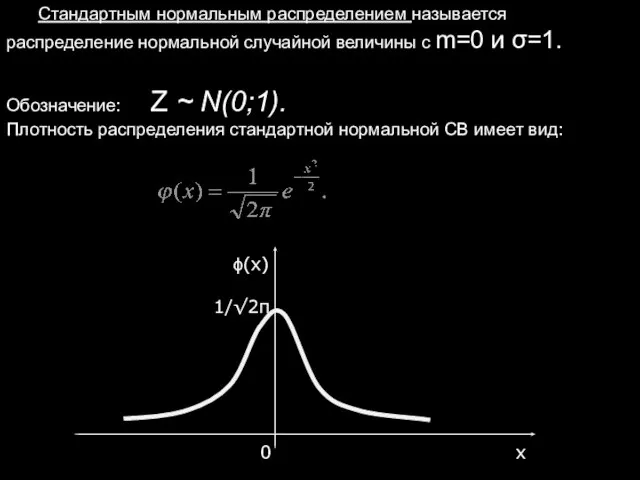

- 47. Стандартным нормальным распределением называется распределение нормальной случайной величины с m=0 и σ=1. Обозначение: Z ~ N(0;1).

- 48. Формула для вычисления вероятности попадания нормально распределенной СВ в заданный интервал: Справедлива формула: На основе этой

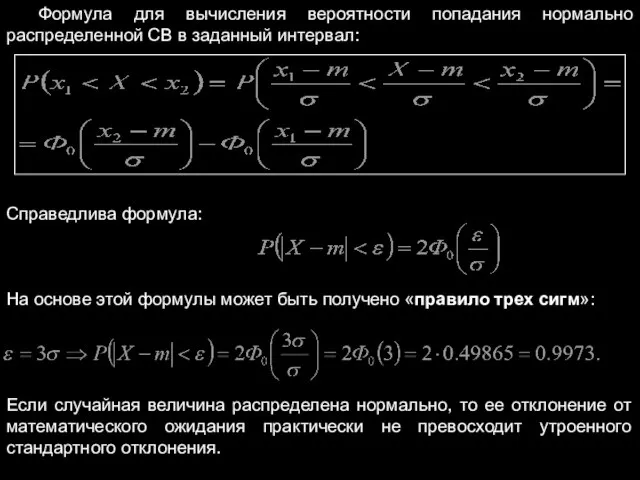

- 49. §13. Устойчивость некоторых законов распределения. Если СВ нормально распределена: X ~ N(m;σ), то СВ Y=aX+b также

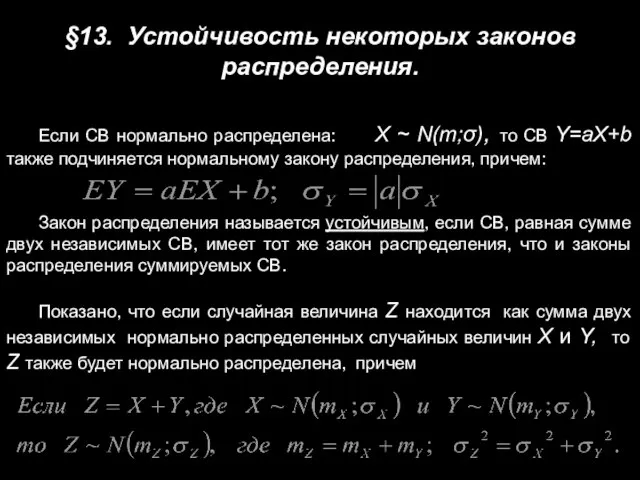

- 50. §14. Неравенство Чебышева. Неравенство Маркова (или лемма Чебышева) Если случайная величина Х принимает только неотрицательные значения

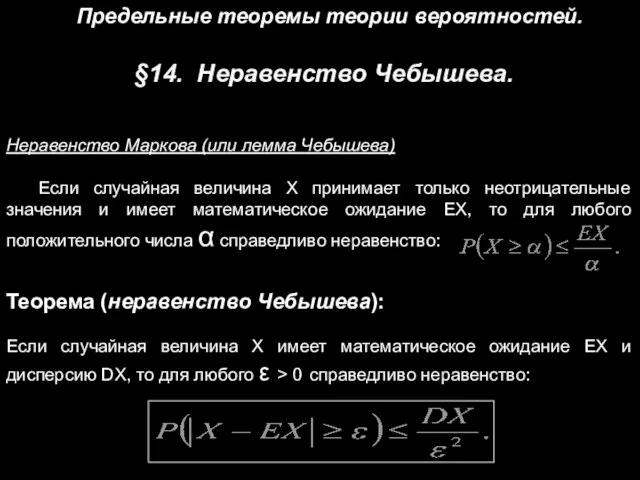

- 51. §15.Теорема Чебышева. Закон больших чисел (ЗБЧ). Введем понятие сходимости по вероятности:

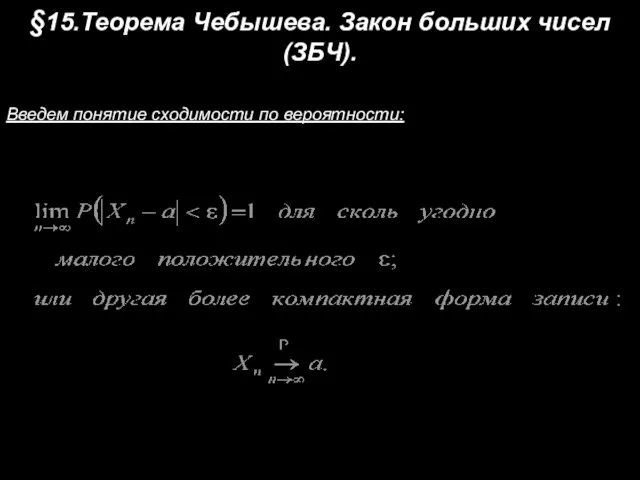

- 52. Формулировка ЗБЧ в форме Чебышева П.Л. (теорема Чебышева): Если дисперсии n независимых случайных величин Х1 ,

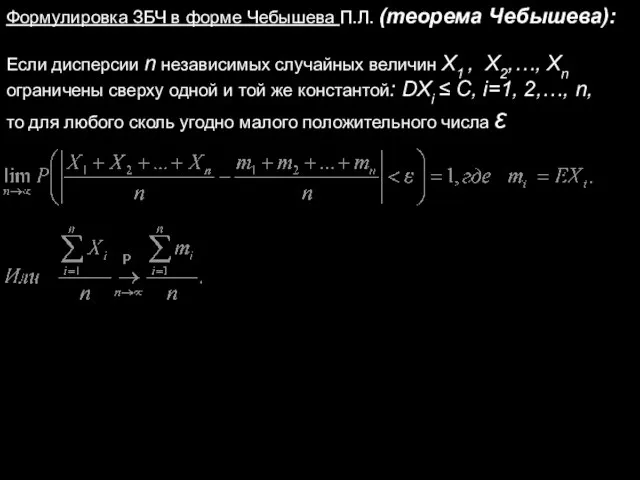

- 53. Следствия из теоремы Чебышева: Первое следствие: Теорема Хинчина Если независимые случайные величины Х1 , Х2,…, Хn

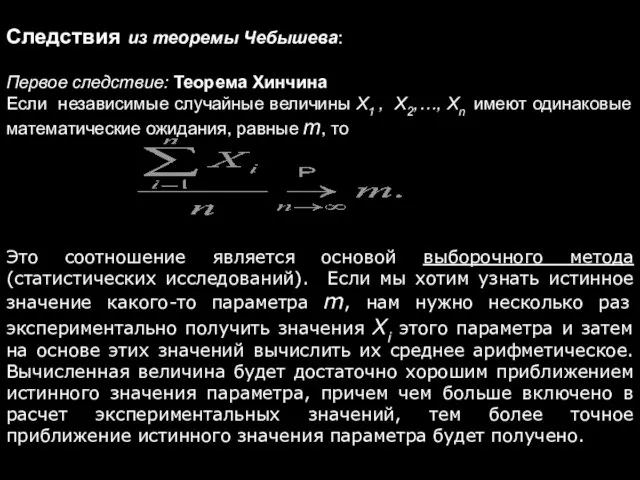

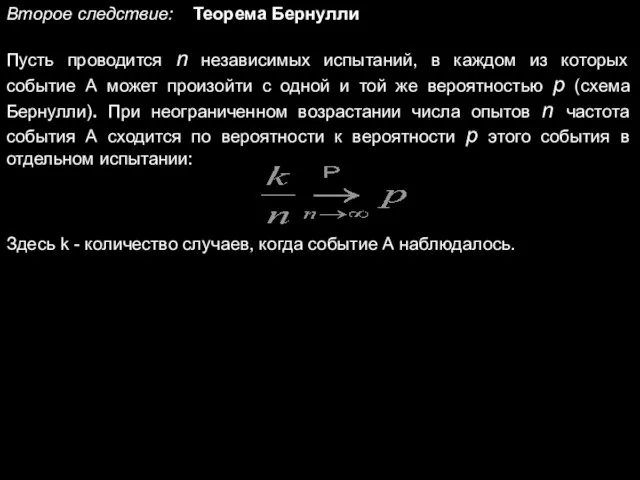

- 54. Второе следствие: Теорема Бернулли Пусть проводится n независимых испытаний, в каждом из которых событие А может

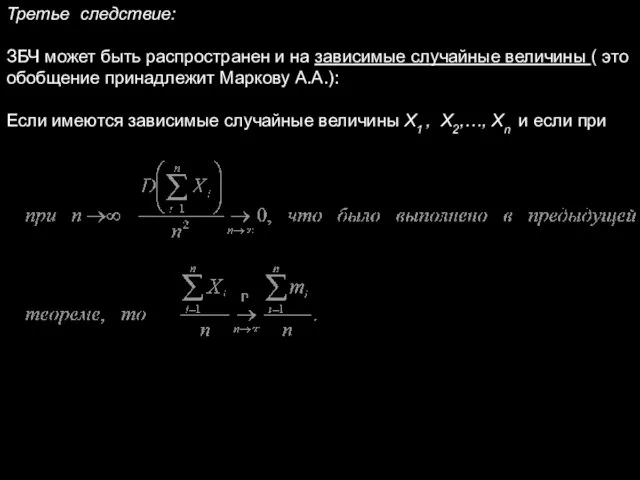

- 55. Третье следствие: ЗБЧ может быть распространен и на зависимые случайные величины ( это обобщение принадлежит Маркову

- 56. §16. Смысл и формулировка центральной предельной теоремы (ЦПТ). Интегральная теорема Муавра-Лапласа как следствие ЦПТ. Эта теорема

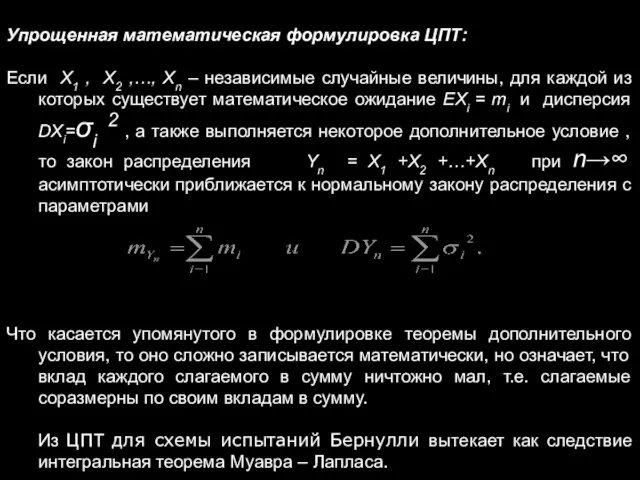

- 57. Упрощенная математическая формулировка ЦПТ: Если X1 , X2 ,…, Xn – независимые случайные величины, для каждой

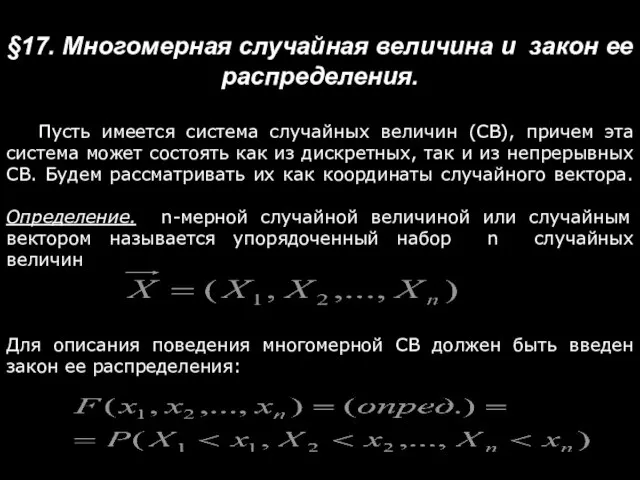

- 58. §17. Многомерная случайная величина и закон ее распределения. Пусть имеется система случайных величин (СВ), причем эта

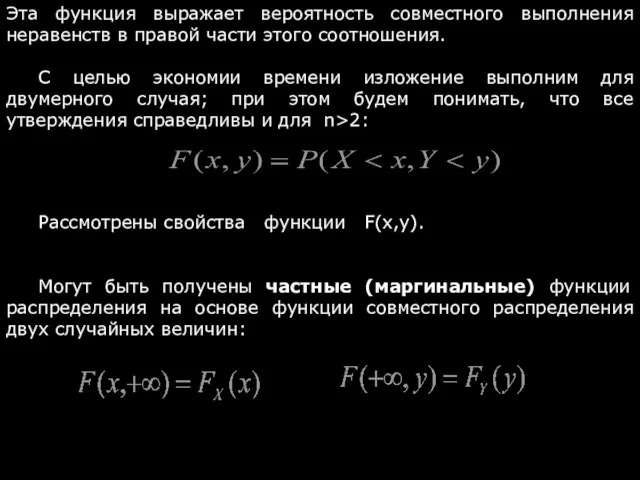

- 59. Эта функция выражает вероятность совместного выполнения неравенств в правой части этого соотношения. С целью экономии времени

- 60. Для двумерной непрерывной случайной величины (X,Y) функция совместного распределения может быть представлена в виде: Для функции

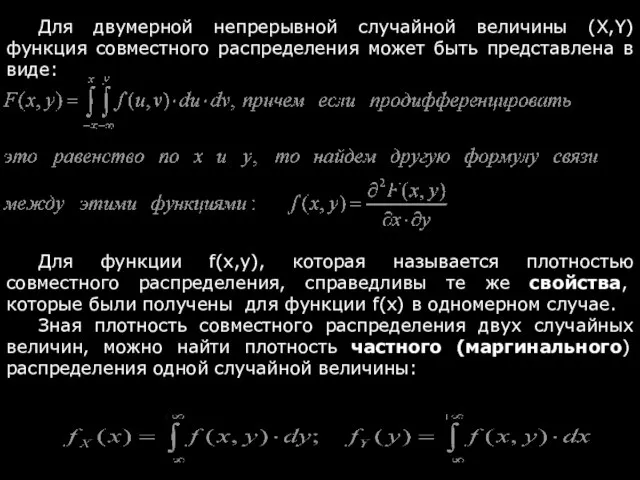

- 61. Для независимых случайных величин Х и Y независимы события {X Для непрерывных СВ из данного соотношения,

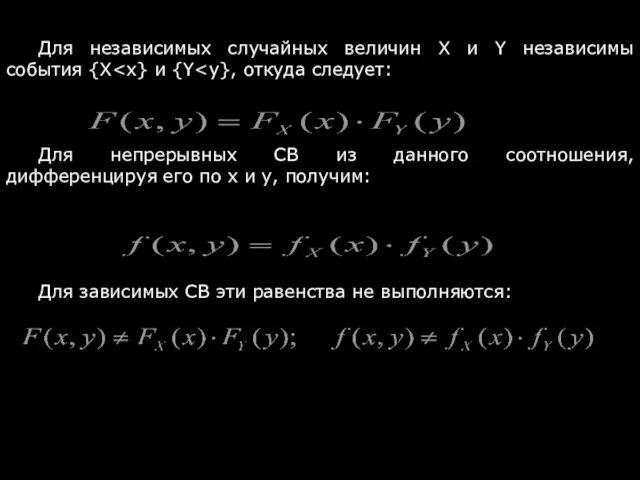

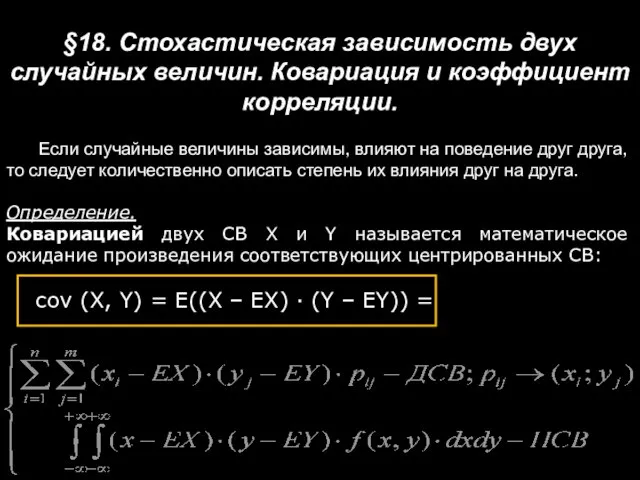

- 62. §18. Стохастическая зависимость двух случайных величин. Ковариация и коэффициент корреляции. Если случайные величины зависимы, влияют на

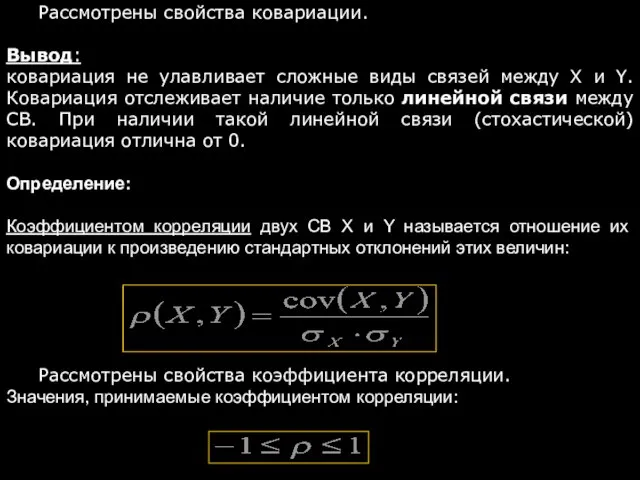

- 63. Рассмотрены свойства ковариации. Вывод: ковариация не улавливает сложные виды связей между X и Y. Ковариация отслеживает

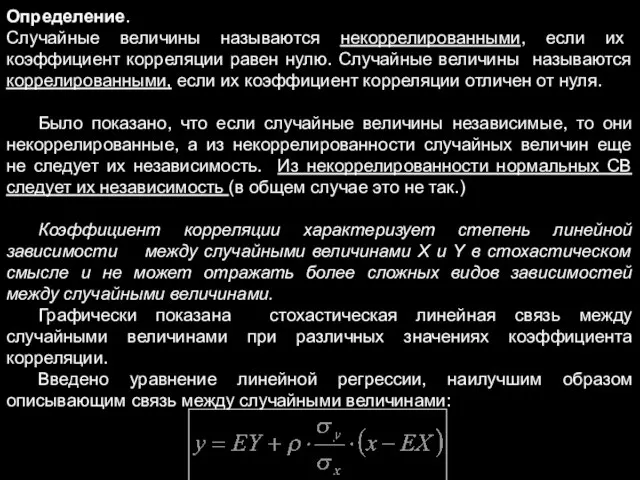

- 64. Определение. Случайные величины называются некоррелированными, если их коэффициент корреляции равен нулю. Случайные величины называются коррелированными, если

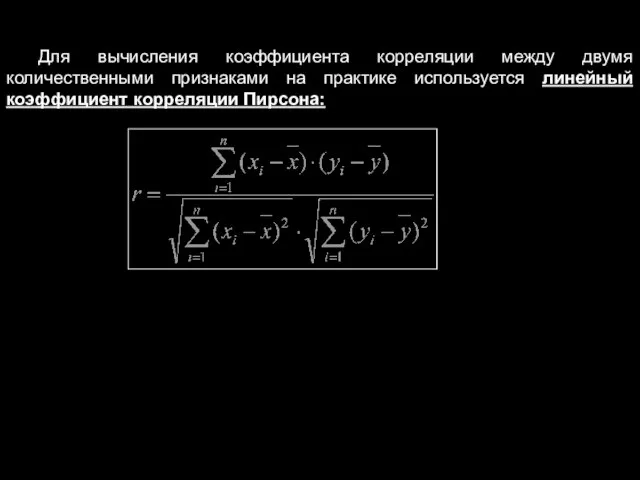

- 65. Для вычисления коэффициента корреляции между двумя количественными признаками на практике используется линейный коэффициент корреляции Пирсона:

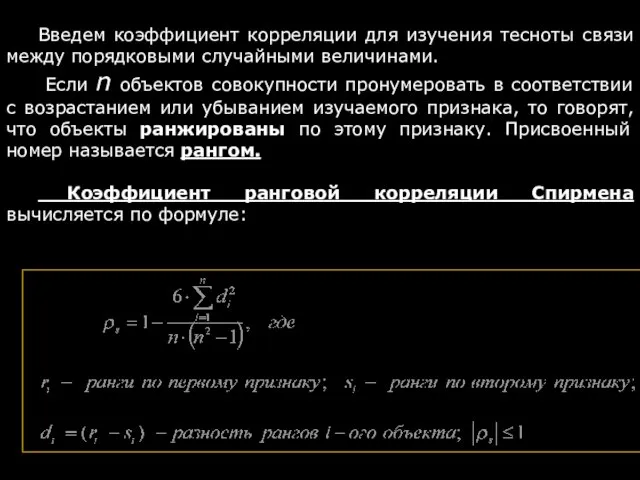

- 66. Введем коэффициент корреляции для изучения тесноты связи между порядковыми случайными величинами. Если n объектов совокупности пронумеровать

- 67. В случае совпадения рангов при вычислении коэффициента ранговой корреляции следует брать среднее арифметическое рангов, приходящихся на

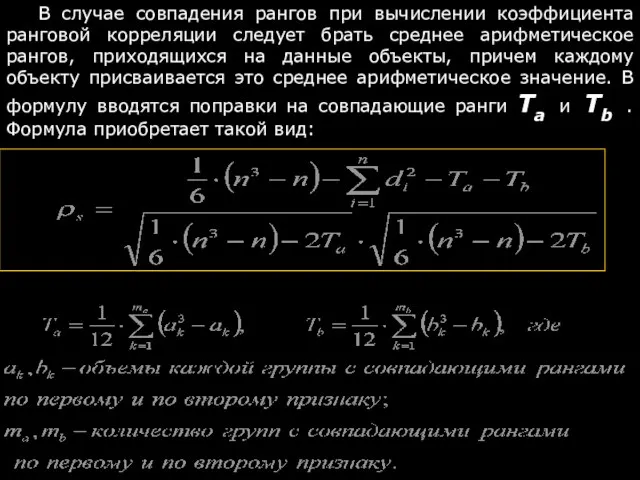

- 68. Раздел 2. Элементы математической статистики. Начнем с нового раздела нумерацию параграфов заново. § 1. Случайные выборки.

- 69. Генеральной совокупностью (ГС) называется вся подлежащая изучению какого-либо свойства (говорят, признака) совокупность объектов. Та часть объектов,

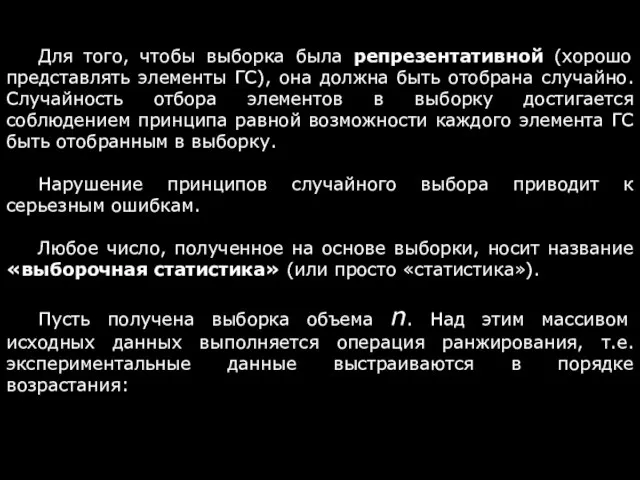

- 70. Для того, чтобы выборка была репрезентативной (хорошо представлять элементы ГС), она должна быть отобрана случайно. Случайность

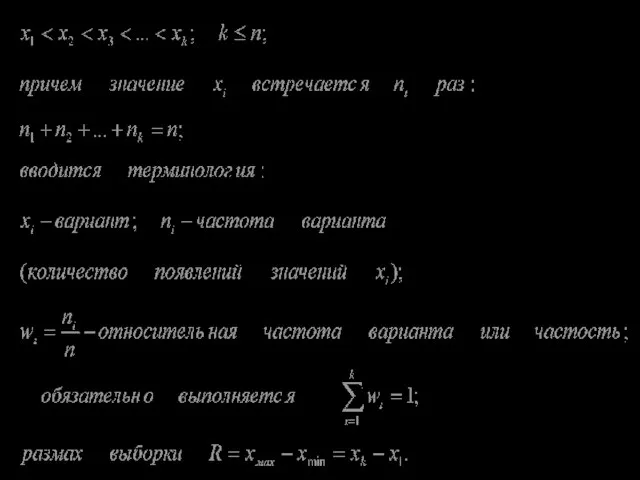

- 72. Определение. Вариационным рядом называется ранжированный в порядке возрастания ряд значений (вариантов) с соответствующими им частотами. Данный

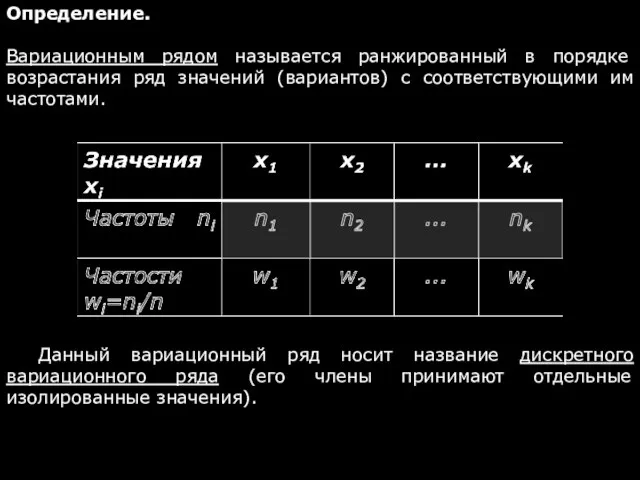

- 73. Построение дискретного вариационного ряда нецелесообразно, когда число значений в выборке велико или признак имеет непрерывную природу,

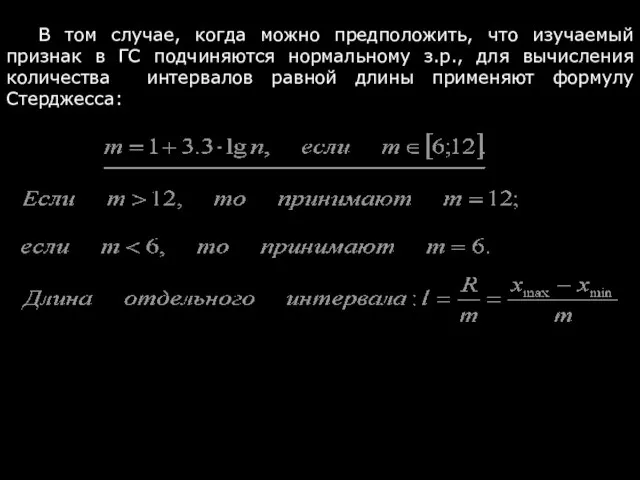

- 74. В том случае, когда можно предположить, что изучаемый признак в ГС подчиняются нормальному з.р., для вычисления

- 75. Существуют различные приёмы изображения набора данных, которые дают визуальное представление об основных свойствах экспериментальных данных в

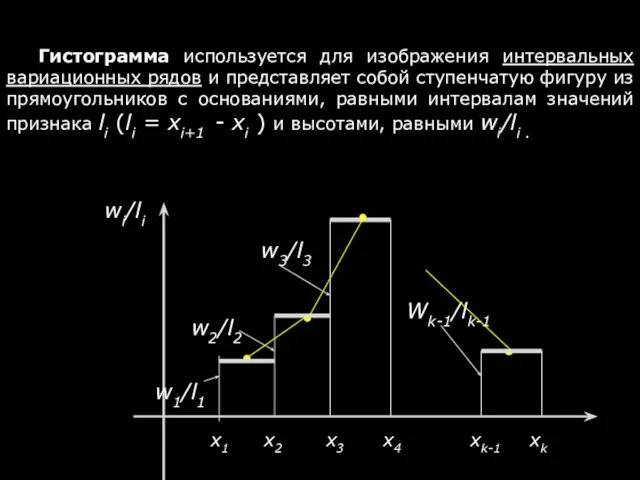

- 76. Гистограмма используется для изображения интервальных вариационных рядов и представляет собой ступенчатую фигуру из прямоугольников с основаниями,

- 77. Эмпирической функцией распределения Fn(x) называется относительная частота того, что случайная величина принимает значение меньше заданного: Fn(x)

- 78. Следует дополнить вариационные ряды и их графическое изображение некоторыми сводными характеристиками вариационных рядов. Эти обобщающие показатели

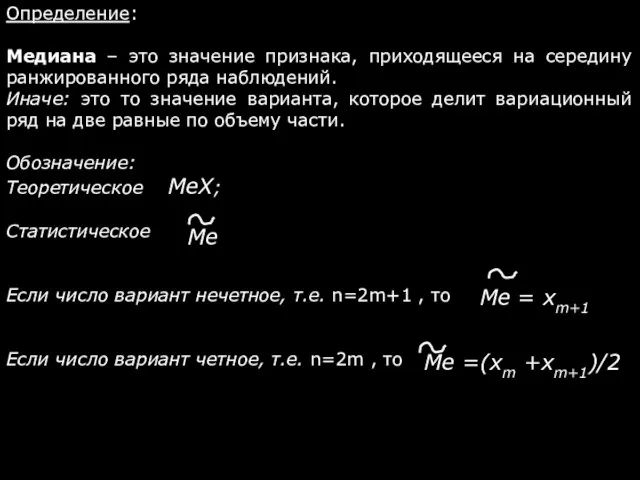

- 79. Определение: Медиана – это значение признака, приходящееся на середину ранжированного ряда наблюдений. Иначе: это то значение

- 80. Определение: Модой называется значение признака, наиболее часто встречающееся в выборке. Иначе: Мода - то значение варианта,

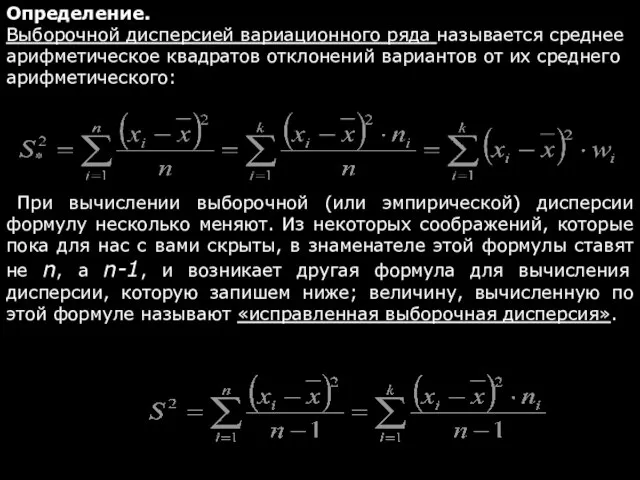

- 81. Определение. Выборочной дисперсией вариационного ряда называется среднее арифметическое квадратов отклонений вариантов от их среднего арифметического: При

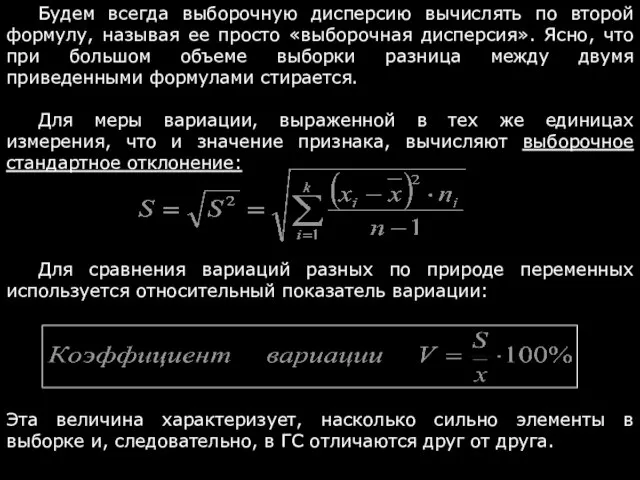

- 82. Будем всегда выборочную дисперсию вычислять по второй формулу, называя ее просто «выборочная дисперсия». Ясно, что при

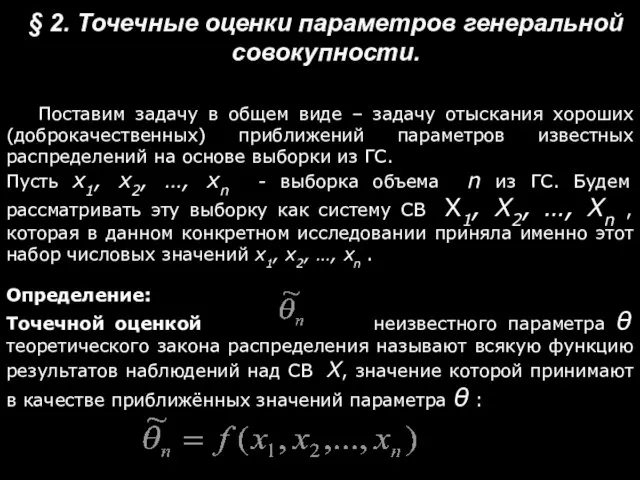

- 83. § 2. Точечные оценки параметров генеральной совокупности. Поставим задачу в общем виде – задачу отыскания хороших

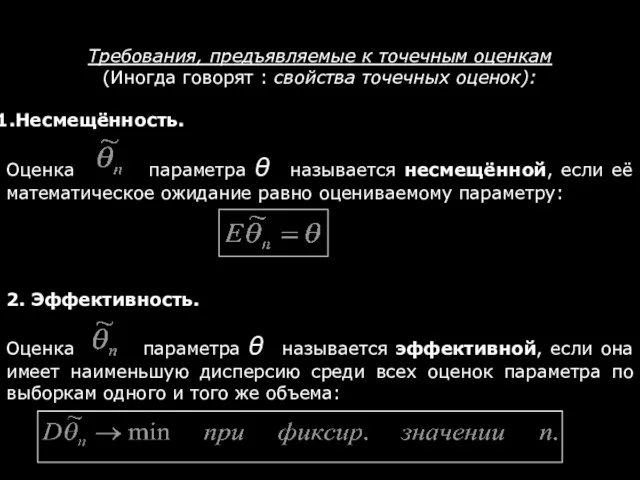

- 84. Требования, предъявляемые к точечным оценкам (Иногда говорят : свойства точечных оценок): Несмещённость. Оценка параметра θ называется

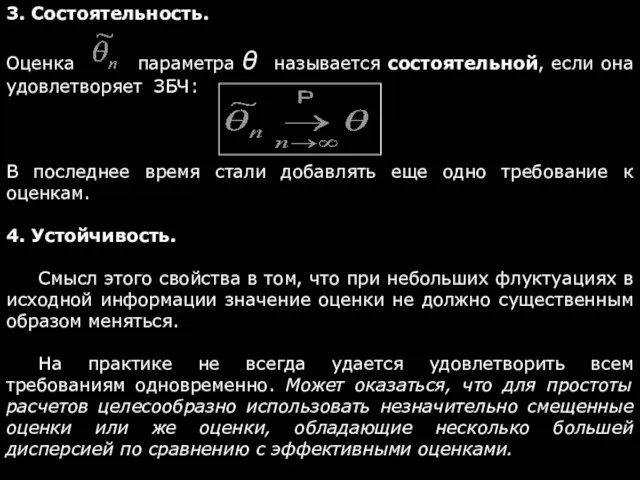

- 85. 3. Состоятельность. Оценка параметра θ называется состоятельной, если она удовлетворяет ЗБЧ: В последнее время стали добавлять

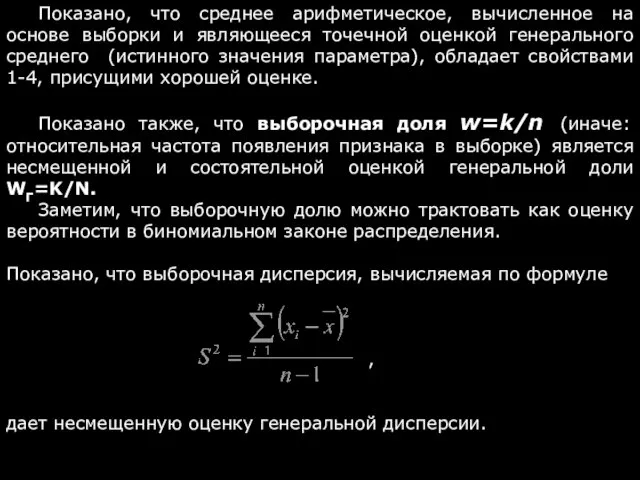

- 86. Показано, что среднее арифметическое, вычисленное на основе выборки и являющееся точечной оценкой генерального среднего (истинного значения

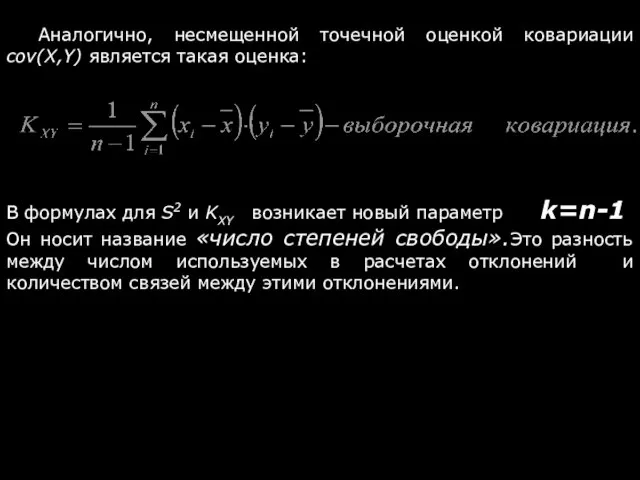

- 87. Аналогично, несмещенной точечной оценкой ковариации cov(X,Y) является такая оценка: В формулах для S2 и KXY возникает

- 88. § 3. Методы получения точечных оценок параметров генеральной совокупности. Основное внимание уделим методу, который наиболее часто

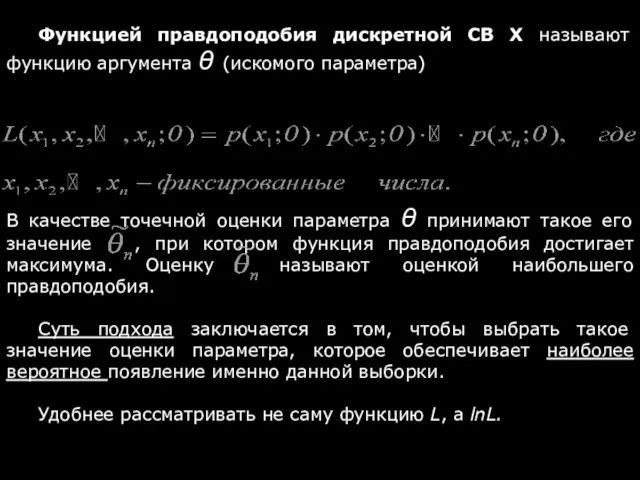

- 89. Функцией правдоподобия дискретной СВ Х называют функцию аргумента θ (искомого параметра) В качестве точечной оценки параметра

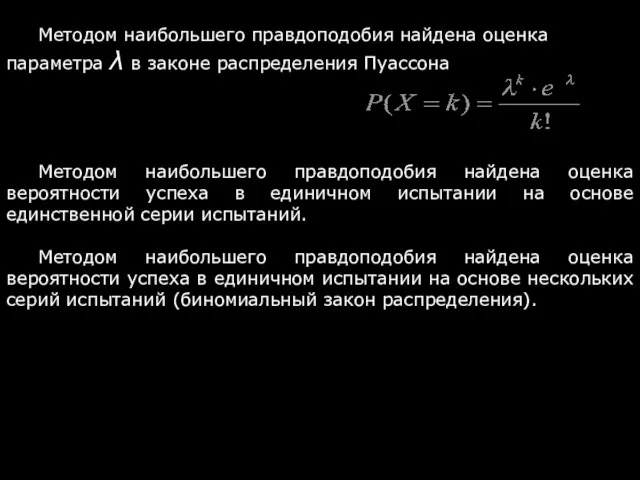

- 90. Методом наибольшего правдоподобия найдена оценка параметра λ в законе распределения Пуассона Методом наибольшего правдоподобия найдена оценка

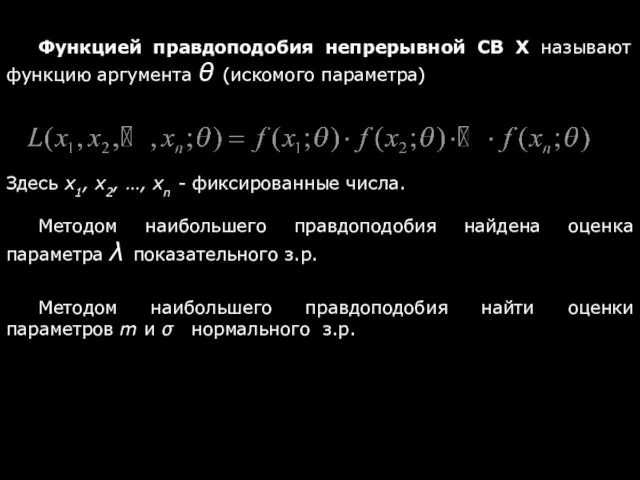

- 91. Функцией правдоподобия непрерывной СВ Х называют функцию аргумента θ (искомого параметра) Здесь x1, x2, …, xn

- 92. По поводу метода наибольшего правдоподобия сделаем выводы: 1. Метод наибольшего правдоподобия дает естественные оценки, не противоречащие

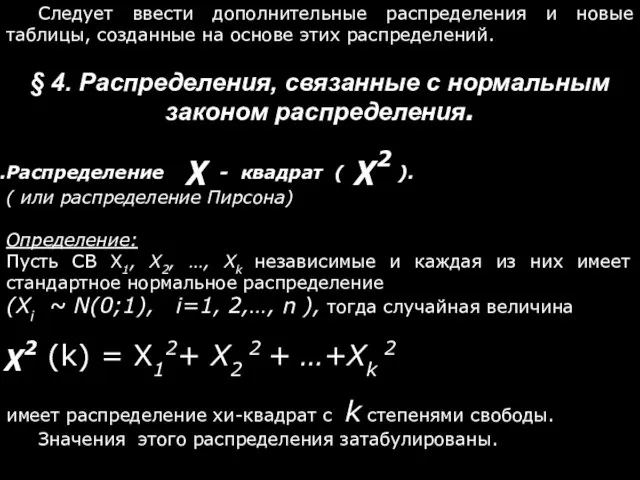

- 93. Следует ввести дополнительные распределения и новые таблицы, созданные на основе этих распределений. § 4. Распределения, связанные

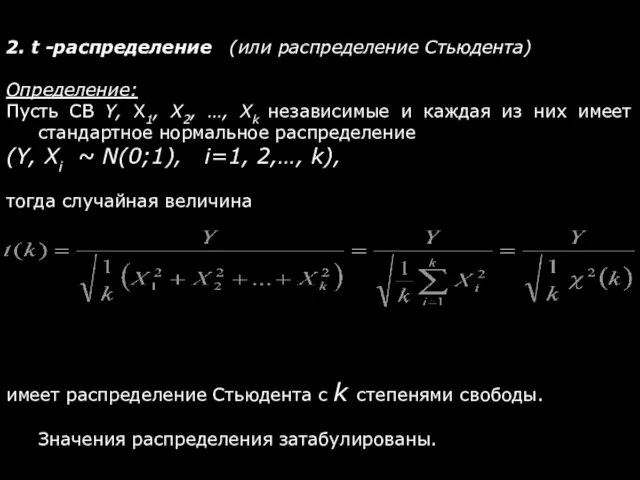

- 94. 2. t -распределение (или распределение Стьюдента) Определение: Пусть СВ Y, X1, X2, …, Xk независимые и

- 95. § 5. Интервальные оценки параметров генеральной совокупности. Наша задача - научиться отыскивать границы интервала, который накроет

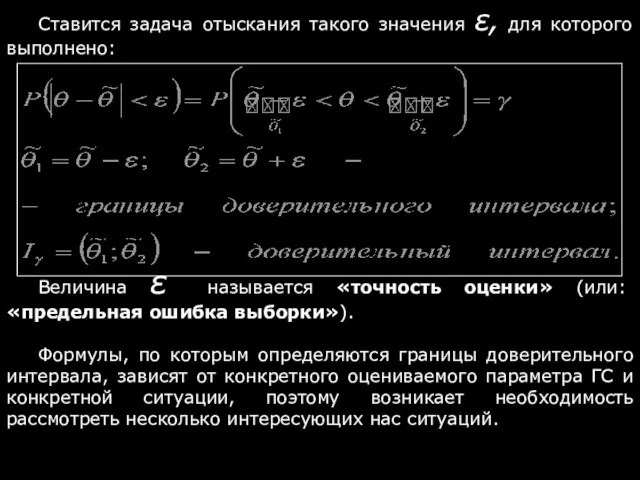

- 96. Ставится задача отыскания такого значения ε, для которого выполнено: Величина ε называется «точность оценки» (или: «предельная

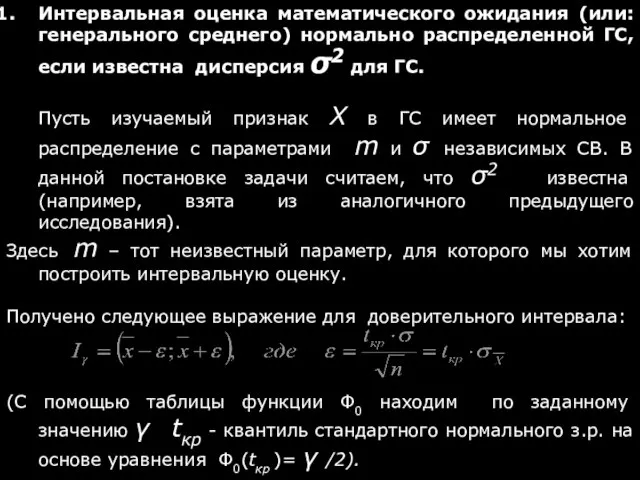

- 97. Интервальная оценка математического ожидания (или: генерального среднего) нормально распределенной ГС, если известна дисперсия σ2 для ГС.

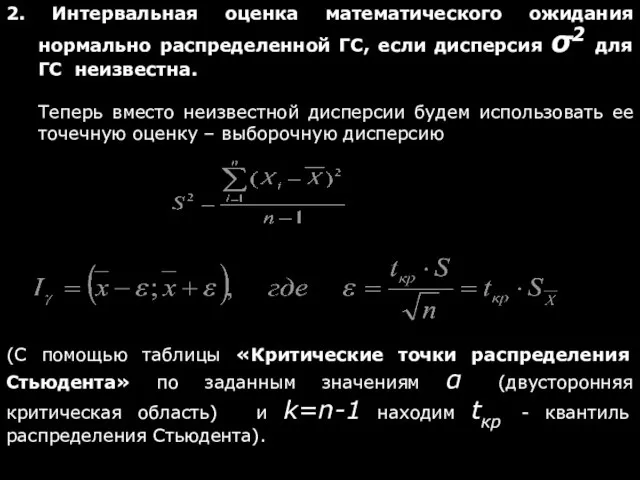

- 98. 2. Интервальная оценка математического ожидания нормально распределенной ГС, если дисперсия σ2 для ГС неизвестна. Теперь вместо

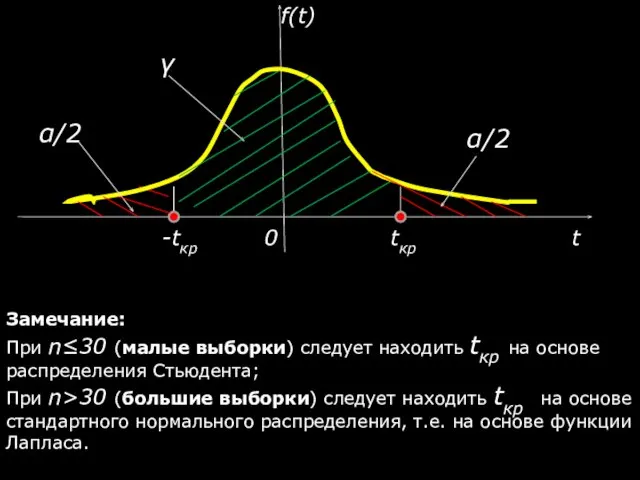

- 99. Замечание: При n≤30 (малые выборки) следует находить tкр на основе распределения Стьюдента; При n>30 (большие выборки)

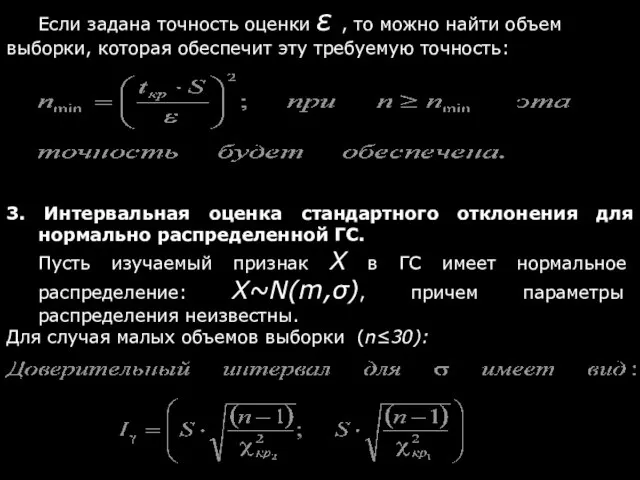

- 100. Если задана точность оценки ε , то можно найти объем выборки, которая обеспечит эту требуемую точность:

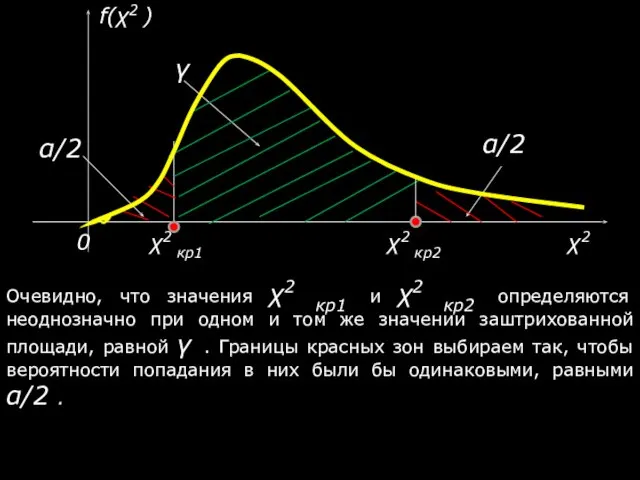

- 101. Очевидно, что значения χ2 кр1 и χ2 кр2 определяются неоднозначно при одном и том же значении

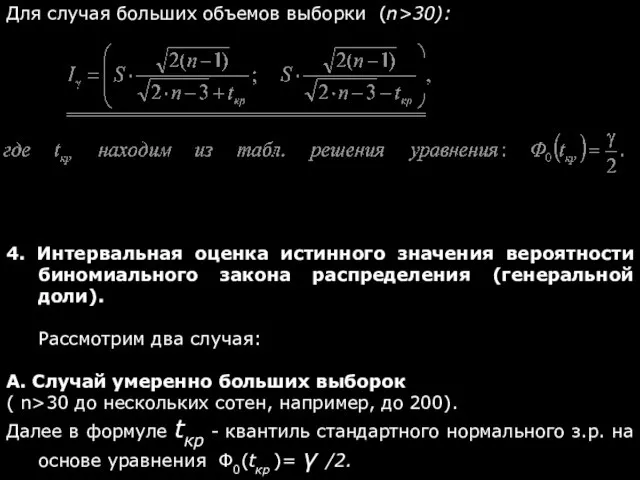

- 102. Для случая больших объемов выборки (n>30): 4. Интервальная оценка истинного значения вероятности биномиального закона распределения (генеральной

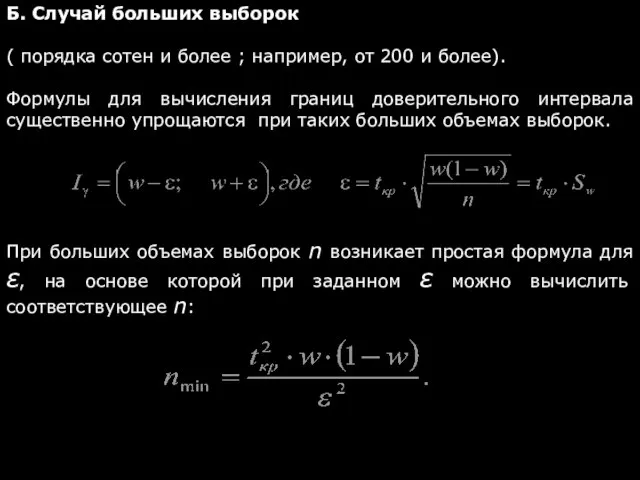

- 104. Б. Случай больших выборок ( порядка сотен и более ; например, от 200 и более). Формулы

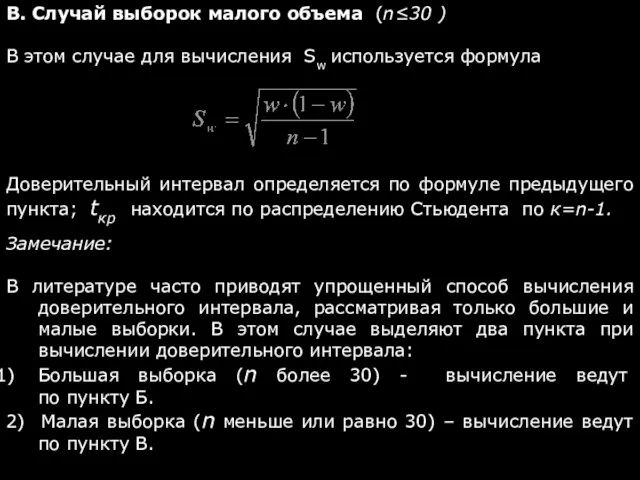

- 105. В. Случай выборок малого объема (n≤30 ) В этом случае для вычисления Sw используется формула Доверительный

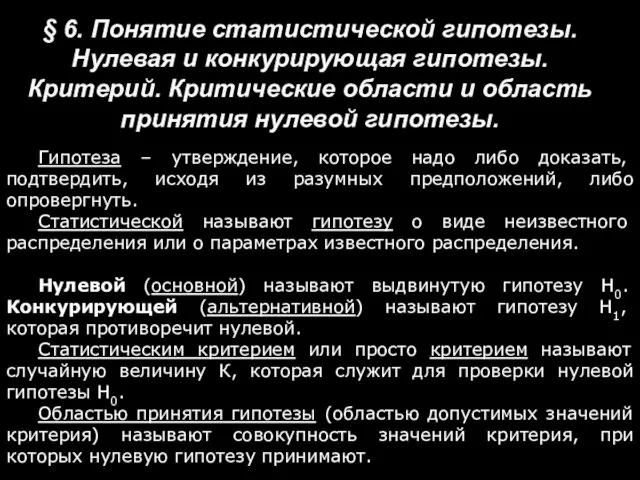

- 106. § 6. Понятие статистической гипотезы. Нулевая и конкурирующая гипотезы. Критерий. Критические области и область принятия нулевой

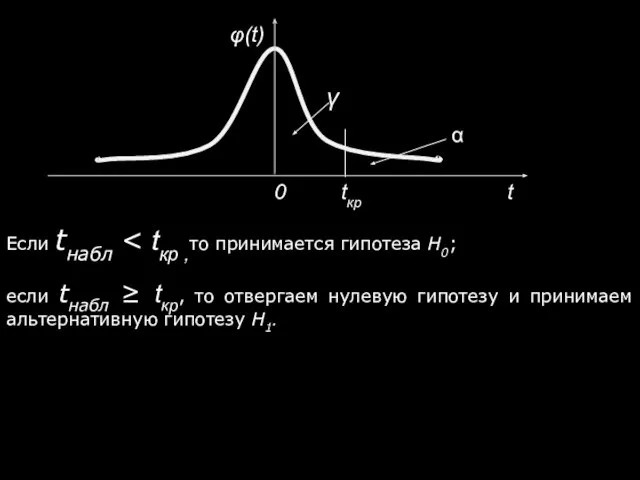

- 107. Критической областью называют совокупность значений критерия, при которых нулевую гипотезу отвергают. Это такие значения критерия, которые

- 108. Процедура проверки простой параметрической гипотезы выглядит так: Формируют нулевую гипотезу Н0 и альтернативную гипотезу Н1 на

- 109. Вероятность попадания в эту область мала и равна α=1-γ. α носит название «уровень значимости»(α=0.10;0.05;0.01). 4. Вычисляют

- 110. 6. Если наблюдаемое значение критерия Кнабл попадает в область неестественных значений и мы, следовательно, отвергаем гипотезу

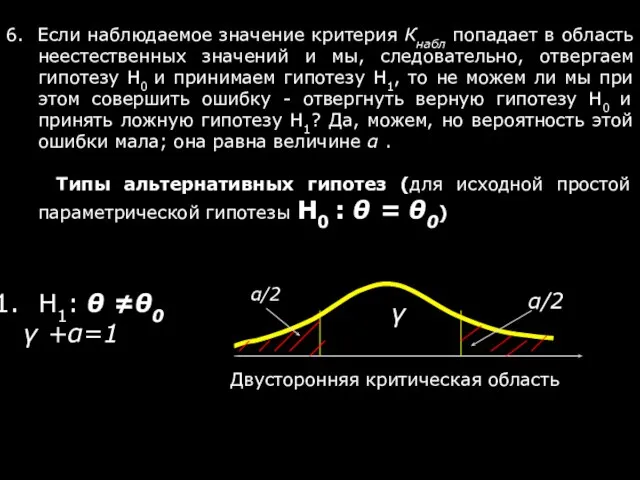

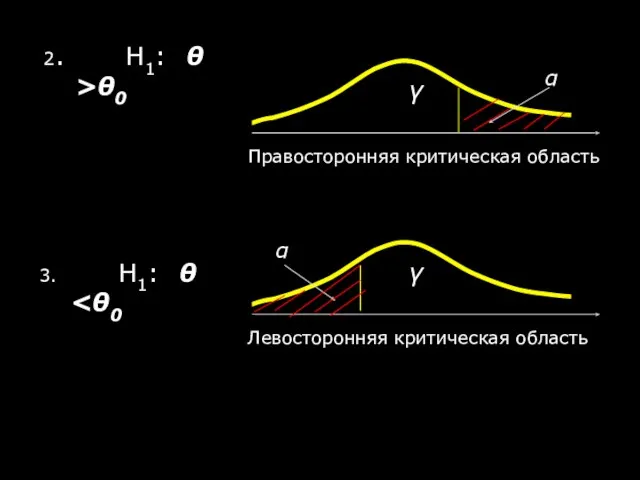

- 111. 3. Н1: θ 2. Н1: θ >θ0

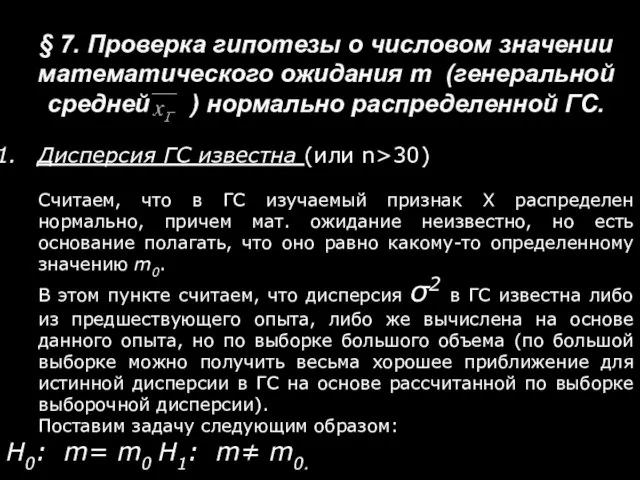

- 112. § 7. Проверка гипотезы о числовом значении математического ожидания m (генеральной средней ) нормально распределенной ГС.

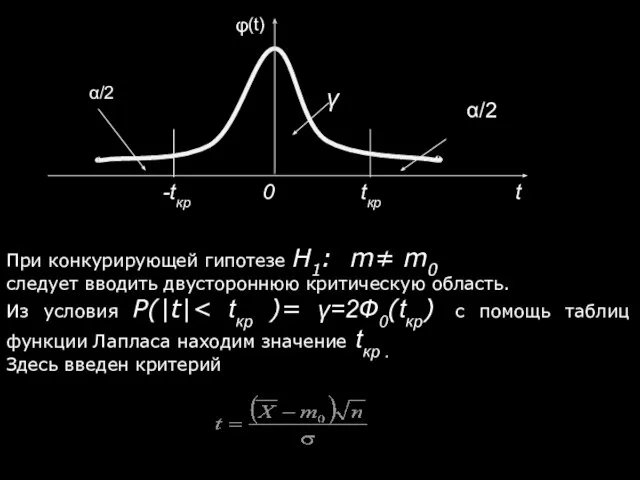

- 113. При конкурирующей гипотезе Н1: m≠ m0 следует вводить двустороннюю критическую область. Из условия P(|t| Здесь введен

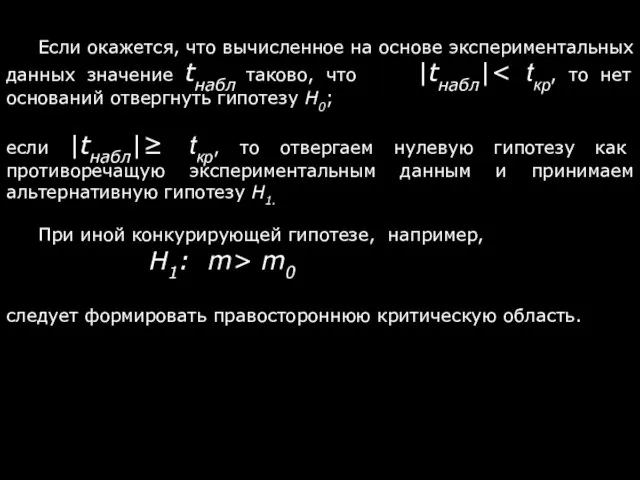

- 114. Если окажется, что вычисленное на основе экспериментальных данных значение tнабл таково, что |tнабл| если |tнабл|≥ tкр,

- 115. Если tнабл если tнабл ≥ tкр, то отвергаем нулевую гипотезу и принимаем альтернативную гипотезу Н1.

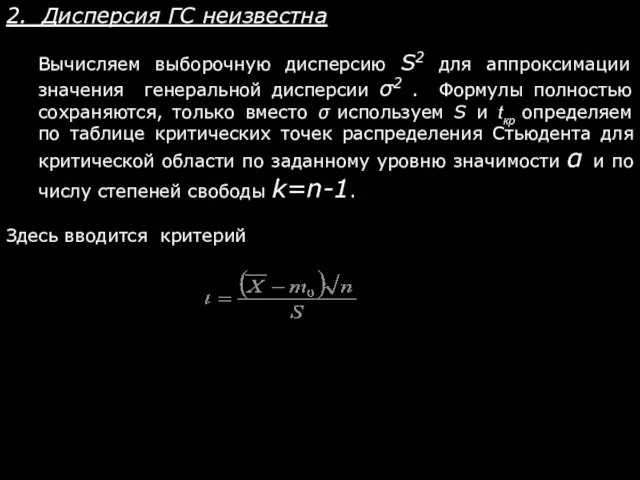

- 116. 2. Дисперсия ГС неизвестна Вычисляем выборочную дисперсию S2 для аппроксимации значения генеральной дисперсии σ2 . Формулы

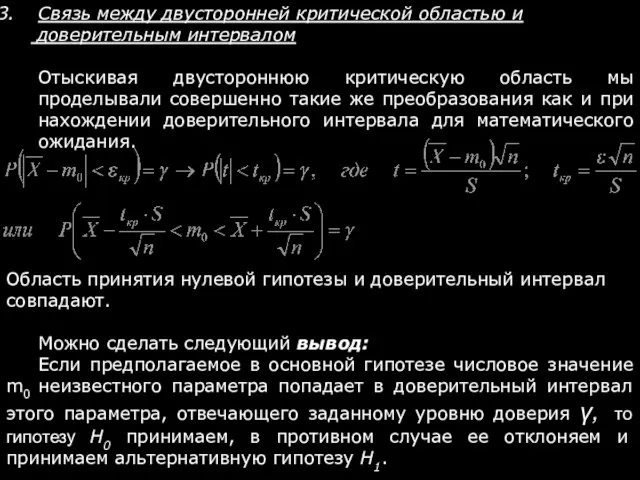

- 117. Связь между двусторонней критической областью и доверительным интервалом Отыскивая двустороннюю критическую область мы проделывали совершенно такие

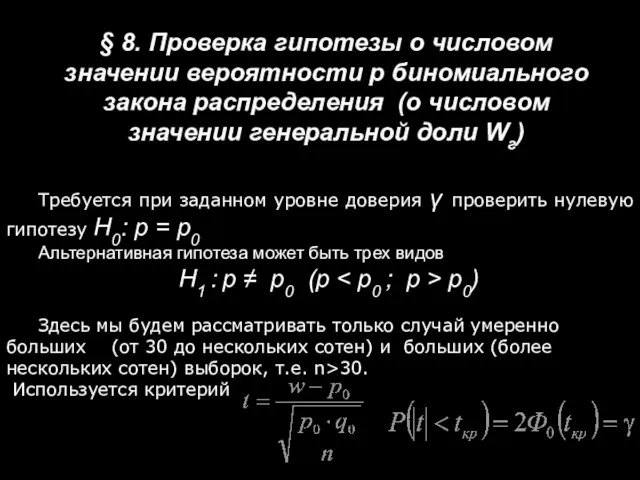

- 118. § 8. Проверка гипотезы о числовом значении вероятности p биномиального закона распределения (о числовом значении генеральной

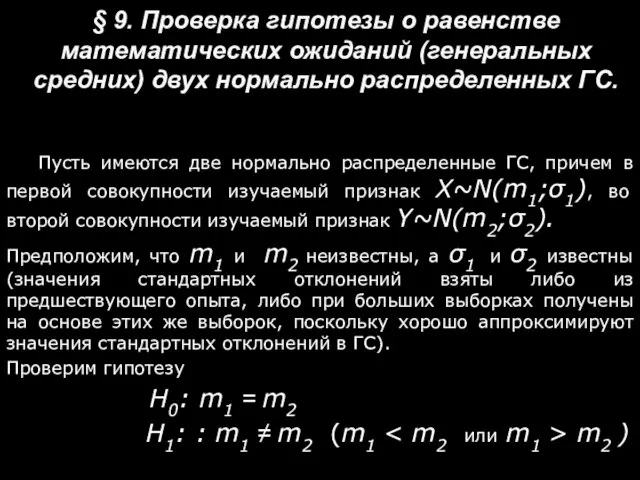

- 119. § 9. Проверка гипотезы о равенстве математических ожиданий (генеральных средних) двух нормально распределенных ГС. Пусть имеются

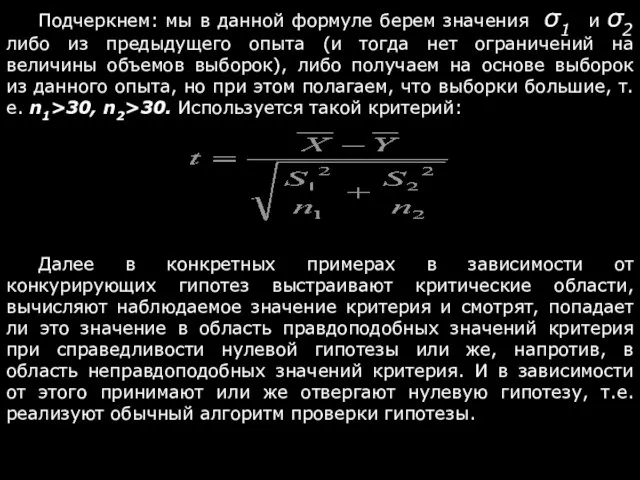

- 120. Подчеркнем: мы в данной формуле берем значения σ1 и σ2 либо из предыдущего опыта (и тогда

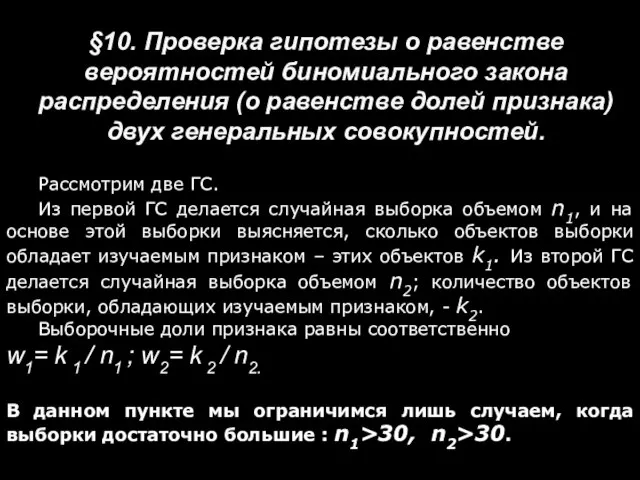

- 121. §10. Проверка гипотезы о равенстве вероятностей биномиального закона распределения (о равенстве долей признака) двух генеральных совокупностей.

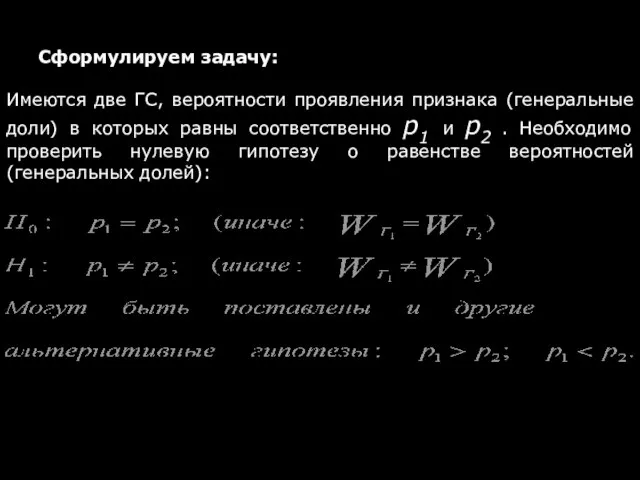

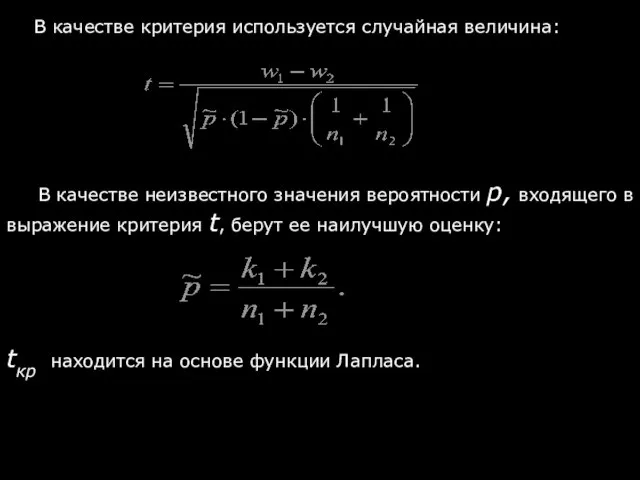

- 122. Сформулируем задачу: Имеются две ГС, вероятности проявления признака (генеральные доли) в которых равны соответственно p1 и

- 123. В качестве неизвестного значения вероятности р, входящего в выражение критерия t, берут ее наилучшую оценку: tкр

- 124. §11. Проверка гипотезы о значимости выборочного коэффициента корреляции Пирсона. Рассматривается двумерная нормально распределенная генеральная совокупность (X,Y),

- 125. Всегда проверяется нулевая гипотеза об отсутствии линейной корреляционной связи в ГС, а альтернатива заключается в предположении

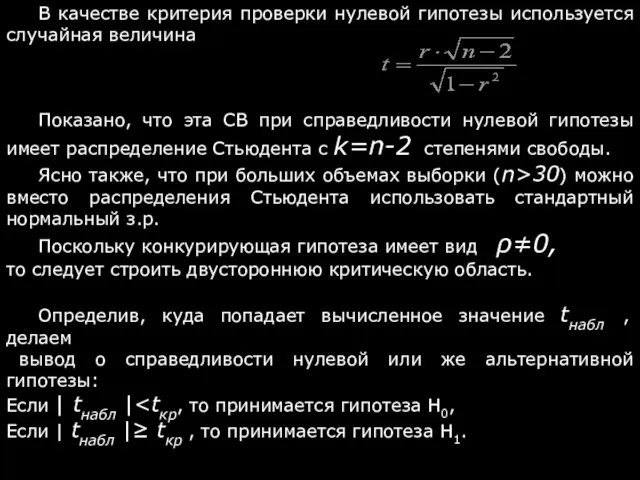

- 126. В качестве критерия проверки нулевой гипотезы используется случайная величина Показано, что эта СВ при справедливости нулевой

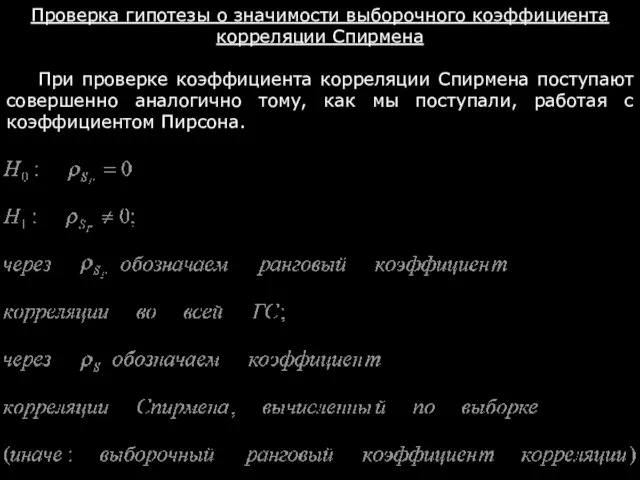

- 127. Проверка гипотезы о значимости выборочного коэффициента корреляции Спирмена При проверке коэффициента корреляции Спирмена поступают совершенно аналогично

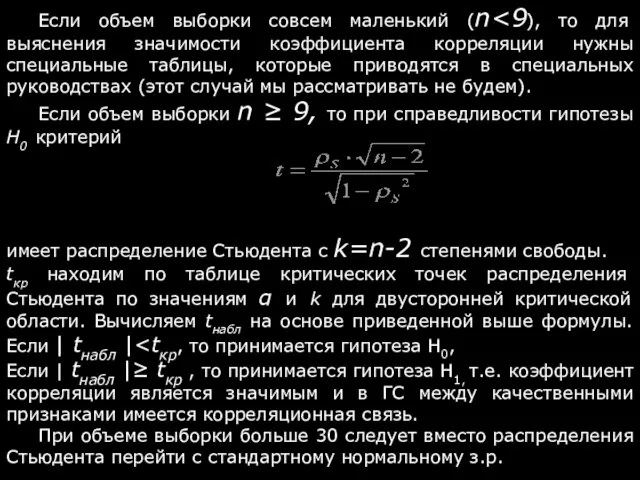

- 128. Если объем выборки совсем маленький (n Если объем выборки n ≥ 9, то при справедливости гипотезы

- 129. Критерий знаков не связан с заданием каких-то конкретных значений параметров распределения, и поэтому на основе этого

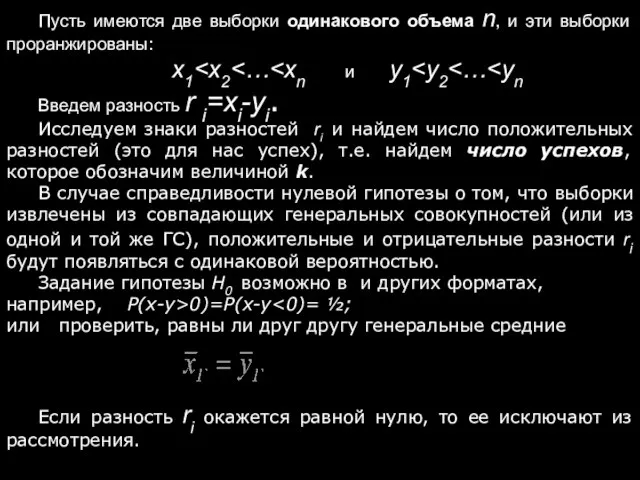

- 130. Пусть имеются две выборки одинакового объема n, и эти выборки проранжированы: x1 Введем разность r i=xi-yi.

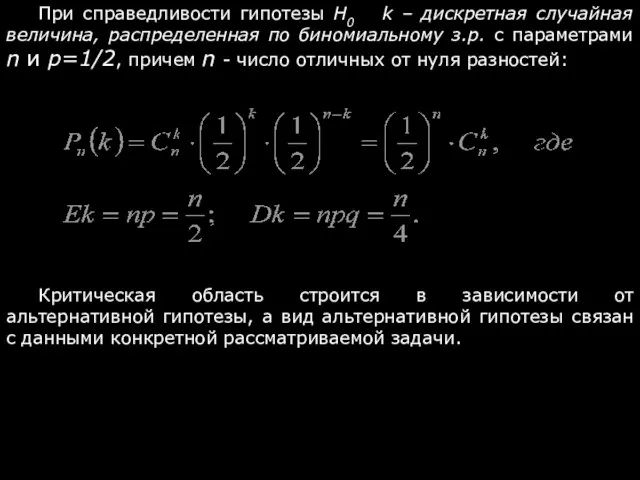

- 131. При справедливости гипотезы H0 k – дискретная случайная величина, распределенная по биномиальному з.р. с параметрами n

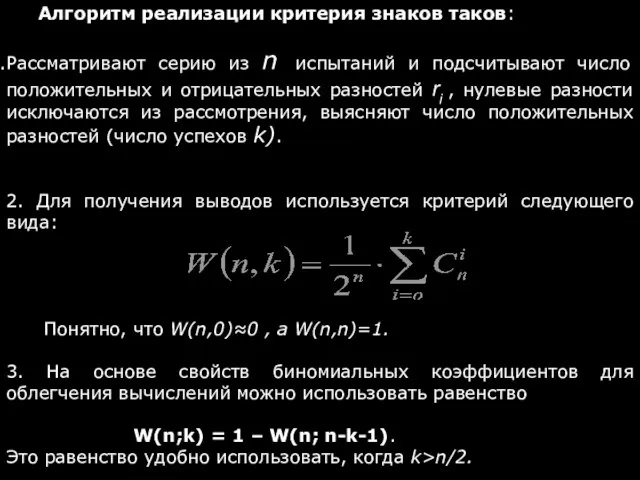

- 132. Алгоритм реализации критерия знаков таков: Рассматривают серию из n испытаний и подсчитывают число положительных и отрицательных

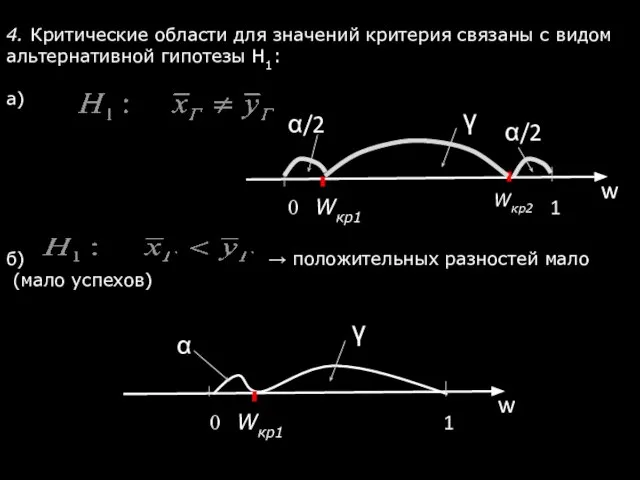

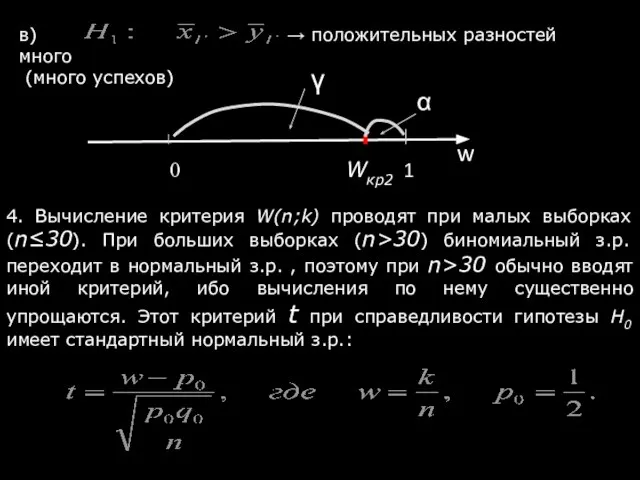

- 133. 4. Критические области для значений критерия связаны с видом альтернативной гипотезы H1: а) б) → положительных

- 134. в) → положительных разностей много (много успехов) 4. Вычисление критерия W(n;k) проводят при малых выборках (n≤30).

- 135. § 13. Шкалы измерений признаков. Ранее были рассмотрены признаки, измеряемые в количественных шкалах - в этом

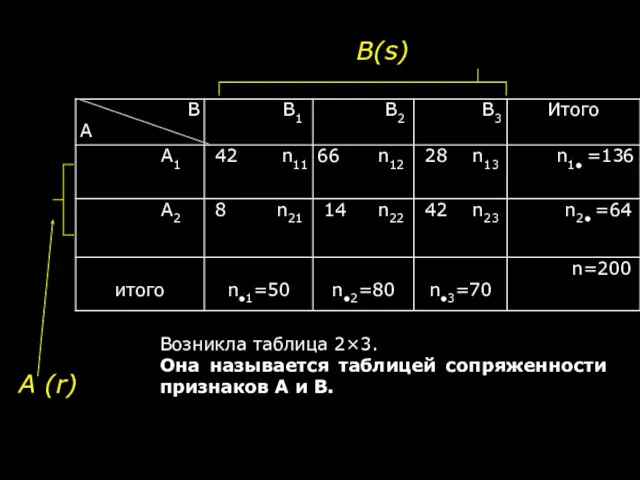

- 136. § 14. Связь номинальных признаков (таблицы сопряженности) Предположим, что признаки статистически независимы, тогда введем две гипотезы:

- 137. Возникла таблица 2×3. Она называется таблицей сопряженности признаков А и В.

- 138. Введем обозначения: i - номер строки (i=1,2,…,r) j- номер столбца (j=1,2,…,s) nij - частота события Ai∩Bj

- 139. Определение. Величины называются ожидаемыми или теоретическими частотами (имеется в виду ожидаемыми при выполнении гипотезы H0) При

- 140. Если равенства (*) примерно выполняются, то гипотезу H0 можно признать справедливой. Если же равенства (*) плохо

- 141. Теорема (К. Пирсон, Р. Фишер): Если справедлива гипотеза Н0, на основе которой рассчитаны теоретические частоты Т,

- 142. Как было сказано, распределение χ2 является предельным для СВ Х2 , поэтому использовать его как приближение

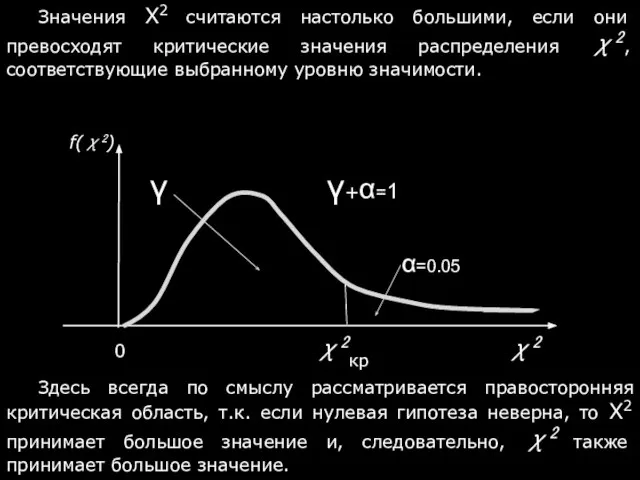

- 143. Значения Х2 считаются настолько большими, если они превосходят критические значения распределения χ2, соответствующие выбранному уровню значимости.

- 144. Коэффициенты для вычисления тесноты связи между номинальными признаками: Коэффициент «фи» Коэффициент взаимной сопряженности Пирсона

- 146. Скачать презентацию

Взаимное расположение графиков линейных функций. 7 класс.

Взаимное расположение графиков линейных функций. 7 класс.  Презентация по математике "Треугольники" - скачать

Презентация по математике "Треугольники" - скачать  Ребусы. Математика, 5 класс

Ребусы. Математика, 5 класс Преобразование временных рядов в последовательности гистограмм как метод получения космофизической информации

Преобразование временных рядов в последовательности гистограмм как метод получения космофизической информации Путешествие к острову натуральных чисел. 5 класс

Путешествие к острову натуральных чисел. 5 класс Число та цифра 5

Число та цифра 5 Теория графов

Теория графов Счёт в пределах ста

Счёт в пределах ста Диофантовы уравнения

Диофантовы уравнения Уравнение окружности

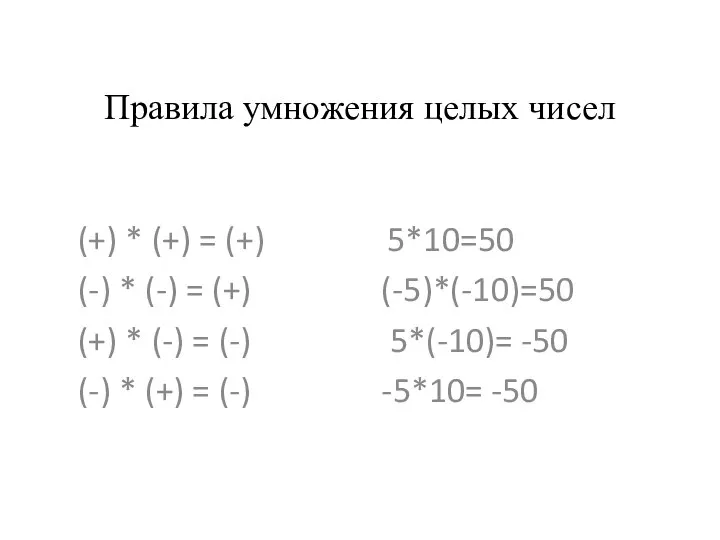

Уравнение окружности Правила умножения целых чисел

Правила умножения целых чисел Математическая логика

Математическая логика Презентация по математике "Сложение отрицательных чисел и чисел с разными знаками" - скачать

Презентация по математике "Сложение отрицательных чисел и чисел с разными знаками" - скачать  Задача оптимизации. Проектные параметры

Задача оптимизации. Проектные параметры Движение в одном направлении

Движение в одном направлении Моделирование информационных систем

Моделирование информационных систем Тригонометрические уравнения. Задания для устного счета

Тригонометрические уравнения. Задания для устного счета Смежные углы

Смежные углы Абсолютные и относительные показатели

Абсолютные и относительные показатели Математичні моделі та методи теорії портфеля

Математичні моделі та методи теорії портфеля Сравнение чисел. Урок математики в 6 классе

Сравнение чисел. Урок математики в 6 классе Теорема Пифагора

Теорема Пифагора Чтение таблиц. Извлечение необходимой информации из таблиц

Чтение таблиц. Извлечение необходимой информации из таблиц «Вредная задача»

«Вредная задача» События. 5 класс. Учебник Зубаревой

События. 5 класс. Учебник Зубаревой Раскрытие скобок

Раскрытие скобок Уравнения. 5 класс

Уравнения. 5 класс Комбинаторика элементтері

Комбинаторика элементтері