Содержание

- 2. Однако, когда зависимая переменная отличается, этого делать нельзя. 2 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК

- 3. В случае линейной модели, R2 измеряет долю дисперсии в Y, объясненную моделью. В случае полулогарифмической модели

- 4. Очевидно, что они связаны, но они не совпадают, поэтому прямые сравнения бессмысленны. 4 СРАВНЕНИЕ ЛИНЕЙНЫХ И

- 5. Однако доброкачественность моделей с линейной и логарифмической версиями одной и той же зависимой переменной можно сравнить

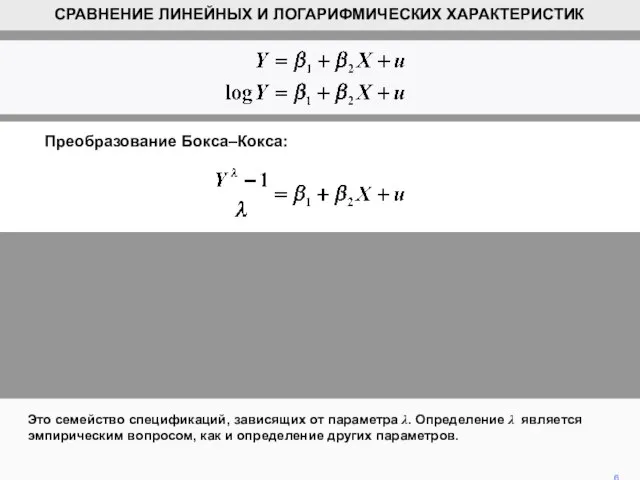

- 6. Это семейство спецификаций, зависящих от параметра λ. Определение λ является эмпирическим вопросом, как и определение других

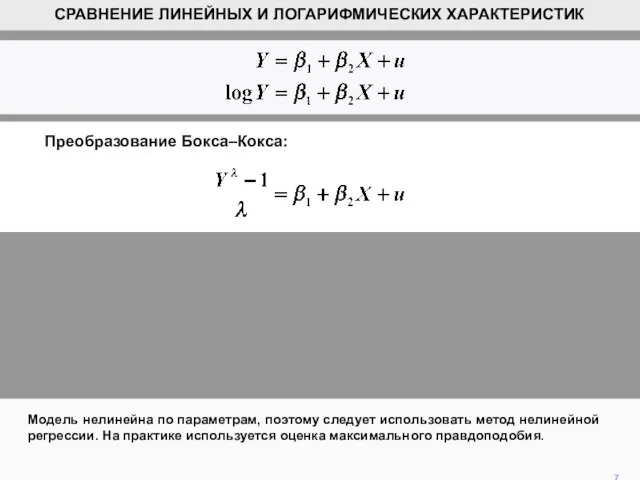

- 7. Модель нелинейна по параметрам, поэтому следует использовать метод нелинейной регрессии. На практике используется оценка максимального правдоподобия.

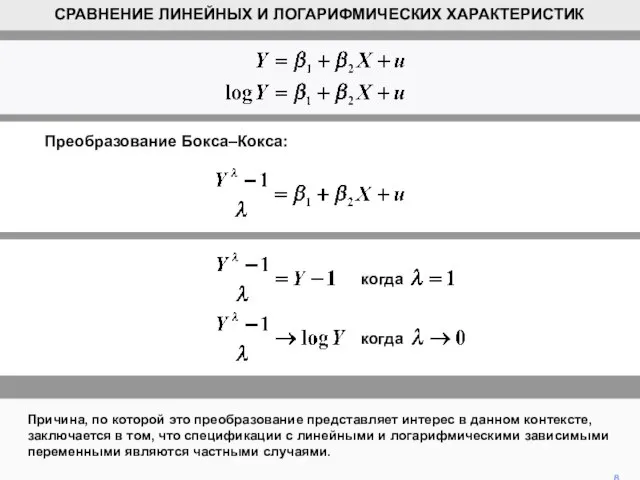

- 8. 8 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК Причина, по которой это преобразование представляет интерес в данном контексте,

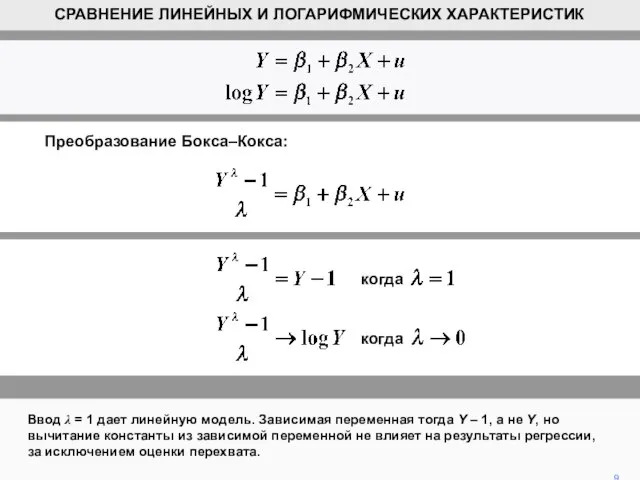

- 9. 9 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК Ввод λ = 1 дает линейную модель. Зависимая переменная тогда

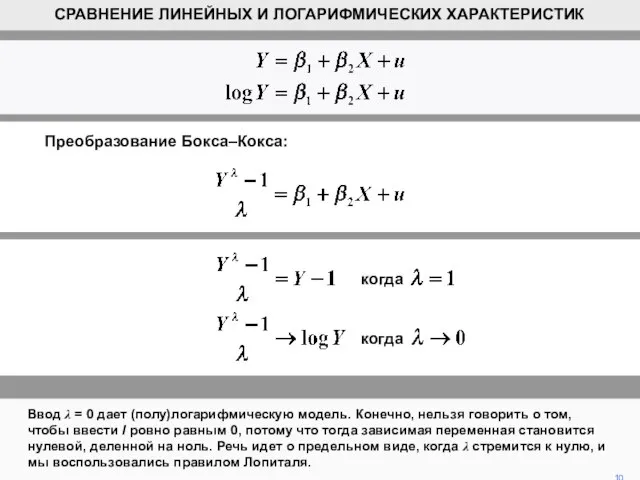

- 10. 10 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК Ввод λ = 0 дает (полу)логарифмическую модель. Конечно, нельзя говорить

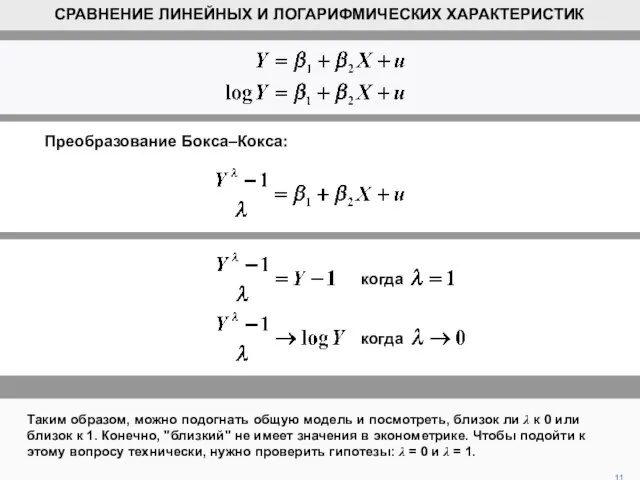

- 11. 11 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК Таким образом, можно подогнать общую модель и посмотреть, близок ли

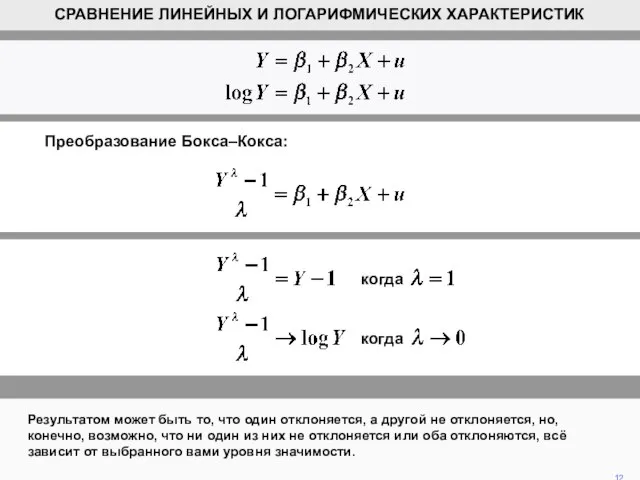

- 12. Результатом может быть то, что один отклоняется, а другой не отклоняется, но, конечно, возможно, что ни

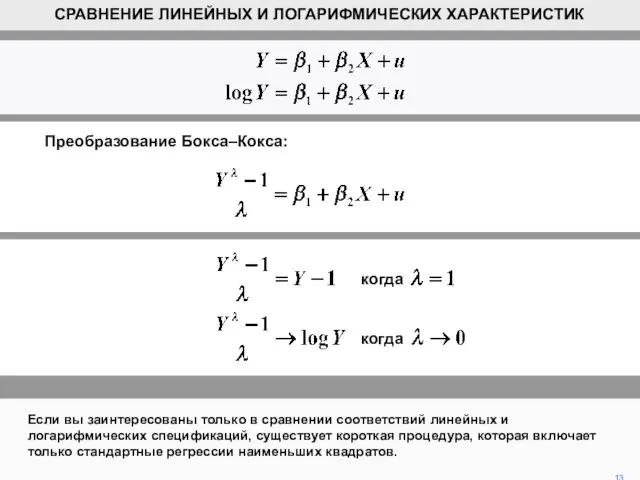

- 13. когда когда 13 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК Преобразование Бокса–Кокса: Если вы заинтересованы только в сравнении

- 14. Первый шаг - разделить наблюдения по зависимой переменной на их среднее геометрическое. Будем называть преобразованную переменную

- 15. Теперь вы регрессируете Y* и logeY*, оставляя правую часть уравнения без изменений. (Параметрам были даны простые

- 16. Остаточные суммы квадратов теперь прямо сопоставимы. Таким образом, спецификация с меньшим RSS обеспечивает лучшую подгонку. 16

- 17. среднее геометрическое Y Мы будем использовать преобразование для сравнения приступов линейной и полулогарифмической версий простого уравнения

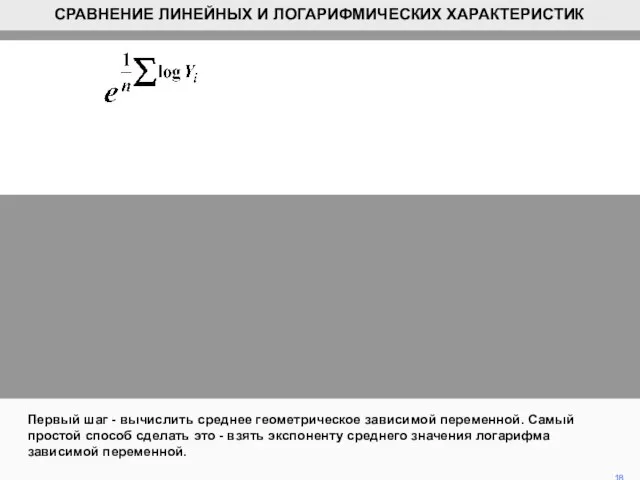

- 18. Первый шаг - вычислить среднее геометрическое зависимой переменной. Самый простой способ сделать это - взять экспоненту

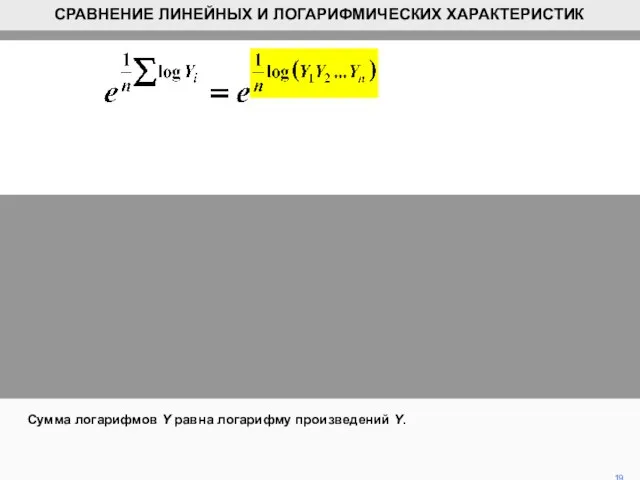

- 19. Сумма логарифмов Y равна логарифму произведений Y. 19 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК

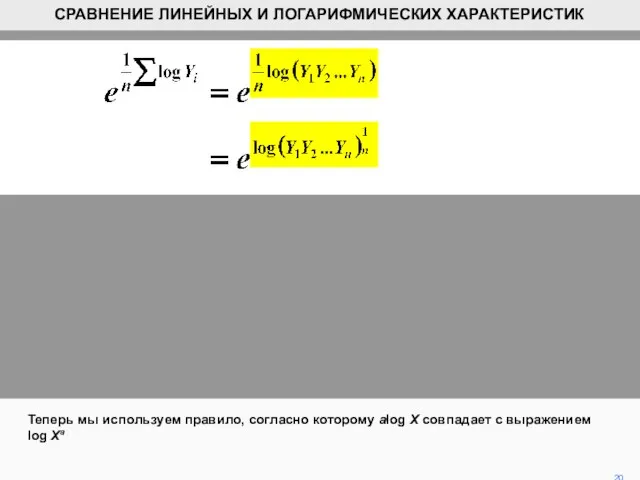

- 20. Теперь мы используем правило, согласно которому alog X совпадает с выражением log Xa 20 СРАВНЕНИЕ ЛИНЕЙНЫХ

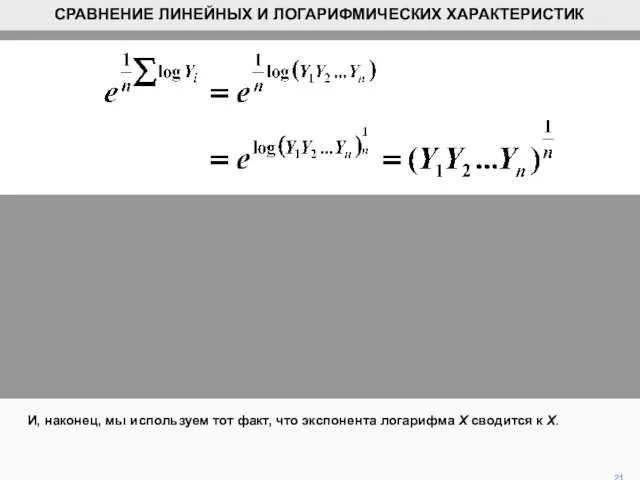

- 21. И, наконец, мы используем тот факт, что экспонента логарифма X сводится к X. 21 СРАВНЕНИЕ ЛИНЕЙНЫХ

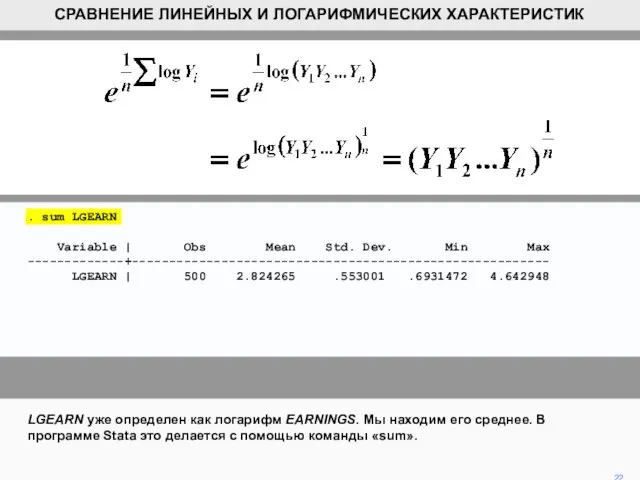

- 22. LGEARN уже определен как логарифм EARNINGS. Мы находим его среднее. В программе Stata это делается с

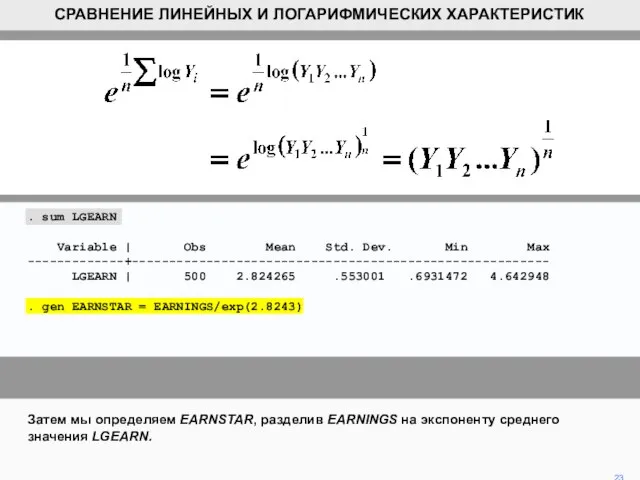

- 23. Затем мы определяем EARNSTAR, разделив EARNINGS на экспоненту среднего значения LGEARN. 23 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ

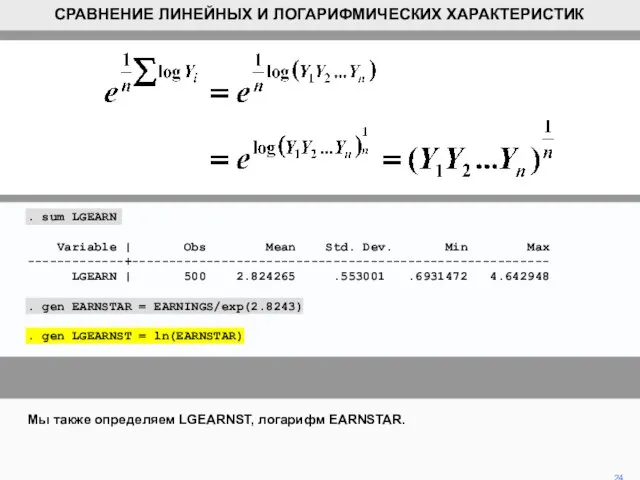

- 24. Мы также определяем LGEARNST, логарифм EARNSTAR. 24 СРАВНЕНИЕ ЛИНЕЙНЫХ И ЛОГАРИФМИЧЕСКИХ ХАРАКТЕРИСТИК . sum LGEARN Variable

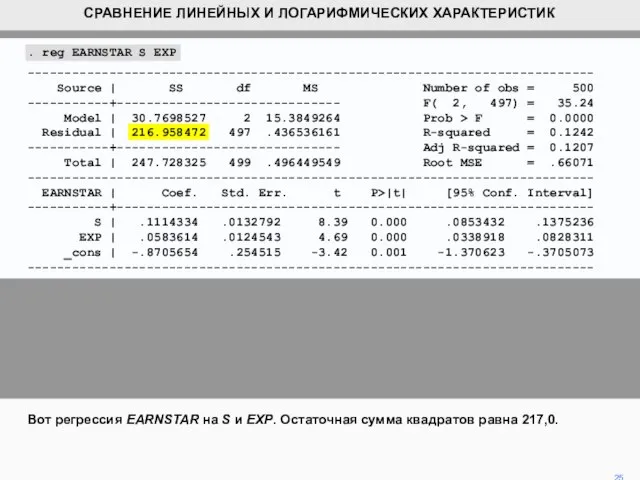

- 25. . reg EARNSTAR S EXP ---------------------------------------------------------------------------- Source | SS df MS Number of obs = 500

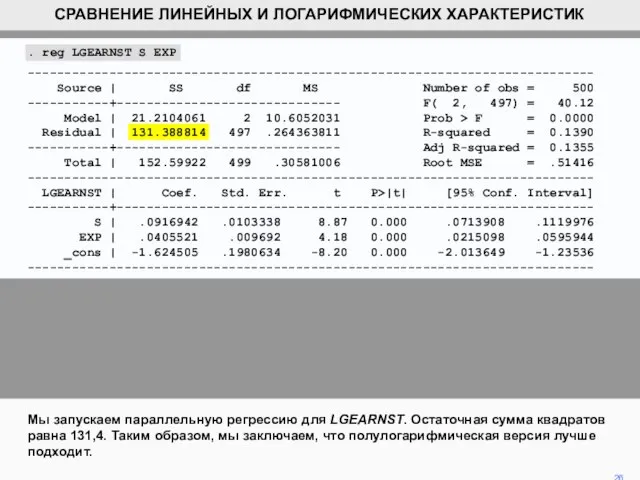

- 26. Мы запускаем параллельную регрессию для LGEARNST. Остаточная сумма квадратов равна 131,4. Таким образом, мы заключаем, что

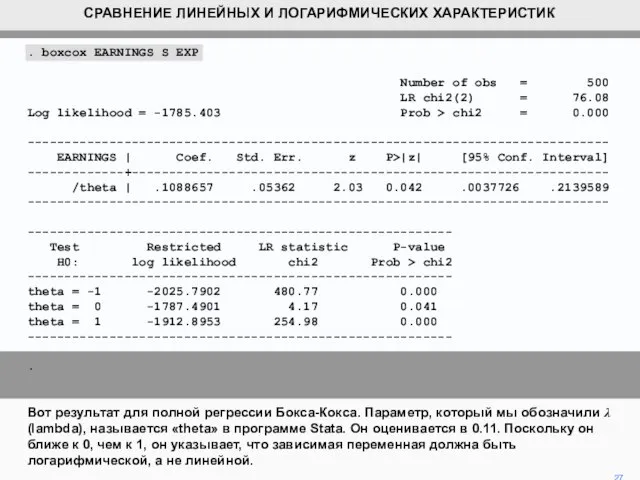

- 27. . boxcox EARNINGS S EXP Number of obs = 500 LR chi2(2) = 76.08 Log likelihood

- 29. Скачать презентацию

Лесная школа. Игра-тренажёр. Математика для детей 5-7 лет

Лесная школа. Игра-тренажёр. Математика для детей 5-7 лет Сложение вида +8, +9

Сложение вида +8, +9 Пирамида

Пирамида Параллельные прямые

Параллельные прямые Презентация по математике "Умножение десятичных дробей на натуральные числа" - скачать бесплатно

Презентация по математике "Умножение десятичных дробей на натуральные числа" - скачать бесплатно Понятие об отображении. Образ и прообраз, биекция

Понятие об отображении. Образ и прообраз, биекция Тригонометрические неравенства

Тригонометрические неравенства Логарифмические уравнения. Задания для устного счета

Логарифмические уравнения. Задания для устного счета Параллелограмм

Параллелограмм Измерение высоты здания основываясь на правилах подобия треугольников

Измерение высоты здания основываясь на правилах подобия треугольников Машинки от 0 до 10

Машинки от 0 до 10 Решение уравнений

Решение уравнений 20161016_delenie_s_ostatkom_14.10.2016

20161016_delenie_s_ostatkom_14.10.2016 Функция y = sin x, ее свойства и график

Функция y = sin x, ее свойства и график Комбинаторика

Комбинаторика Правильные и неправильные дроби

Правильные и неправильные дроби Аналіз показників розвитку фінансової системи

Аналіз показників розвитку фінансової системи Разложение вектора по двум неколлинеарным векторам. Координаты вектора

Разложение вектора по двум неколлинеарным векторам. Координаты вектора Викторина по математике

Викторина по математике 5 класс _

5 класс _ Первое знакомство с понятием вероятность. Урок 146

Первое знакомство с понятием вероятность. Урок 146 ОГЭ - 2016. Открытый банк заданий по математике. Модуль «Геометрия»

ОГЭ - 2016. Открытый банк заданий по математике. Модуль «Геометрия» Какой я человек. Интеллектуальная разминка

Какой я человек. Интеллектуальная разминка Приём письменного деления на однозначное число с переходом через десяток. 3 класс

Приём письменного деления на однозначное число с переходом через десяток. 3 класс Диаметр окружности

Диаметр окружности Презентация по математике "Область определения функции" - скачать

Презентация по математике "Область определения функции" - скачать  Тренажёр. Единицы измерения

Тренажёр. Единицы измерения Задачи военно-прикладного характера Вклад ученых математиков в оборонную мощь страны во время Великой Отечественной войны.

Задачи военно-прикладного характера Вклад ученых математиков в оборонную мощь страны во время Великой Отечественной войны.