Содержание

- 2. Теория нейронных сетей: предмет Хорошо известно, что человеческий мозг по своим возможностям далеко превосходит обычные компьютеры

- 3. Cтроение биологического нейрона Нервная система и мозг человека состоят из нейронов, соединенных между собой нервными волокнами.

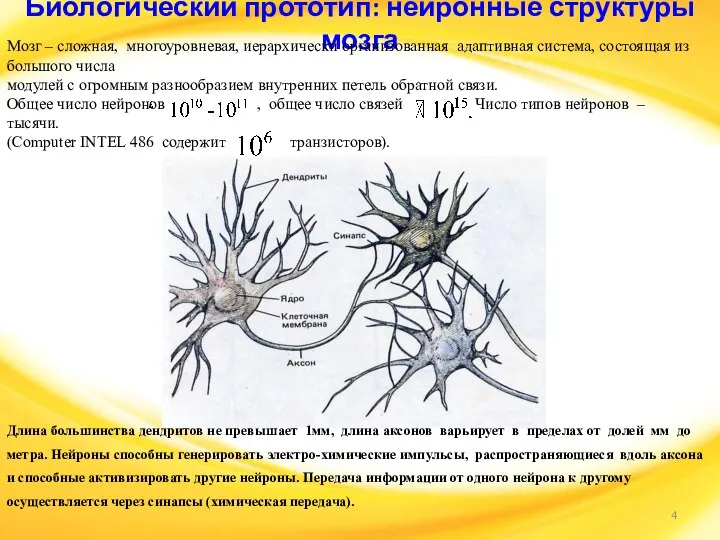

- 4. Биологический прототип: нейронные структуры мозга Мозг – сложная, многоуровневая, иерархически организованная адаптивная система, состоящая из большого

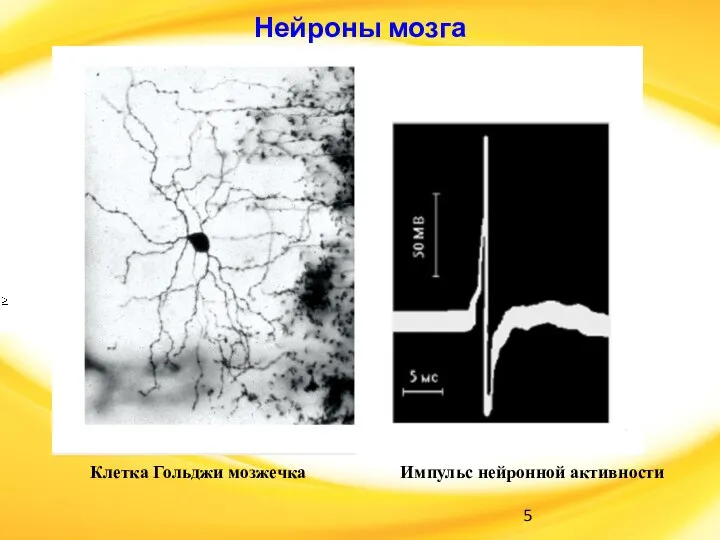

- 5. Нейроны мозга Клетка Гольджи мозжечка Импульс нейронной активности

- 6. Биологический нейрон

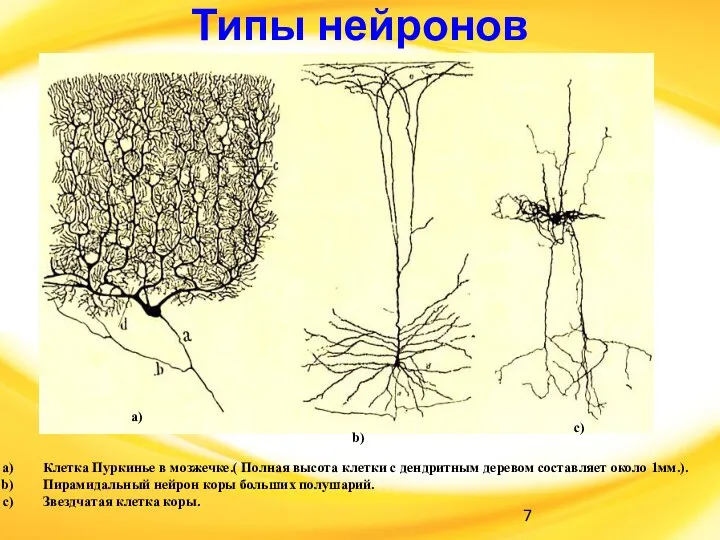

- 7. Типы нейронов a) b) c) Клетка Пуркинье в мозжечке.( Полная высота клетки с дендритным деревом составляет

- 8. Нейроны зрительной коры мозга Пирамидальные нейроны первичной зрительной коры обезьяны (использована окраска по Гольджи, при которой

- 9. Типы синапсов

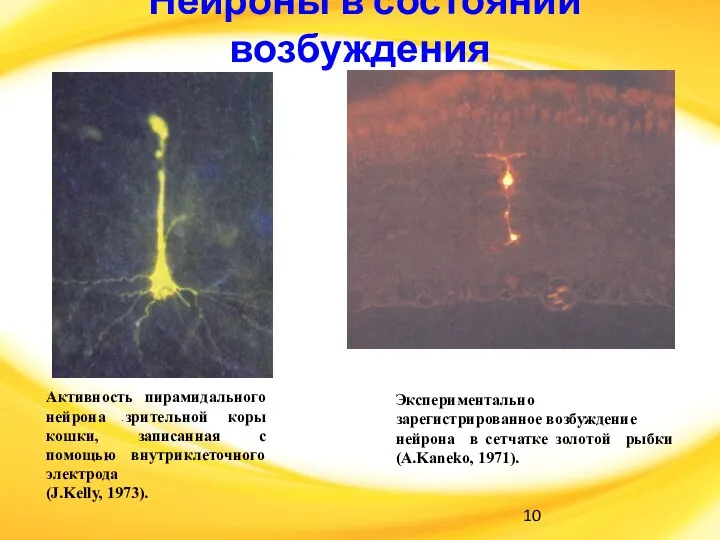

- 10. Нейроны в состоянии возбуждения . Активность пирамидального нейрона зрительной коры кошки, записанная с помощью внутриклеточного электрода

- 11. Биологический нейрон Передача импульса Дендриты Например, могут быть присоединены к рецепторам Аксон Может быть присоединен к

- 12. Биологические нейронные сети 1872-1895 гг. Понятие нейрона и нейронной сети; Первые предположения о принципе работы;

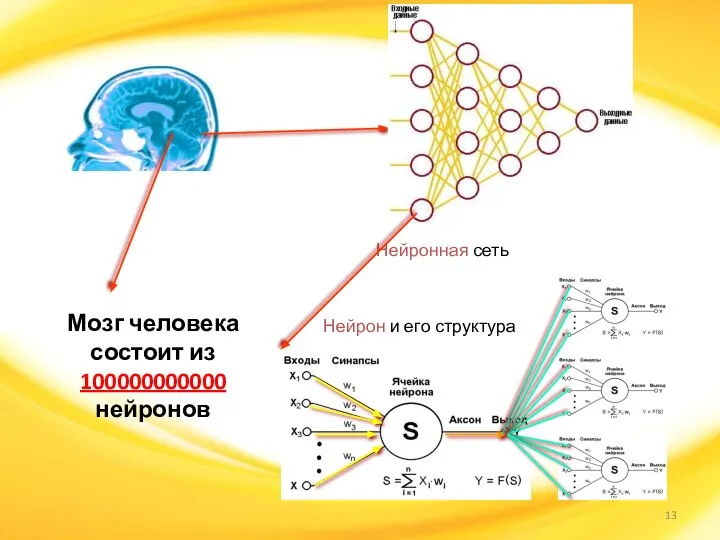

- 13. Нейронная сеть Нейрон и его структура Мозг человека состоит из 100000000000 нейронов

- 14. Нейронная сеть Совокупность соединенных между собой нейронов; Сеть осуществляет преобразование входного сигнала с рецепторов в выходной,

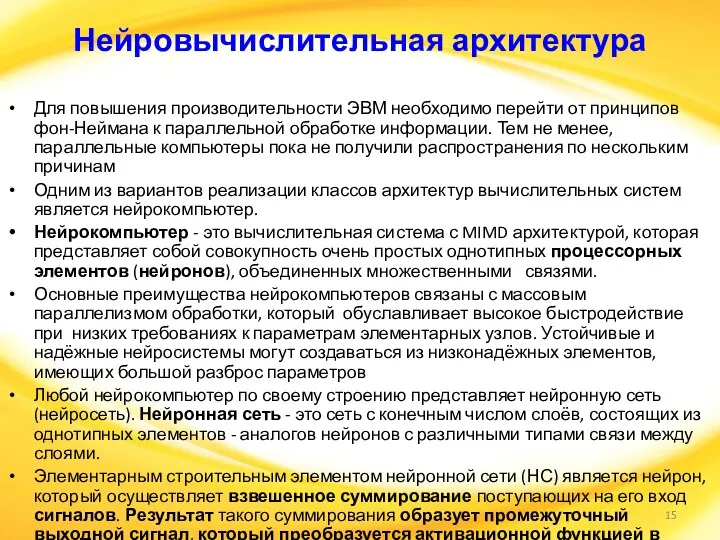

- 15. Нейровычислительная архитектура Для повышения производительности ЭВМ необходимо перейти от принципов фон-Неймана к параллельной обработке информации. Тем

- 16. Нейронные сети Предпосылка: Известно, что биологические системы (люди, животные) прекрасно справляются со сложными задачами распознавания образов;

- 17. Искусственные нейронные сети Искусственная нейронная сеть – массивный параллельный распределенный процессор, в котором заложены возможности для

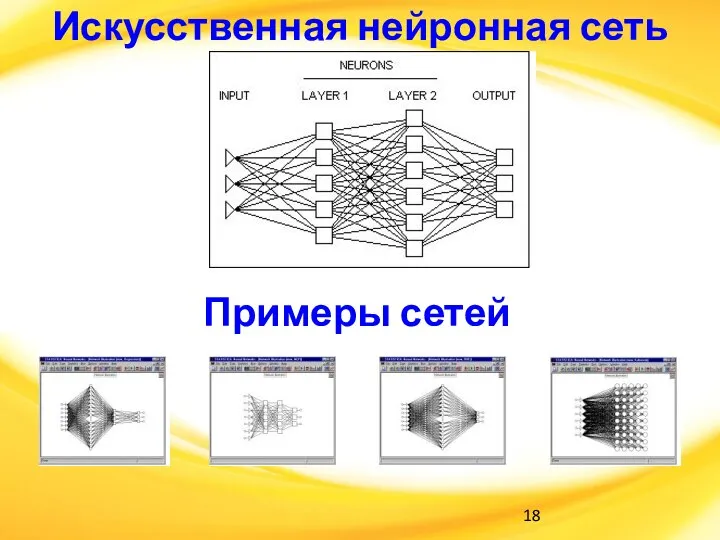

- 18. Примеры сетей Искусственная нейронная сеть

- 19. Применение нейронных сетей

- 20. Области применения Распознавание образов Оценка кредитного риска Прогнозирование финансовых потоков и объемов продаж Маркетинговые исследования Медицинская

- 21. Пример применения: прогнозирование цен на нефть Временной ряд имеет значительную хаотическую составляющую, что не позволяет выделить

- 22. Пример применения: результаты прогнозирования Построен прогноз на 30 дней вперед по 90 предыдущим наблюдениям Максимальная ошибка

- 23. Решаемые задачи Задачи, успешно решаемые НС на данном этапе их развития: формирование моделей и различных нелинейных

- 24. Задачи, решаемые с помощью ИНС

- 25. Преимущества нейронных сетей Предлагают стандартные способы решения многих нестандартных задач. Явное описание модели заменяется созданием «образовательной

- 26. Преимущества нейронных сетей Кроме этого, применение НС обеспечивает следующие полезные свойства: 1. Способность к обобщению. Под

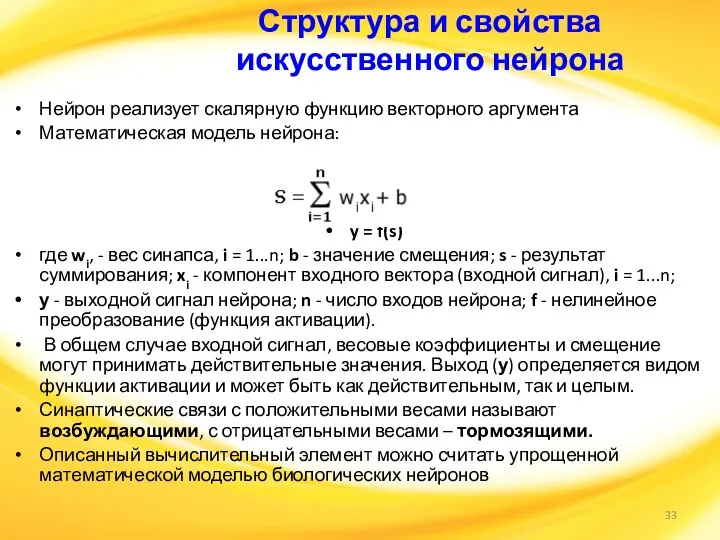

- 27. Структура и свойства искусственного нейрона Нейрон состоит из элементов трех типов: умножителей (синапсов), сумматора и нелинейного

- 28. Основные понятия Рисунок 1. Математическая модель нейрона X –Входы, группа синапсов W-Вес синаптической связи S -Текущее

- 29. Нейронный элемент

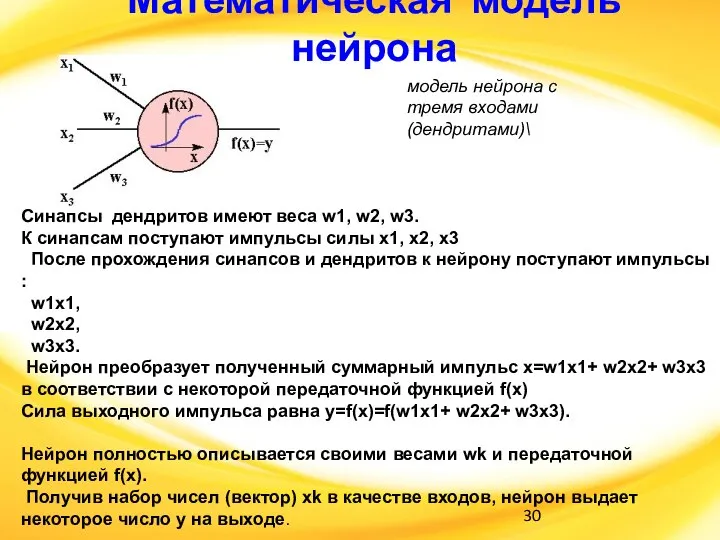

- 30. Математическая модель нейрона Синапсы дендритов имеют веса w1, w2, w3. К синапсам поступают импульсы силы x1,

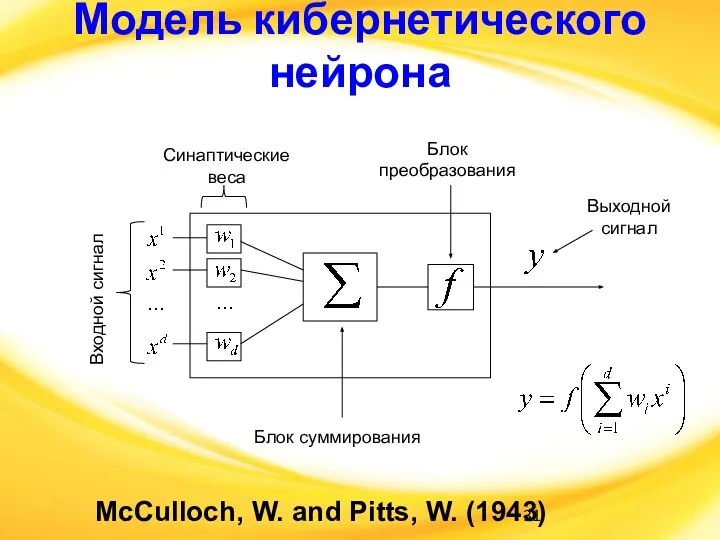

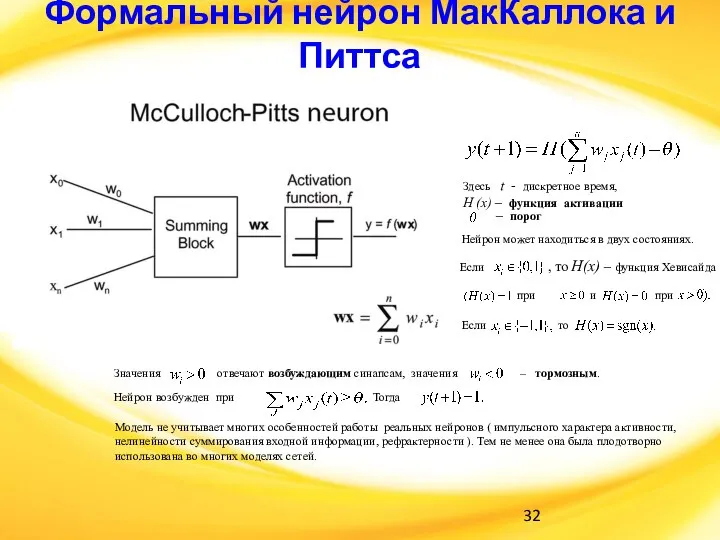

- 31. Модель кибернетического нейрона McCulloch, W. and Pitts, W. (1943) Входной сигнал Синаптические веса Блок суммирования Блок

- 32. Формальный нейрон МакКаллока и Питтса . Модель не учитывает многих особенностей работы реальных нейронов ( импульсного

- 33. Структура и свойства искусственного нейрона Нейрон реализует скалярную функцию векторного аргумента Математическая модель нейрона: y =

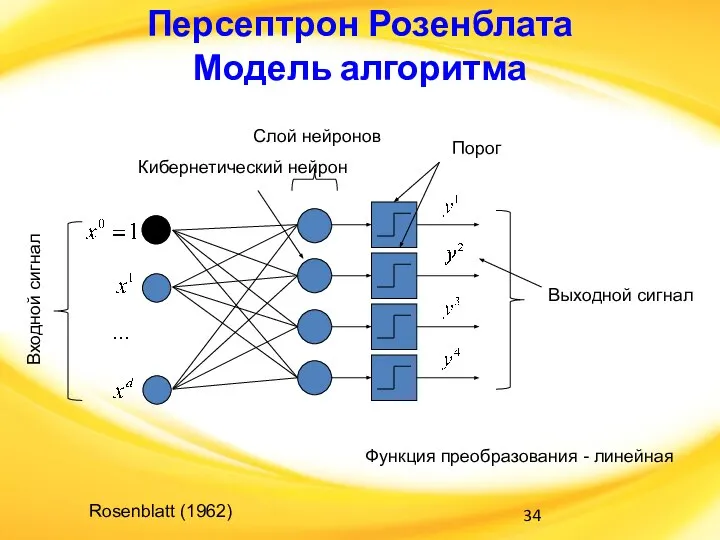

- 34. Персептрон Розенблата Модель алгоритма Входной сигнал Слой нейронов Функция преобразования - линейная Порог Выходной сигнал Кибернетический

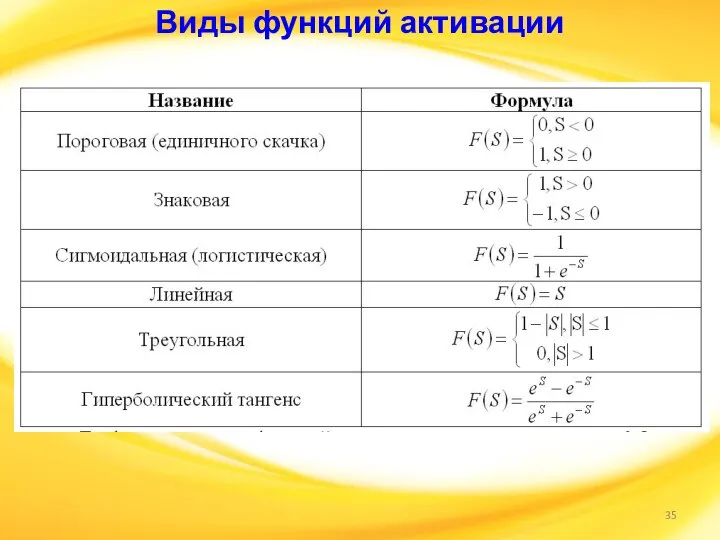

- 35. Виды функций активации

- 36. Виды функций активации

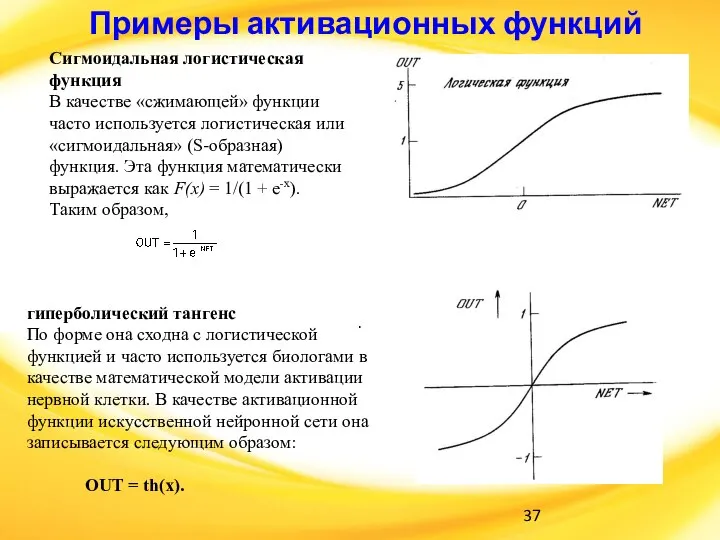

- 37. Примеры активационных функций Сигмоидальная логистическая функция В качестве «сжимающей» функции часто используется логистическая или «сигмоидальная» (S-образная)

- 38. Синтез нейронных сетей В зависимости от функций, выполняемых нейронами в сети, можно выделить три типа нейронов:

- 39. Топологии различных архитектур НС: а – полносвязная сеть; б– многослойная (слоистая) сеть; в – слабосвязные сети

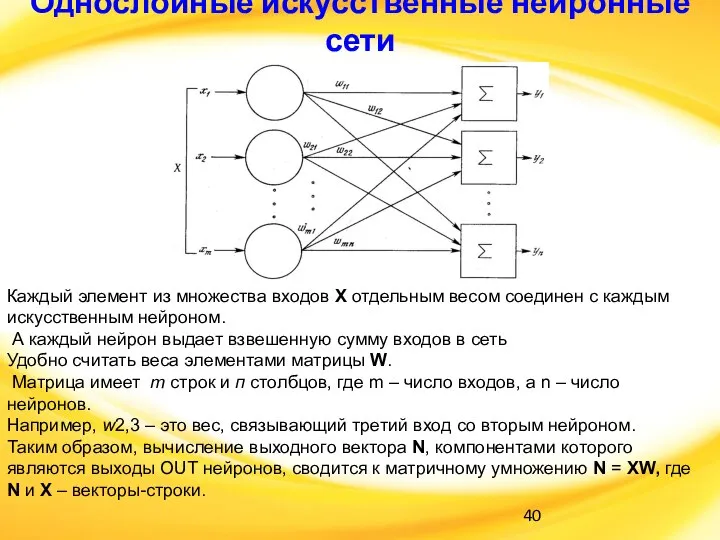

- 40. Однослойные искусственные нейронные сети Каждый элемент из множества входов Х отдельным весом соединен с каждым искусственным

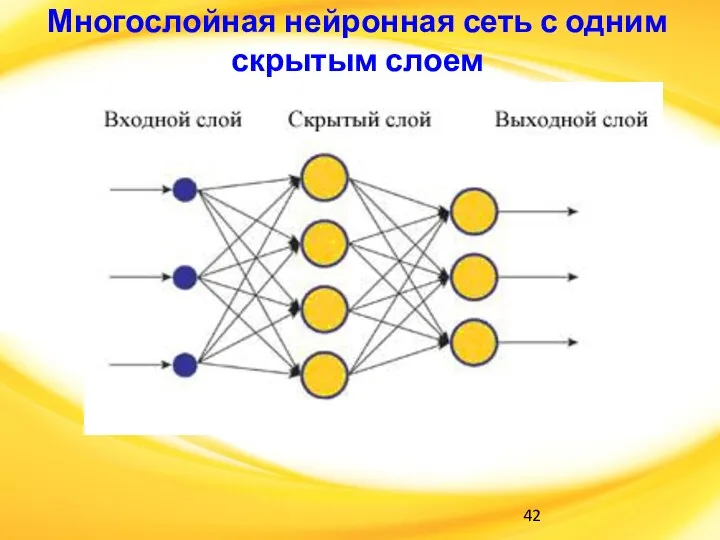

- 41. Многослойные искусственные нейронные сети Более крупные и сложные нейронные сети обладают, как правило, и большими вычислительными

- 42. Многослойная нейронная сеть с одним скрытым слоем

- 43. Обобщенная структура многослойной сигмоидальной НС

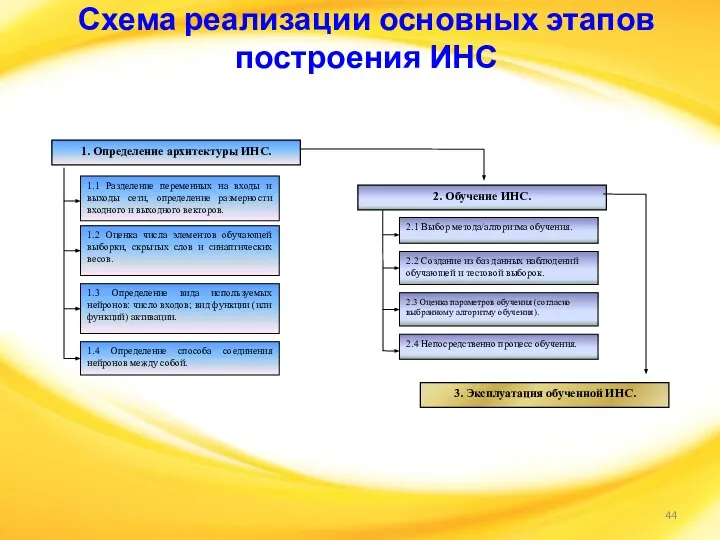

- 44. Схема реализации основных этапов построения ИНС

- 45. Как построить нейронную сеть 2 этапа: Выбор типа (архитектуры) нейронной сети. какие нейроны мы хотим использовать

- 46. Выбор количества нейронов и слоев Количество нейронов и слоев связано: 1) со сложностью задачи; 2) с

- 47. Подготовка входных и выходных данных Данные, подаваемые на вход сети и снимаемые с выхода, должны быть

- 48. Обучение сети Процесс функционирования НС зависит от величин синаптических связей, поэтому, задавшись определенной структурой НС, отвечающей

- 49. Обучение сети Алгоритмы обучения делятся на два больших класса: детерминистские и стохастические. В первом из них

- 50. Обучение нейронной сети

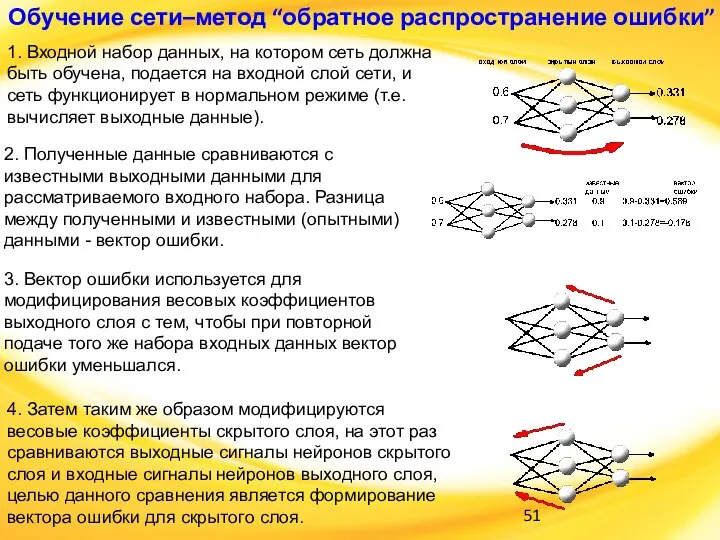

- 51. Обучение сети–метод “обратное распространение ошибки” 1. Входной набор данных, на котором сеть должна быть обучена, подается

- 53. Скачать презентацию

Дисциплина. Мотивация. Оптимизация времени

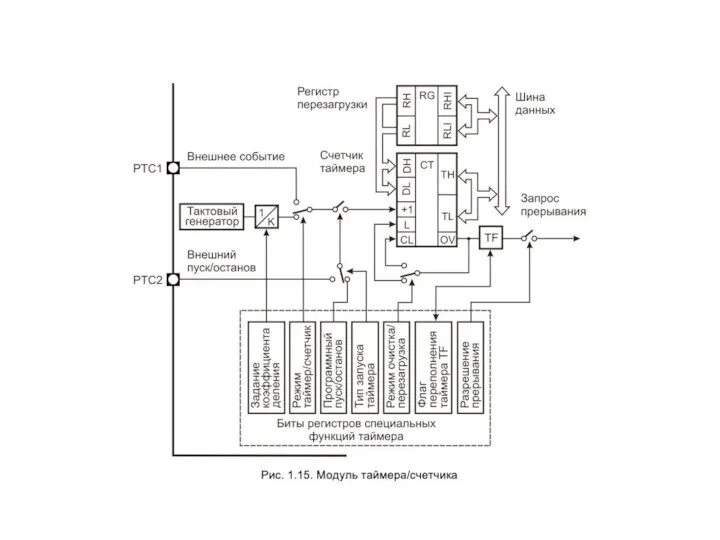

Дисциплина. Мотивация. Оптимизация времени МПСУ 2-3

МПСУ 2-3 Развитие русской портретной живописи

Развитие русской портретной живописи Программные средства эконометрического анализа и прогнозирования

Программные средства эконометрического анализа и прогнозирования Жұдырықшалы механизмдерді жіктеу

Жұдырықшалы механизмдерді жіктеу Удосконалення системи управління персоналом підприємства

Удосконалення системи управління персоналом підприємства Языки программирования

Языки программирования Действие магнитного поля на проводник с током. Сила Ампера

Действие магнитного поля на проводник с током. Сила Ампера Казахские национальные игры

Казахские национальные игры Современный компьютер. Перспективы развития

Современный компьютер. Перспективы развития Понятие и классификация субъектов налогового права Выполнила: студентка группы Ю-104, Панова Екатерина.

Понятие и классификация субъектов налогового права Выполнила: студентка группы Ю-104, Панова Екатерина. Выйдя на улицу, юный пешеход должен вежливо передвигаться только по тротуару или обочине! - презентация

Выйдя на улицу, юный пешеход должен вежливо передвигаться только по тротуару или обочине! - презентация Презентация на тему "Воспитательная система МБОУ «Каратузская СОШ»" - скачать презентации по Педагогике

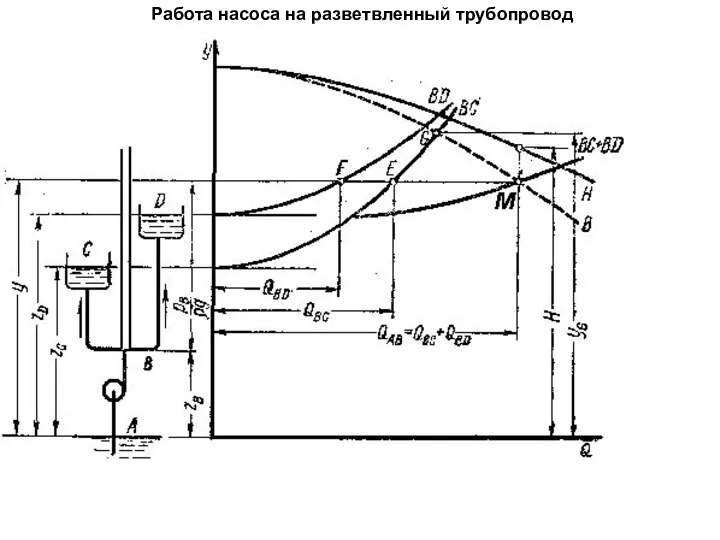

Презентация на тему "Воспитательная система МБОУ «Каратузская СОШ»" - скачать презентации по Педагогике насос в сети

насос в сети  Начертательная геометрия. Краткий курс

Начертательная геометрия. Краткий курс Презентация "Экономика Франции" - скачать презентации по Экономике

Презентация "Экономика Франции" - скачать презентации по Экономике Ukrainian traditions

Ukrainian traditions Презентация на тему "Профильная и предпрофильная подготовка учащихся" - скачать презентации по Педагогике

Презентация на тему "Профильная и предпрофильная подготовка учащихся" - скачать презентации по Педагогике ОСНОВНЫЕ АВТОРСКИЕ ПЕДАГОГИЧЕСКИЕ СИСТЕМЫ ПРОШЛОГО

ОСНОВНЫЕ АВТОРСКИЕ ПЕДАГОГИЧЕСКИЕ СИСТЕМЫ ПРОШЛОГО Государственное управление в области техносферной безопасности

Государственное управление в области техносферной безопасности Editing and proofreading

Editing and proofreading Мова і мовлення

Мова і мовлення Кейс – метод как педагогическая технология Никитин Валерий Яковлевич, д.п.н., профессор

Кейс – метод как педагогическая технология Никитин Валерий Яковлевич, д.п.н., профессор Искусство Древней Греции Афинский Акрополь

Искусство Древней Греции Афинский Акрополь  Основы метрологии и технического регулирования

Основы метрологии и технического регулирования Инженерные системы зданий и сооружений

Инженерные системы зданий и сооружений СОЗДАНИЕ КУЛЬТУРНОЙ СРЕДЫ ПРИ ОБУЧЕНИИ МЛАДШИХ ШКОЛЬНИКОВ ИНОСТРАННОМУ ЯЗЫКУ

СОЗДАНИЕ КУЛЬТУРНОЙ СРЕДЫ ПРИ ОБУЧЕНИИ МЛАДШИХ ШКОЛЬНИКОВ ИНОСТРАННОМУ ЯЗЫКУ Политическая система и политический режим

Политическая система и политический режим