Виды искусственных нейронных сетей и способы организации их обучения и функционирования. Лекция 17-18

Содержание

- 2. ПЕРСЕПТРОН Розенблатта Одной из первых искусственных сетей, способных к перцепции (восприятию) и формированию реакции на воспринятый

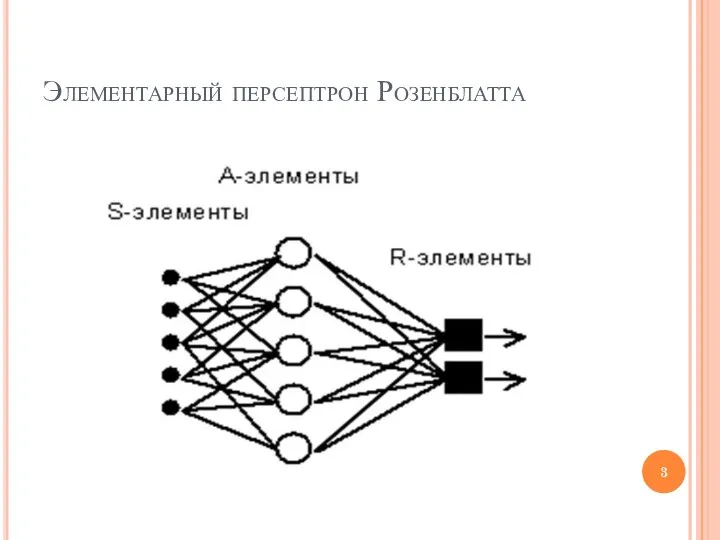

- 3. Элементарный персептрон Розенблатта

- 4. Обучение сети Обучение сети состоит в подстройке весовых коэффициентов каждого нейрона. Пусть имеется набор пар векторов

- 5. Предложенный Ф.Розенблаттом метод обучения состоит в итерационной подстройке матрицы весов, последовательно уменьшающей ошибку в выходных векторах.

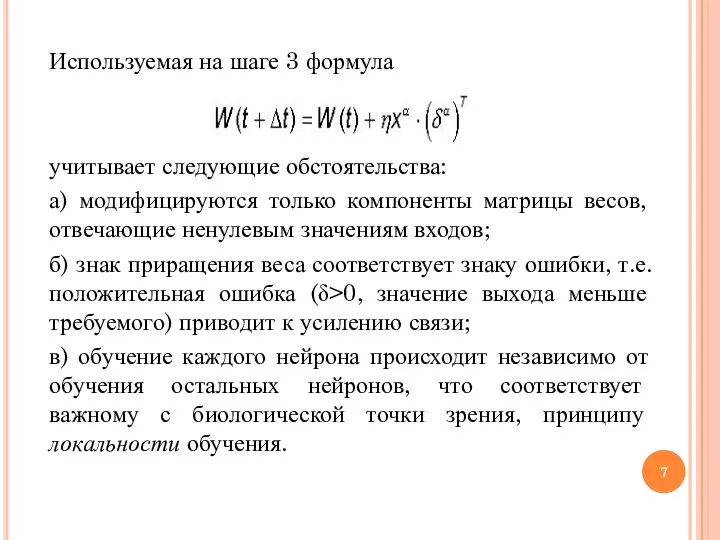

- 7. Используемая на шаге 3 формула учитывает следующие обстоятельства: а) модифицируются только компоненты матрицы весов, отвечающие ненулевым

- 8. Данный метод обучения был назван Ф. Розенблаттом “методом коррекции с обратной передачей сигнала ошибки”. Позднее более

- 9. Элементарный персептрон Розенблатта Однако, как было показано позднее (M.Minsky, S.Papert, 1969), этот вывод оказался неточным: Были

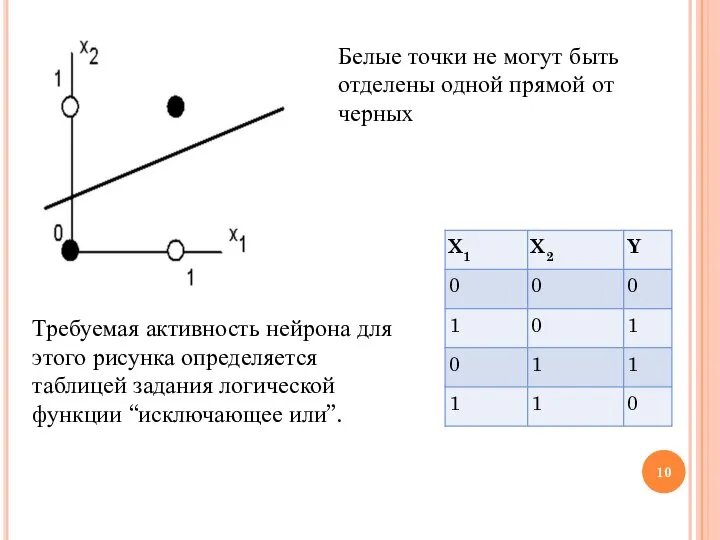

- 10. Белые точки не могут быть отделены одной прямой от черных Требуемая активность нейрона для этого рисунка

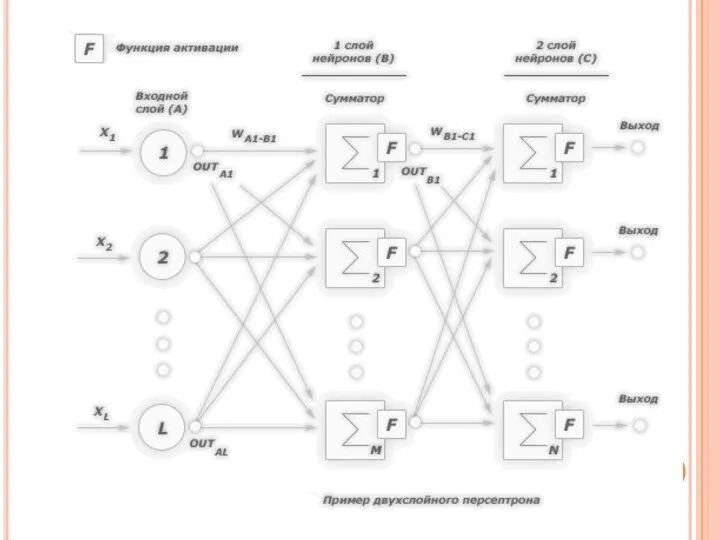

- 12. Многослойный персептрон Многослойными персептронами называют нейронные сети прямого распространения. Входной сигнал в таких сетях распространяется в

- 13. Основное прикладное значение этого класса сетей состоит в том, что они могут решать задачу аппроксимации многомерных

- 14. Дискриминатор Скалярный выход нейрона можно использовать в качестве индикатор принадлежности входного вектора к одному из заданных

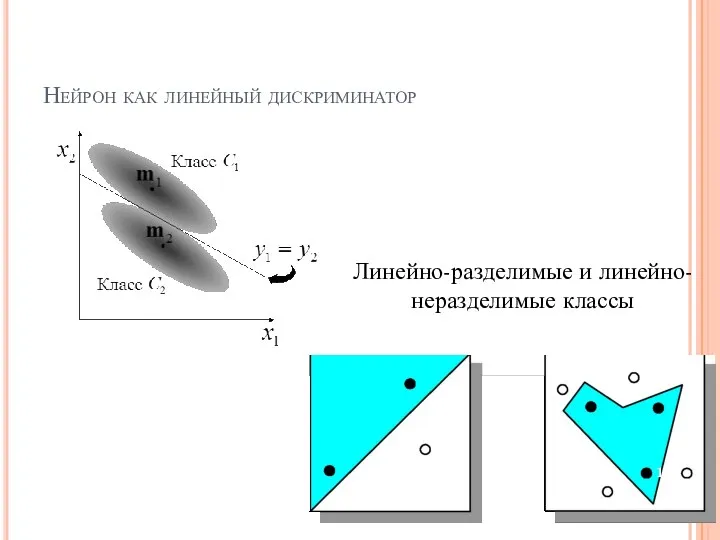

- 15. Нейрон как линейный дискриминатор Линейно-разделимые и линейно-неразделимые классы

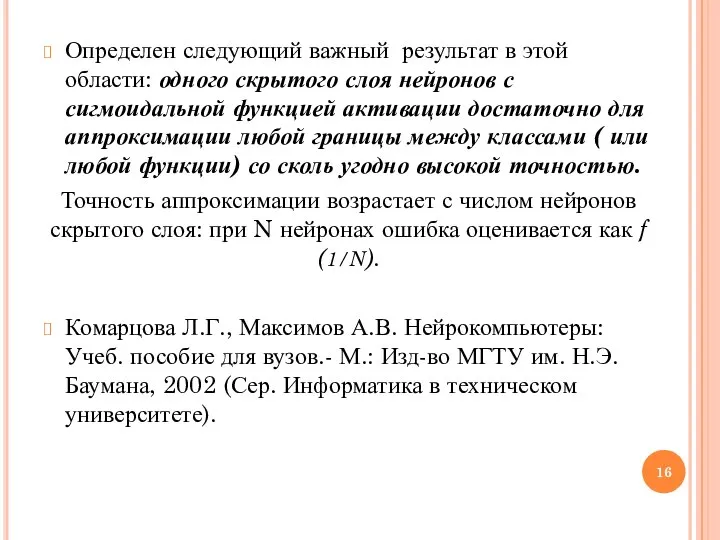

- 16. Определен следующий важный результат в этой области: одного скрытого слоя нейронов с сигмоидальной функцией активации достаточно

- 18. Многослойный персептрон При построении сети на основе нескольких слоев персептронов учитывается следующее: Количество входных и выходных

- 19. Многослойные персептроны Многослойные персептроны успешно применяются для решения разнообразных сложных задач и имеют три следующих отличительных

- 20. метод обратного распространения ошибки Исторически наибольшую трудность на пути к эффективному правилу обучения многослойных персептронов вызывала

- 21. САМООБУЧАЮЩИЕСЯ НЕЙРОСЕТИ Самообучающиеся нейросети - это класс сетей, в котором обучение происходит без учителя, т.е. реализуется

- 22. Длина описания данных пропорциональна разрядности данных (числу бит), определяющей возможное разнообразие принимаемых ими значений, и размерности

- 23. понижение размерности данных с минимальной потерей информации (анализ главных компонент данных, выделение наборов независимых признаков); уменьшение

- 24. Правило Ойа минимизации ошибки обучения сети

- 25. Соревновательное обучение Соревновательное обучение состоит в том, чтобы каждый нейрон был обучен усиливать свой выход и

- 26. Алгорим «Победитель получает все» (WTA) Разновидность соревновательного алгоритма: Веса латеральных связей – т.е. связей в одном

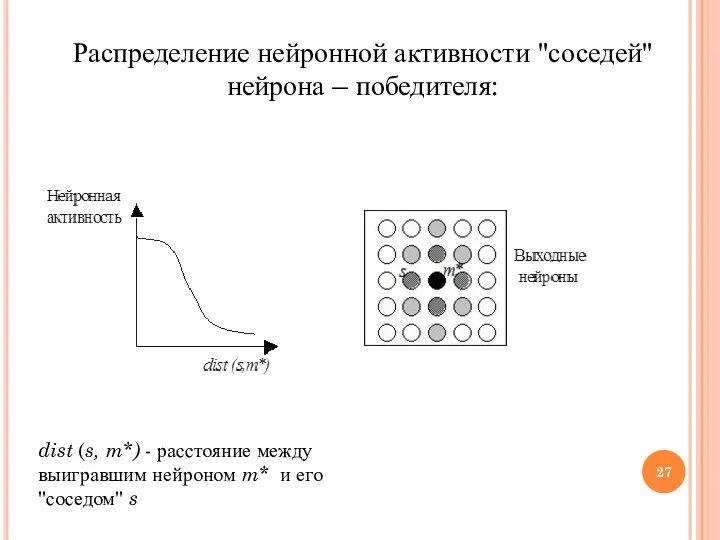

- 27. Распределение нейронной активности "соседей" нейрона – победителя: dist (s, m*) - расстояние между выигравшим нейроном m*

- 28. Нейросетевая парадигма Липпмана-Хемминга, реализующая механизм WTA для решения задачи классификации данных, является моделью с прямой структурой

- 29. Карта самоорганизации Кохонена (Самоорганизующаяся сеть Кохонена) В противоположность хемминговой сети модель Кохонена (T.Kohonen, 1982) выполняет обобщение

- 30. Самоорганизующаяся сеть Кохонена Данная сеть обучается без учителя на основе самоорганизации. По мере обучения вектора весов

- 31. Сеть Кохонена содержит один скрытый слой нейронов. Число входов каждого нейрона равно размерности входного образа. Количество

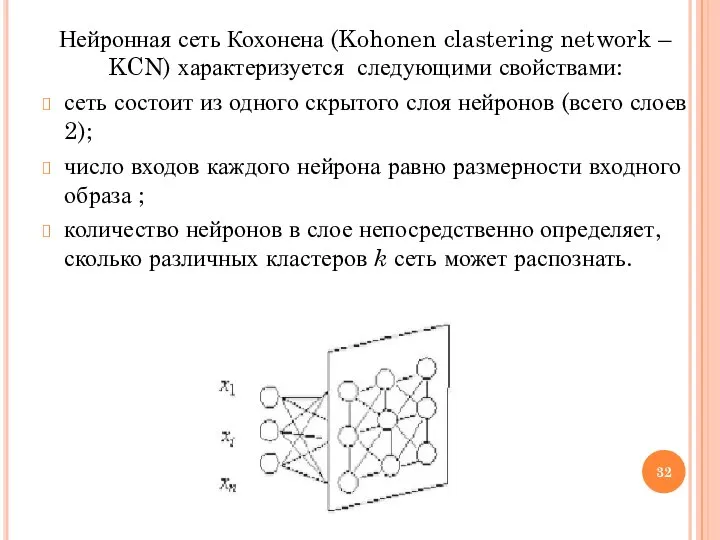

- 32. Нейронная сеть Кохонена (Kohonen clastering network – KCN) характеризуется следующими свойствами: сеть состоит из одного скрытого

- 33. Модель Хопфилда (J.J.Hopfield, 1982) Модель Хопфилда занимает особое место в ряду нейросетевых моделей: В ней впервые

- 34. РЕКУРЕНТНЫЕ СЕТИ ХОПФИЛДА Сеть Хопфилда получается, если наложить на веса связей в выражении s j =

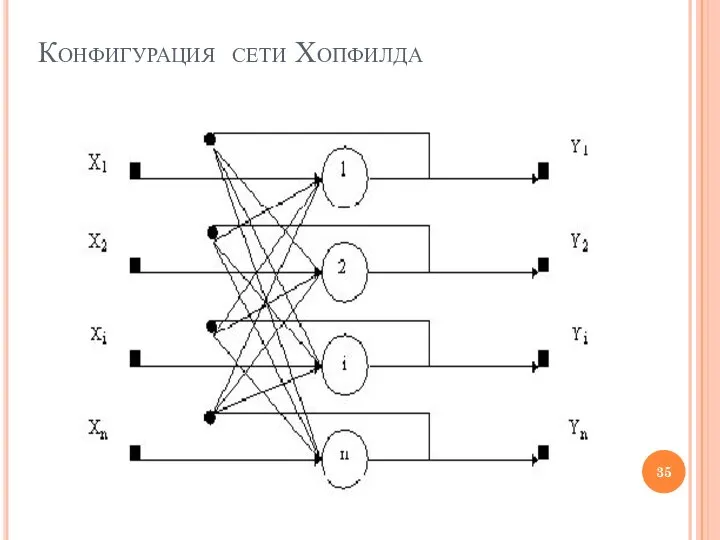

- 35. Конфигурация сети Хопфилда

- 36. Одно из достоинств симметричной квадратной матрицы связей, характерной для сети Хопфилда, состоит в том, что поведение

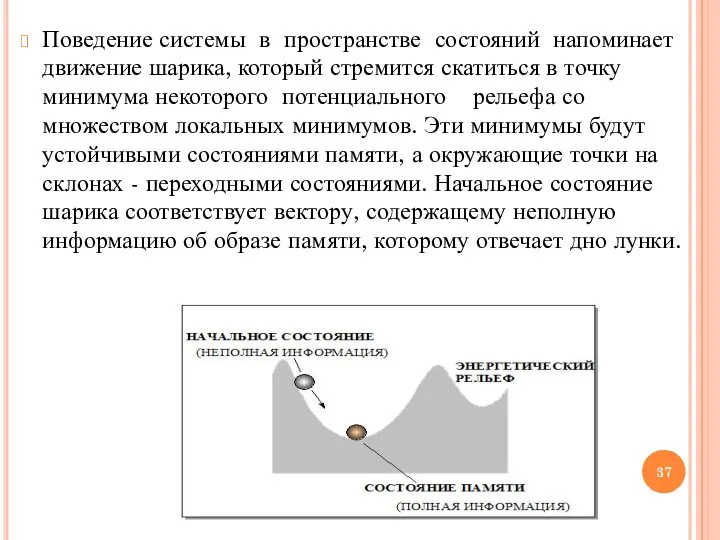

- 37. Поведение системы в пространстве состояний напоминает движение шарика, который стремится скатиться в точку минимума некоторого потенциального

- 38. Характер рельефа определяется видом целевой функции Е и формируется в процессе обучения сети. Обучение производится путем

- 39. Главное свойство сети Хопфилда - способность восстанавливать возмущенное состояние равновесия - "вспоминать" искаженные или потерянные биты

- 40. Одна и та же сеть с одними и теми же весами связей может хранить и воспроизводить

- 41. Ассоциативный характер памяти сети Хопфилда качественно отличает ее от обычной, адресной, компьютерной памяти. При использовании ассоциативной

- 42. Преобразование информации рекуррентными нейронными сетями типа сети Хопфилда, минимизирующими энергию, может приводить к появлению в их

- 43. Хотя сети Хопфилда получили применение на практике, им свойственны определенные недостатки, ограничивающие возможности их применения: модель

- 45. Скачать презентацию

Презентация на тему "Ценностно – смысловая составляющая социокультурного подхода к преподаванию английского языка" - скачат

Презентация на тему "Ценностно – смысловая составляющая социокультурного подхода к преподаванию английского языка" - скачат Презентация Основы таможенного дела

Презентация Основы таможенного дела Современные автомобили и двигатели

Современные автомобили и двигатели Государственный долг внешний и внутренний Бурсаковский Сергей Т093

Государственный долг внешний и внутренний Бурсаковский Сергей Т093 Ряд Фурье и интеграл Фурье

Ряд Фурье и интеграл Фурье ТЕОРИЯ ЭЛЕКТРИЧЕСКИХ ЦЕПЕЙ ПЕРЕМЕННОГО ТОКА С ДУГАМИ

ТЕОРИЯ ЭЛЕКТРИЧЕСКИХ ЦЕПЕЙ ПЕРЕМЕННОГО ТОКА С ДУГАМИ Электроснабжение медноникелевого комбината

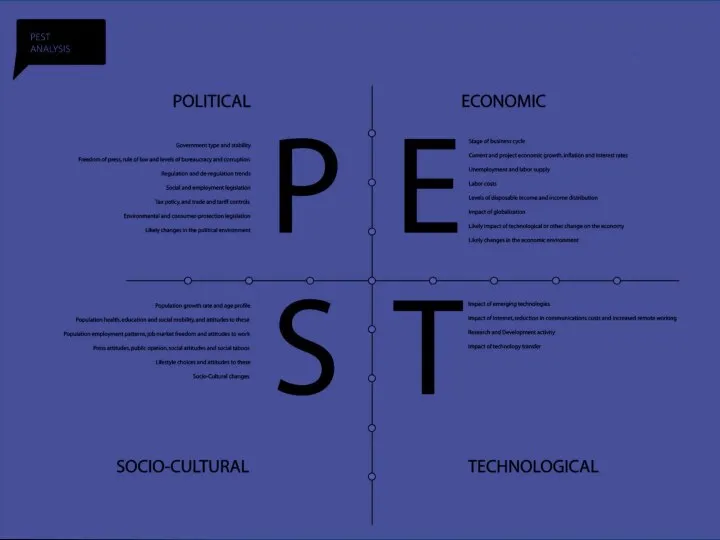

Электроснабжение медноникелевого комбината PEST Analysis

PEST Analysis Информационные технологии в медицине

Информационные технологии в медицине Ватутин Николай Фёдорович

Ватутин Николай Фёдорович The Greatest Among Art Самое великое из всех искусств

The Greatest Among Art Самое великое из всех искусств органоиды1

органоиды1 Перспективы железобетона. Направления развития

Перспективы железобетона. Направления развития Психология цвета в интерьере

Психология цвета в интерьере Фінансова звітність та її зміст

Фінансова звітність та її зміст Литейное производство. Прибыли и холодильники отливок. (Лекция 7)

Литейное производство. Прибыли и холодильники отливок. (Лекция 7) Критерий выбора системы управления e-образованием Международная конференция: «Информационные и коммуникационные технологий е-об

Критерий выбора системы управления e-образованием Международная конференция: «Информационные и коммуникационные технологий е-об Абстрактный тип данных. Стек

Абстрактный тип данных. Стек Что такое мехатроника

Что такое мехатроника Корпорация Строй Контракт

Корпорация Строй Контракт Презентация Классификация и кодирование товаров Лекция

Презентация Классификация и кодирование товаров Лекция Успешный выход на рынок в экономическую зону Германии Докладчик: Аудитор/налоговый консультант Дитер Вагенер Партнер DHPG DR. HARZEM

Успешный выход на рынок в экономическую зону Германии Докладчик: Аудитор/налоговый консультант Дитер Вагенер Партнер DHPG DR. HARZEM  Действия населения в зоне химического поражения

Действия населения в зоне химического поражения Космічний. Комікси

Космічний. Комікси Применение линейного программирования в математических моделях

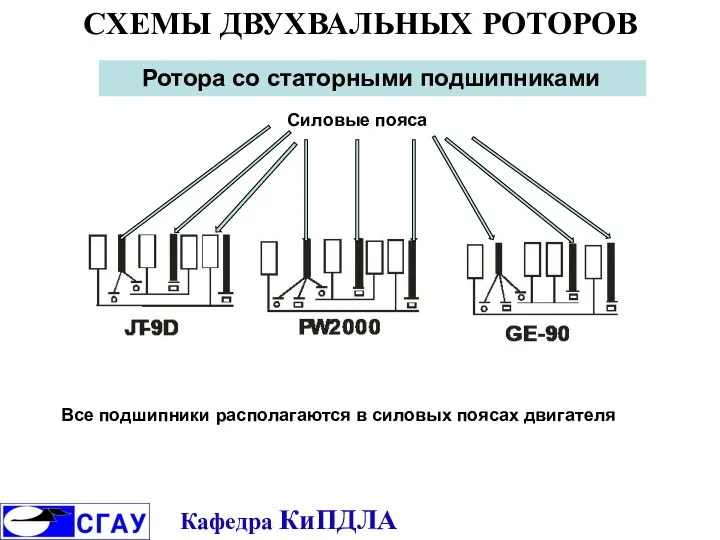

Применение линейного программирования в математических моделях Схемы двухвальных роторов

Схемы двухвальных роторов Презентация на тему сыр

Презентация на тему сыр Анализ эффективности при борьбе с солеотложениями на добывающих скважинах средне-харьягинского месторождения

Анализ эффективности при борьбе с солеотложениями на добывающих скважинах средне-харьягинского месторождения