Содержание

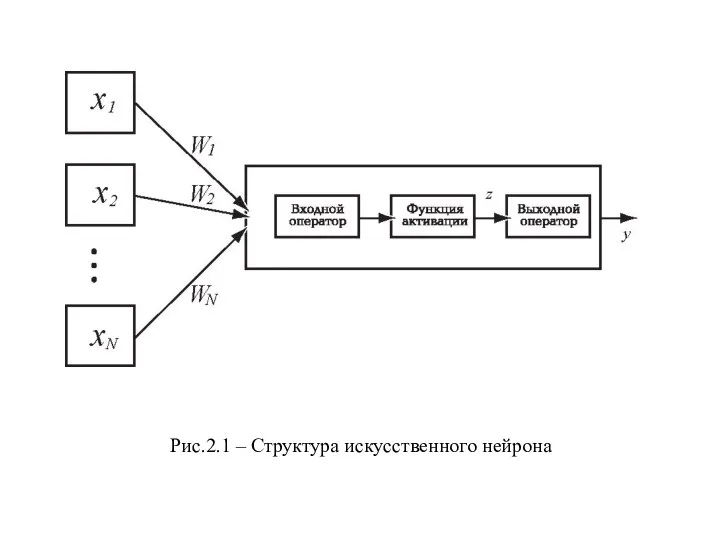

- 2. Рис.2.1 – Структура искусственного нейрона

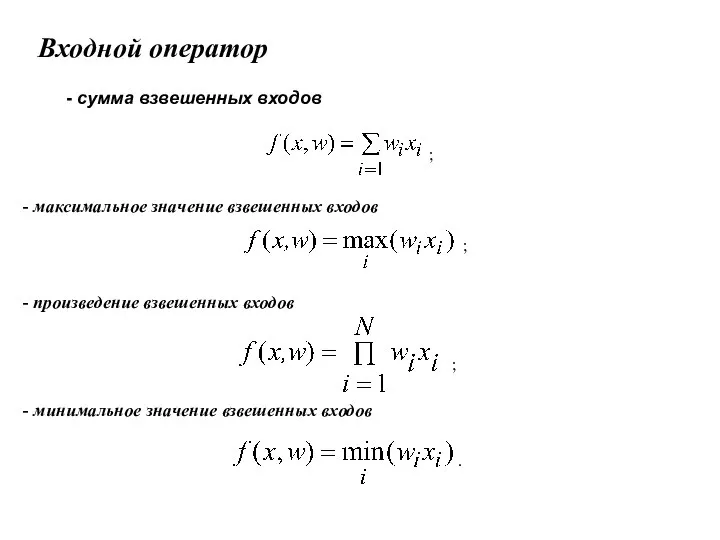

- 3. Входной оператор - сумма взвешенных входов ; - максимальное значение взвешенных входов ; - произведение взвешенных

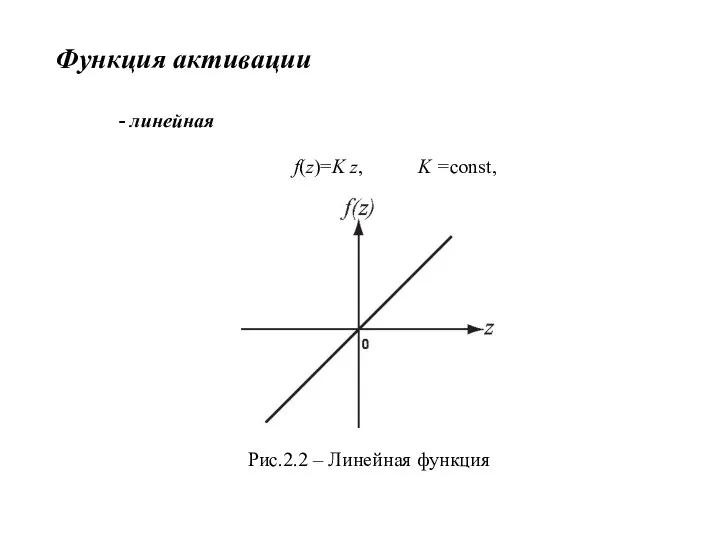

- 4. Функция активации - линейная f(z)=K z, K =const, Рис.2.2 – Линейная функция

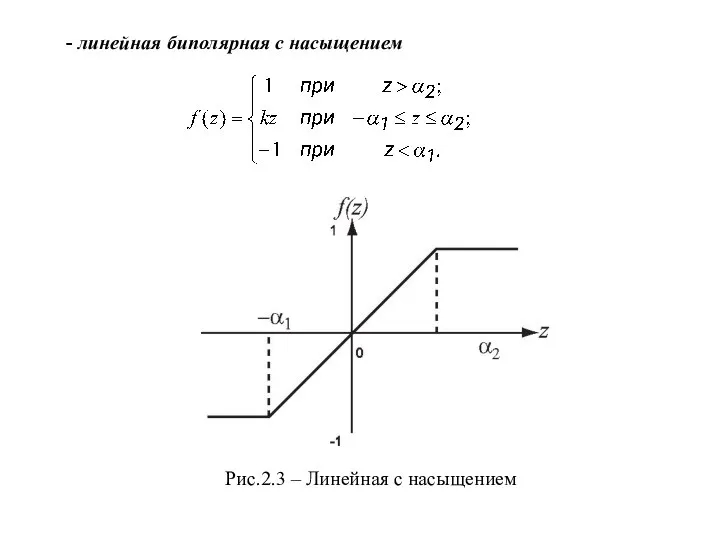

- 5. - линейная биполярная с насыщением Рис.2.3 – Линейная с насыщением

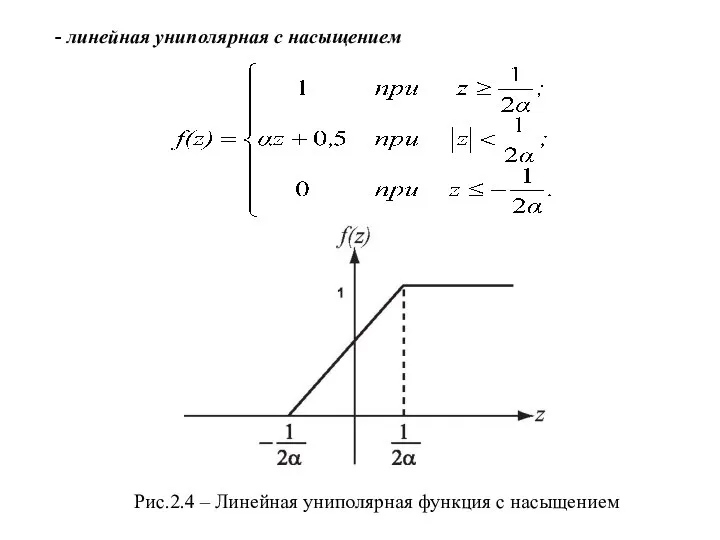

- 6. - линейная униполярная с насыщением Рис.2.4 – Линейная униполярная функция с насыщением

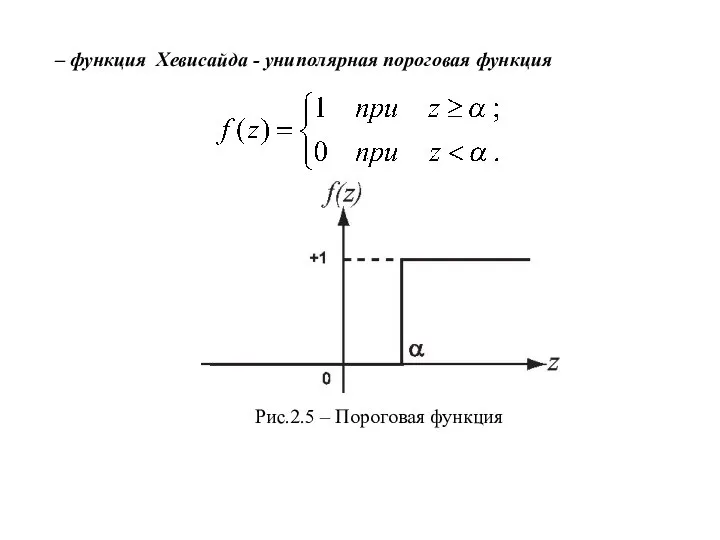

- 7. – функция Хевисайда - униполярная пороговая функция Рис.2.5 – Пороговая функция

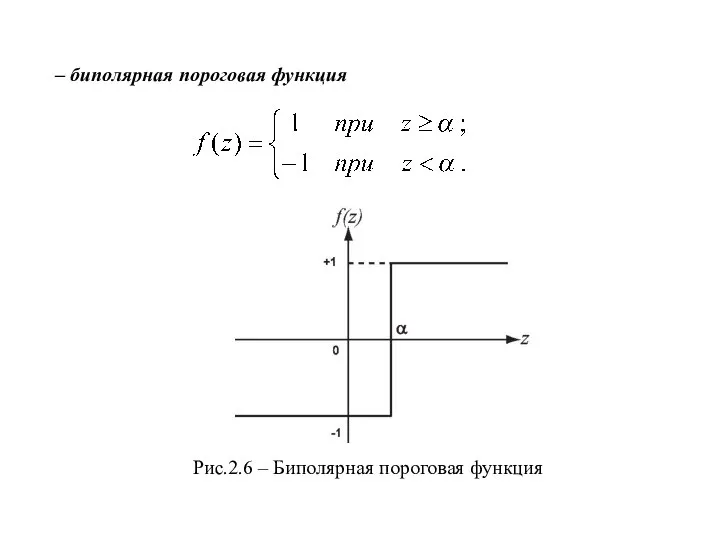

- 8. – биполярная пороговая функция Рис.2.6 – Биполярная пороговая функция

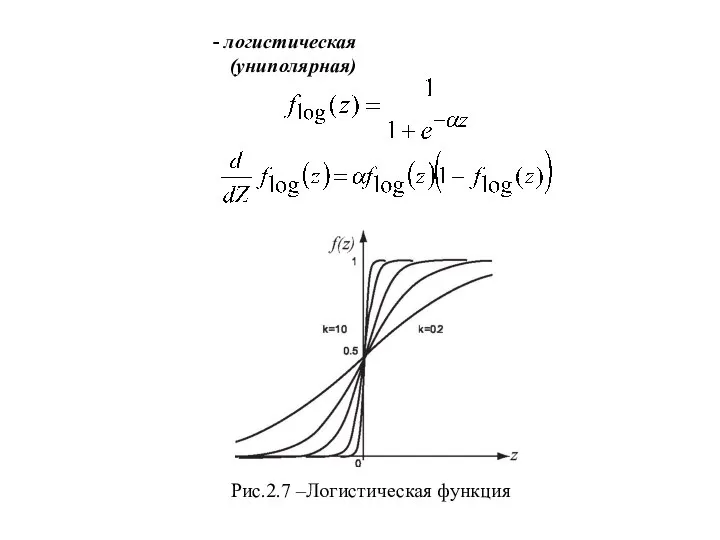

- 9. - логистическая (униполярная) Рис.2.7 –Логистическая функция

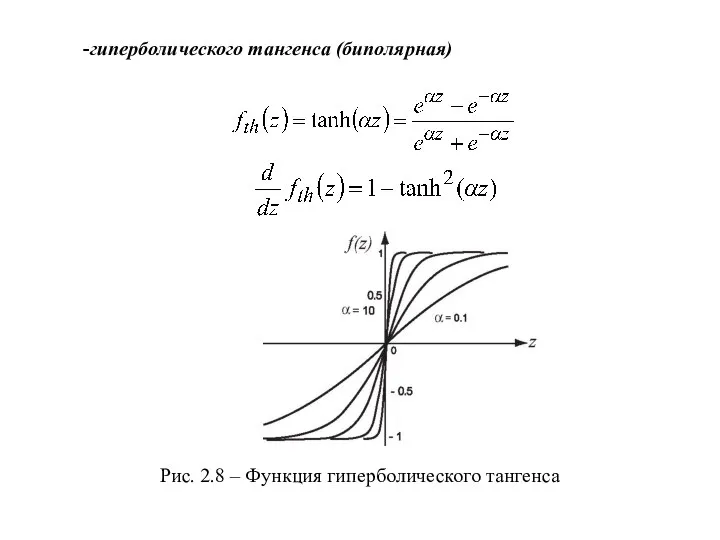

- 10. -гиперболического тангенса (биполярная) , Рис. 2.8 – Функция гиперболического тангенса

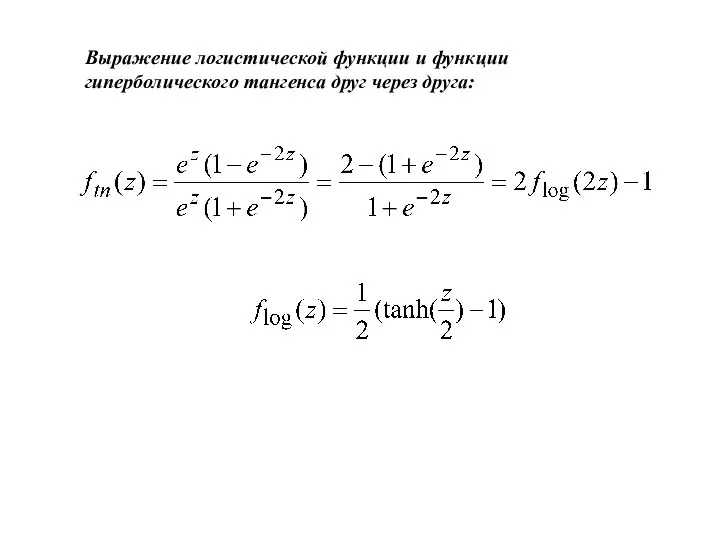

- 11. Выражение логистической функции и функции гиперболического тангенса друг через друга:

- 12. - модулированная сигмоида Рис. 2.9 – Функция “модулированная сигмоида”

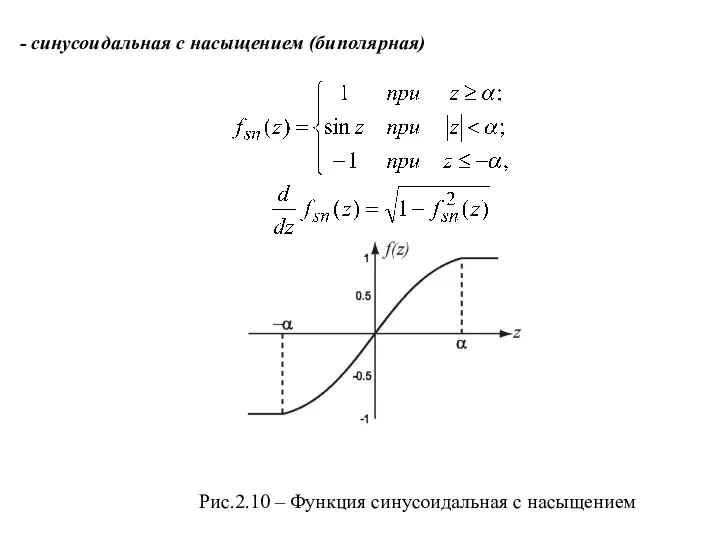

- 13. - синусоидальная с насыщением (биполярная) Рис.2.10 – Функция синусоидальная с насыщением

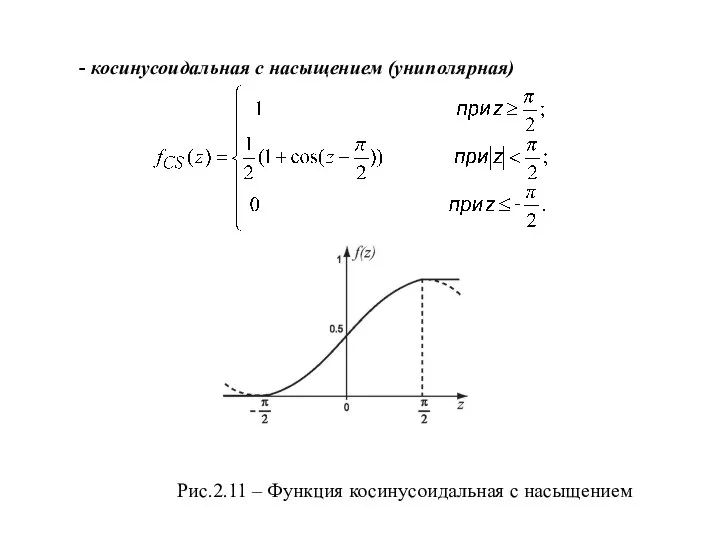

- 14. - косинусоидальная с насыщением (униполярная) Рис.2.11 – Функция косинусоидальная с насыщением

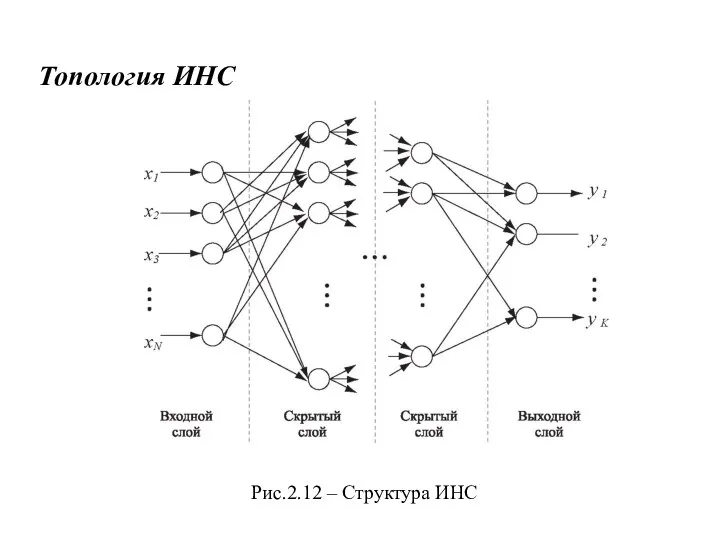

- 15. Топология ИНС Рис.2.12 – Структура ИНС

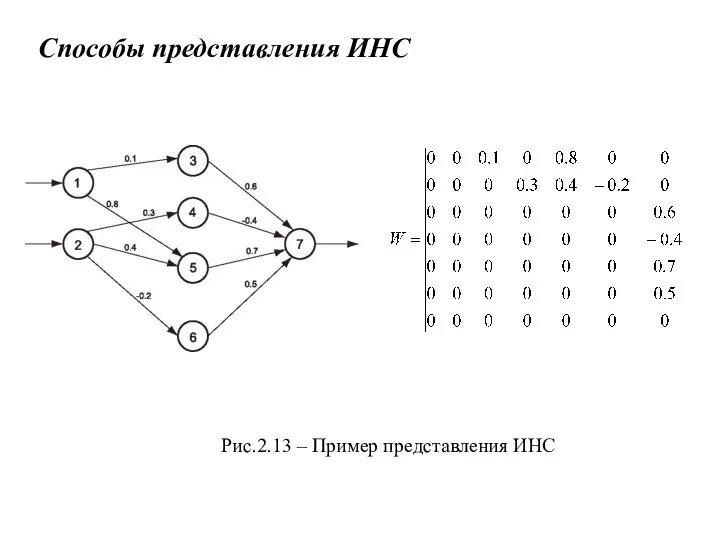

- 16. Способы представления ИНС Рис.2.13 – Пример представления ИНС

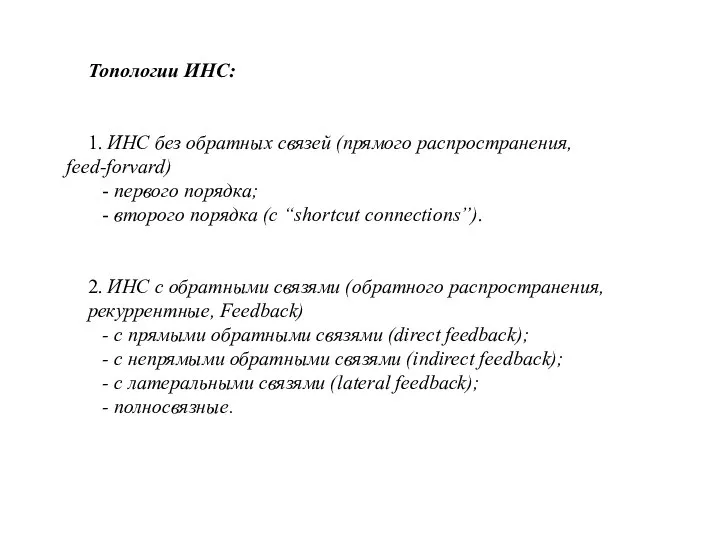

- 17. Топологии ИНС: 1. ИНС без обратных связей (прямого распространения, feed-forvard) - первого порядка; - второго порядка

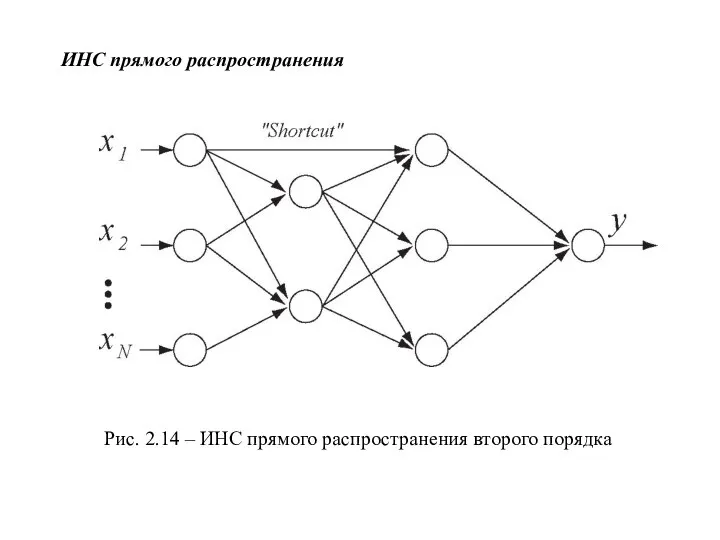

- 18. ИНС прямого распространения Рис. 2.14 – ИНС прямого распространения второго порядка

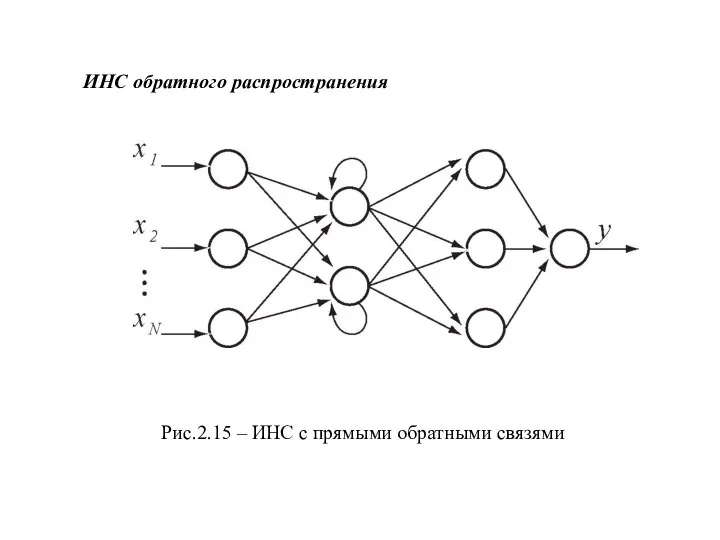

- 19. ИНС обратного распространения Рис.2.15 – ИНС с прямыми обратными связями

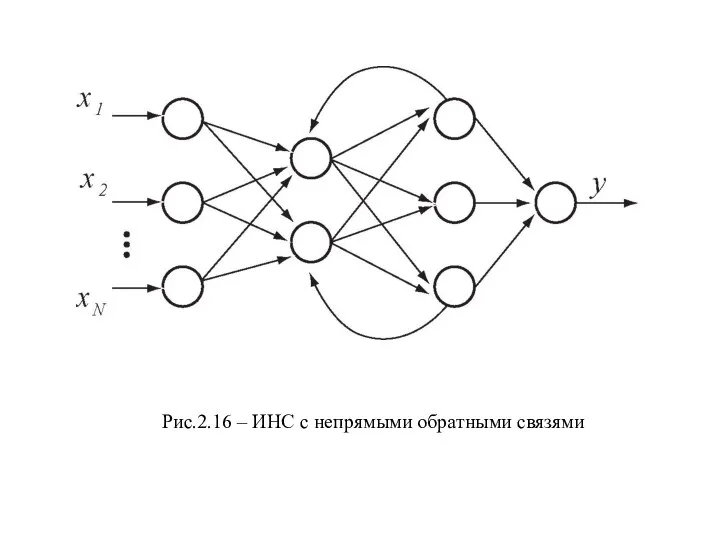

- 20. Рис.2.16 – ИНС с непрямыми обратными связями

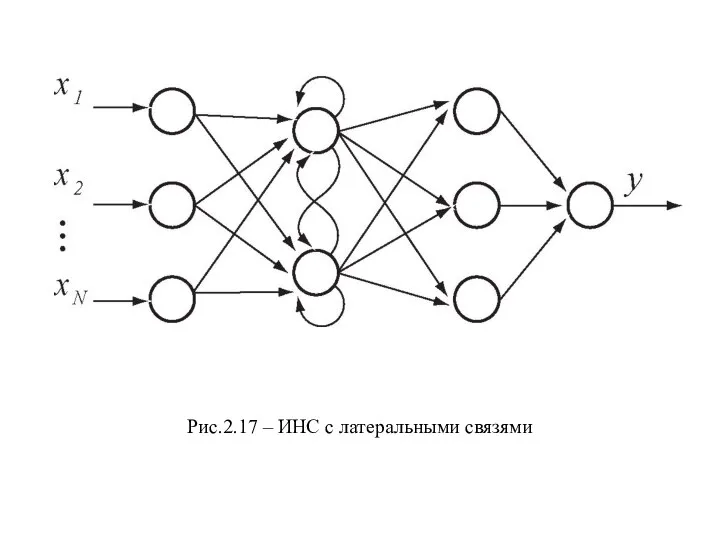

- 21. Рис.2.17 – ИНС с латеральными связями

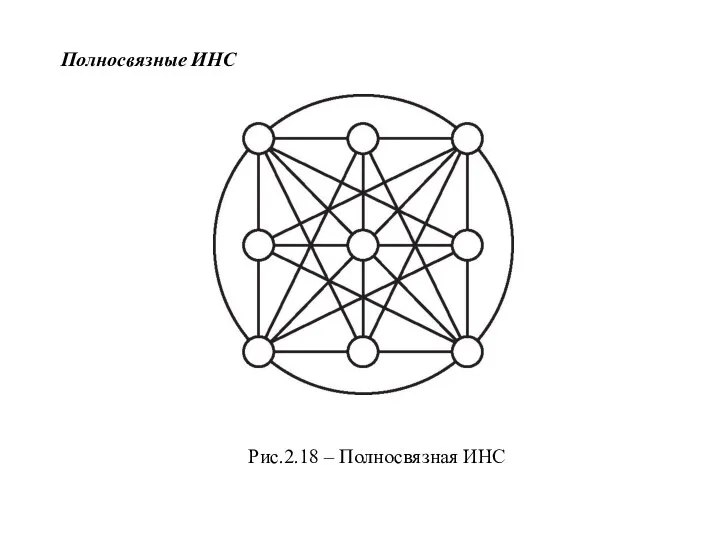

- 22. Полносвязные ИНС Рис.2.18 – Полносвязная ИНС

- 23. Подходы к обучению ИНС: - изменение конфигурации сети путем образования новых или исключения некоторых существующих связей

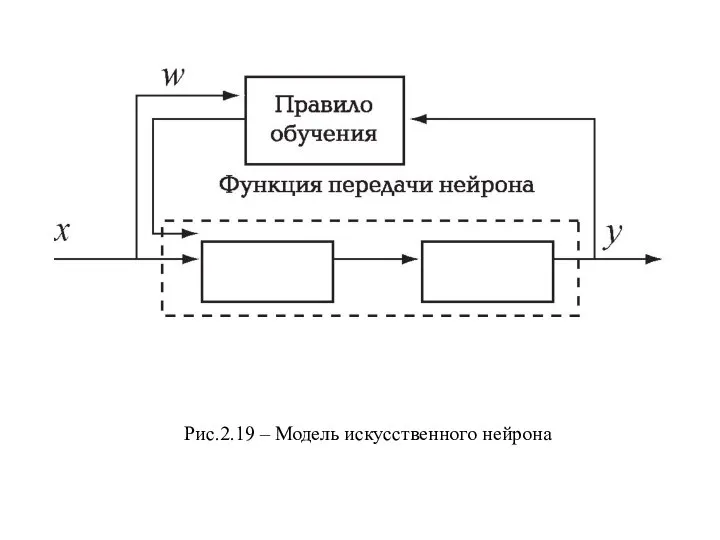

- 24. Рис.2.19 – Модель искусственного нейрона

- 25. Типы обучения ИНС: - Обучение с учителем; - Обучение без учителя; - Подкрепляемое обучение.

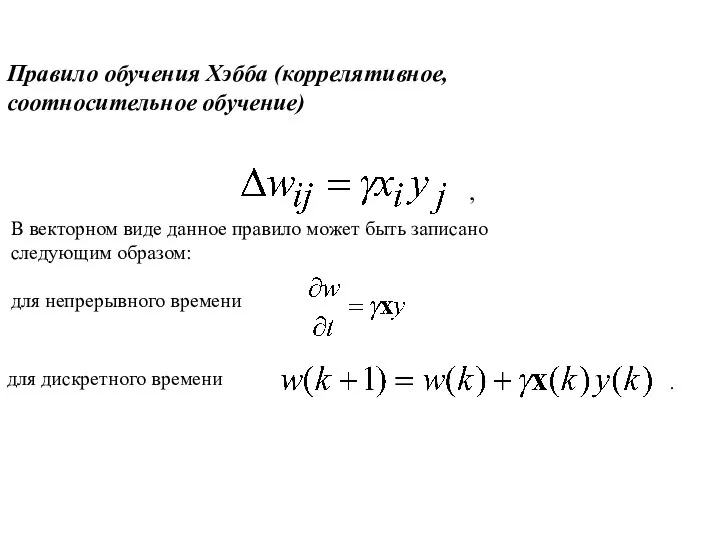

- 26. Правило обучения Хэбба (коррелятивное, соотносительное обучение) , В векторном виде данное правило может быть записано следующим

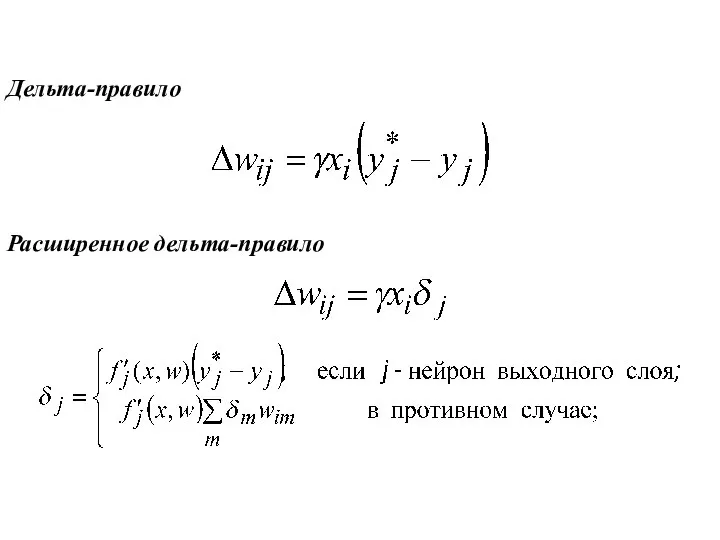

- 27. Дельта-правило Расширенное дельта-правило

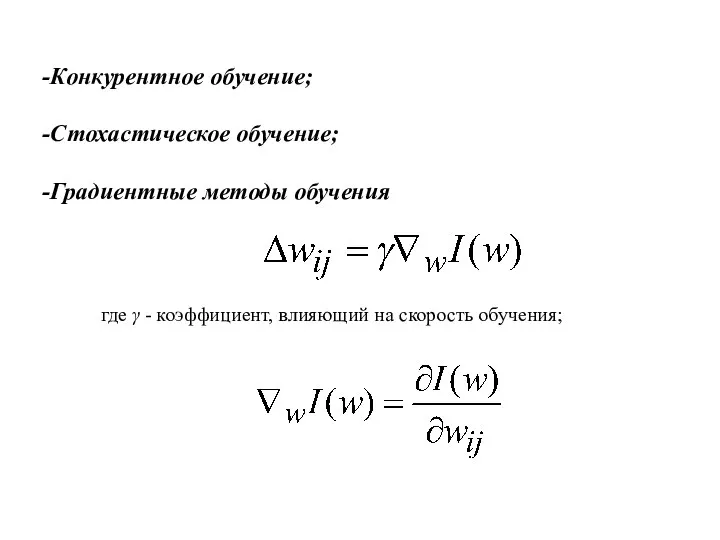

- 28. Конкурентное обучение; Стохастическое обучение; Градиентные методы обучения где γ - коэффициент, влияющий на скорость обучения;

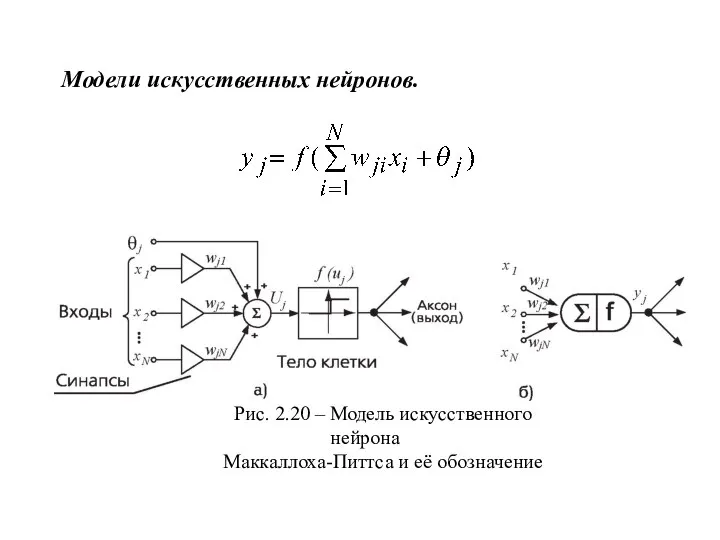

- 29. Модели искусственных нейронов. Рис. 2.20 – Модель искусственного нейрона Маккаллоха-Питтса и её обозначение

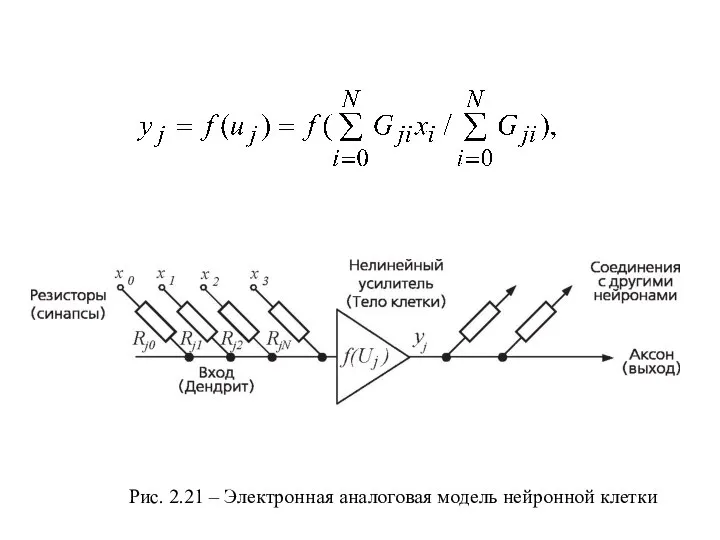

- 30. Рис. 2.21 – Электронная аналоговая модель нейронной клетки

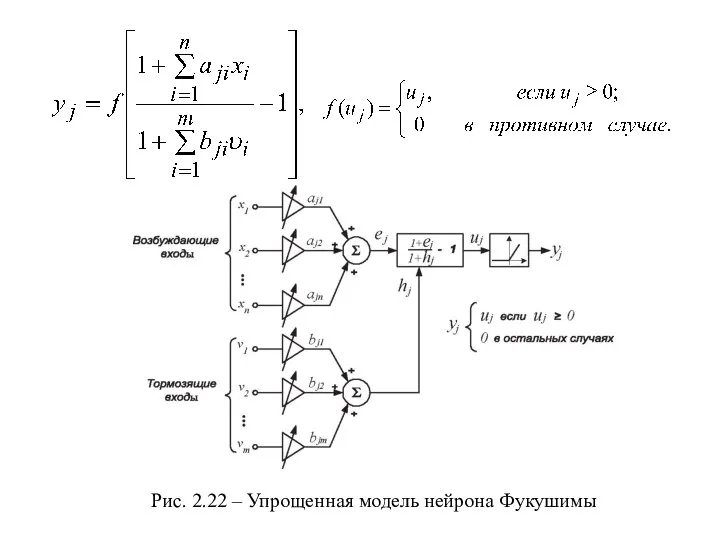

- 31. Рис. 2.22 – Упрощенная модель нейрона Фукушимы

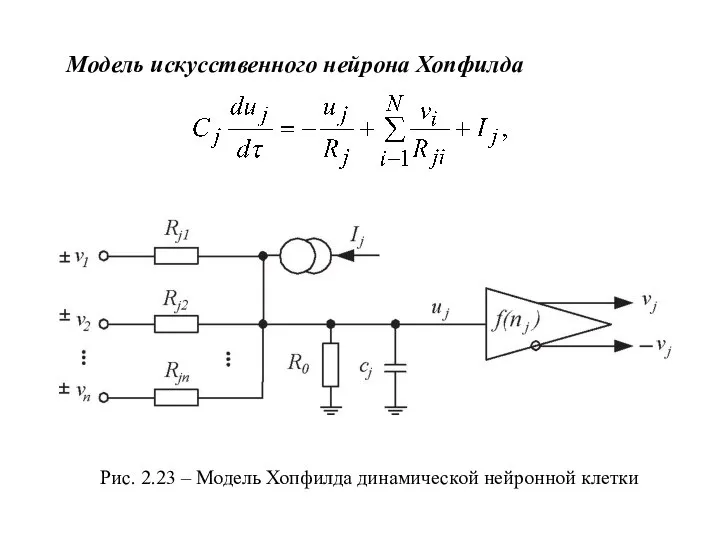

- 32. Модель искусственного нейрона Хопфилда Рис. 2.23 – Модель Хопфилда динамической нейронной клетки

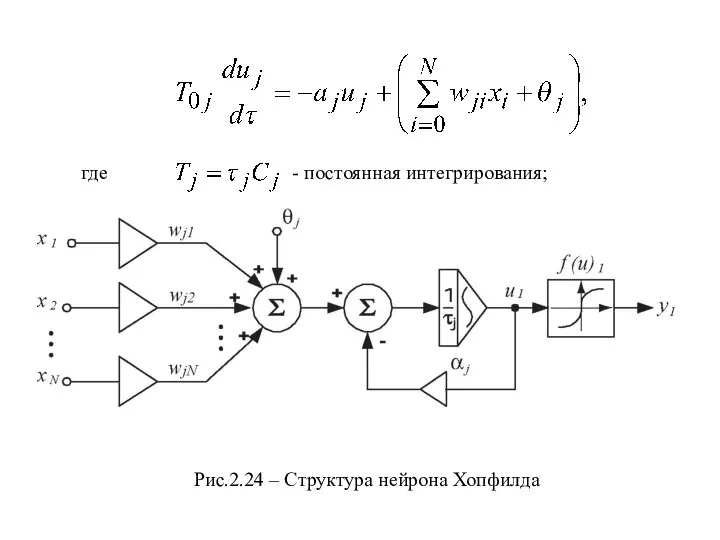

- 33. Рис.2.24 – Структура нейрона Хопфилда - постоянная интегрирования; где

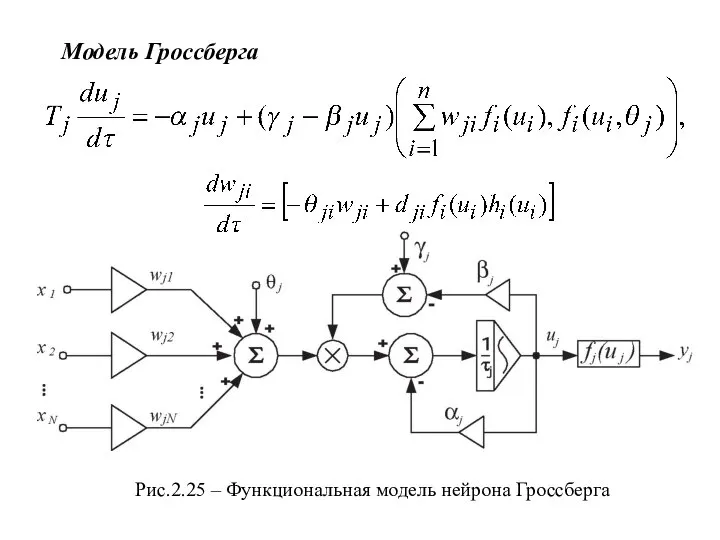

- 34. Модель Гроссберга Рис.2.25 – Функциональная модель нейрона Гроссберга

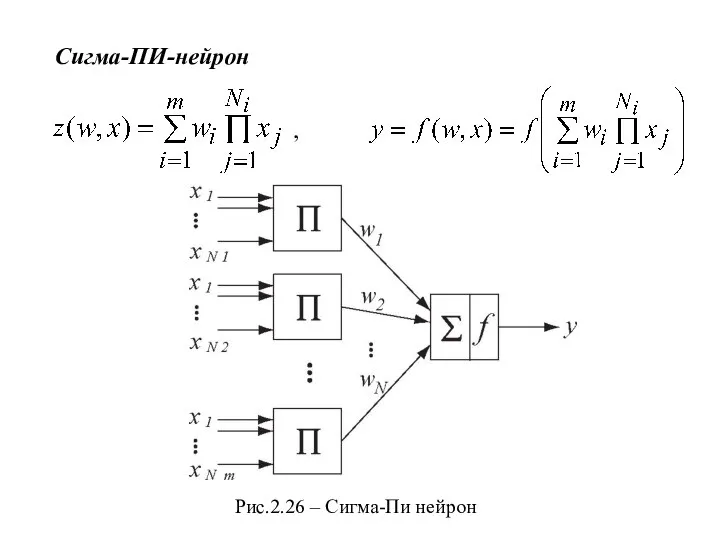

- 35. Сигма-ПИ-нейрон , Рис.2.26 – Сигма-Пи нейрон

- 37. Скачать презентацию

Дифференцированный подход в обучении учащихся при подготовке к ГИА

Дифференцированный подход в обучении учащихся при подготовке к ГИА Решение задач с помощью квадратных уравнений

Решение задач с помощью квадратных уравнений Квадрат и куб числа.

Квадрат и куб числа. Математика в профессии статистика

Математика в профессии статистика Внеклассное мероприятие по математике с элементами экономики. В отделении Сбербанка. 5 класс

Внеклассное мероприятие по математике с элементами экономики. В отделении Сбербанка. 5 класс ОБЪЁМНЫЕ ТЕЛА И МНОГОГРАННИКИ

ОБЪЁМНЫЕ ТЕЛА И МНОГОГРАННИКИ  Графический метод решения уравнений и их систем в курсе алгебры 8 класса

Графический метод решения уравнений и их систем в курсе алгебры 8 класса Натуральный ряд чисел

Натуральный ряд чисел Решение задач по теме четырехугольники

Решение задач по теме четырехугольники Осевая симметрия

Осевая симметрия Презентация на тему ЕВКЛИД (ок. 365 — 300 до н. э.) галерея великих математиков

Презентация на тему ЕВКЛИД (ок. 365 — 300 до н. э.) галерея великих математиков  9 класс решение задач при помощи систем уравнений

9 класс решение задач при помощи систем уравнений  Функции

Функции Многоликая парабола

Многоликая парабола Формирование универсальных учебных действий при решении текстовых задач

Формирование универсальных учебных действий при решении текстовых задач Видеоурок по теме "Сфера и шар". 11 класс

Видеоурок по теме "Сфера и шар". 11 класс Корень п-ой степени

Корень п-ой степени Дисциплина «Математические модели в инвестиционном проектировании»

Дисциплина «Математические модели в инвестиционном проектировании» Открытый конкурс «Мой первый урок». Элементы теории вероятностей

Открытый конкурс «Мой первый урок». Элементы теории вероятностей Source coordinate definition by. Non-destructive assay

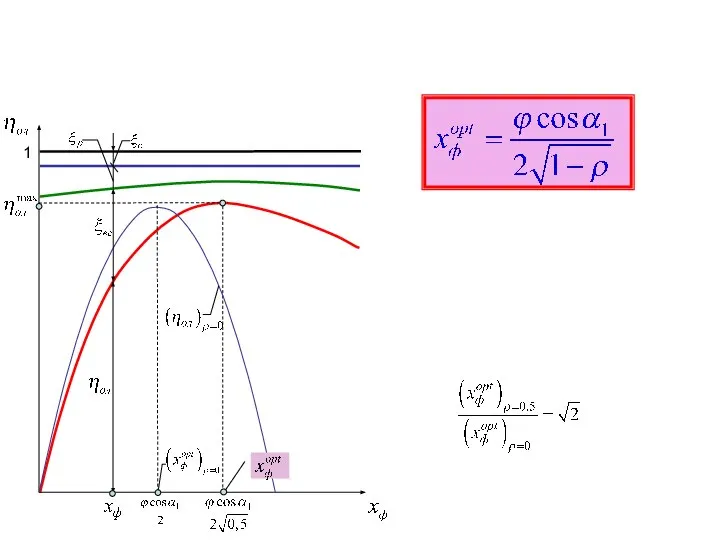

Source coordinate definition by. Non-destructive assay Оптимальный располагаемый теплоперепад ступени

Оптимальный располагаемый теплоперепад ступени Моделирование методом Монте-Карло

Моделирование методом Монте-Карло Симметрия вокруг нас © О.К. Ермишко, учитель математики МОУ СОШ № 4 пгт Прогресс 2010

Симметрия вокруг нас © О.К. Ермишко, учитель математики МОУ СОШ № 4 пгт Прогресс 2010 Тест. Деление суммы на число. (3 класс)

Тест. Деление суммы на число. (3 класс) Гармонический анализ

Гармонический анализ Кто где живет? Головоломки

Кто где живет? Головоломки Урок-КВН

Урок-КВН Сказочная страна функций. Электронный урок

Сказочная страна функций. Электронный урок