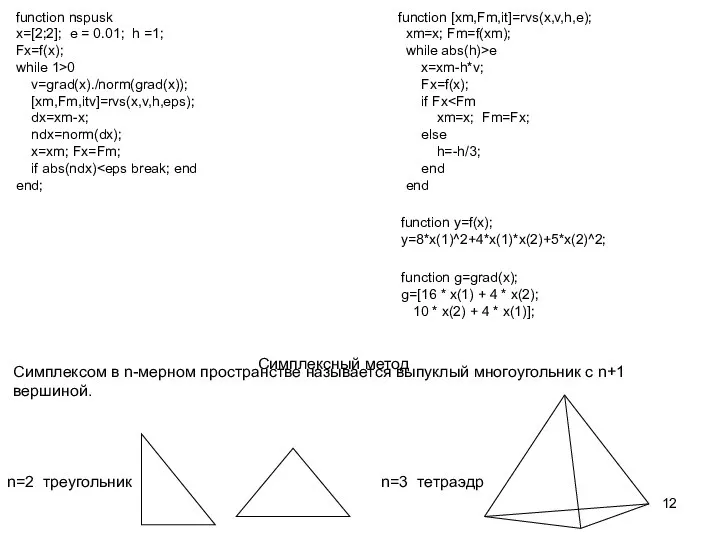

Содержание

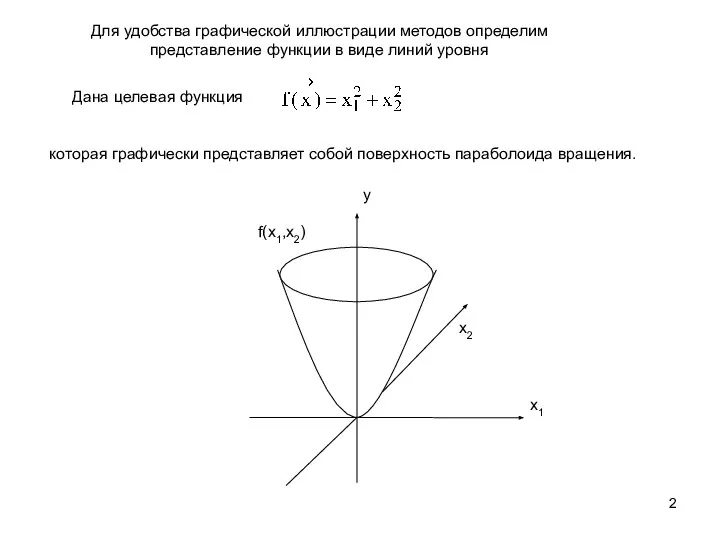

- 2. Для удобства графической иллюстрации методов определим представление функции в виде линий уровня Дана целевая функция которая

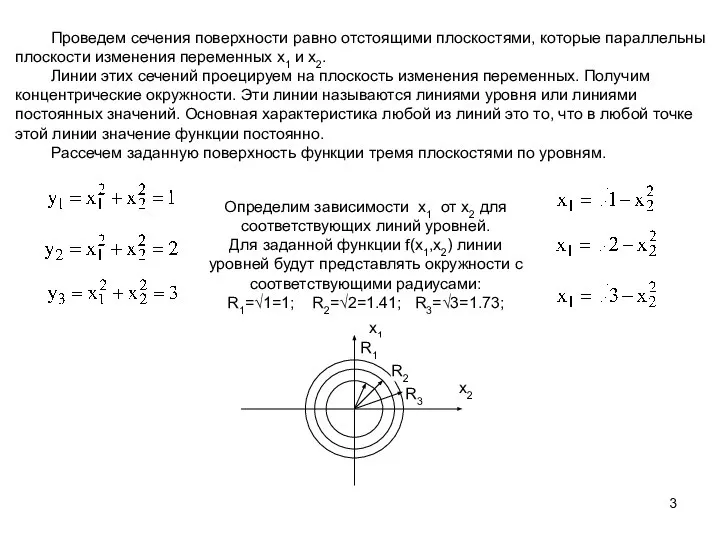

- 3. Проведем сечения поверхности равно отстоящими плоскостями, которые параллельны плоскости изменения переменных x1 и x2. Линии этих

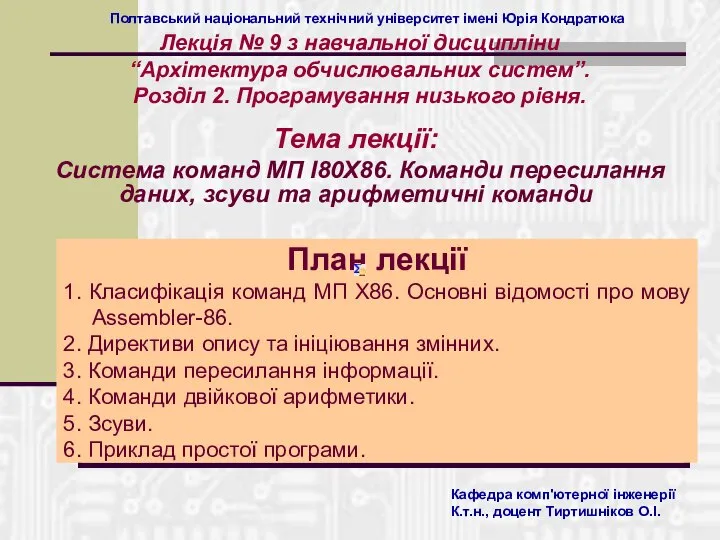

- 4. функция Химмельблау fxx01=inline('(x1.^2+x2-11).^2+(x1+x2.^2-7).^2') [x1,x2]=meshgrid(-4:0.05:4); z=fxx01(x1,x2); contour(x1,x2,z)

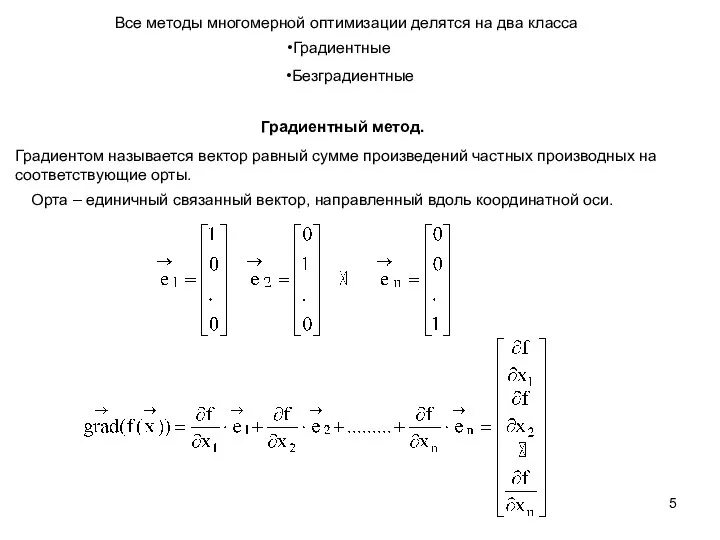

- 5. Все методы многомерной оптимизации делятся на два класса Градиентом называется вектор равный сумме произведений частных производных

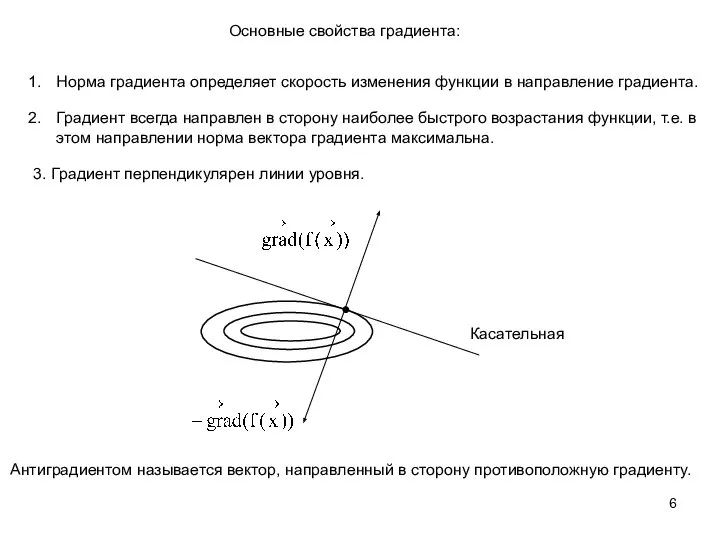

- 6. Норма градиента определяет скорость изменения функции в направление градиента. Градиент всегда направлен в сторону наиболее быстрого

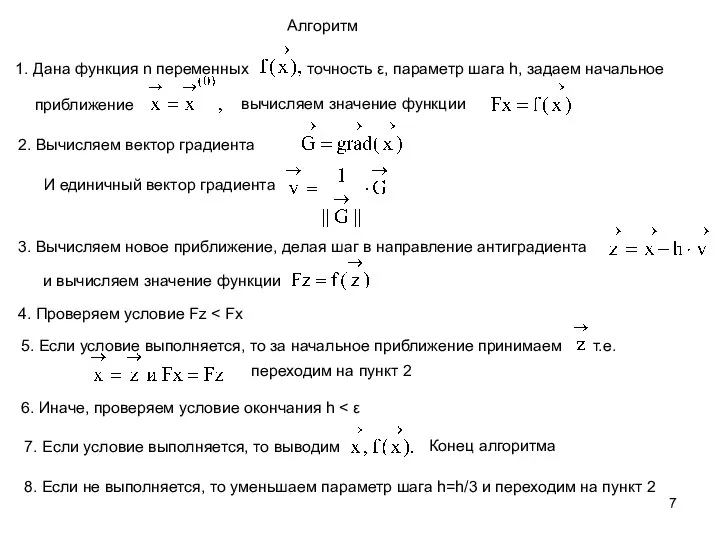

- 7. Алгоритм 1. Дана функция n переменных точность ε, параметр шага h, задаем начальное приближение вычисляем значение

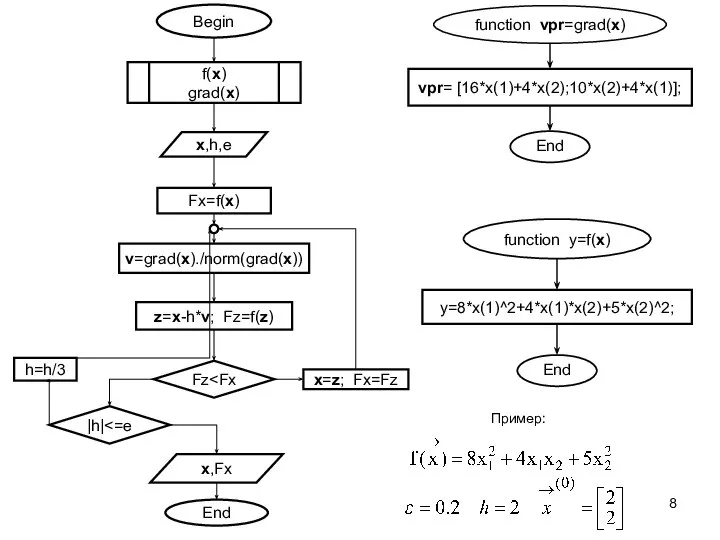

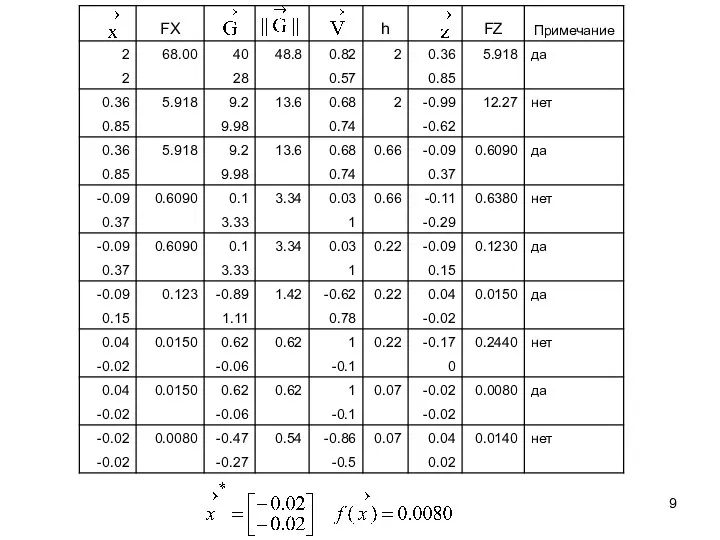

- 8. Пример: function vpr=grad(x) End function y=f(x) End End Begin f(x) grad(x) x,h,e Fz x,Fx |h| vpr=

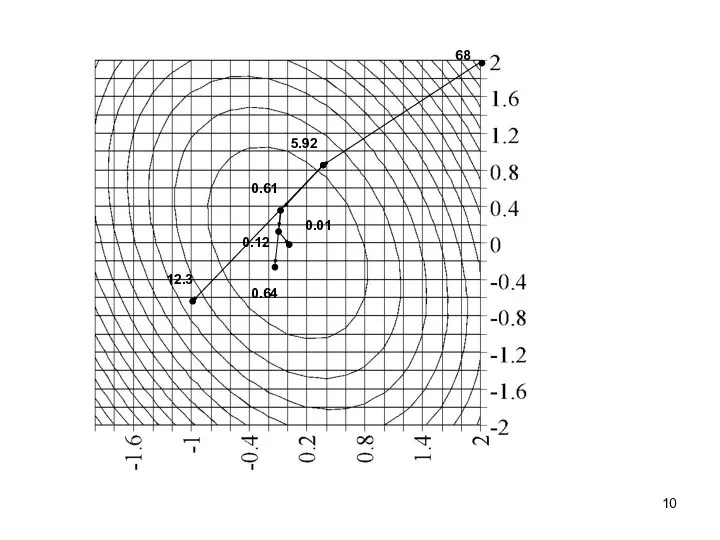

- 10. 68 5.92 12.3 0.61 0.64 0.12 0.01

- 11. function [xm,Fm]=rvs(x,v,h,e) x=xm-h*v Fx:=f(x) Fx ІhІ xm:=x Fm:=Fx h:=-h/3 End Метод наискорейшего спуска End Begin f(x)

- 12. function y=f(x); y=8*x(1)^2+4*x(1)*x(2)+5*x(2)^2; function g=grad(x); g=[16 * x(1) + 4 * x(2); 10 * x(2) +

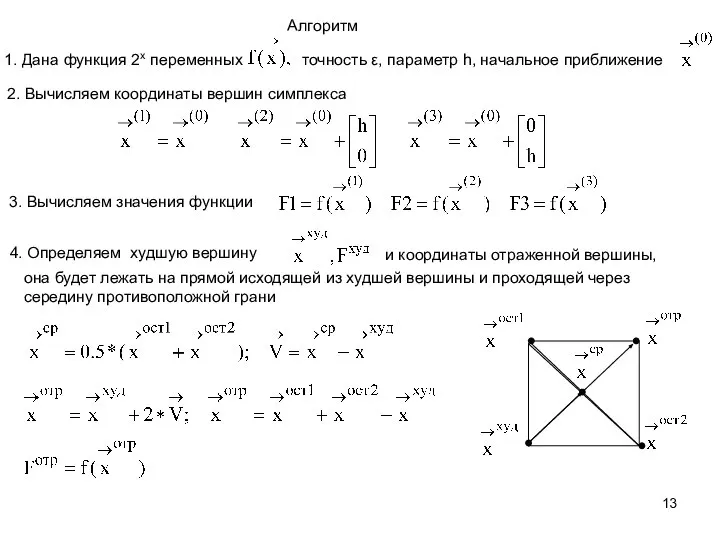

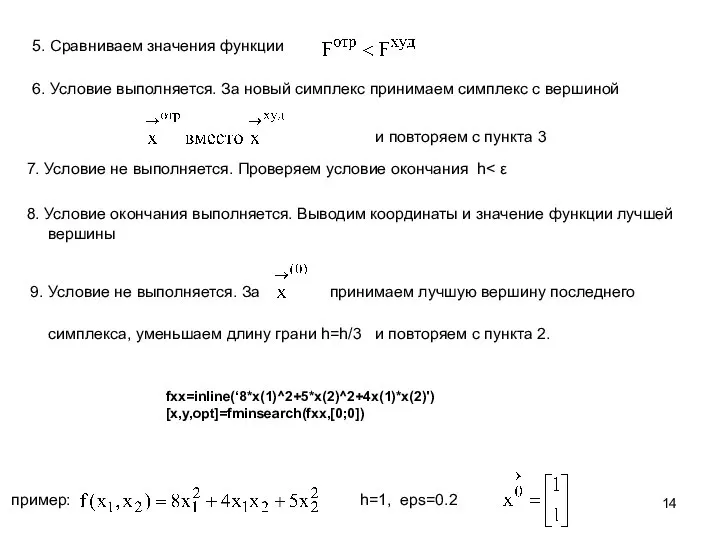

- 13. Алгоритм 1. Дана функция 2x переменных точность ε, параметр h, начальное приближение 2. Вычисляем координаты вершин

- 14. 7. Условие не выполняется. Проверяем условие окончания h симплекса, уменьшаем длину грани h=h/3 и повторяем с

- 15. Ответ:

- 17. Скачать презентацию

![функция Химмельблау fxx01=inline('(x1.^2+x2-11).^2+(x1+x2.^2-7).^2') [x1,x2]=meshgrid(-4:0.05:4); z=fxx01(x1,x2); contour(x1,x2,z)](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/1297960/slide-3.jpg)

![function [xm,Fm]=rvs(x,v,h,e) x=xm-h*v Fx:=f(x) Fx ІhІ xm:=x Fm:=Fx h:=-h/3 End Метод](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/1297960/slide-10.jpg)

Архитектура Владимиро-Суздальского княжества

Архитектура Владимиро-Суздальского княжества Черенков Фёдор Фёдорович

Черенков Фёдор Фёдорович Электроника. Последовательностная логика

Электроника. Последовательностная логика Презентация Характеристика элементов вывозных таможенных пошлин. Ставки и порядок их применения

Презентация Характеристика элементов вывозных таможенных пошлин. Ставки и порядок их применения Новая конституция РФ (приложение)

Новая конституция РФ (приложение) Всероссийский физкультурно-спортивный комплекс «Готов к труду и обороне» (ГТО): актуальные вопросы внедрения

Всероссийский физкультурно-спортивный комплекс «Готов к труду и обороне» (ГТО): актуальные вопросы внедрения Основы защиты информации в телекоммуникационных системах

Основы защиты информации в телекоммуникационных системах  Методика развития гибкости у детей 8-9 лет, занимающихся греко-римской борьбой

Методика развития гибкости у детей 8-9 лет, занимающихся греко-римской борьбой Программа элективного курса «Основы фитодизайна»

Программа элективного курса «Основы фитодизайна» Виды юридической ответственности

Виды юридической ответственности Мировая политика и мировая экономика в условиях глобализации

Мировая политика и мировая экономика в условиях глобализации Регрессия — погружение в прошлые жизни

Регрессия — погружение в прошлые жизни Эл пособие ч 2

Эл пособие ч 2 Характеристики и виды организаций

Характеристики и виды организаций Теорема Виета (8 класс) - презентация по Алгебре_

Теорема Виета (8 класс) - презентация по Алгебре_ Современная тактика лечения ОРЗ у часто болеющих детей

Современная тактика лечения ОРЗ у часто болеющих детей  Концепция производственной демократии

Концепция производственной демократии  E-commerce web 2.0 для Полякова Елена проектировщик интерфейсов HumanoIT Group. - презентация

E-commerce web 2.0 для Полякова Елена проектировщик интерфейсов HumanoIT Group. - презентация Posters NPE

Posters NPE Заповеди блаженств

Заповеди блаженств 격조사 (падежные частицы). Корейские окончания. Урок 2-4

격조사 (падежные частицы). Корейские окончания. Урок 2-4 Асинхронные двигатели

Асинхронные двигатели Приостановление сроков исковой давности

Приостановление сроков исковой давности Система команд МП I80X86. Команди пересилання даних, зсуви та арифметичні команди

Система команд МП I80X86. Команди пересилання даних, зсуви та арифметичні команди Профессия автомеханик

Профессия автомеханик НЕВРОЛОГИЯ Клещевой энцефалит

НЕВРОЛОГИЯ Клещевой энцефалит C# и Entity FrameWork

C# и Entity FrameWork Component Enabler for .NET

Component Enabler for .NET