- Главная

- Математика

- Понятие о корреляционном и регрессионном анализах

Содержание

- 2. Понятие корреляционной и регрессионной связи Две (или более) случайных величины 1. Могут быть связаны функциональной зависимостью

- 3. При изучении конкретных зависимостей между случайными величинами вводят понятия: · факторные признаки или факторы - независимые

- 4. Регрессия - это односторонняя стохастическая зависимость, когда одна из переменных служит причиной для изменения другой. Например,

- 5. Виды регрессий и корреляций При изучении взаимосвязи факторных и результативных признаков могут быть следующие случаи: а)

- 6. Виды регрессии классифицируются по следующим признакам: а) по числу переменных, учитываемых в регрессии: · простая регрессия

- 7. Задачи корреляционного и регрессионного анализа 1. Задачи корреляционного анализа: а) определяет степень связи двух и более

- 9. Скачать презентацию

Слайд 2

Понятие корреляционной и регрессионной связи

Две (или более) случайных величины

1. Могут быть

Понятие корреляционной и регрессионной связи

Две (или более) случайных величины

1. Могут быть

связаны функциональной зависимостью – для каждой независимой переменной X существует вполне определенное значение зависимой переменной Y. Строгая функциональная зависимость реализуется на практике редко, т.к. обе величины подвергаются еще и влиянию случайных факторов.

2. Могут быть связаны статистической зависимостью – изменение одной случайной величины приводит к изменению распределения другой случайной величины. Если статистическая зависимость проявляется в том, что при изменении одной величины изменяетсясреднее значение другой, такую зависимость называют корреляционной.

3. Могут быть независимы.

2. Могут быть связаны статистической зависимостью – изменение одной случайной величины приводит к изменению распределения другой случайной величины. Если статистическая зависимость проявляется в том, что при изменении одной величины изменяетсясреднее значение другой, такую зависимость называют корреляционной.

3. Могут быть независимы.

Слайд 3

При изучении конкретных зависимостей между случайными величинами вводят понятия:

· факторные признаки или

При изучении конкретных зависимостей между случайными величинами вводят понятия:

· факторные признаки или

факторы - независимые или объясняющие переменные, причины. Могут быть случайными и неслучайными. Часто обозначаются X;

· результативные признаки или показатели - объясняемые или зависимые переменные. Являются случайными. Часто обозначаются Y.

Иногда X и Y можно менять местами (т.е. не только изменение X вызывает изменение Y, но и наоборот, изменение Y вызывает изменение X) .

Функциональная и корреляционная зависимость отличаются тем, что при функциональной зависимости, зная Х, можно вычислить величину Y. При корреляционной зависимости устанавливается лишь тенденция изменения Y при изменении X.

Корреляционный и регрессионный анализы имеют общие методы обработки данных, но отличаются своими целями. В корреляционном анализе оценивается наличие и глубина (сила) статистической связи, в регрессионном анализе оценивается форма статистической связи между случайными величинами.

Если не известно, какой их признаков зависимый, а какой - независимый, или же это безразлично, то X и Y равноправны, т.е. каждый из признаков может рассматриваться как независимый или как зависимый. В этом случае говорят, что X и Y коррелированны (имеют связи корреляционного типа) в широком смысле. Если переменные не равноправны, т.е. четко ясно, какая из них причина, а какая следствие, то говорят о регрессионной зависимости.

· результативные признаки или показатели - объясняемые или зависимые переменные. Являются случайными. Часто обозначаются Y.

Иногда X и Y можно менять местами (т.е. не только изменение X вызывает изменение Y, но и наоборот, изменение Y вызывает изменение X) .

Функциональная и корреляционная зависимость отличаются тем, что при функциональной зависимости, зная Х, можно вычислить величину Y. При корреляционной зависимости устанавливается лишь тенденция изменения Y при изменении X.

Корреляционный и регрессионный анализы имеют общие методы обработки данных, но отличаются своими целями. В корреляционном анализе оценивается наличие и глубина (сила) статистической связи, в регрессионном анализе оценивается форма статистической связи между случайными величинами.

Если не известно, какой их признаков зависимый, а какой - независимый, или же это безразлично, то X и Y равноправны, т.е. каждый из признаков может рассматриваться как независимый или как зависимый. В этом случае говорят, что X и Y коррелированны (имеют связи корреляционного типа) в широком смысле. Если переменные не равноправны, т.е. четко ясно, какая из них причина, а какая следствие, то говорят о регрессионной зависимости.

Слайд 4

Регрессия - это односторонняя стохастическая зависимость, когда одна из переменных служит причиной

Регрессия - это односторонняя стохастическая зависимость, когда одна из переменных служит причиной

для изменения другой.

Например, при изучении потребления электроэнергии (Y) в зависимости от объема производства (X) речь идет об односторонней связи, следовательно, о регрессии.

Существуют особенности, связанные с постановкой задачи:

· если изучают стохастическую зависимость Y от X, то устанавливают регрессию Y на X, т.е. Y=f(X);

· если изучают стохастическую зависимость X от Y - то устанавливают регрессию X на Y, т.е. Х=g(Y).

Например, изучается влияние стоимости товара на спрос и влияние спроса на стоимость товара. Здесь и стоимость, и спрос могут быть зависимой и независимой переменными в зависимости от постановки задачи.

Могут быть ситуации, когда обратная регрессия не имеет физического смысла, например, урожайность зависит от количества осадков, обратная зависимость бессмысленна.

Например, при изучении потребления электроэнергии (Y) в зависимости от объема производства (X) речь идет об односторонней связи, следовательно, о регрессии.

Существуют особенности, связанные с постановкой задачи:

· если изучают стохастическую зависимость Y от X, то устанавливают регрессию Y на X, т.е. Y=f(X);

· если изучают стохастическую зависимость X от Y - то устанавливают регрессию X на Y, т.е. Х=g(Y).

Например, изучается влияние стоимости товара на спрос и влияние спроса на стоимость товара. Здесь и стоимость, и спрос могут быть зависимой и независимой переменными в зависимости от постановки задачи.

Могут быть ситуации, когда обратная регрессия не имеет физического смысла, например, урожайность зависит от количества осадков, обратная зависимость бессмысленна.

Слайд 5

Виды регрессий и корреляций

При изучении взаимосвязи факторных и результативных признаков могут

Виды регрессий и корреляций

При изучении взаимосвязи факторных и результативных признаков могут

быть следующие случаи:

а) X и Y — случайные величины;

б) Х- неслучайная величина, Y - случайная величина.

Виды корреляции классифицируются по следующим признакам:

а) по характеру корреляции:

· положительная (или равнонаправленная, прямая корреляция);

· отрицательная (или обратная корреляция);

б) по числу переменных:

· простая или парная корреляция (две переменных X и Y);

· множественная корреляция (рассматривается связь более двух переменных);

· частная корреляция (рассматривается связь между двумя переменными при фиксированном влиянии других переменных);

в) по форме связи:

· линейная корреляция;

· нелинейная корреляция;

г) по типу связи признаков:

· непосредственная корреляция;

· косвенная корреляция;

· ложная корреляция.

а) X и Y — случайные величины;

б) Х- неслучайная величина, Y - случайная величина.

Виды корреляции классифицируются по следующим признакам:

а) по характеру корреляции:

· положительная (или равнонаправленная, прямая корреляция);

· отрицательная (или обратная корреляция);

б) по числу переменных:

· простая или парная корреляция (две переменных X и Y);

· множественная корреляция (рассматривается связь более двух переменных);

· частная корреляция (рассматривается связь между двумя переменными при фиксированном влиянии других переменных);

в) по форме связи:

· линейная корреляция;

· нелинейная корреляция;

г) по типу связи признаков:

· непосредственная корреляция;

· косвенная корреляция;

· ложная корреляция.

Слайд 6

Виды регрессии классифицируются по следующим признакам:

а) по числу переменных, учитываемых в регрессии:

· простая

Виды регрессии классифицируются по следующим признакам:

а) по числу переменных, учитываемых в регрессии:

· простая

регрессия (парная – рассматриваются две переменных);

· множественная, или частная регрессия (рассматривается более двух переменных);

б) по форме зависимости между факторными и результирующими признаками:

· линейная регрессия (признаки связаны линейной зависимостью);

· нелинейная регрессия (признаки связаны нелинейной зависимостью);

в) по характеру регрессии (имеет смысл только для простой линейной регрессии):

· положительная регрессия;

· отрицательная регрессия;

г) по типу связи факторных и результирующих признаков:

· непосредственная регрессия - причина прямо воздействует на следствие;

· косвенная регрессия, Y и X не состоят в прямой зависимости, а определяются общей для них причиной через третью переменную;

· нонсенс-регрессия (абсурдная).

· множественная, или частная регрессия (рассматривается более двух переменных);

б) по форме зависимости между факторными и результирующими признаками:

· линейная регрессия (признаки связаны линейной зависимостью);

· нелинейная регрессия (признаки связаны нелинейной зависимостью);

в) по характеру регрессии (имеет смысл только для простой линейной регрессии):

· положительная регрессия;

· отрицательная регрессия;

г) по типу связи факторных и результирующих признаков:

· непосредственная регрессия - причина прямо воздействует на следствие;

· косвенная регрессия, Y и X не состоят в прямой зависимости, а определяются общей для них причиной через третью переменную;

· нонсенс-регрессия (абсурдная).

Слайд 7

Задачи корреляционного и регрессионного анализа

1. Задачи корреляционного анализа:

а) определяет степень связи двух

Задачи корреляционного и регрессионного анализа

1. Задачи корреляционного анализа:

а) определяет степень связи двух

и более признаков;

б) определяет факторы оказывающее наибольшее влияние на результирующий признак Y.

2. Задачи регрессионного анализа:

а) устанавливает форму зависимости (для случая парной регрессии – убывающая или возрастающая);

б) определяет вид функции регрессии;

в) оценивает неизвестные значения зависимой переменной Y (можно воспроизвести значение Y при заданных значениях X внутри рассматриваемого интервала (интерполяция) и вне интервала (экстраполяция)).

Ход рассуждений, постановка задачи, получаемые результаты в корреляционном и регрессионном анализе различны, но очень часто эти два вида анализа проводятся параллельно на одном и том же массиве исходных данных.

б) определяет факторы оказывающее наибольшее влияние на результирующий признак Y.

2. Задачи регрессионного анализа:

а) устанавливает форму зависимости (для случая парной регрессии – убывающая или возрастающая);

б) определяет вид функции регрессии;

в) оценивает неизвестные значения зависимой переменной Y (можно воспроизвести значение Y при заданных значениях X внутри рассматриваемого интервала (интерполяция) и вне интервала (экстраполяция)).

Ход рассуждений, постановка задачи, получаемые результаты в корреляционном и регрессионном анализе различны, но очень часто эти два вида анализа проводятся параллельно на одном и том же массиве исходных данных.

- Предыдущая

Геометрический смысл производнойСледующая -

Расчет нелинейных цепей графическим методом

Предмет, метод, задачи и организация статистики в РФ

Предмет, метод, задачи и организация статистики в РФ Сумма углов треугольника. Тренировочные упражнения

Сумма углов треугольника. Тренировочные упражнения Математический анализ

Математический анализ Қалдықпен бөлу

Қалдықпен бөлу Решение тригонометрических уравнений

Решение тригонометрических уравнений Число «Пи» вокруг нас. МОУ СОШ №7 Г. Тверь

Число «Пи» вокруг нас. МОУ СОШ №7 Г. Тверь Сложение и вычитание смешанных чисел

Сложение и вычитание смешанных чисел Решение задач разными способами

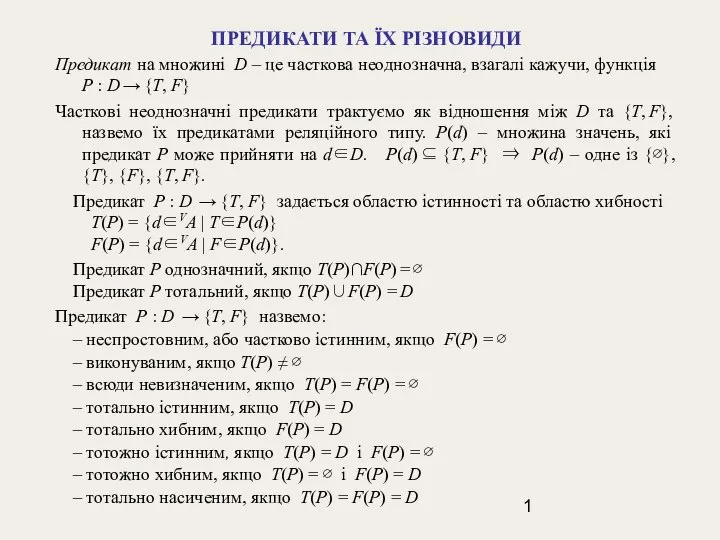

Решение задач разными способами Предикати та їх різновиди

Предикати та їх різновиди Степень с отрицательным показателем

Степень с отрицательным показателем Теория вероятностей

Теория вероятностей Математика. Тест №5

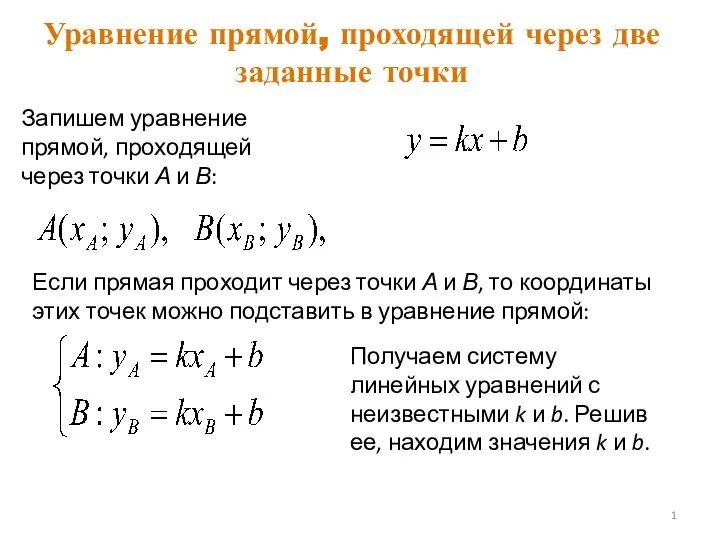

Математика. Тест №5 Уравнение прямой, проходящей через две заданные точки

Уравнение прямой, проходящей через две заданные точки Синус, косинус и тангенс углов от 0⁰ до 180 ⁰

Синус, косинус и тангенс углов от 0⁰ до 180 ⁰ Рациональные дроби и их свойства

Рациональные дроби и их свойства Теорема Виета. Квадратное уравнение

Теорема Виета. Квадратное уравнение ЖЕНЩИНАМ МАТЕМАТИКАМ …

ЖЕНЩИНАМ МАТЕМАТИКАМ … Векторы

Векторы Решение нестандартных задач Цифры не управляют миром, но они показывают, как управляется мир. (И. Гете) План презентации 1. К

Решение нестандартных задач Цифры не управляют миром, но они показывают, как управляется мир. (И. Гете) План презентации 1. К МНР-машины. Программа машины

МНР-машины. Программа машины Расстояние от точки до прямой. Перпендикулярные прямые

Расстояние от точки до прямой. Перпендикулярные прямые Что мы узнали, чему научились.

Что мы узнали, чему научились. Метод интегрирования по частям в неопределенном интеграле. Интегрирование тригонометрических функций

Метод интегрирования по частям в неопределенном интеграле. Интегрирование тригонометрических функций Аттестационная работа. Методическая разработка исследовательской работы Длина окружности и площадь круга. (6 класс)

Аттестационная работа. Методическая разработка исследовательской работы Длина окружности и площадь круга. (6 класс) Элементы комбинаторики

Элементы комбинаторики Логарифмические уравнения

Логарифмические уравнения Обобщающий урок по теме: «Синус, косинус, тангенс суммы и разности аргументов. Презентация выполнена для уроков по алгебре и начал

Обобщающий урок по теме: «Синус, косинус, тангенс суммы и разности аргументов. Презентация выполнена для уроков по алгебре и начал Корни уравнения

Корни уравнения