Содержание

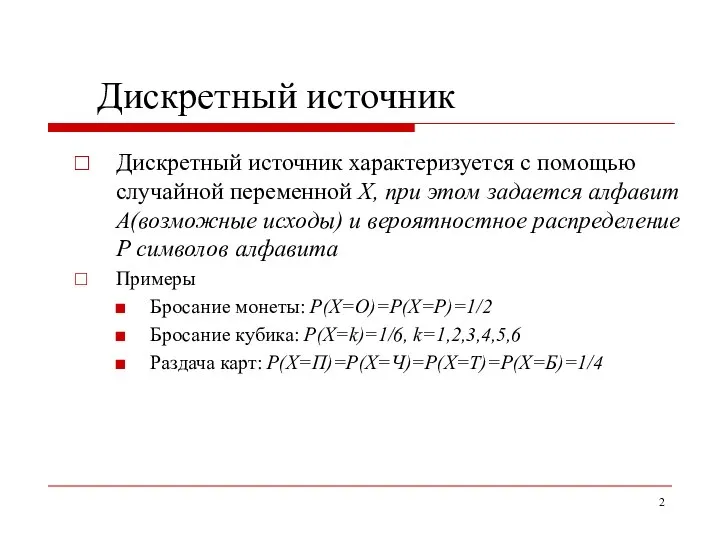

- 2. Дискретный источник Дискретный источник характеризуется с помощью случайной переменной X, при этом задается алфавит A(возможные исходы)

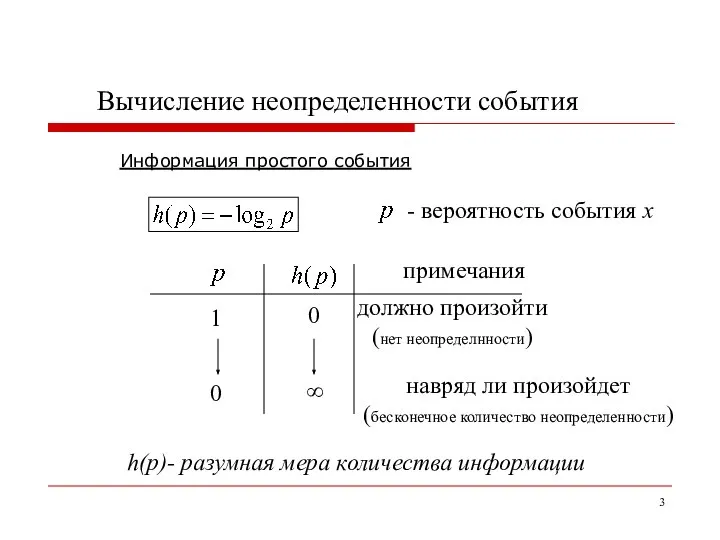

- 3. Вычисление неопределенности события вероятность события x 1 0 0 ∞ примечания должно произойти (нет неопределнности) навряд

- 4. Взвешенная информация простого события 0 1 0 ∞ 1/2 1 0 0 1/2 При возрастании p

- 5. p=1/e Максимум взвешенной информации

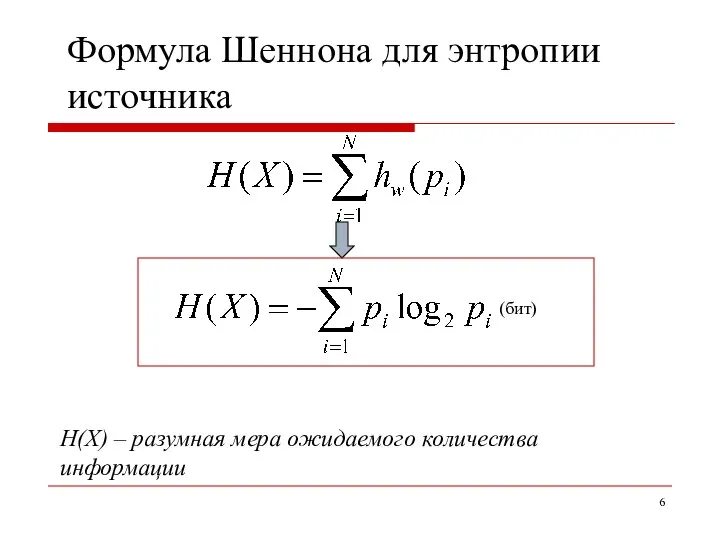

- 6. Формула Шеннона для энтропии источника H(X) – разумная мера ожидаемого количества информации

- 7. Пример (бернуллиевский источник) Бросание монеты с вероятностью выпадания орла p (0 Крайние случаи: При p стремящемся

- 8. Энтропия бернуллиевского источника

- 9. Некоторые свойства H(X) Неотрицательная Максимум достигается при равномерном распределении

- 10. Какая польза от H(X)? Первая теорема Шеннона (Шеннона-Хартли) Для дискретного источника без памяти X, его энтропия

- 11. Избыточность кода источника Теоретическая граница Практическое значение

- 12. Проверка формулы Шеннона. Игра в числа

- 13. Проверка формулы Шеннона. Игра в «Морской бой» (упрощенная)

- 14. Лотерея с «неправильной» монетой Номера билетов: 0000…………….00 0000…………….01 0000…………….10 ……………………. 1111…………….11 Стоимость билетов – 100 руб.

- 16. Скачать презентацию

Степень с целым отрицательным показателем

Степень с целым отрицательным показателем Многогранники

Многогранники Интегралы, локальные вклады. (Лекция 3)

Интегралы, локальные вклады. (Лекция 3) Линейные алгоритмы

Линейные алгоритмы Простейшие тригонометрические уравнения

Простейшие тригонометрические уравнения Презентация Учет инфляции в финансовых вычислениях

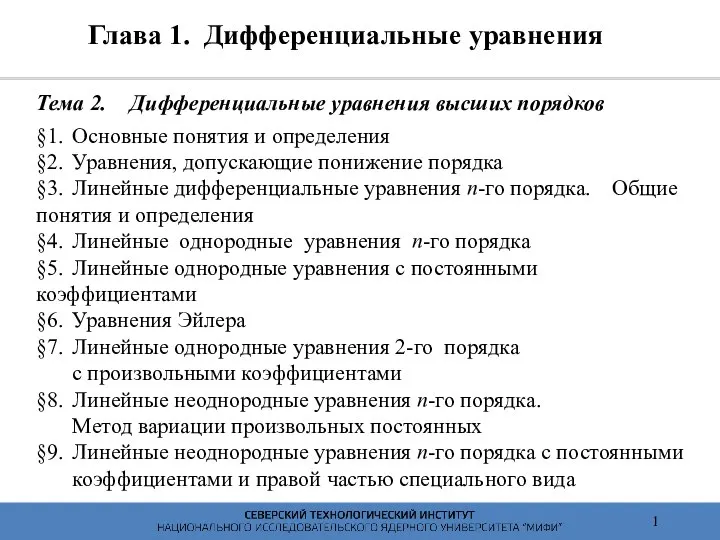

Презентация Учет инфляции в финансовых вычислениях Дифференциальные уравнения высших порядков

Дифференциальные уравнения высших порядков Задачи на разрезания и перекраивания фигур Факультатив . Математика 5 класс Учитель математики школы №91 Г.А.Ларькина Г.Нижний

Задачи на разрезания и перекраивания фигур Факультатив . Математика 5 класс Учитель математики школы №91 Г.А.Ларькина Г.Нижний  Задачи на Проценты

Задачи на Проценты Метрология в прошлом и настоящем

Метрология в прошлом и настоящем Математические гонки. Интерактивный тренажёр. Счёт в пределах 10

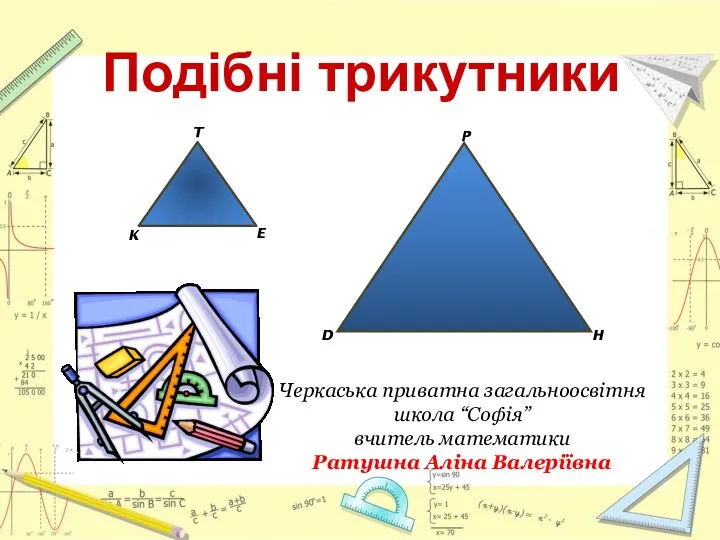

Математические гонки. Интерактивный тренажёр. Счёт в пределах 10 Подібні трикутники

Подібні трикутники Построение графиков функций при решении квадратных уравнений

Построение графиков функций при решении квадратных уравнений Сумма углов треугольника. Теорема

Сумма углов треугольника. Теорема Тест по основам метрологии

Тест по основам метрологии Теорема Пифагора. Пифагоровы штаны

Теорема Пифагора. Пифагоровы штаны Теория рядов

Теория рядов Деление с остатком на 10, 100 и 1000

Деление с остатком на 10, 100 и 1000 Нумерация чисел в концентре 1000. Учебник Аргинская, развивающая система Занкова

Нумерация чисел в концентре 1000. Учебник Аргинская, развивающая система Занкова Нестандартные задачи на множества. Начальная школа +

Нестандартные задачи на множества. Начальная школа + Решение задач в два действия. 1 класс

Решение задач в два действия. 1 класс Методика формирования элементарных математических представлений как научная область

Методика формирования элементарных математических представлений как научная область Построение графиков, содержащих выражение под знаком модуля

Построение графиков, содержащих выражение под знаком модуля Создание функций из массива данных. Интерполяция. Регрессия. Прикладные методы расчета и программные комплексы (4)

Создание функций из массива данных. Интерполяция. Регрессия. Прикладные методы расчета и программные комплексы (4) Подобие треугольников

Подобие треугольников Основы теории вероятности и математической статистики. Лекция 4

Основы теории вероятности и математической статистики. Лекция 4 Золотое сечение

Золотое сечение Задачи на проценты. Путешествие по лабиринту, урок-игра в 5-м классе

Задачи на проценты. Путешествие по лабиринту, урок-игра в 5-м классе