Содержание

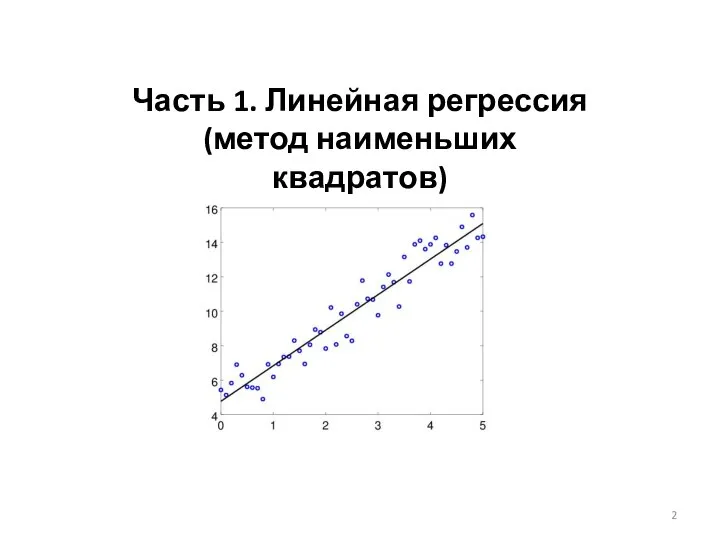

- 2. Часть 1. Линейная регрессия (метод наименьших квадратов)

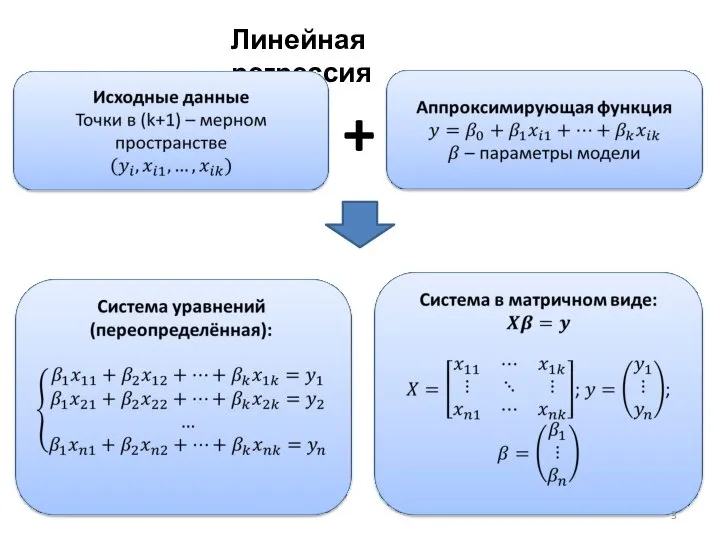

- 3. Линейная регрессия +

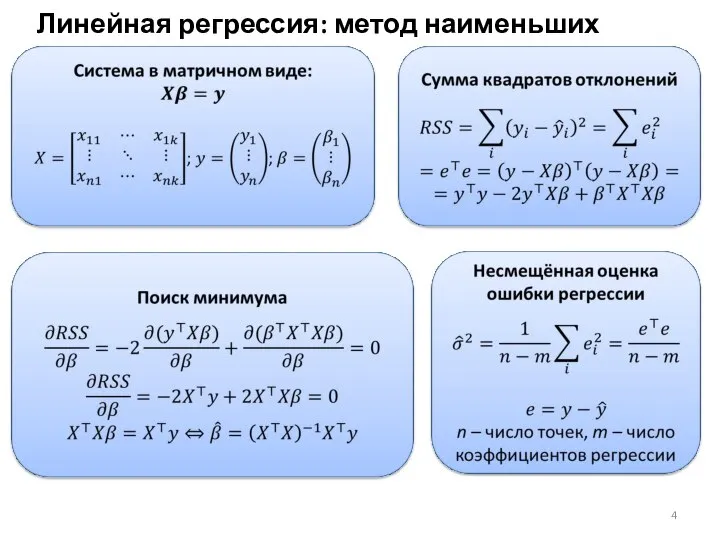

- 4. Линейная регрессия: метод наименьших квадратов

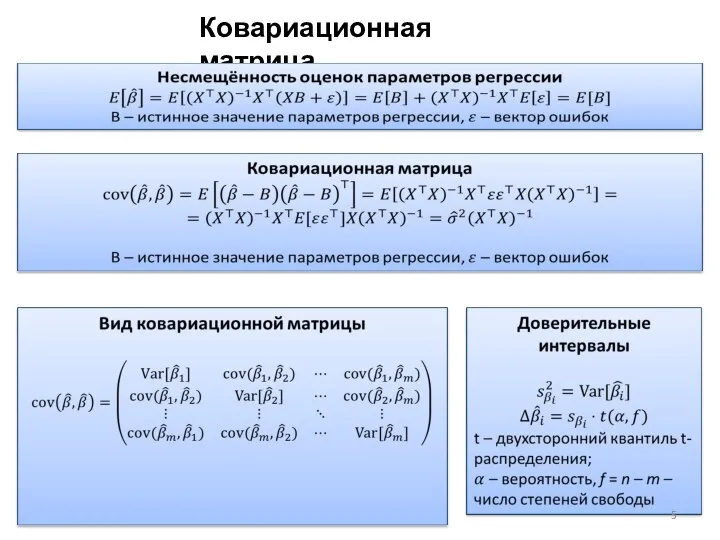

- 5. Ковариационная матрица

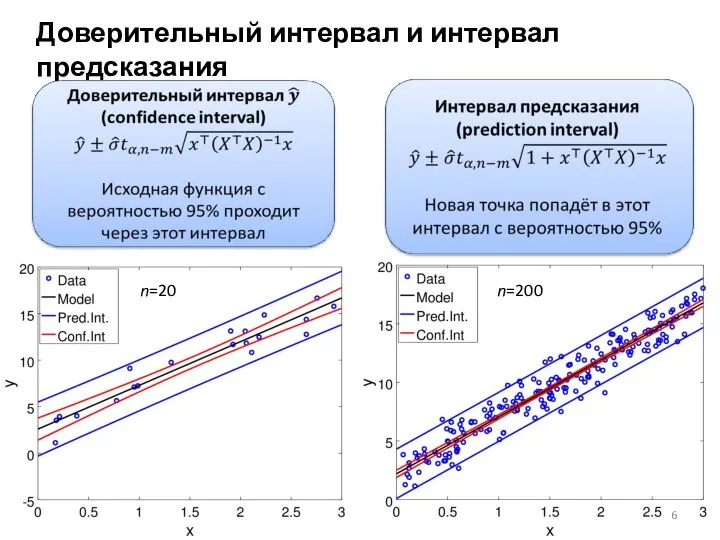

- 6. Доверительный интервал и интервал предсказания n=20 n=200

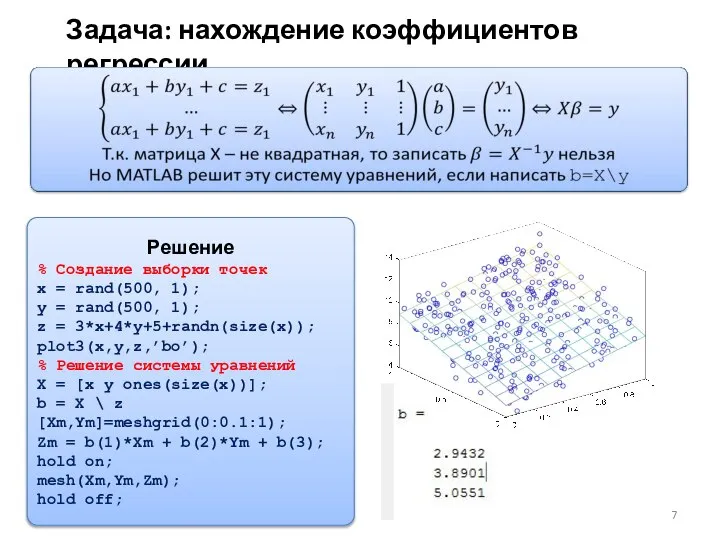

- 7. Задача: нахождение коэффициентов регрессии Решение % Создание выборки точек x = rand(500, 1); y = rand(500,

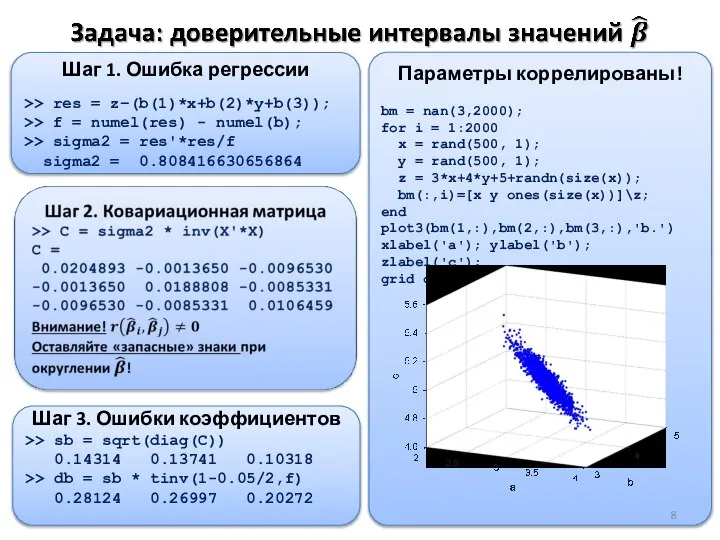

- 8. Параметры коррелированы! bm = nan(3,2000); for i = 1:2000 x = rand(500, 1); y = rand(500,

- 9. Часть 2. Нелинейная регрессия (метод наименьших квадратов)

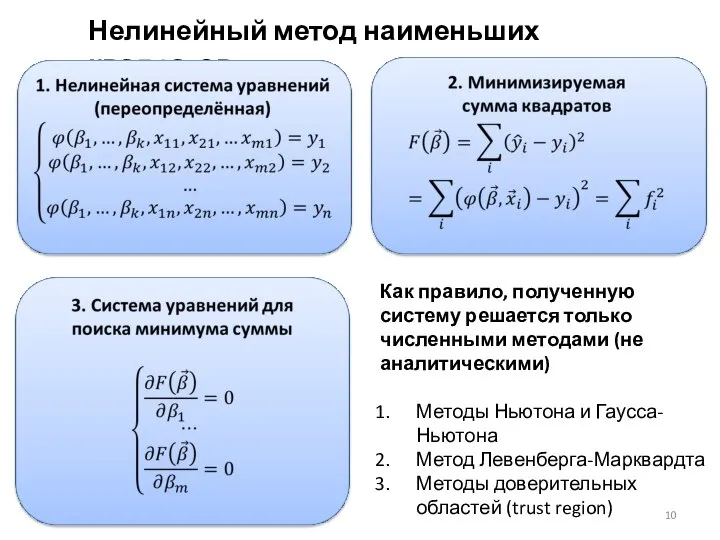

- 10. Нелинейный метод наименьших квадратов Как правило, полученную систему решается только численными методами (не аналитическими) Методы Ньютона

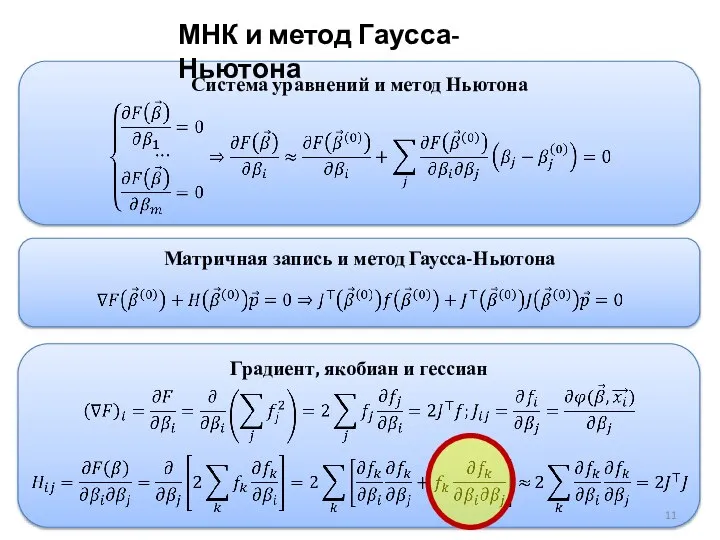

- 11. Матричная запись и метод Гаусса-Ньютона Система уравнений и метод Ньютона Градиент, якобиан и гессиан МНК и

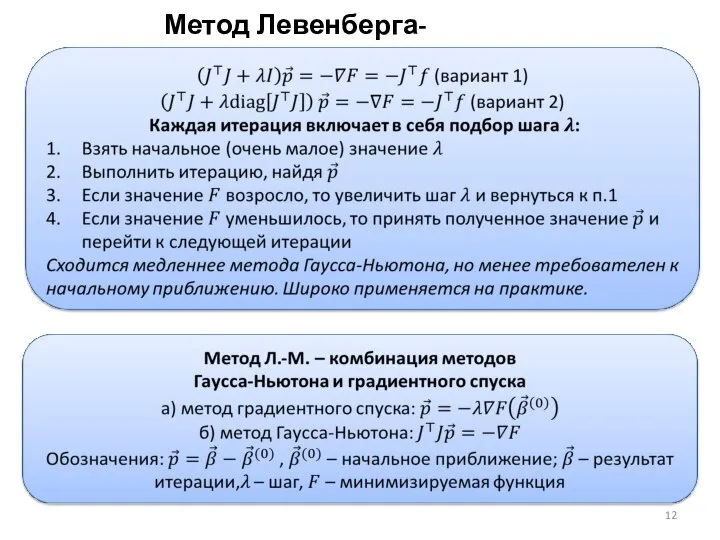

- 12. Метод Левенберга-Марквардта

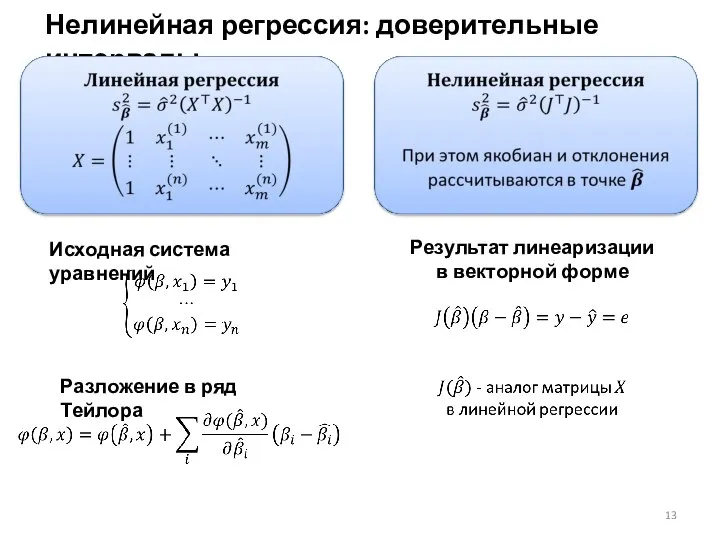

- 13. Нелинейная регрессия: доверительные интервалы Исходная система уравнений Результат линеаризации в векторной форме Разложение в ряд Тейлора

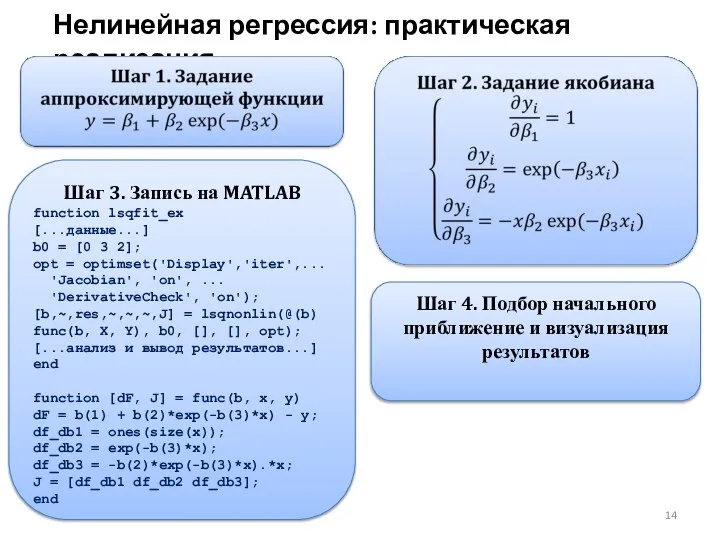

- 14. Нелинейная регрессия: практическая реализация Шаг 3. Запись на MATLAB function lsqfit_ex [...данные...] b0 = [0 3

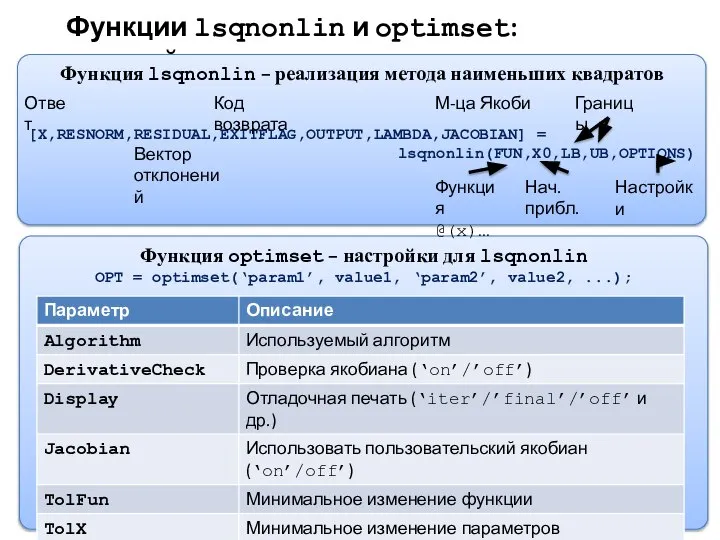

- 15. Функция optimset – настройки для lsqnonlin OPT = optimset(‘param1’, value1, ‘param2’, value2, ...); Функции lsqnonlin и

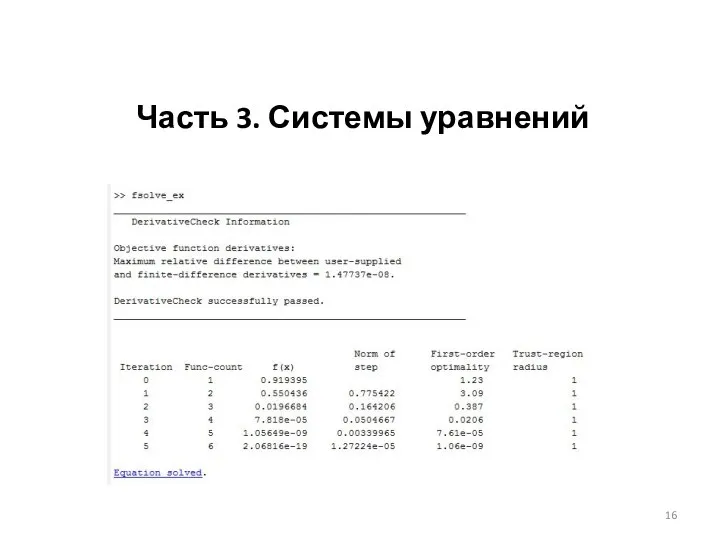

- 16. Часть 3. Системы уравнений

- 17. Решение без якобиана >> f=@(p)[p(1)^3+cos(p(2))-2; sin(p(1)^2) + log(p(2))]; >> [p,ff] = fsolve(f,[1 1]) Equation solved [...дополнительная

- 19. Скачать презентацию

![Решение без якобиана >> f=@(p)[p(1)^3+cos(p(2))-2; sin(p(1)^2) + log(p(2))]; >> [p,ff] =](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/709690/slide-16.jpg)

Случайная величина (СВ) и закон ее распределения

Случайная величина (СВ) и закон ее распределения Математика в в профессии

Математика в в профессии Перетворення графіків функцій

Перетворення графіків функцій Основные понятия теории графов

Основные понятия теории графов Булевы функции

Булевы функции Модуль. Определение. Свойства. Геометрический смысл модуля

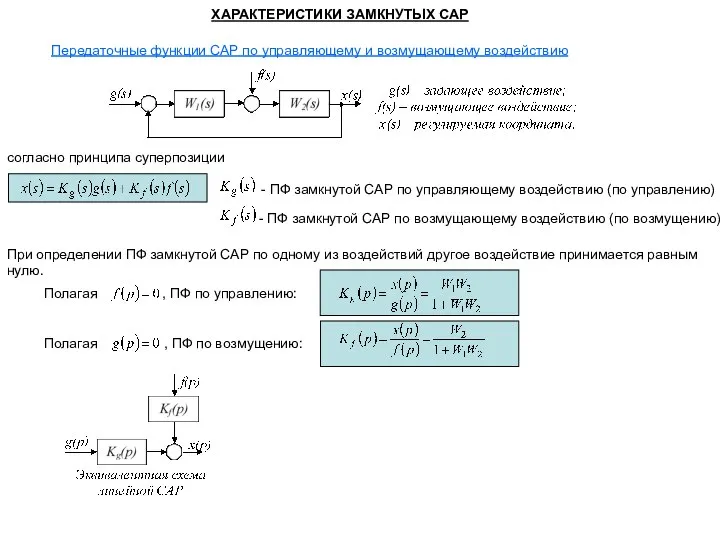

Модуль. Определение. Свойства. Геометрический смысл модуля Характеристики замкнутых САР

Характеристики замкнутых САР Алгебра и начала анализа. Профильное обучение 10 класс

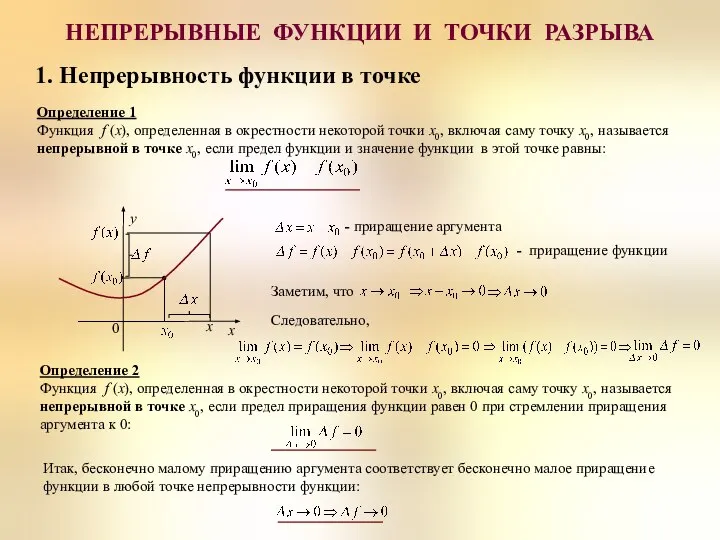

Алгебра и начала анализа. Профильное обучение 10 класс Непрерывные функции и точки разрыва

Непрерывные функции и точки разрыва Определение числовой функции и способы её задания. (10 класс)

Определение числовой функции и способы её задания. (10 класс) Аттестационная работа. Практико-ориентированные задачи на уроках математики

Аттестационная работа. Практико-ориентированные задачи на уроках математики Преобразование выражений, содержащих операцию извлечения квадратного корня

Преобразование выражений, содержащих операцию извлечения квадратного корня Моделирование корреляционных зависимостей

Моделирование корреляционных зависимостей Построение сечения куба, нахождение его координат и площади

Построение сечения куба, нахождение его координат и площади Занимательный материал на десятичные дроби

Занимательный материал на десятичные дроби Решение задач с помощью систем линейных уравнений

Решение задач с помощью систем линейных уравнений Призма. Понятие призмы

Призма. Понятие призмы 20180131_vidy_treugolnikov_po_uglam

20180131_vidy_treugolnikov_po_uglam Пак Наталья Николаевна Пак Наталья Николаевна Учитель математики ГБОУ лицей 179 Урок геометрии в 8 классе

Пак Наталья Николаевна Пак Наталья Николаевна Учитель математики ГБОУ лицей 179 Урок геометрии в 8 классе  Знаходження площі геометричної фігури

Знаходження площі геометричної фігури Аксиома параллельных прямых

Аксиома параллельных прямых Машинное обучение и анализ данных. Линейные модели. Логистическая регрессия

Машинное обучение и анализ данных. Линейные модели. Логистическая регрессия Сумма n первых членов геометрической прогрессии

Сумма n первых членов геометрической прогрессии Функція f(x)=sin x

Функція f(x)=sin x Решение задач на проценты. Как найти % от числа

Решение задач на проценты. Как найти % от числа Углы на плоскости

Углы на плоскости Изображение пространственных фигур на плоскости

Изображение пространственных фигур на плоскости Теория вероятностей и математическая статистика

Теория вероятностей и математическая статистика