Содержание

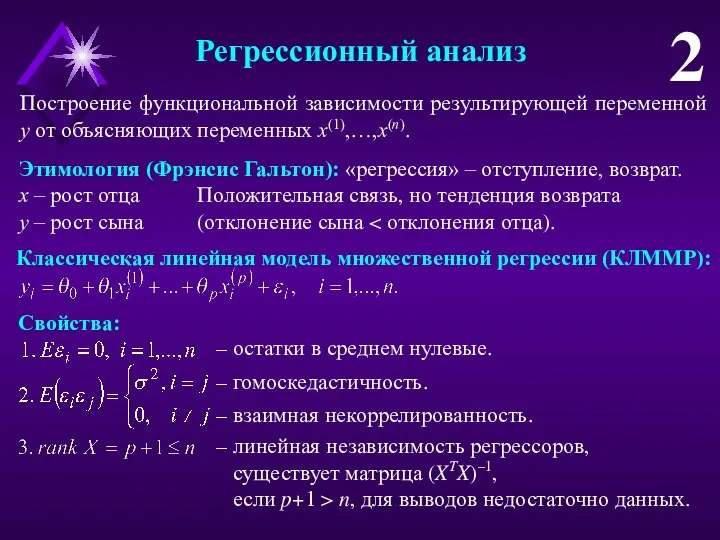

- 2. Регрессионный анализ 2 Построение функциональной зависимости результирующей переменной y от объясняющих переменных x(1),…,x(n). Этимология (Фрэнсис Гальтон):

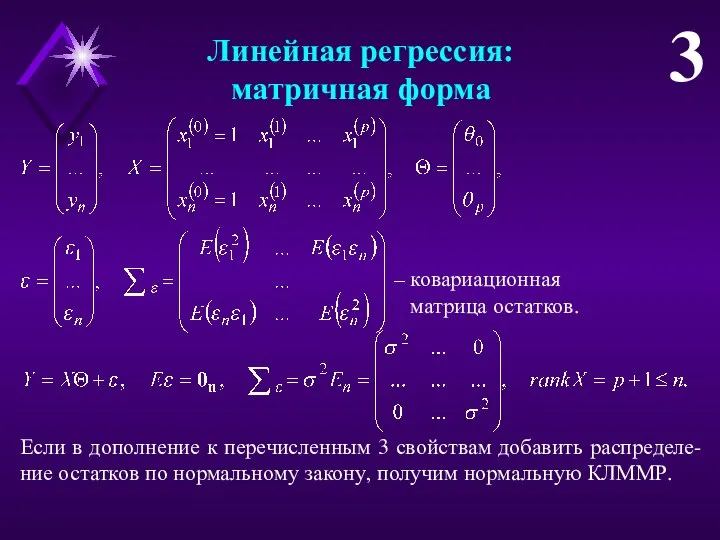

- 3. Линейная регрессия: матричная форма 3 – ковариационная матрица остатков. Если в дополнение к перечисленным 3 свойствам

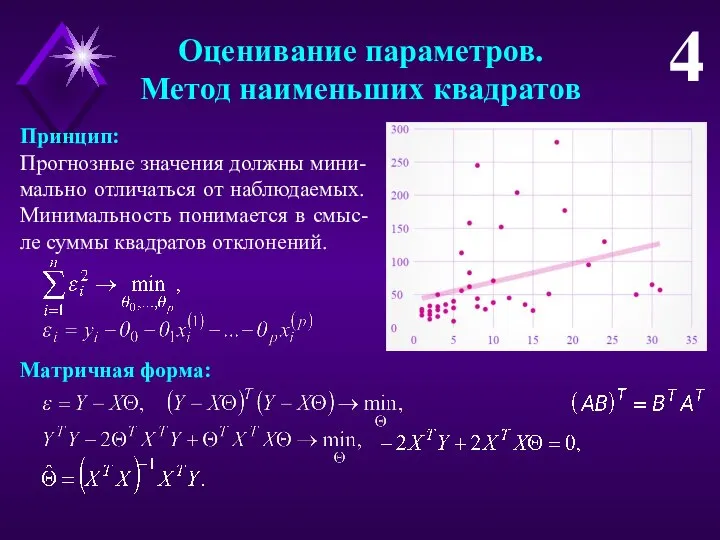

- 4. Оценивание параметров. Метод наименьших квадратов 4 Принцип: Прогнозные значения должны мини-мально отличаться от наблюдаемых. Минимальность понимается

- 5. Метод наименьших квадратов. Случай парной регрессии 5 Формулы МНК для парной регрессии y = θ0 +

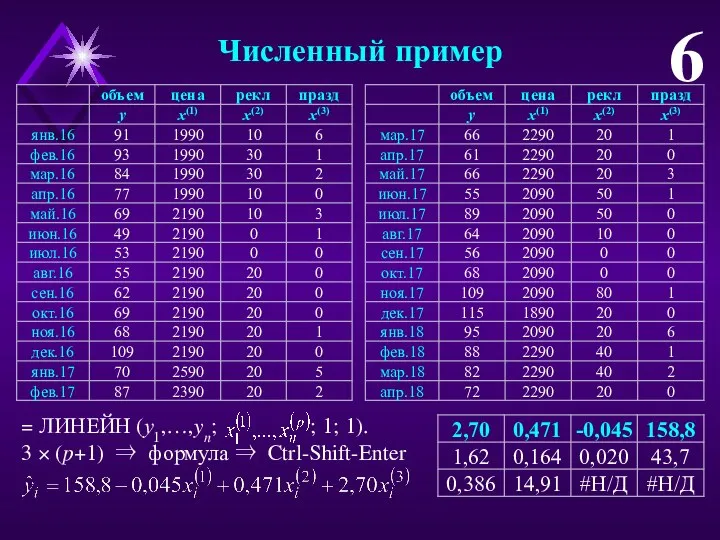

- 6. Численный пример 6 = ЛИНЕЙН (у1,…,yn; ; 1; 1). 3 × (p+1) ⇒ формула ⇒ Ctrl-Shift-Enter

- 7. Свойства оценок 7 На разных выборках за счет случайного характера остатков будут получены различные оценки! 1.

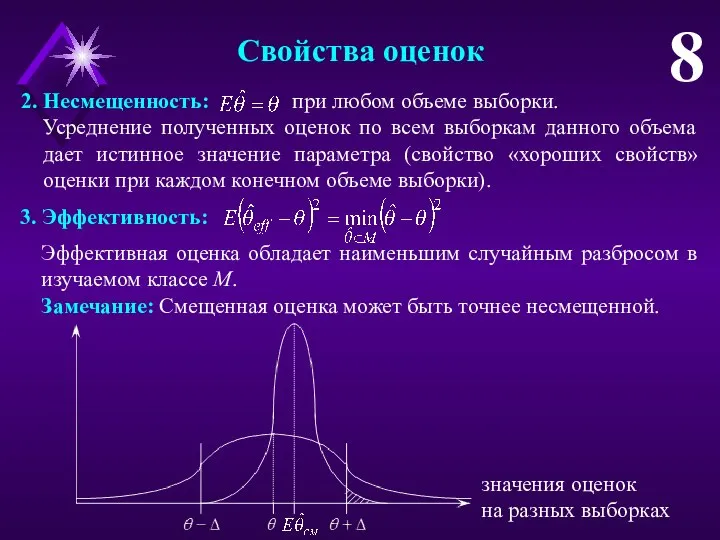

- 8. Свойства оценок 8 2. Несмещенность: при любом объеме выборки. Усреднение полученных оценок по всем выборкам данного

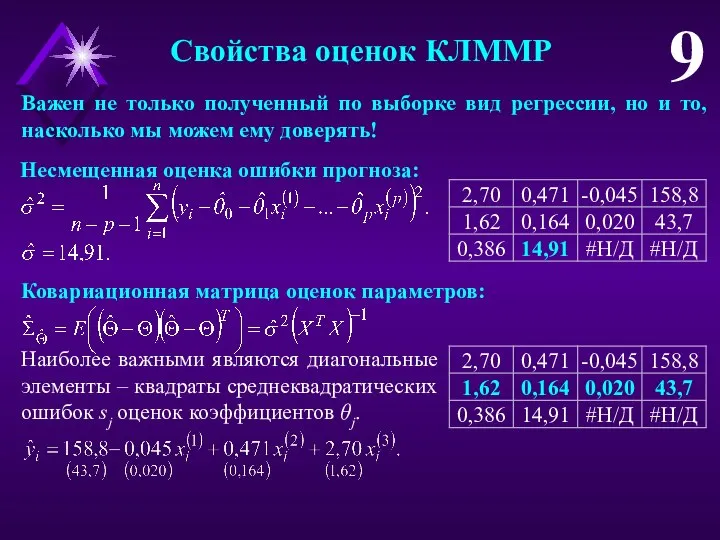

- 9. Свойства оценок КЛММР 9 Несмещенная оценка ошибки прогноза: Ковариационная матрица оценок параметров: Наиболее важными являются диагональные

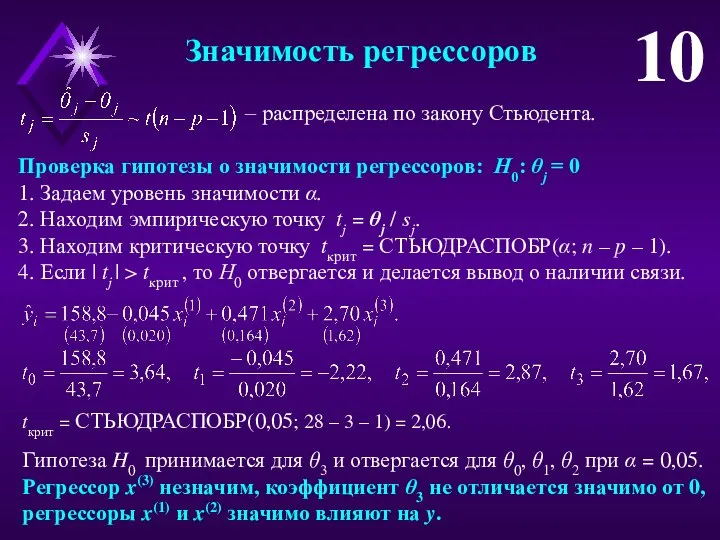

- 10. Значимость регрессоров 10 – распределена по закону Стьюдента. Проверка гипотезы о значимости регрессоров: Н0: θj =

- 11. Построение доверительного интервала 11 При уровне значимости 1% (tкрит = 2,80) незначимой становится цена, при 0,1%

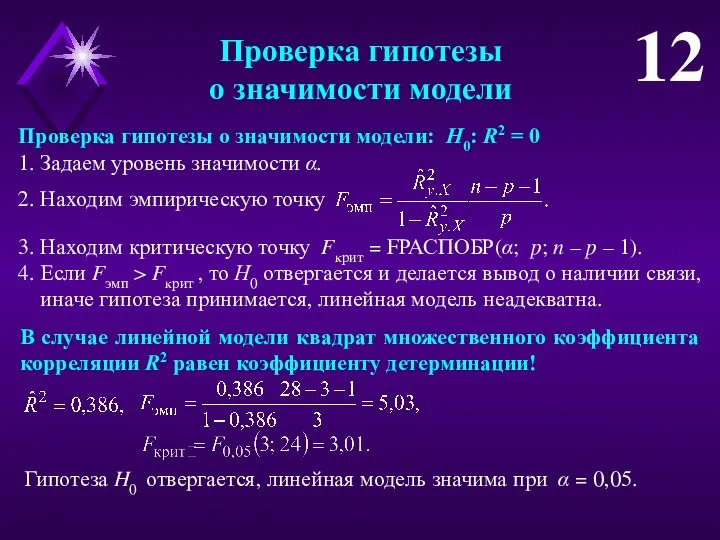

- 12. Проверка гипотезы о значимости модели 12 Проверка гипотезы о значимости модели: Н0: R2 = 0 1.

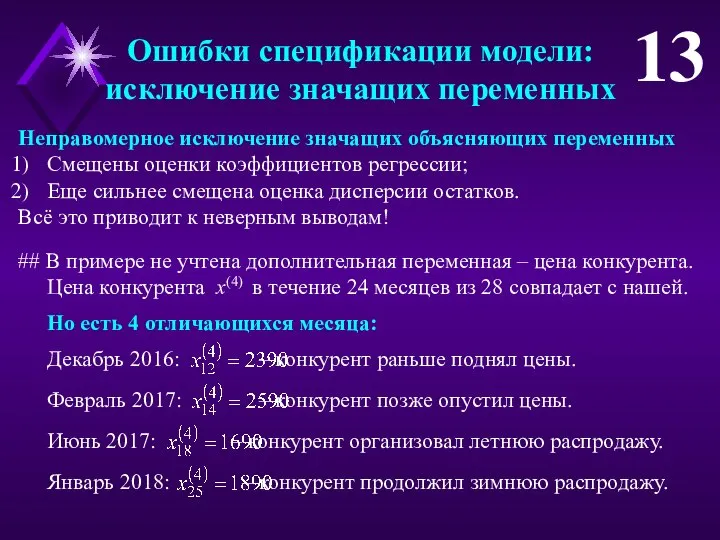

- 13. Ошибки спецификации модели: исключение значащих переменных 13 Неправомерное исключение значащих объясняющих переменных Смещены оценки коэффициентов регрессии;

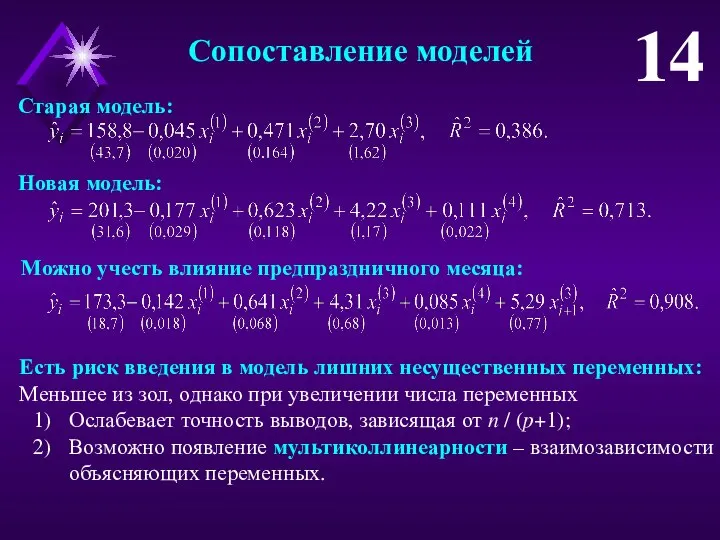

- 14. Сопоставление моделей 14 Старая модель: Новая модель: Можно учесть влияние предпраздничного месяца: Есть риск введения в

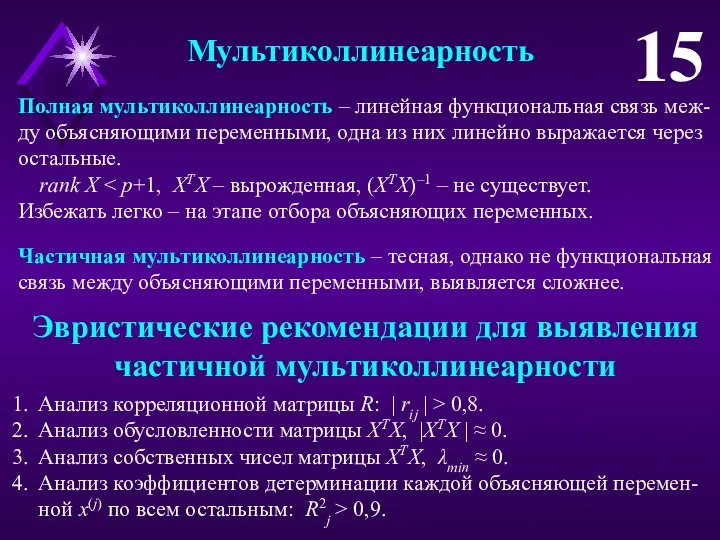

- 15. Мультиколлинеарность 15 Полная мультиколлинеарность – линейная функциональная связь меж-ду объясняющими переменными, одна из них линейно выражается

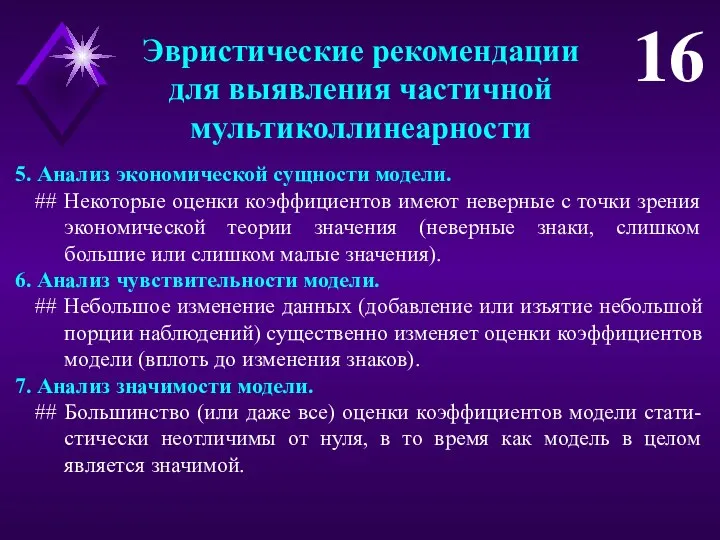

- 16. Эвристические рекомендации для выявления частичной мультиколлинеарности 16 5. Анализ экономической сущности модели. ## Некоторые оценки коэффициентов

- 17. Переход к смещенным методам оценивания 17 значения оценок на разных выборках Смещенная оценка может быть более

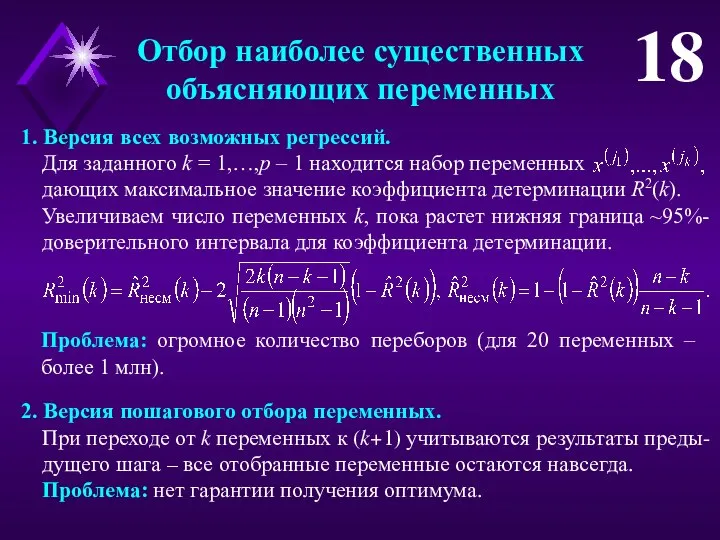

- 18. Отбор наиболее существенных объясняющих переменных 18 1. Версия всех возможных регрессий. Для заданного k = 1,…,p

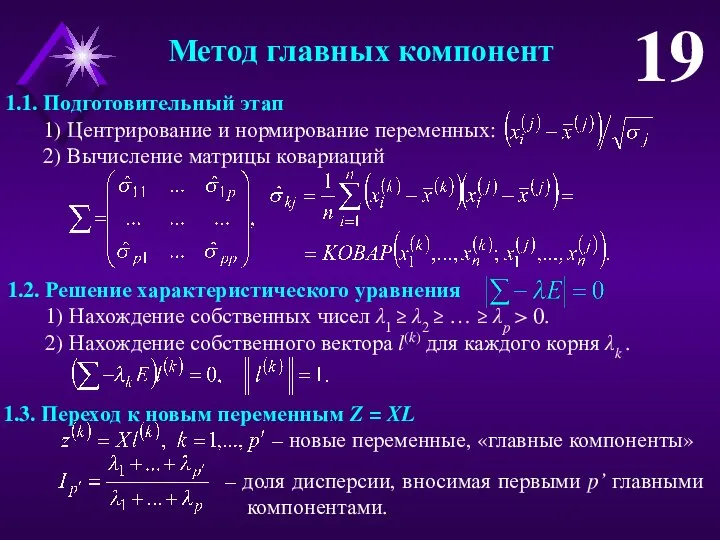

- 19. Метод главных компонент 19 3. Переход к новым переменным Z = XL – новые переменные, «главные

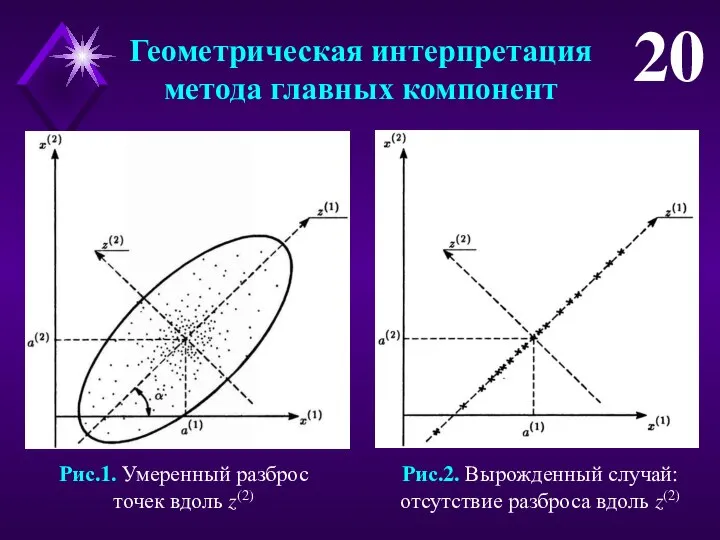

- 20. Геометрическая интерпретация метода главных компонент 20 Рис.1. Умеренный разброс точек вдоль z(2) Рис.2. Вырожденный случай: отсутствие

- 21. Проблема интерпретации метода главных компонент 21 Матрица нагрузок главных компонент на исходные переменные: ## Наблюдения –

- 23. Скачать презентацию

Математическое моделирование. (Лекция 3)

Математическое моделирование. (Лекция 3) Третий признак равенства треугольников

Третий признак равенства треугольников Аттестационная работа. Решение задач повышенной сложности

Аттестационная работа. Решение задач повышенной сложности ТЕСТ по математике

ТЕСТ по математике Правильный восьмиугольник

Правильный восьмиугольник Проверка домашнего задания

Проверка домашнего задания Признаки равенства треугольников

Признаки равенства треугольников Графы и их представление на ЭВМ

Графы и их представление на ЭВМ Призма и пирамида

Призма и пирамида Соотношения между сторонами и углами прямоугольного треугольника

Соотношения между сторонами и углами прямоугольного треугольника Множества. Алгебра логики

Множества. Алгебра логики Композиция и макетирование. Закономерности композиции. (Тема 2)

Композиция и макетирование. Закономерности композиции. (Тема 2) Логические задачки

Логические задачки Теорема Пифагора

Теорема Пифагора Спецификация КИМ ЕГЭ 2015 г. Проверяемые требования (умения)

Спецификация КИМ ЕГЭ 2015 г. Проверяемые требования (умения) Теорема Пифагора. Деление дробей

Теорема Пифагора. Деление дробей Деление с остатком

Деление с остатком Презентация по математике "Древнейшая нумерация" - скачать

Презентация по математике "Древнейшая нумерация" - скачать  Платоновы тела и тайна мироздания

Платоновы тела и тайна мироздания Комплексные числа

Комплексные числа Симметрия. Повторение, 8 класс (пункт 48, стр 110)

Симметрия. Повторение, 8 класс (пункт 48, стр 110) Тетраэдр. Задания для устного счета. Упражнение 5

Тетраэдр. Задания для устного счета. Упражнение 5 Десятичный и натуральный логарифмы Подготовил учитель математики СШ №12 Пышкин К.А

Десятичный и натуральный логарифмы Подготовил учитель математики СШ №12 Пышкин К.А  Аксиомы стереометрии

Аксиомы стереометрии Обобщающие статистические показатели

Обобщающие статистические показатели Применение производной к решению задач ЕГЭ

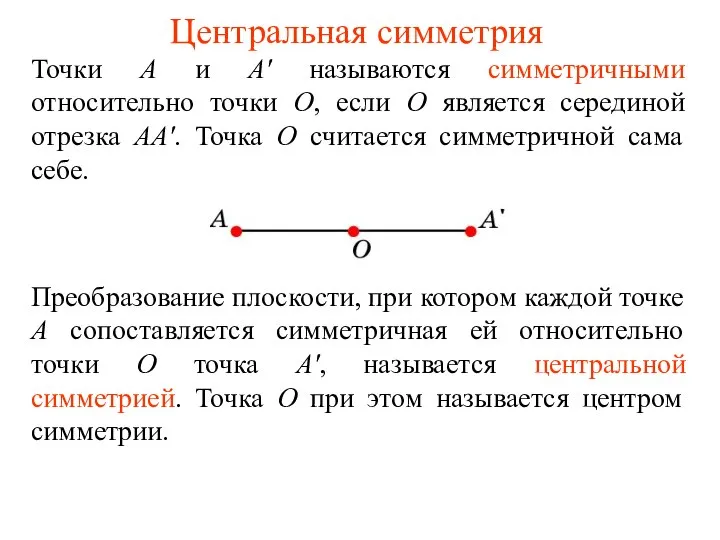

Применение производной к решению задач ЕГЭ Центральная симметрия

Центральная симметрия Аттестационная работа. Методическая разработка по выполнению проекта «Цифры и числа в нашей жизни»

Аттестационная работа. Методическая разработка по выполнению проекта «Цифры и числа в нашей жизни»